Делиться

Введение

В настоящее время мы живем во времена, когда искусственный интеллект, особенно модели обработки больших языков, такие как ChatGPT, глубоко интегрированы в нашу повседневную жизнь и рабочие процессы. Эти модели способны выполнять самые разнообразные задачи, от сложных, таких как написание кода, до простых, таких как суммирование текста. Однако впечатляющие возможности этих моделей в значительной степени сдерживаются одним узким местом. Несмотря на то, что используемое оборудование позволяет запускать эти модели с невероятно высокой скоростью, сам процесс получения ответа от них может оставаться довольно медленным и вялым.

Мотивация

По сути, для каждого слова, сгенерированного моделью, веса модели должны быть загружены в видеопамять графического процессора из системной памяти, где происходит весь процесс вычисления, после чего все данные возвращаются обратно в системную память. Поскольку само вычисление занимает гораздо меньше времени, чем передача данных между областями памяти, чип вынужден простаивать в ожидании следующей партии данных. Это очень неэффективно.

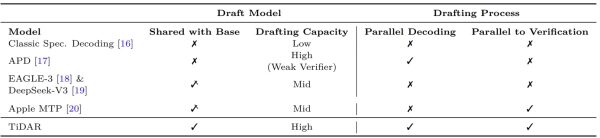

Было предпринято несколько попыток разработать алгоритмы, которые бы поддерживали активность чипа, а не позволяли ему простаивать между передачами памяти. Одним из таких методов является спекулятивное декодирование [2] , где меньшая модель, обычно гораздо более слабая, используется для создания множества будущих токенов, которые основная модель проверяет одновременно. Но поскольку меньшая модель часто гораздо менее интеллектуальна, она совершает много ошибок, которые основная модель затем вынуждена отклонять, что сводит на нет всю цель. С другой стороны, чисто параллельные диффузионные модели могут записывать сотни токенов одновременно, но эта скорость часто достигается за счет точности и согласованности языка. При точности моделей AR и скорости диффузионных моделей идеальная архитектура должна находиться где-то посередине.

Решение: TiDAR

Исследователи из Nvidia также придерживались того же мнения и поэтому предложили новую архитектуру, которую они назвали TiDAR [1] , сокращение от «Think in Diffusion, Talk in Autoregression» («Думай в диффузии, говори в авторегрессии»).

Гениальность TiDAR заключается в том, как он преобразует процесс, обычно являющийся последовательным (как в традиционных LLM), в параллельный. TiDAR показывает, что, несмотря на то, что авторегрессия и диффузия — это две совершенно разные философии проектирования, их все же можно объединить и использовать с учетом их преимуществ.

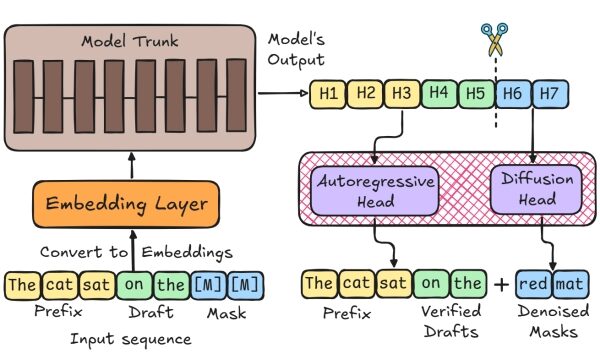

Чтобы понять его суть, нам нужно рассмотреть, как формируется входная информация для этой модели. В стандартной модели LLM мы просто подаем на вход все предыдущие слова для прогнозирования токенов по одному. В TiDAR, однако, мы формируем специальную трехкомпонентную входную последовательность.

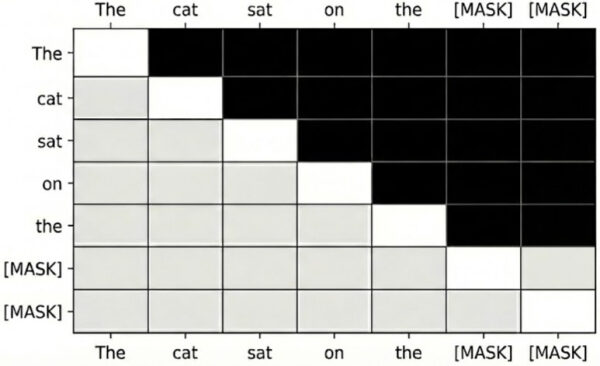

Представьте, что у нас есть предложение «Кот сел». Если сложить все части вместе, то полностью сформированная входная последовательность будет выглядеть примерно так:

- Префикс: «The», «cat», «sat» (история, полученная от пользователя).

- Черновики: «on», «the» (предположения из предыдущего шага, которые необходимо проверить на этой итерации).

- Маски будущего: [МАСКА], [МАСКА] (Пустые ячейки, куда мы хотим добавить новые варианты).

Теперь, когда мы разобрались с основами входного тензора, давайте перейдем к пониманию того, как происходит фактическая обработка.

Компонент 1: «Разговор» (Авторегрессивный верификатор)

Это первая и наиболее важная часть архитектуры модели. На этом этапе задача модели — проверить черновики, созданные в предыдущей итерации, и решить, достаточно ли они хороши для сохранения.

Как работает параллельная верификация

В конце вы можете задаться вопросом: «Если модели приходится проверять, хороши ли черновики или нет, насколько это быстрее, чем просто их генерация?» Давайте ответим на этот вопрос.

В обычной авторегрессионной модели, если вы хотите сгенерировать 5 слов, вам нужно запустить модель 5 раз. Вы подаете слово 1, чтобы получить слово 2, затем подаете слова 1+2, чтобы получить слово 3, и так далее. Графическому процессору приходится загружать огромный массив весов модели из памяти 5 раз. Это основное узкое место, которое необходимо устранить.

Именно это и исправляет TiDAR при проверке черновых токенов, поскольку он может сделать это за один проход, а это значит, что 2 слова [«on», «the»] добавляются к выходным данным всего за один прямой проход. Для этого процесса используется маска причинного внимания, которая обеспечивает:

- При включении режима «включено» модель видит только «Кот сидел».

- При проверке слова «the» модель видит только «Кот сел на».

Поскольку графический процессор представляет собой мощный параллельный процессор, он может одновременно вычислять «правильность» всех этих черновиков за одну операцию. Фактически, он выполняет 2 шага работы за цену 1 шага. Именно отсюда и берется огромное ускорение.

Механизм мгновенной коррекции

Но что произойдет, если черновик окажется неправильным? Что, если черновики будут [«in», «pizza»] вместо [«on», «the»]?

Самое приятное то, что неважно, если черновики содержат ошибки. Исправление практически бесплатно.

Модель проверяет черновики, вычисляя распределение вероятностей по своему словарю с учетом полученного контекста. Если черновики представляют собой правдоподобные предсказания, которые модель могла бы выбрать, они выбираются; если же нет, модель выбирает наиболее вероятное слово из только что вычисленного распределения.

Поскольку мы выполнили эти вычисления в том же прямом проходе, нам не нужно запускать модель снова. Мы просто:

- Отбросить неудачный черновик [«в»].

- Мгновенно замените победителя [«on»] из списка вероятностей, который мы только что рассчитали.

- Удалите все последующие черновики [«пицца»] (потому что они были основаны на неправильном слове).

Это гарантирует, что конечный результат, который мы получаем, математически так же корректен, как и при медленном, пошаговом выполнении модели. Мы получаем скорость параллельной обработки с точностью последовательной обработки.

Компонент 2: «Мышление» (Формулировщик распространения)

Пока авторегрессивный «говорящий» компонент занят проверкой того, какой токен оставить, а какой отклонить, «думающий» компонент формирует токены для следующей итерации.

Заполнение пустых мест

Помните те токены [MASK] в конце нашей входной последовательности? Диффузионная часть пытается заполнить эти пробелы, чтобы авторегрессионная часть могла проверить их на следующей итерации.

В частности, в этой части модель анализирует все слова в последовательности одновременно. Для этого она использует двунаправленную маску вместо обычной причинной маски, но только для этих токенов [MASK].

Почему двунаправленный режим?

Поскольку головка диффузии должна обрабатывать несколько токенов одновременно, она должна уметь соотносить все слова со всеми [MASK]. По сути, она должна уловить «атмосферу» последовательности, чтобы заполнить токены [MASK] и, следовательно, двунаправленную маску.

В нашем примере, модуль Diffusion анализирует все токены [MASK] вместе с историей («Кот сидел на») и пытается «очистить» их от шума, чтобы получить наиболее правдоподобный и связный текст. Он спрашивает: «Какая фраза из двух слов наиболее вероятна после „Кот сидел на“?» и может предложить «красный коврик».

Итоговая причинно-следственная маска, объединенная для обоих компонентов, выглядит следующим образом:

Непрерывный цикл

Это создает непрерывный цикл:

- На первом этапе диффузионная головка делает предположение «на».

- На втором этапе эти предположения перемещаются в позицию «Черновик».

- Авторегрессионная модель проверяет их (и корректирует при необходимости).

- Одновременно с этим, головка устройства Diffusion переходит к угадыванию следующей фразы («красный коврик»).

Благодаря постоянному прогнозированию и одновременной проверке данных, TiDAR обеспечивает максимальную загрузку графического процессора, гарантируя, что вычислительная мощность никогда не будет потрачена впустую.

Результаты

Исследователи провели ряд тестов технологии TiDAR, чтобы проверить, действительно ли их новый подход эффективен. Давайте посмотрим, к каким выводам они пришли:

1. Скорость: огромный скачок вперед

Наиболее важным показателем для этой архитектуры является способность повысить скорость вывода, и она это делает, причем весьма существенно.

По сравнению со стандартной авторегрессионной (AR) моделью, TiDAR демонстрирует значительное увеличение пропускной способности. Пропускная способность здесь обозначает количество токенов, которые модель может генерировать в секунду.

- Для модели с 1,5 миллиардами параметров TiDAR достиг ускорения в 4,71 раза . Это означает, что данная архитектура может генерировать тот же объем текста почти в 5 раз быстрее, чем стандартная архитектура LLM.

- Для модели с большим количеством параметров (8B) результирующее ускорение оказывается еще более значительным, достигая 5,91x .

Это существенное улучшение по сравнению с традиционной схемой прогнозирования следующего токена, позволяющее отказаться от генерации одного токена и одновременно создавать несколько токенов.

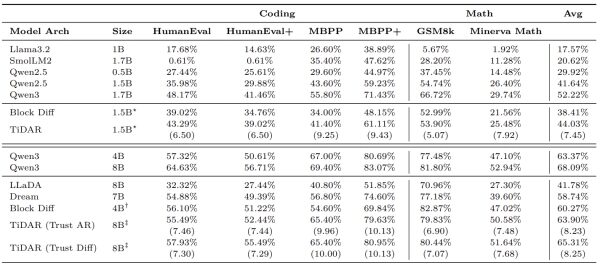

2. Качество: сокращение разрыва

До сих пор модели LLM, основанные исключительно на диффузии, такие как Dream [4] или Llada [5], всегда испытывали трудности в достижении сопоставимых возможностей рассуждения и согласованности с моделями AR.

Однако TiDAR, благодаря своему гибридному подходу, практически идеально устранил этот пробел. Используя авторегрессионную модель для проверки черновых токенов, созданных диффузионной моделью, TiDAR одновременно сочетает в себе точность авторегрессионных моделей и скорость чистых диффузионных моделей.

- На таких тестах, как HumanEval (кодирование) [6] и GSM8K (математика) [7] , TiDAR показал результаты, которые были «без потерь» по сравнению с базовой моделью AR.

- Фактически, по некоторым показателям он даже немного превзошел базовый уровень, вероятно, благодаря «прогнозирующему» характеру процесса составления плана, который помогает модели лучше планировать задачи, требующие логического мышления.

3. Эффективность против спекулятивного декодирования

Авторы также сравнили TiDAR с лучшим на данный момент методом ускорения вывода, называемым EAGLE-3 (алгоритм, основанный на спекулятивном декодировании).

Как обсуждалось ранее, спекулятивное декодирование использует отдельную, меньшую по размеру модель для создания будущих токенов, которые затем может проверить основная модель. Но проблема в том, что меньшая модель допускает множество ошибок, что приводит к отклонению токенов и нерациональному использованию вычислительных ресурсов. TiDAR, однако, использует собственную основную модель для создания и проверки токенов. Это делает созданные токены гораздо более точными и качественными.

- По указанной выше причине «процент одобрения» (частота правильных ответов на черновики) показатель TiDAR был значительно выше.

- Высокий процент принятия означает, что модель тратит меньше времени на исправление своих ошибок и больше времени на генерацию самого текста.

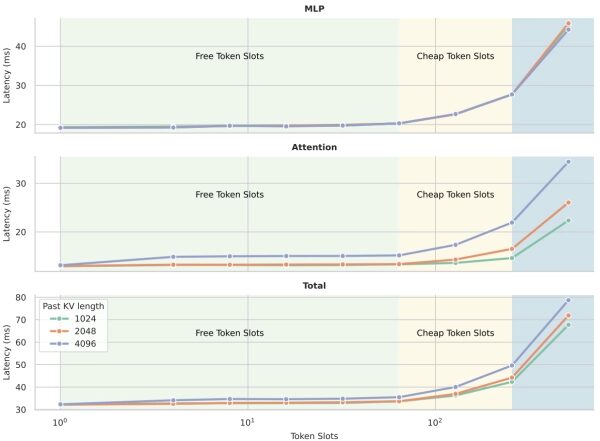

4. Преимущество «бесплатного токена»

В заключение, результаты подтверждают основную гипотезу статьи: действительно ли мы используем графический процессор на пределе его возможностей.

Проведенные авторами эксперименты показывают, что механизм формирования чертежей в TiDAR практически не добавляет задержки по сравнению со стандартным прямым проходом. В стандартном проходе графический процессор ограничен объемом памяти, что означает, что ограничивающими факторами являются этапы загрузки и выгрузки данных, а не сами вычисления.

Однако в TiDAR мы можем дополнительно нагрузить графический процессор, вместо того чтобы оставлять его простаивать. График ниже, по сути, показывает, сколько токенов мы можем создать за один прямой проход, прежде чем вычисления станут узким местом для графического процессора.

Оказывается, мы можем создавать около 60 токенов за один проход, прежде чем вычислительная мощность графического процессора начнет ограничивать наши возможности.

На графике выше по оси X показано количество созданных токенов, а по оси Y — задержка модели. Как видно, зеленая область графика, будучи плоской, указывает на отсутствие увеличения задержки даже при увеличении количества созданных токенов. Задержка начинает расти только примерно при 60 токенах (желтая область), что свидетельствует о том, что фактические вычисления теперь занимают больше времени, чем перемещение данных в память и из памяти.

Это означает, что теоретически мы можем сгенерировать 60 токенов одновременно без дополнительной задержки.

👉Если вам понравилась эта статья, я публикую более короткие и актуальные материалы на Substack.

👉А если вы хотите поддержать написание независимых научных работ, BuyMeACoffee поможет вам в этом.

Ссылки

- Лю, Дж., Дун, С., Е, З. и др. (2025). TiDAR: Думайте в диффузионном режиме, говорите в авторегрессионном режиме. Препринт arXiv.

- Левиафан, Й., Кальман, М., и Матиас, Й. (2023). Быстрый вывод из трансформеров с помощью спекулятивного декодирования. Международная конференция по машинному обучению (ICML).

- Ли, Ю., Вэй, Ф., Чжан, Ч., и Чжан, Х. (2025). Eagle-3: Масштабирование ускорения вывода больших языковых моделей за счет тестирования во время обучения. Препринт arXiv.

- Йе, Дж. и др. (2025). Dream-7B: Распространение больших языковых моделей. Препринт arXiv.

- Ни, С. и др. (2025). Модели распространения больших языков (LLaDA). Препринт arXiv.

- Чен, М. и др. (2021). Оценка больших языковых моделей, обученных на коде (HumanEval). Препринт arXiv.

- Коббе, К. и др. (2021). Обучение верификаторов решению математических текстовых задач (GSM8K). Препринт arXiv.

Источник: towardsdatascience.com