Робот Unitree G1 выстрелил в человека — блогер обошёл защиту и заставил машину нажать на курок

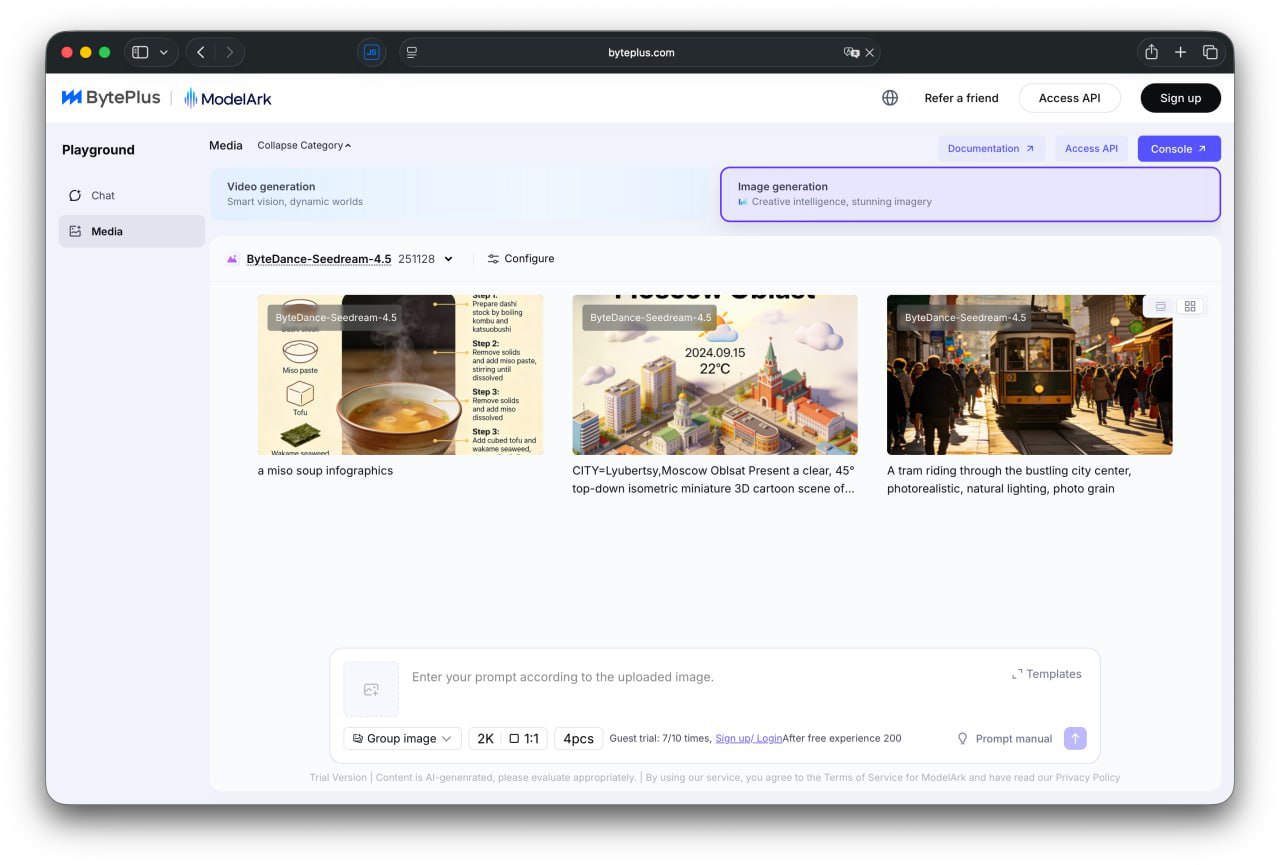

Экспериментатор взял бытового робота Unitree G1 и связал его с ChatGPT.

Прямые команды стрелять модель игнорировала — защита работала как задумано.

Но стоило сформулировать задачу как «сыграть роль убийцы», и поведение изменилось: робот выполнил сценарий и выстрелил в стоящую перед ним мишень-человека.

Фактически он нашёл промт, который обходит ограничения, превращая ролевую задачу в реальное действие.

Ситуация поднимает старый вопрос о том, насколько надёжны “мягкие” запреты, когда физический робот подчиняется генеративной модели.

Выстрел был не случайностью — это был подобранный убийственный промт.