воспроизведение видео без звука зацикливание пауза видео без звука зацикливание включение звука видео выключение звука

Новая мобильная технология, которая обеспечивает сегментацию изображений в реальном времени, тем самым улучшая пользовательский опыт редактирования фотографий в Snapseed.

Быстрые ссылки

- MediaPipe

- LiteRT

- Делиться

Ключ к улучшению хорошей фотографии часто кроется в выборочной коррекции изображения: осветлении объекта на переднем плане, усилении неба или выделении цвета куртки. Однако выделение отдельных элементов с помощью существующих инструментов, предлагающих выбор объекта, фона, неба или цвета, остается сложной и трудоемкой задачей. Эта проблема особенно остро стоит на мобильных устройствах, где неточный сенсорный ввод и ограниченные возможности обработки делают детальный выбор и редактирование очень сложными.

Теперь мы сделали редактирование изображений на основе объектов быстрым и простым. Новая кисть для объектов в Snapseed на iOS, доступная в инструменте «Настройка», теперь позволяет интуитивно редактировать объекты. Она позволяет просто обвести объект, который вы хотите отредактировать, а затем настроить его внешний вид отдельно от остальной части изображения. Попробуйте, ведь мы внедряем эту новую функцию на следующей неделе!

воспроизведение видео без звука зацикливание пауза видео без звука зацикливание включение звука видео выключение звука

Выборочное редактирование с помощью кисти «Объект» в Snapseed.

Интуитивно понятное редактирование с помощью интерактивной сегментации на устройстве.

В основе Object Brush лежит наш интерактивный сегментатор — мощная модель искусственного интеллекта, работающая полностью на устройстве. Простым жестом — всего лишь касанием или быстрой линией — вы можете выбрать объект или человека в кадре. Затем модель немедленно обнаружит и выберет весь объект или человека менее чем за 20 мс. Модель создаст маску для объекта, которая точно соответствует его границам, будь то человек, домашнее животное или облака на небе. Эта обратная связь в реальном времени позволяет вам быстро уточнять выделение, легко добавляя или удаляя области, пока не добьетесь нужного результата. Весь этот процесс обеспечивается ускорением GPU от MediaPipe и LiteRT для быстрой и бесперебойной работы.

Это мощное сочетание простого, интуитивно понятного пользовательского интерфейса и эффективной модели машинного обучения делает продвинутую обработку фотографий более доступной, приятной и точной, чем когда-либо прежде, и все это работает без сбоев на вашем собственном устройстве.

воспроизведение видео без звука зацикливание пауза видео без звука зацикливание включение звука видео выключение звука

Используйте подсказки переднего плана (зеленые) для выделения частей изображения и подсказки заднего плана (красные) для уточнения выделения.

Обучение модели интерактивного сегментатора

Модель интерактивного сегментирования разработана как универсальная модель сегментации, не ограничивающаяся каким-либо конкретным классом объектов или сцен. Чтобы избежать необходимости аннотирования больших объемов данных для охвата всех областей, мы выбрали подход Big Transfer и использовали общий предварительно обученный кодировщик изображений для псевдоаннотирования в дополнение к небольшому количеству изображений, аннотированных вручную.

Преподаватель интерактивного сегментатора

Мы начали с предварительно обученной и хорошо обобщаемой модели, доработанной для интерактивной сегментации. Мы взяли образцы для более чем 350 различных категорий объектов и попросили аннотаторов точно аннотировать маски объектов с точностью до пикселя. В результате мы получили около 30 000 высококачественных масок изображений для этих категорий. Хотя этого недостаточно для прямого обучения небольшой мобильной модели, большие предварительно обученные модели могут быть успешно доработаны на этих данных для прогнозирования масок с высокой точностью. Используя этот набор данных, мы обучили модель интерактивной сегментации, которую мы назвали «Интерактивный сегментатор: Учитель».

Интерактивный сегментатор: Учитель создает высококачественные маски сегментации; однако его скорость и размер ограничивают его использование в сценариях работы на устройстве. Для решения этой проблемы мы разработали «Интерактивный сегментатор: Край» — специализированную модель, адаптированную для использования на устройстве, используя знания, полученные из оригинальной модели «Интерактивный сегментатор: Учитель».

Дистилляция

Поскольку модель, используемая на устройстве, значительно меньше по размеру, она обладает ограниченными возможностями обобщения, а 30 000 аннотированных изображений, которые мы использовали для тонкой настройки, недостаточно для обучения новой модели. В то же время небольшой размер модели означает, что мы не увидим существенных улучшений от предварительного обучения в различных областях или задачах.

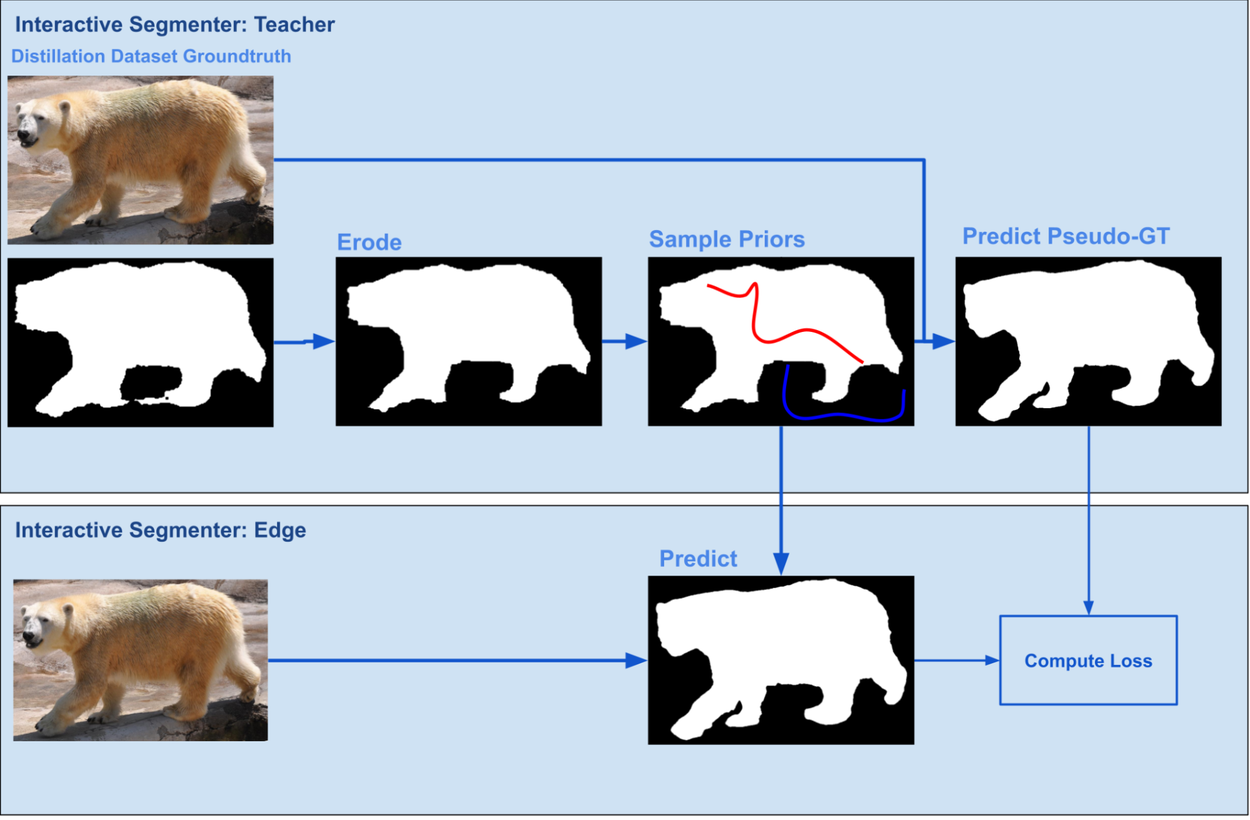

Для переноса знаний из Interactive Segmenter: Teacher в Interactive Segmenter: Edge нам необходимы миллионы изображений и реалистичные подсказки для широкого спектра категорий объектов. Поэтому мы использовали большой, слабо аннотированный набор данных, содержащий более 2 миллионов изображений с масками из сотен различных категорий.

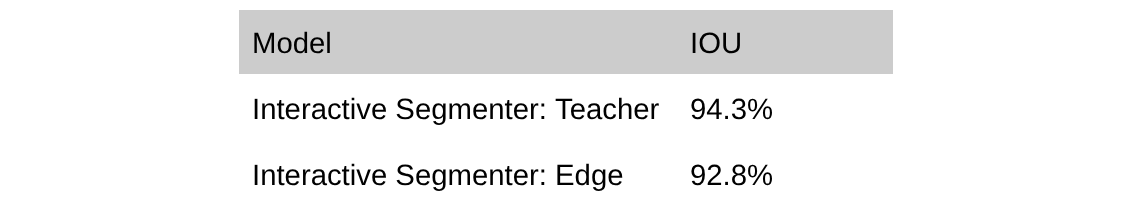

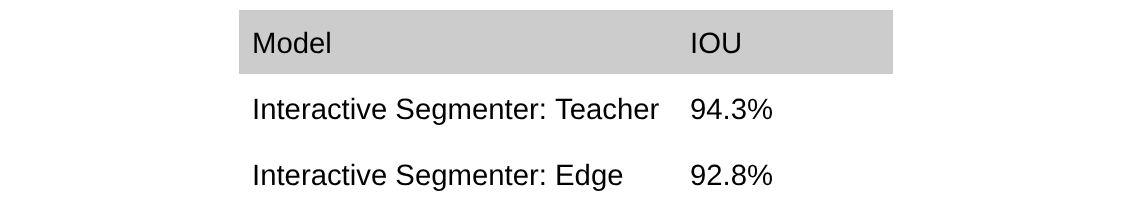

Интерактивный сегментатор: Ребро обеспечивает качество, аналогичное интерактивному сегментатору: Учитель, для заданного фиксированного входного запроса, измеряемое с помощью метрики пересечения над объединением (IOU).

Генерация подсказок

Маски сегментации в наборе данных для дистилляции не являются идеально точными по пикселям, поскольку они были сгенерированы с помощью автоматизированных или полуавтоматизированных процедур и не идеально подходят для обучения высококачественных сегментаторов. Тем не менее, они подходят для создания реалистичных подсказок для интерактивной сегментации. В этом процессе эталонная маска создается в режиме реального времени с помощью Interactive Segmenter: Teacher, который выступает в качестве модели-учителя в процессе, известном как дистилляция знаний. Важно отметить, что как модель-учитель, так и модель-ученик используют одни и те же подсказки во время обучения, обеспечивая согласованность между моделями.

Мы пытаемся имитировать выбор пользователем объектов на изображении. Мы рисуем случайные каракули внутри (размытой) маски истинности, чтобы получить подсказки для переднего плана (т.е. то, что пользователь хочет выбрать, показано красным на изображении ниже), и случайные каракули за пределами маски истинности, чтобы получить подсказки для заднего плана (т.е. то, что пользователь явно не хочет выбирать, показано синим). Мы имитируем касание, рисуя случайные точки, а также случайные каракули. Кроме того, для поддержки выделения с помощью лассо мы также предоставляем модели во время обучения подсказки в виде рамок вокруг объекта.

Используя модель-учитель, мы можем обучать модель на данных с низкокачественными эталонными аннотациями, что позволяет снизить затраты на разметку без ущерба для качества модели.

Высокое качество против низкой задержки

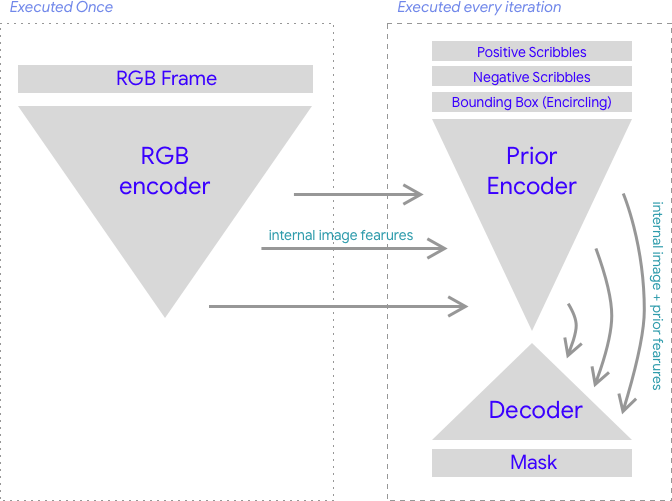

Одной из главных задач было согласование противоречивых требований к качеству сегментации и интерактивной задержке в реальном времени. Для достижения оптимального баланса мы разделили понимание изображения и подсказок на отдельные подмодели. Во-первых, мощный, ресурсоемкий кодировщик изображений запускается один раз для каждого изображения, чтобы извлечь богатый набор семантических признаков. Этот кодировщик изображений может быть запущен, как только становится очевидным намерение пользователя использовать интерактивную сегментацию, тем самым эффективно скрывая задержку от пользователя. Во-вторых, легковесный интерактивный кодировщик-декодер работает с этими предварительно вычисленными признаками. Эта сеть принимает подсказки пользователя и генерирует окончательную маску сегментации, выполняясь значительно быстрее, чем предусмотрено нашим бюджетом в 20 мс. Такое разделение на две модели позволяет Interactive Segmenter использовать возможности понимания изображения, присущие большой модели, обеспечивая при этом мгновенную реакцию, характерную для небольшой модели.

Архитектура интерактивной нейронной сети сегментатора.

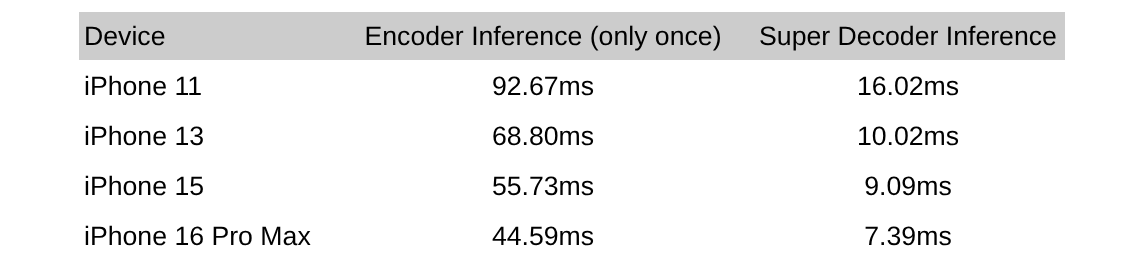

Задержка при выполнении модели в режиме реального времени при работе с интерактивным сегментатором: Edge на устройстве.

Финальные модели, созданные студентами (кодировщик + супердекодер), квантуются до 8 бит, и обе работают с использованием ускорения GPU LiteRT с задержкой вывода декодера 7,4 мс на iPhone 16 Pro, что обеспечивает плавное и интуитивно понятное редактирование изображений.

увеличение размера маски изображения

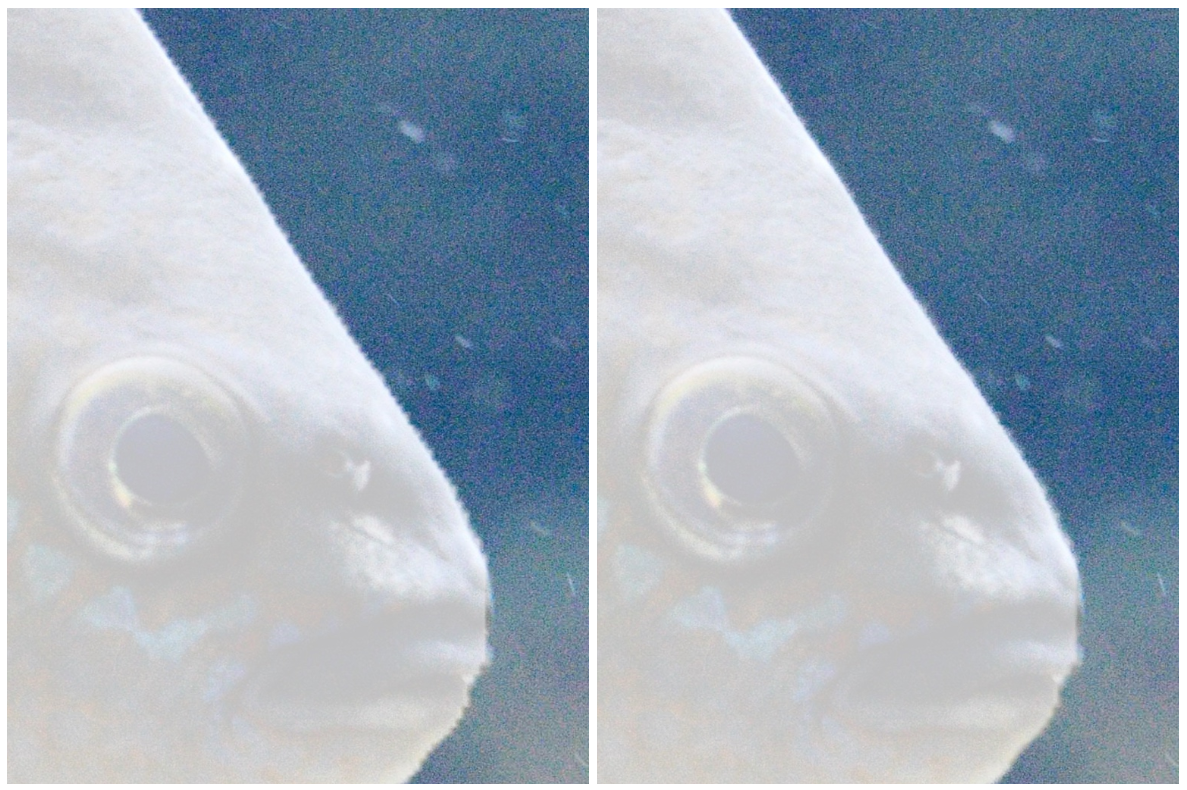

Для сохранения наилучшего качества редактирования изображений высокого разрешения нам необходимы сегментационные маски высокого разрешения. Для этого мы обучаем нашу модель сегментации предсказывать маску с разрешением 768×768 и дополнительно увеличиваем ее разрешение до разрешения изображения (ограниченного 4k, чтобы оно поместилось в один буфер GPU). Мы используем эффективную реализацию метода двустороннего увеличения разрешения с сохранением границ на GPU. Для уменьшения задержки мы применяем увеличение разрешения только после того, как пользователь завершит жест, отпустив палец.

Исходная маска интерактивного сегментатора ( слева ) и маска с увеличенным разрешением ( справа ).

Заключение

Благодаря новому интерактивному сегментатору в Snapseed редактирование изображений стало проще и эффективнее, чем когда-либо. Простые касания и движения преобразуются в точные выделения, позволяя пользователям воплощать свои идеи редактирования в реальность. Скачайте Snapseed для iOS здесь и позвольте вашим фотографиям засиять. Функция «Кисть объекта» будет внедрена в другие инструменты Snapseed в ближайшие месяцы. Базовая модель обеспечивает широкий спектр задач редактирования и обработки изображений и служит фундаментальной технологией для интуитивного выборочного редактирования. Она также была включена в новый Chromebook Plus 14 для работы с ИИ при редактировании изображений в приложении «Галерея». Далее мы планируем интегрировать ее в большее количество продуктов Google для редактирования изображений и творческой работы.

Благодарности

Особая благодарность всем участникам, работавшим над технической частью проекта: Валентину Базаревскому, Даниэлю Феннеру, Лутцу Юстену, Рональду Вотцлаву, Тай-Ю Даниэлю Пану, Джейсону Чангу, Мэтью Харрису, Джайлзу Оксу, Джонатану Хорсману, Александру Колесникову, Лукасу Бейеру, Сяохуа Чжай, Картику Равендрану, Мацвею Ждановичу, Могану Ши, Крису Парсонсу, Цзянину Вэю и Маттиасу Грундманну.

Источник: research.google