Быстрые и эффективные модели, оптимизированные для программирования и работы с субагентами.

Сегодня мы выпускаем GPT-5.4 mini и nano — наши самые функциональные компактные модели на сегодняшний день. Они сочетают в себе многие преимущества GPT-5.4 и более быстрые и эффективные модели, разработанные для обработки больших объемов данных.

GPT-5.4 mini значительно превосходит GPT-5 mini по таким параметрам, как программирование, логическое мышление, многомодальное понимание и использование инструментов, при этом работая более чем в 2 раза быстрее. Он также приближается к производительности более крупной модели GPT-5.4 в нескольких тестах, включая SWE-Bench Pro и OSWorld-Verified.

GPT-5.4 nano — это самая компактная и дешевая версия GPT-5.4 для задач, где скорость и стоимость имеют первостепенное значение. Это также значительное улучшение по сравнению с GPT-5 nano. Мы рекомендуем её для классификации, извлечения данных, ранжирования и кодирования субагентов, выполняющих более простые вспомогательные задачи.

Эти модели созданы для тех типов рабочих нагрузок, где задержка напрямую влияет на пользовательский опыт: помощники по программированию, которым необходимо быстро реагировать, субагенты, быстро выполняющие вспомогательные задачи, компьютерные системы, которые захватывают и интерпретируют скриншоты, и мультимодальные приложения, способные анализировать изображения в режиме реального времени. В таких условиях наилучшей моделью часто является не самая большая, а та, которая может быстро реагировать, надежно использовать инструменты и при этом хорошо справляться со сложными профессиональными задачами.

| GPT-5.4 (очень высокий) | GPT-5.4 mini (xhigh) | GPT-5.4 nano (xhigh) | GPT-5 мини (высокий¹) | |

|---|---|---|---|---|

| SWE-Bench Pro (публичная версия) | 57,7% | 54,4% | 52,4% | 45,7% |

| Терминальный стенд 2.0 | 75,1% | 60,0% | 46,3% | 38,2% |

| Туатлон | 54,6% | 42,9% | 35,5% | 26,9% |

| GPQA Diamond | 93,0% | 88,0% | 82,8% | 81,6% |

| Проверено OSWorld | 75,0% | 72,1% | 39,0% | 42,0% |

1. Максимально возможное усилие, затрачиваемое на рассуждения в GPT-5 mini, составляет 'high'.

Вот что думают наши клиенты после тестирования GPT-5.4 mini и nano в своих рабочих процессах:

«GPT-5.4 mini демонстрирует высокую производительность на всех этапах для модели этого класса. В наших оценках она сравнялась или превзошла конкурирующие модели по нескольким задачам вывода и точности определения источников при значительно меньших затратах. Она также достигла более высоких показателей успешного выполнения сквозных задач и более точной идентификации источников, чем более крупная модель GPT-5.4».

— Аабхас Шарма, технический директор Hebbia

Программирование

Модели GPT-5.4 mini и nano особенно эффективны в процессах кодирования, требующих быстрой итерации. Они с низкой задержкой обрабатывают целевые правки, навигацию по кодовой базе, генерацию фронтенда и циклы отладки, что делает их идеальным выбором для задач кодирования, требующих более быстрого и экономичного выполнения.

В тестах производительности GPT-5.4 mini стабильно превосходит GPT-5-mini при аналогичных задержках и приближается к показателям прохождения тестов на уровне GPT-5.4, работая при этом значительно быстрее, обеспечивая один из самых выгодных компромиссов между производительностью и задержкой для рабочих процессов программирования.

Мы оцениваем задержку, анализируя поведение наших моделей в производственной среде и моделируя это в автономном режиме. Оценка задержки учитывает длительность вызова инструмента (время выполнения кода), количество выбранных токенов и количество входных токенов. Реальная задержка может существенно отличаться и зависит от многих факторов, не учтенных в нашем моделировании. Аналогично, стоимость оценивается на основе цен на API этих моделей на момент написания. Стоимость может измениться в будущем. Рассуждения были сдвинуты от низкого к очень высокому уровню.

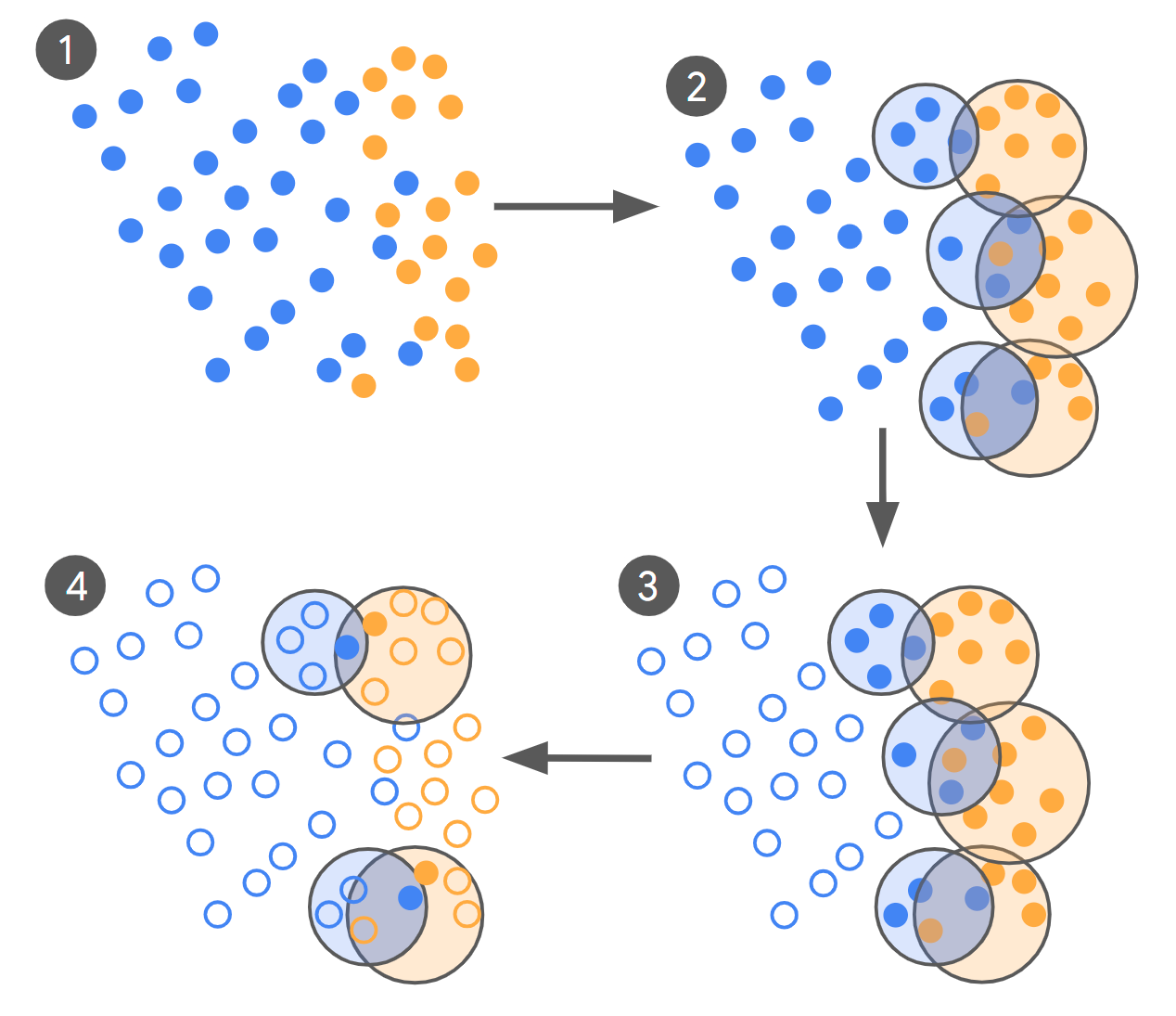

Субагенты

GPT-5.4 mini также отлично подходит для систем, объединяющих модели разных размеров. Например, в Codex более крупная модель, такая как GPT-5.4, может обрабатывать планирование, координацию и вынесение окончательного решения, делегируя субагентам GPT-5.4 mini выполнение более узких подзадач параллельно — таких как поиск в кодовой базе, анализ большого файла или обработка вспомогательных документов. Подробнее о работе субагентов в Codex можно узнать в документации (откроется в новом окне) .

Этот подход становится всё более полезным по мере того, как меньшие модели становятся быстрее и функциональнее. Вместо использования одной модели для всего, разработчики могут создавать системы, в которых большие модели определяют, что делать, а меньшие модели быстро выполняют задачи в масштабе. GPT-5.4 mini — наша самая мощная мини-модель для такого стиля работы.

Использование компьютера

GPT-5.4 mini также демонстрирует высокие результаты в многомодальных задачах, особенно связанных с использованием компьютера. Модель может быстро интерпретировать скриншоты сложных пользовательских интерфейсов для оперативного выполнения задач, связанных с работой за компьютером. По данным OSWorld-Verified, GPT-5.4 mini приближается к GPT-5.4, при этом значительно превосходя GPT-5 mini.

Наличие и цены

GPT-5.4 mini доступен уже сегодня в API, Codex и ChatGPT.

В API GPT-5.4 mini поддерживаются ввод текста и изображений, использование инструментов, вызов функций, веб-поиск, поиск файлов, использование компьютера и навыки. Он имеет контекстное окно на 400 000 символов и стоит 0,75 доллара за 1 миллион входных токенов и 4,50 доллара за 1 миллион выходных токенов.

В Codex GPT-5.4 mini доступен во всех приложениях Codex, CLI, расширениях IDE и веб-интерфейсе. Он использует всего 30% квоты GPT-5.4, позволяя разработчикам быстро справляться с более простыми задачами кодирования в Codex примерно за треть стоимости. Codex также может делегировать задачи субагентам GPT-5.4 mini, чтобы менее ресурсоемкие задачи выполнялись на более дешевой модели.

В ChatGPT GPT-5.4 mini доступен пользователям Free и Go через функцию «Thinking» в меню «+». Для всех остальных пользователей GPT-5.4 mini доступен в качестве резервного варианта для ограничения скорости запросов к GPT-5.4 Thinking.

GPT-5.4 nano доступен только через API и стоит 0,20 доллара США за 1 миллион входных токенов и 1,25 доллара США за 1 миллион выходных токенов.

Для получения более подробной информации о мерах безопасности моделей, пожалуйста, ознакомьтесь с дополнением к системной карте на нашем портале безопасности развертывания (откроется в новом окне) .

Программирование

| GPT-5.4 (очень высокий) | GPT-5.4 mini (xhigh) | GPT-5.4 nano (xhigh) | GPT-5 mini (high¹) | |

|---|---|---|---|---|

| SWE-bench Pro (публичная версия) | 57,7% | 54,4% | 52,4% | 45,7% |

| Терминальный стенд 2.0 | 75,1% | 60,0% | 46,3% | 38,2% |

Вызов инструментов

| GPT-5.4 (очень высокий) | GPT-5.4 mini (xhigh) | GPT-5.4 nano (xhigh) | GPT-5 мини (высокий¹) | |

|---|---|---|---|---|

| Атлас MCP | 67,2% | 57,7% | 56,1% | 47,6% |

| Туатлон | 54,6% | 42,9% | 35,5% | 26,9% |

| τ2-стенд (телекоммуникации) | 98,9% | 93,4% | 92,5% | 74,1% |

Интеллект

| GPT-5.4 (очень высокий) | GPT-5.4 mini (xhigh) | GPT-5.4 nano (xhigh) | GPT-5 mini (high¹) | |

|---|---|---|---|---|

| GPQA Diamond | 93,0% | 88,0% | 82,8% | 81,6% |

| HLE с инструментом | 52,1% | 41,5% | 37,7% | 31,6% |

| HLE без инструментов | 39,8% | 28,2% | 24,3% | 18,3% |

MM / Vision / CUA

| GPT-5.4 (очень высокий) | GPT-5.4 mini (xhigh) | GPT-5.4 nano (xhigh) | GPT-5 mini (high¹) | |

|---|---|---|---|---|

| Проверено OSWorld | 75,0% | 72,1% | 39,0% | 42,0% |

| MMMUPro с Python | 81,5% | 78,0% | 69,5% | 74,1% |

| MMMUPro | 81,2% | 76,6% | 66,1% | 67,5% |

| OmniDocBench 1.5 (без инструментов)² — чем меньше, тем лучше. | 0.109 | 0.1263 | 0.2419 | 0.1791 |

Длинный контекст

| GPT-5.4 (очень высокий) | GPT-5.4 mini (xhigh) | GPT-5.4 nano (xhigh) | GPT-5 мини (высокий¹) | |

|---|---|---|---|---|

| OpenAI MRCR v2 8-игольный 64K–128K | 86,0% | 47,7% | 44,2% | 35,1% |

| OpenAI MRCR v2 8-игольный 128K–256K | 79,3% | 33,6% | 33,1% | 19,4% |

| Graphwalks BFS 0K–128K | 93,1% | 76,3% | 73,4% | 73,4% |

| Graphwalks parents 0–128K (точность) | 89,8% | 71,5% | 50,8% | 64,3% |

1. Максимально возможное усилие, затрачиваемое на рассуждения в GPT-5 mini, составляет 'high'.

2. Общее расстояние редактирования. OmniDocBench был запущен с параметром reasoning_effort, установленным на 'none', чтобы отразить производительность с низкими затратами и низкой задержкой.

Источник: openai.com