По словам представителя Министерства обороны, знакомого с ситуацией, американские военные могут использовать системы генеративного искусственного интеллекта для ранжирования списков целей и выработки рекомендаций — которые будут проверены людьми — о том, какую цель следует атаковать первой. Информация о возможном использовании чат-ботов на основе ИИ появилась на фоне пристального внимания к Пентагону в связи с ударом по иранской школе, расследование которого еще продолжается.

Список возможных целей может быть загружен в систему генеративного искусственного интеллекта, которую Пентагон использует для работы в секретных условиях. Затем, как заявил чиновник, пожелавший остаться анонимным для MIT Technology Review, чтобы обсудить деликатные темы, люди могут попросить систему проанализировать информацию и расставить приоритеты целей, учитывая такие факторы, как текущее местоположение самолетов. После этого люди будут отвечать за проверку и оценку результатов и рекомендаций. Теоретически, для подобных сценариев в будущем могут использоваться модели ChatGPT от OpenAI и Grok от xAI, поскольку обе компании недавно достигли соглашения об использовании своих моделей Пентагоном в секретных условиях.

Официальный представитель охарактеризовал это как пример того, как всё может работать, но не подтвердил и не опроверг, отражает ли это то, как системы искусственного интеллекта используются в настоящее время.

Другие СМИ сообщали, что система Claude от Anthropic была интегрирована в существующие военные системы искусственного интеллекта и использовалась в операциях в Иране и Венесуэле, но комментарии официального лица проливают свет на конкретную роль, которую могут играть чат-боты, особенно в ускорении поиска целей. Они также проливают свет на то, как военные используют две разные технологии искусственного интеллекта, каждая из которых имеет свои ограничения.

По меньшей мере с 2017 года американские военные работают над инициативой по обработке «больших данных» под названием Maven. Она использует более старые типы искусственного интеллекта, в частности компьютерное зрение, для анализа огромных массивов данных и изображений, собранных Пентагоном. Maven может, например, обрабатывать тысячи часов видеоматериалов, снятых беспилотниками, и алгоритмически идентифицировать цели. В отчете Джорджтаунского университета за 2024 год показано, как солдаты используют систему для выбора и проверки целей, что ускоряет процесс получения разрешения на их использование. Солдаты взаимодействуют с Maven через интерфейс с картой поля боя и панелью управления, которая может выделять потенциальные цели одним цветом, а дружественные силы — другим.

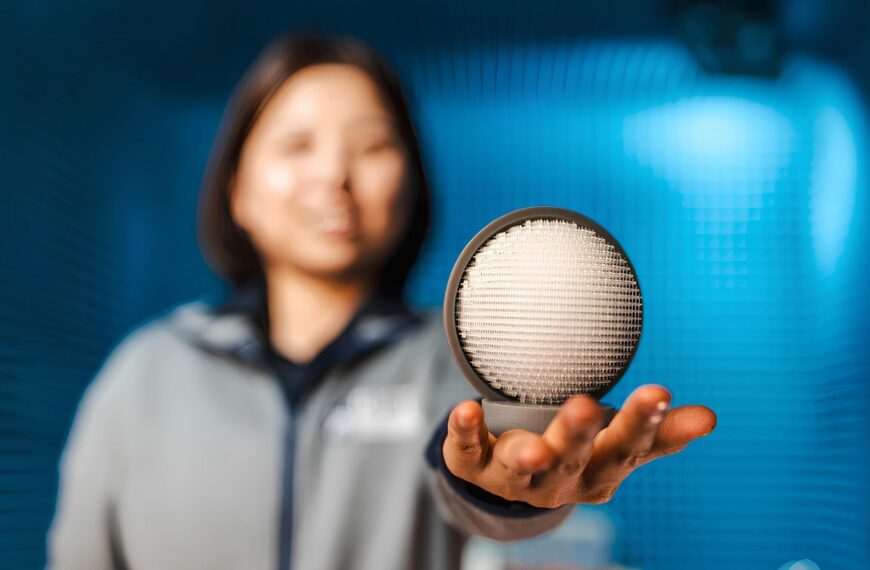

Комментарии чиновника позволяют предположить, что генеративный ИИ теперь добавляется в качестве уровня для чат-ботов, предназначенных для общения, — уровня, который военные могут использовать для более быстрого поиска и анализа данных при принятии решений, например, о том, каким целям отдавать приоритет.

Системы генеративного ИИ, подобные тем, что лежат в основе ChatGPT, Claude и Grok, представляют собой принципиально иную технологию по сравнению с ИИ, который в основном лежит в основе Maven. Построенные на основе больших языковых моделей, они гораздо менее проверены в реальных условиях. И если интерфейс Maven заставлял пользователей напрямую изучать и интерпретировать данные на карте, то результаты, полученные с помощью моделей генеративного ИИ, проще в доступе, но сложнее в проверке.

Использование генеративного ИИ для принятия таких решений сокращает время, необходимое для целеуказания, добавил чиновник, не уточнив, насколько можно увеличить скорость, если людям приходится тратить время на перепроверку результатов модели.

Использование военных систем искусственного интеллекта находится под пристальным вниманием общественности после недавнего удара по школе для девочек в Иране, в результате которого погибло более 100 детей. Многие новостные агентства сообщили, что удар был нанесен американской ракетой, хотя Пентагон заявил, что расследование еще продолжается. И хотя Washington Post сообщила, что Claude и Maven участвовали в принятии решений о целях в Иране, пока нет никаких доказательств, объясняющих, какую роль, если таковая имелась, сыграли генеративные системы искусственного интеллекта. В среду New York Times сообщила, что предварительное расследование выявило, что устаревшие данные о целях частично ответственны за удар.

Связанная статья

В последние месяцы Пентагон активно наращивает использование ИИ в различных операциях. Еще в декабре он начал предлагать миллионам военнослужащих несекретное использование генеративных моделей ИИ для таких задач, как анализ контрактов или написание презентаций, в рамках проекта GenAI.mil. Однако лишь немногие генеративные модели ИИ были одобрены Пентагоном для секретного использования.

Первым был Claude компании Anthropic, который, помимо использования в Иране, по сообщениям, применялся в операциях по захвату венесуэльского лидера Николаса Мадуро в январе. Однако после недавних разногласий между Пентагоном и Anthropic по поводу того, может ли Anthropic ограничивать использование своего ИИ военными, Министерство обороны признало компанию угрозой для цепочки поставок, а президент Трамп потребовал в социальных сетях, чтобы правительство прекратило использование ее продуктов ИИ в течение шести месяцев. Anthropic оспаривает это решение в суде.

28 февраля компания OpenAI объявила о соглашении с военными об использовании своих технологий в секретных условиях. Компания Илона Маска xAI также заключила соглашение с Пентагоном об использовании своей модели Grok в подобных условиях. OpenAI заявила, что соглашение с Пентагоном сопровождалось ограничениями, хотя практическая эффективность этих ограничений неясна.

Если у вас есть информация об использовании ИИ военными, вы можете безопасно поделиться ею через Signal (имя пользователя jamesodonnell.22).

Источник: www.technologyreview.com