Повторяй запрос — получишь лучший ответ: Google нашла неожиданный трюк для LLM

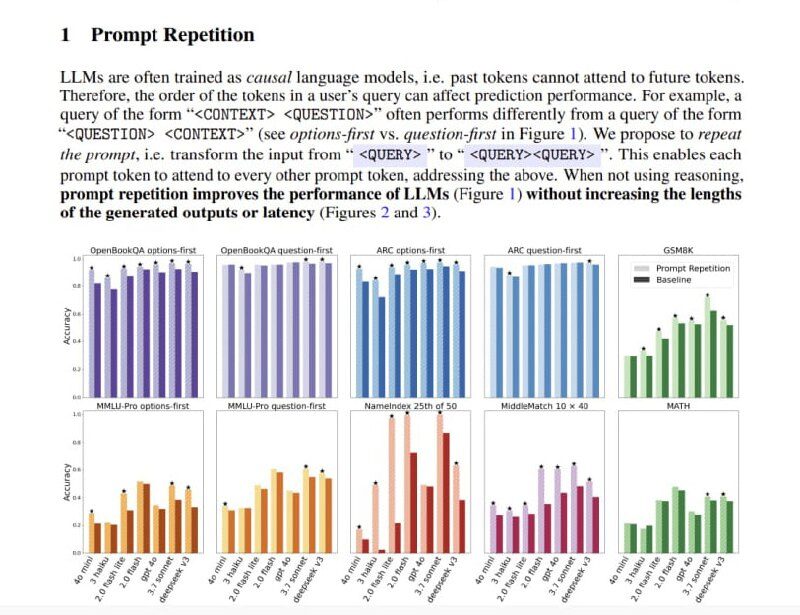

Исследователи Google обнаружили простой, но нетривиальный приём: повторение одного и того же запроса улучшает ответы нерассуждающих LLM. В ряде тестов прирост качества доходил почти до 10% Google arXiv.

Как это выглядит на практике:

— вместо <Запрос> отправлять <Запрос><Запрос>

— ещё лучше — повторить запрос три раза

— либо добавить формулировку вроде: «Давай я повторю: …»

Почему это работает:

— дело в механизме внимания трансформера

— при втором чтении модель уже знает контекст

— токены второй части начинают взаимодействовать с токенами первой

— в итоге задача «собирается» точнее

Важное ограничение:

— приём не помогает рассуждающим моделям

— они и так повторяют и переформулируют запросы внутри цепочки рассуждений

Итог простой и немного ироничный:

для «быстрых» моделей иногда достаточно сказать то же самое ещё раз, чтобы получить более качественный ответ — без новых инструкций и сложных промтов.