Как развивалось оперативное проектирование, как это было изучено с научной точки зрения; и какие последствия это имеет для будущего инструментов разговорного искусственного интеллекта.

Делиться

Уже некоторое время в области ИИ циркулирует мнение, что разработка подсказок мертва или, по крайней мере, устарела. С одной стороны, это связано с тем, что чистые языковые модели стали более гибкими и надежными, лучше переносящими неоднозначность, а с другой — с тем, что модели рассуждений могут обходить некорректные подсказки и, следовательно, лучше понимать пользователя. Какова бы ни была точная причина, эра «волшебных фраз», работавших как заклинания, и гиперспецифичных фразовых уловок, похоже, подходит к концу. В этом узком смысле разработка подсказок как набор трюков (который был научно проанализирован в таких статьях, как эта от DeepMind, представившей превосходные затравки для языковых моделей еще тогда, когда GPT-4 стал доступен) действительно умирает.

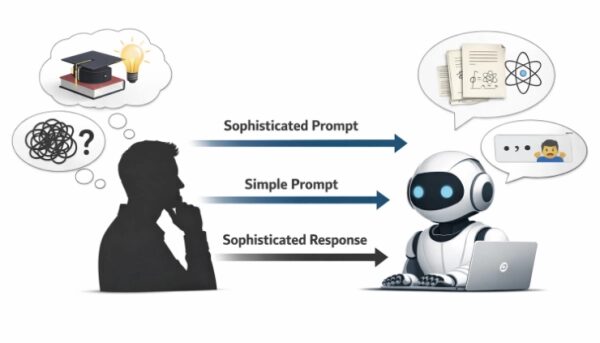

Но теперь компания Anthropic придала цифрам более тонкий и важный смысл. Они обнаружили, что, хотя точная формулировка вопроса имеет меньшее значение, чем раньше, «сложность» этого вопроса имеет огромное значение. Фактически, она почти идеально коррелирует со сложностью ответа модели.

Это не метафора и не мотивационный «слоган», а эмпирический результат, полученный на основе данных, собранных компанией Anthropic среди своих пользователей. Читайте дальше, чтобы узнать больше, потому что всё это невероятно интересно, и это выходит за рамки простого понимания того, как мы будем использовать системы искусственного интеллекта на основе LLM.

Антропогенный экономический индекс: отчет за январь 2026 года.

В отчете «Антропический экономический индекс: январь 2026 года» ведущие авторы Рут Аппель, Максим Массенкофф и Питер МакКрори анализируют, как люди фактически используют Клода в разных регионах и контекстах. Начнем с, пожалуй, самого поразительного вывода: они обнаружили сильную количественную взаимосвязь между уровнем образования, необходимым для понимания запроса пользователя, и уровнем образования, необходимым для понимания ответа Клода. В разных странах коэффициент корреляции составляет r = 0,925 (p < 0,001, N = 117). В разных штатах США он составляет r = 0,928 (p < 0,001, N = 50).

Это означает, что чем лучше ваши знания и чем яснее вы можете вводить подсказки, тем лучше будут ответы. Проще говоря, то, как люди вводят подсказки, определяет, как Клод на них реагирует.

И знаете что? Я сам убедился в этом на качественном уровне, сравнивая то, как я и другие мои коллеги с докторской степенью взаимодействуют с системами искусственного интеллекта, с тем, как это делают пользователи без достаточных инструкций.

От «методов быстрого реагирования» до «когнитивной поддержки»

Первые обсуждения методов оперативного проектирования были сосредоточены на поверхностных приемах: добавлении фразы «давайте подумаем шаг за шагом», указании роли («действовать как старший специалист по анализу данных») или тщательном упорядочивании инструкций (больше примеров можно найти в статье DeepMind, ссылку на которую я привел во вводной части). Эти методы были полезны, когда модели были нестабильными и легко давали сбой — что, кстати, в свою очередь использовалось для переопределения их правил безопасности, чего сейчас добиться гораздо сложнее.

Но по мере совершенствования моделей многие из этих приемов стали необязательными. Та же самая модель часто могла прийти к приемлемому результату даже без них.

Результаты исследования Anthropic проясняют, почему это в конечном итоге привело к мнению о том, что разработка подсказок устарела. Оказывается, «механические» аспекты подсказок — синтаксис, «волшебные слова», ритуалы форматирования — действительно имеют меньшее значение. Не исчезла важность того, что они называют «когнитивной поддержкой»: насколько хорошо пользователь понимает проблему, насколько точно он её формулирует и знает ли он, как выглядит хороший ответ — другими словами, критическое мышление, позволяющее отличить хорошие ответы от бесполезных иллюзий.

В исследовании эта идея операционализируется с использованием образования в качестве количественного показателя уровня подготовки. Исследователи оценили количество лет образования, необходимых для понимания как запросов, так и ответов, обнаружив почти прямую корреляцию! Это говорит о том, что Клод не «повышает» или «понижает» интеллектуальный уровень взаимодействия независимо друг от друга. Вместо этого он удивительно точно отражает ввод пользователя. Это, безусловно, хорошо, когда вы знаете, о чем спрашиваете, но приводит к снижению эффективности системы ИИ, когда вы сами мало что знаете об этом или когда, например, вводите запрос или вопрос слишком быстро и невнимательно.

Если пользователь задаёт поверхностный, недостаточно определённый вопрос, Клод, как правило, отвечает на таком же поверхностном уровне. Если же вопрос содержит глубокие знания предметной области, хорошо продуманные ограничения и неявные стандарты строгости, Клод отвечает тем же. И да, я определённо наблюдал это на моделях ChatGPT и Gemini, которые я использую чаще всего.

Почему это нетривиально

На первый взгляд, это может показаться очевидным. Конечно, на лучшие вопросы даются лучшие ответы. Но именно величина корреляции делает результат научно интересным. Корреляции выше 0,9 редко встречаются в социальных и поведенческих данных, особенно в разнородных единицах, таких как страны или штаты США. Таким образом, в результате исследования была обнаружена не слабая тенденция, а довольно структурная взаимосвязь.

Важно отметить, что полученные результаты противоречат распространенному мнению о том, что ИИ может выступать в роли уравнивающего фактора, позволяя всем получать информацию примерно одинакового уровня независимо от языка, уровня образования и знакомства с темой. Широко распространено мнение, что продвинутые модели «поднимут» уровень пользователей с низким уровнем квалификации, автоматически предоставляя результаты экспертного уровня независимо от качества входных данных. Результаты, полученные Anthropic, показывают, что это совсем не так, и реальность гораздо более условна. Хотя Claude (и это, вероятно, относится ко всем моделям разговорного ИИ) потенциально может выдавать очень сложные ответы, он делает это только тогда, когда пользователь дает соответствующий запрос.

Поведение модели не является фиксированным; оно разрабатывается.

Хотя, на мой взгляд, эта часть отчета не подкреплена данными, и, исходя из моего личного опыта, я склонен не согласиться, она предполагает, что этот «зеркальный» эффект не является неотъемлемым свойством всех языковых моделей, и что реакция модели в значительной степени зависит от того, как она обучается, дорабатывается и инструктируется. Хотя, как я уже сказал, я не согласен, я понимаю, что можно представить себе систему, которая заставляет модель всегда использовать упрощенный язык, независимо от ввода пользователя, или, наоборот, систему, которая всегда отвечает высокотехническим языком. Но это нужно будет разработать.

Модель Клода, похоже, занимает более динамичную промежуточную позицию. Вместо того чтобы навязывать фиксированный уровень сложности, она адаптирует свой уровень под запрос пользователя. Такое дизайнерское решение подчеркивает важность навыков пользователя. Модель способна к рассуждениям экспертного уровня, но рассматривает запрос как сигнал о том, в какой степени следует задействовать эти навыки.

Было бы здорово увидеть, как другие крупные игроки, такие как OpenAI и Google, проводят аналогичные тесты и анализы данных об использовании своих сервисов.

Искусственный интеллект как множитель, поддающийся количественной оценке.

«Клише» о том, что «ИИ — это уравнитель», часто повторяется без каких-либо доказательств, и, как я уже говорил выше, анализ Anthropic предоставляет именно это… но в негативном ключе.

Если уровень сложности выходных данных масштабируется пропорционально уровню сложности входных данных, то модель не заменяет человеческий опыт (и не уравнивает его); однако она его многократно увеличивает. И это положительно сказывается на пользователях, применяющих систему ИИ в своих областях знаний.

Слабая база, умноженная на мощный инструмент, остается слабой, и в лучшем случае вы можете использовать консультации с системой ИИ, чтобы начать работу в какой-либо области, при условии, что вы знаете достаточно, чтобы хотя бы отличать иллюзии от фактов. Сильная база, напротив, дает огромные преимущества, потому что тогда вы начинаете с большим количеством информации и получаете еще больше; например, я очень часто провожу мозговой штурм с помощью ChatGPT или, что еще лучше, с помощью Gemini 3 в AI Studio, обсуждая уравнения, описывающие физические явления, чтобы в конечном итоге получить от системы фрагменты кода или даже целые приложения, скажем, для подгонки данных к очень сложным математическим моделям. Да, я мог бы сделать это сам, но, тщательно формулируя свои запросы к системе ИИ, она могла бы выполнить работу буквально на порядки быстрее, чем я бы это сделал.

Вся эта аргументация может помочь примирить два, казалось бы, противоречивых представления об ИИ. С одной стороны, модели, несомненно, впечатляют и могут превзойти людей во многих узкоспециализированных задачах. С другой стороны, они часто разочаровывают при наивном использовании. Разница заключается не столько в формулировке задания, сколько в понимании пользователем предметной области, структуры проблемы и критериев успеха.

Последствия для образования и работы

Один из выводов заключается в том, что инвестиции в человеческий капитал по-прежнему имеют большое значение. По мере того, как модели становятся все более точным отражением уровня подготовки пользователей, различия в уровне экспертных знаний могут стать более заметными, а не менее очевидными, как предполагает концепция «выравнивания». Те, кто может формулировать точные, обоснованные запросы, получат гораздо больше пользы от той же базовой модели, чем те, кто этого сделать не может.

Это также меняет представление о том, что должно означать «оперативное проектирование» в будущем. Речь идёт не столько об освоении новых технических навыков, сколько о развитии традиционных: знаний в предметной области, критического мышления, декомпозиции проблемы. Умение задавать правильные вопросы и распознавать хорошие ответы оказывается настоящим связующим звеном. Всё это, вероятно, очевидно для нас, читателей Towards Data Science, но мы здесь, чтобы учиться, и количественные данные, полученные Anthropic, делают всё это гораздо более убедительным.

В заключение отметим, что данные Anthropic излагают свои тезисы с необычайной ясностью. И снова, нам следует призвать всех крупных игроков, таких как OpenAI, Google, Meta и т. д., провести аналогичный анализ своих данных об использовании и потребовать, чтобы они представили результаты общественности, как это сделала Anthropic.

И точно так же, как мы долго боролись за свободный и повсеместный доступ к системам разговорного искусственного интеллекта, четкие правила для пресечения дезинформации и преднамеренного неправомерного использования, способы, в идеале, устранения или хотя бы выявления галлюцинаций, и многое другое, теперь мы можем добавить к этому призывы к достижению подлинного равенства.

Ссылки и материалы по теме

Чтобы узнать все подробности об отчете Anthropic (в котором затрагиваются и многие другие интересные моменты, а также приводятся все сведения об анализируемых данных): https://www.anthropic.com/research/anthropic-economic-index-january-2026-report

Также вам может быть интересен отчет Microsoft «Новое будущее работы 2025», с которым исследование Anthropic проводит некоторые сравнения, доступный здесь: https://www.microsoft.com/en-us/research/project/the-new-future-of-work/

Моя предыдущая статья «Две новые работы DeepMind демонстрируют, как искусственный интеллект может помочь человеческому интеллекту»: https://pub.towardsai.net/two-new-papers-by-deepmind-exemplify-how-artificial-intelligence-can-help-human-intelligence-ae5143f07d49

Моя предыдущая статья «Новая разработка DeepMind раскрывает возможности использования идеальных подсказок для языковых моделей»: https://medium.com/data-science/new-deepmind-work-unveils-supreme-prompt-seeds-for-language-models-e95fb7f4903c

Источник: towardsdatascience.com