Для чего оптимизированы (и для чего не оптимизированы) программы LLM, и как отрасль подходит к ИИ вместо структурированных наборов бизнес-данных, включая один подход, разработанный моей командой и мной.

Делиться

Руководители по всему миру спешат использовать программы магистратуры права (LLM), но зачастую для задач, для которых они не подходят. Более того, согласно недавнему исследованию Массачусетского технологического института, 95% пилотов GenAI терпят неудачу — они не получают никакой отдачи.

Область, которая осталась без внимания в буре вокруг GenAI, — это структурированные данные, причем не только с точки зрения внедрения, но и с технологической точки зрения. На самом деле, структурированные данные таят в себе кладезь потенциальной ценности, особенно в виде прогнозов.

В этой статье я расскажу о том, что могут и чего не могут делать LLM, какую ценность вы можете получить от ИИ, работающего со структурированными данными, в частности для прогностического моделирования, а также о подходах, используемых сегодня в отрасли, включая тот, который я разработал вместе со своей командой.

Почему программы LLM не оптимизированы для бизнес-данных и рабочих процессов

Хотя крупные языковые модели полностью преобразили текст и коммуникацию, они не способны делать прогнозы на основе структурированных реляционных данных, которые играют решающую роль, обеспечивая реальные бизнес-результаты — управление жизненным циклом клиентов, оптимизацию продаж, рекламу и маркетинг, рекомендации, обнаружение мошенничества и оптимизацию цепочки поставок.

Бизнес-данные, на которых базируются предприятия, по своей природе структурированы. Они часто хранятся в таблицах, базах данных и рабочих процессах, где смысл определяется отношениями между сущностями, такими как клиенты, транзакции и цепочки поставок. Другими словами, всё это реляционные данные.

LLM покорили мир и сыграли ключевую роль в развитии ИИ. При этом они были разработаны для работы с неструктурированными данными и по своей природе не подходят для анализа строк, столбцов или соединений. В результате им трудно охватить всю глубину и сложность реляционных данных. Другая проблема заключается в том, что реляционные данные изменяются в режиме реального времени, в то время как LLM обычно обучаются на статических снимках текста. Они также рассматривают числа и количества как токены в последовательности, а не «понимают» их математически. На практике это означает, что LLM оптимизирован для предсказания следующего наиболее вероятного токена, что он делает невероятно хорошо, но не для проверки правильности вычисления. Таким образом, независимо от того, выводит ли модель 3 или 200, когда истинный ответ — 2, штраф, который получает модель, одинаков.

Магистратура LLM способна к многоэтапным рассуждениям, используя цепочку рассуждений, но в некоторых случаях может столкнуться с проблемами надёжности. Поскольку они способны галлюцинировать, и делают это, стоит добавить, уверенно, даже небольшая вероятность ошибки в многоэтапном рабочем процессе может накапливаться на разных этапах. Это снижает общую вероятность правильного результата, а в таких бизнес-процессах, как одобрение кредита или прогнозирование дефицита поставок, даже одна небольшая ошибка может иметь катастрофические последствия.

Из-за всего этого предприятия сегодня полагаются на традиционные конвейеры машинного обучения, создание и поддержка которых занимают месяцы, что ограничивает измеримое влияние ИИ на доход. Применяя ИИ к таким табличным данным, вы фактически переноситесь на тридцать лет назад и нуждаетесь в людях для кропотливого проектирования функций и создания индивидуальных моделей с нуля. Для каждой задачи — отдельно! Этот подход медленный, дорогой, не масштабируемый, а поддержка таких моделей — настоящий кошмар.

Как мы построили нашу модель реляционного фундамента

Моя карьера вращалась вокруг искусственного интеллекта и машинного обучения на основе графоструктурированных данных. С самого начала я осознал, что точки данных не существуют изолированно. Скорее, они являются частью графа, связанного с другими фрагментами данных. Я применил этот подход к своей работе с социальными сетями и вирусным распространением информации, работая с данными из Facebook, Twitter, LinkedIn, Reddit и других источников.

Это понимание привело меня к участию в разработке графовых нейронных сетей в Стэнфорде – фреймворка, позволяющего машинам обучаться на основе взаимосвязей между сущностями, а не только на основе самих сущностей. Я применил это на практике, работая главным научным сотрудником в Pinterest, где алгоритм PinSage преобразил взаимодействие пользователей с Pinterest. Эта работа впоследствии переросла в Graph Transformers, которые используют возможности архитектуры Transformer для работы с графовыми данными. Это позволяет моделям фиксировать как локальные связи, так и долгосрочные зависимости в сложных сетях.

По мере продвижения моих исследований я наблюдал, как компьютерное зрение преобразилось благодаря сверточным сетям, а языковые навыки были преобразованы благодаря магистрам права. Но я понял, что прогнозы, от которых зависит бизнес на основе структурированных реляционных данных, всё ещё ждут своего прорыва, ограниченные методами машинного обучения, которые не менялись более двадцати лет! Десятилетия!

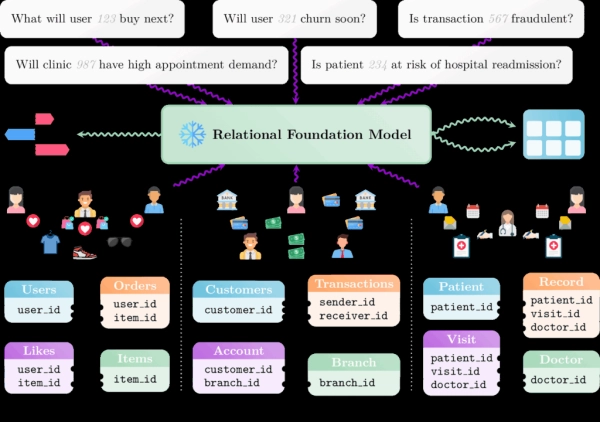

Кульминацией этих исследований и предвидения стало создание мной и моей командой первой реляционной модели фундамента (RFM) для бизнес-данных. Её цель — позволить машинам напрямую оперировать структурированными данными, чтобы понимать, как взаимодействуют такие сущности, как клиенты, транзакции и продукты. Зная взаимосвязи между этими сущностями, мы позволяем пользователям делать точные прогнозы на основе этих конкретных взаимосвязей и закономерностей.

В отличие от LLM, RFM-модели были разработаны для структурированных реляционных данных. RFM-модели предварительно обучены на ряде (синтетических) наборов данных, а также на ряде задач, связанных со структурированными бизнес-данными. Как и LLM, RFM-модели можно легко настроить на мгновенный ответ для широкого спектра предиктивных задач по заданной базе данных, без специфического для конкретной задачи или базы данных обучения.

Нам нужна была система, которая могла бы учиться непосредственно на основе структуры реальных баз данных, без привычной ручной настройки. Чтобы это стало возможным, мы рассматривали каждую базу данных как граф: таблицы стали типами узлов, строки – узлами, а внешние ключи связывали всё воедино. Таким образом, модель могла фактически «видеть», как такие вещи, как клиенты, транзакции и продукты, связаны и меняются с течением времени.

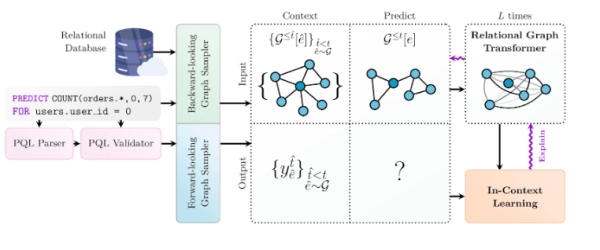

В основе модели лежит сочетание кодировщика столбцов и преобразователя реляционных графов. Каждая ячейка таблицы преобразуется в небольшое числовое представление в зависимости от типа хранящихся в ней данных, будь то число, категория или временная метка. Затем преобразователь просматривает граф, извлекая контекст из связанных таблиц, что помогает модели адаптироваться к новым схемам баз данных и типам данных.

Чтобы пользователи могли указать, какие прогнозы они хотят получить, мы создали простой интерфейс под названием Predictive Query Language (PQL). Он позволяет пользователям описывать, что они хотят предсказать, а модель позаботится обо всём остальном. Модель извлекает нужные данные, учится на прошлых примерах и выводит обоснованный ответ. Благодаря контекстному обучению её не нужно переобучать для каждой задачи! У нас есть возможность тонкой настройки, но она предназначена для очень специализированных задач.

Но это лишь один подход. В отрасли изучается несколько других стратегий:

Отраслевые подходы

1. Внутренние модели фундамента

Такие компании, как Netflix, создают собственные крупномасштабные базовые модели для рекомендаций. Как описано в их блоге, цель — перейти от десятков специализированных моделей к единой централизованной модели, которая изучает предпочтения пользователей по всей платформе. Аналогия с LLM очевидна: подобно тому, как предложение представлено в виде последовательности слов, пользователь представлен в виде последовательности фильмов, с которыми он взаимодействовал. Это позволяет инновациям поддерживать долгосрочную персонализацию, обрабатывая обширную историю взаимодействия.

Преимущества использования такой модели включают в себя контроль, дифференциацию и возможность адаптации архитектуры к потребностям предметной области (например, низкий уровень внимания к задержкам, встраивание на основе метаданных для холодного запуска). С другой стороны, обучение и поддержка таких моделей чрезвычайно затратны, требуя огромных объёмов данных, вычислительных и инженерных ресурсов. Более того, они обучаются на одном наборе данных (например, поведении пользователей Netflix) для одной задачи (например, рекомендаций).

2. Автоматизация разработки моделей с помощью AutoML или агентов Data Science

Такие платформы, как DataRobot и SageMaker Autopilot, продвигают идею автоматизации отдельных этапов процесса машинного обучения. Они помогают командам быстрее работать над такими задачами, как проектирование признаков, выбор модели и обучение. Это упрощает эксперименты, сокращает объем повторяющейся работы и расширяет доступ к машинному обучению за пределы узкоспециализированных команд. В том же духе появляются агенты Data Scientist, идея которых заключается в том, что агент Data Scientist выполняет все классические этапы и повторяет их: очистку данных, проектирование признаков, построение модели, оценку модели и, наконец, разработку модели. Хотя это действительно инновационный подход, пока еще не ясно, будет ли он эффективен в долгосрочной перспективе.

3. Использование графовых баз данных для связанных данных

Такие компании, как Neo4j и TigerGraph, усовершенствовали использование графовых баз данных для более точного отслеживания взаимосвязей точек данных. Это особенно важно в таких областях, как выявление мошенничества, кибербезопасность и управление цепочками поставок, где отношения между сущностями часто важнее самих сущностей. Моделируя данные как сети, а не как отдельные строки в таблице, графовые системы открыли новые способы анализа сложных реальных проблем.

Извлеченные уроки

Когда мы приступили к созданию нашей технологии, наша цель была проста: разработать архитектуры нейронных сетей, способные обучаться непосредственно на основе необработанных данных. Этот подход отражает современную революцию в области искусственного интеллекта (в буквальном смысле), которая основана на нейронных сетях, обучающихся непосредственно на основе пикселей изображения или слов в документе.

На практике наше видение продукта также предполагало, что человек просто подключится к данным и сделает прогноз. Это привело нас к амбициозной цели — созданию предобученной базовой модели, разработанной специально для бизнес-данных (как описано выше), избавляющей от необходимости вручную создавать признаки, обучающие наборы данных и специализированные модели для конкретных задач. Действительно амбициозная задача.

При построении нашей реляционной модели фундамента мы разработали новые архитектуры преобразователей, которые обслуживают набор взаимосвязанных таблиц – схему базы данных. Это потребовало расширения классического механизма внимания LLM, который обслуживает линейную последовательность токенов, до механизма внимания, обслуживающего граф данных. Важно отметить, что механизм внимания должен был быть универсальным для различных структур баз данных, а также для различных типов таблиц, как широких, так и узких, с различными типами столбцов и их значениями.

Ещё одной сложностью стало создание новой схемы обучения, поскольку прогнозирование следующего токена не является корректной целью. Вместо этого мы создали множество синтетических баз данных и предиктивных задач, имитирующих такие задачи, как выявление мошенничества, прогнозирование временных рядов, оптимизация цепочки поставок, профилирование рисков, кредитный скоринг, персонализированные рекомендации, прогнозирование оттока клиентов и оценка лидов.

В конечном итоге это привело к созданию предварительно обученной реляционной базовой модели, которую можно использовать для решения бизнес-задач, будь то финансовое мошенничество или мошенничество в страховании, или оценка медицинских и кредитных рисков.

Заключение

Машинное обучение никуда не денется, и по мере развития этой области наша обязанность как специалистов по обработке данных — инициировать более вдумчивое и откровенное обсуждение истинных возможностей наших технологий — в чем они хороши, а в чем несовершенны.

Мы все знаем, насколько преобразующим было и продолжает быть обучение по программе магистратуры права (LLM), но слишком часто оно внедряется в спешке, без учёта внутренних целей и потребностей. Как специалисты по технологиям, мы должны побуждать руководителей более внимательно изучать свои собственные данные, которые определяют уникальность их компании, и уделять время тщательному анализу того, какие технологии наилучшим образом используют эти данные для достижения бизнес-целей.

В этой статье мы рассмотрели возможности LLM, ценность, которая кроется в (часто) упускаемой из виду стороне структурированных данных, а также отраслевые решения для применения ИИ к структурированным данным, включая мое собственное решение и уроки, извлеченные из его создания.

Спасибо за прочтение.

Источник: towardsdatascience.com