Президент Трамп подписал указ, требующий от компаний, работающих с правительством США, сделать свои модели ИИ «свободными от идеологической предвзятости». Это может обернуться серьёзными проблемами для технологических гигантов.

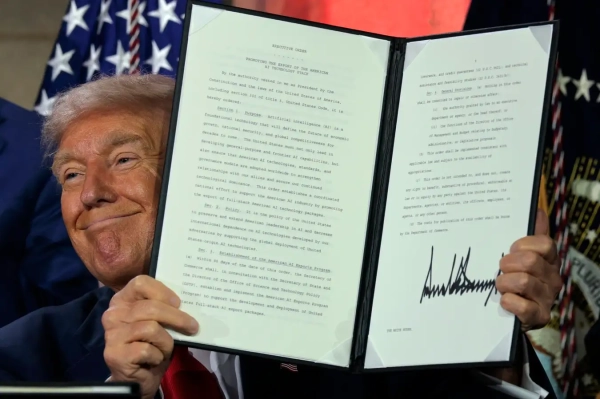

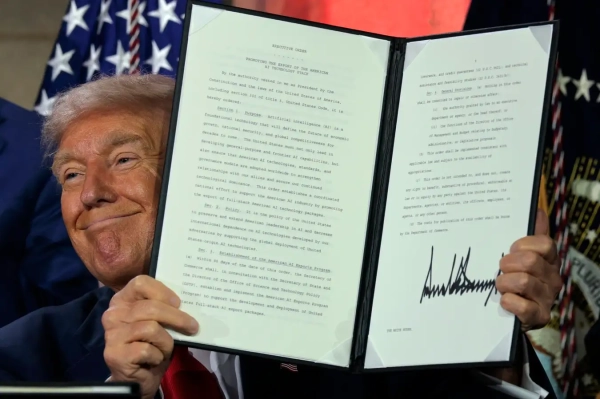

Президент США Дональд Трамп демонстрирует подписанный указ на саммите по искусственному интеллекту 23 июля 2025 года в Вашингтоне, округ Колумбия. Чип Сомодевилла/Getty Images

Президент Дональд Трамп хочет гарантировать, что правительство США будет предоставлять федеральные контракты только разработчикам искусственного интеллекта, чьи системы «свободны от идеологической предвзятости». Однако новые требования могут позволить его администрации навязывать собственное мировоззрение ИИ-моделям технологических компаний, и компании могут столкнуться со значительными трудностями и рисками, пытаясь адаптировать свои модели для соответствия требованиям.

«Предложение о том, что государственные контракты должны быть структурированы таким образом, чтобы гарантировать, что системы ИИ являются «объективными» и «свободными от идеологической предвзятости сверху», наводит на вопрос: объективными по чьему мнению?» — говорит Бекка Бранум из Центра демократии и технологий, некоммерческой организации, занимающейся государственной политикой в Вашингтоне, округ Колумбия.

Реклама

В Плане действий Белого дома в области искусственного интеллекта, опубликованном 23 июля, рекомендуется обновить федеральные правила, «чтобы гарантировать, что правительство будет заключать контракты только с передовыми разработчиками больших языковых моделей (LLM), которые гарантируют объективность своих систем и отсутствие идеологической предвзятости сверху вниз». В тот же день Трамп подписал соответствующий указ под названием «Предотвращение использования искусственного интеллекта в федеральном правительстве».

План действий в области ИИ также рекомендует Национальному институту стандартов и технологий США пересмотреть свою систему управления рисками, связанными с ИИ, чтобы «исключить ссылки на дезинформацию, разнообразие, равенство и инклюзивность, а также изменение климата». Администрация Трампа уже прекратила финансирование исследований, изучающих дезинформацию, и закрыла инициативы DEI, а также уволила исследователей, работающих над докладом Национальной оценки климата США, и сократила расходы на чистую энергию в рамках законопроекта, поддержанного Конгрессом, в котором преобладают республиканцы.

«Системы искусственного интеллекта нельзя считать „свободными от предвзятости сверху вниз“, если само правительство навязывает своё мировоззрение разработчикам и пользователям этих систем», — говорит Бранум. «Эти невероятно расплывчатые стандарты создают благоприятные условия для злоупотреблений».

Теперь разработчикам ИИ, имеющим или желающим получить федеральные контракты, придётся подчиниться требованиям администрации Трампа о создании моделей ИИ, свободных от «идеологической предвзятости». Amazon, Google и Microsoft заключили федеральные контракты на поставку услуг на базе ИИ и облачных вычислений различным государственным учреждениям, в то время как Meta предоставила свои модели ИИ Llama правительственным учреждениям США, работающим в сфере обороны и национальной безопасности.

В июле 2025 года Главное управление по цифровым технологиям и искусственному интеллекту Министерства обороны США объявило о заключении новых контрактов на сумму до 200 миллионов долларов с компаниями Anthropic, Google, OpenAI и xAI Илона Маска. Включение xAI было примечательным, учитывая недавнюю роль Маска в руководстве рабочей группой президента Трампа DOGE, которая уволила тысячи государственных служащих, не говоря уже о чат-боте Grok от xAI, который недавно попал в заголовки газет из-за выражения расистских и антисемитских взглядов, называя себя «МехаГитлером». Ни одна из компаний не ответила на запрос New Scientist, но некоторые сослались на общие заявления своих руководителей, восхваляющие план Трампа в области искусственного интеллекта.

В любом случае технологическим компаниям может быть сложно гарантировать, что их модели ИИ всегда будут соответствовать мировоззрению, выбранному администрацией Трампа, считает Пол Рёттгер из Университета Боккони в Италии. Это связано с тем, что большие языковые модели, лежащие в основе популярных чат-ботов на основе ИИ, таких как ChatGPT от OpenAI, обладают определёнными склонностями или предубеждениями, заложенными в них массивами интернет-данных, на которых они изначально обучались.

Согласно исследованию Рёттгера и его коллег, некоторые популярные чат-боты на основе искусственного интеллекта, разработанные как американскими, так и китайскими разработчиками, демонстрируют удивительно схожие взгляды, которые больше соответствуют позициям либеральных избирателей США по многим политическим вопросам, таким как гендерное равенство в оплате труда и участие трансгендерных женщин в женском спорте, при использовании их для помощи в написании текстов. Причины этой тенденции неясны, но команда предположила, что это может быть следствием обучения моделей искусственного интеллекта более общим принципам, таким как стимулирование честности, справедливости и доброты, а не целенаправленной адаптации моделей к либеральным взглядам со стороны разработчиков.

Изменения в фотографиях и видео с помощью искусственного интеллекта могут изменить наши воспоминания

Стало невероятно просто использовать искусственный интеллект для редактирования изображений или создания видео, чтобы удалять нежелательные объекты или украшать сцены, но это приводит к тому, что люди неправильно запоминают то, что они видели.

Разработчики ИИ по-прежнему могут «направлять модель на создание очень конкретных ответов по конкретным вопросам», уточняя ответы ИИ на определённые запросы пользователя, но это не изменит полностью стандартную установку модели и её неявные предубеждения, говорит Рёттгер. Этот подход также может противоречить общим целям обучения ИИ, таким как приоритет правдивости, отмечает он.

Американские технологические компании также могут потенциально оттолкнуть многих своих клиентов по всему миру, если попытаются согласовать свои коммерческие модели ИИ с мировоззрением администрации Трампа. «Мне интересно посмотреть, чем это обернётся, если США попытаются навязать определённую идеологию модели с глобальной базой пользователей», — говорит Рёттгер. «Думаю, это может обернуться серьёзными неприятностями».

Модели ИИ могли бы попытаться приблизиться к политической нейтральности, если бы их разработчики публично делились большей информацией о предвзятости каждой модели или создали бы набор «заведомо разнообразных моделей с разными идеологическими установками», считает Джиллиан Фишер из Вашингтонского университета. Но «на сегодняшний день создание действительно политически нейтральной модели ИИ может быть невозможно, учитывая изначально субъективную природу нейтральности и множество человеческих решений, необходимых для построения таких систем», — говорит она.

Источник: www.newscientist.com