Птицу никогда не считали умной. Но обучение с подкреплением, лежащее в основе самых передовых в мире систем искусственного интеллекта, гораздо более голубиное, чем человеческое.

В 1943 году, пока самые выдающиеся физики мира расщепляли атомы в рамках Манхэттенского проекта, американский психолог Б. Ф. Скиннер руководил собственным секретным правительственным проектом по победе во Второй мировой войне.

Скиннер не ставил перед собой цели создать новый класс более мощного и разрушительного оружия. Он хотел сделать обычные бомбы более точными. Эта идея пришла ему в голову, когда он смотрел в окно поезда по дороге на научную конференцию. «Я видел, как стая птиц взмывала в воздух и кружила, летя рядом с поездом», — писал он. «Внезапно я увидел в них „устройства“ с превосходным зрением и манёвренностью. Разве они не могли направить ракету?»

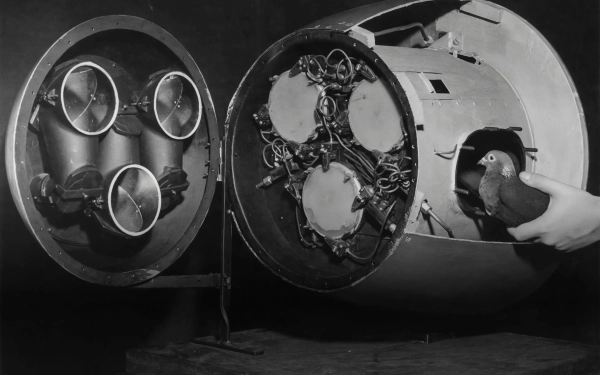

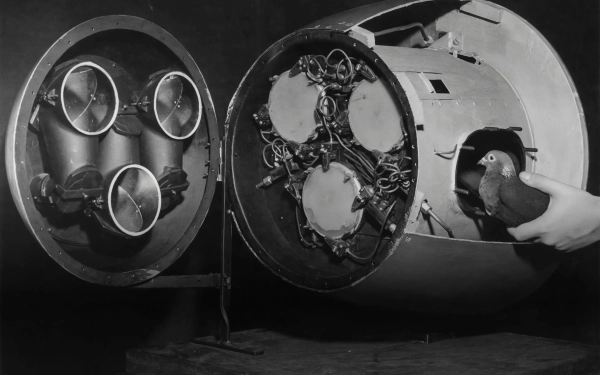

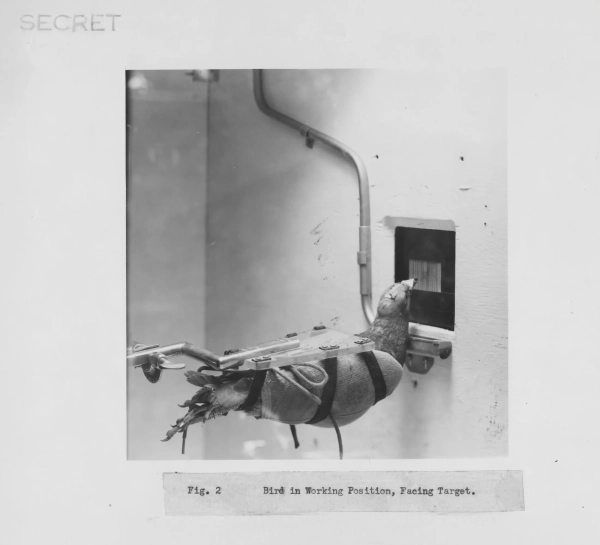

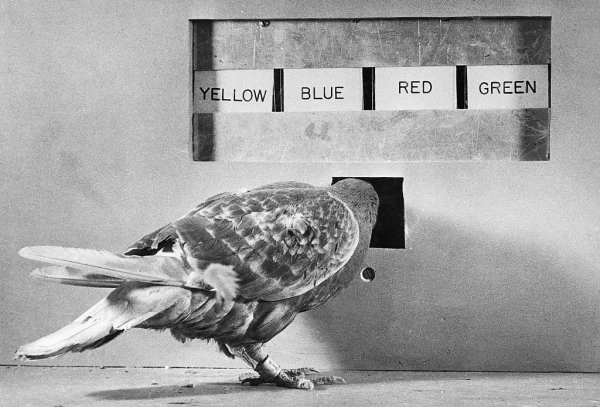

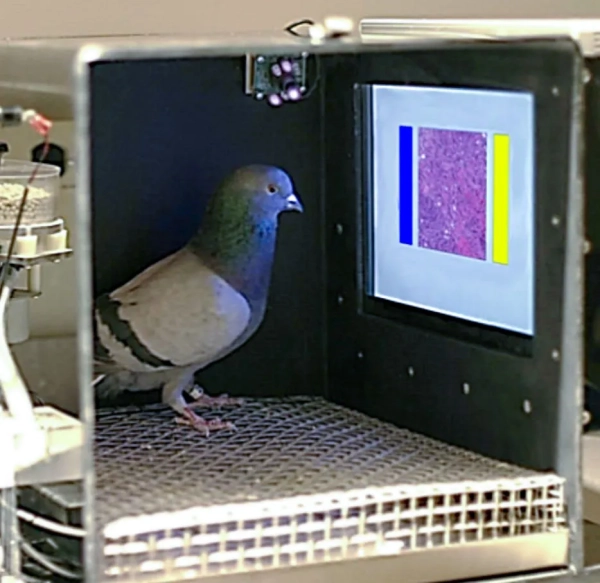

Скиннер начал свои исследования ракет с ворон, но эти умные чёрные птицы оказались непокорными. Поэтому он отправился в местный магазин, где продавали голубей китайским ресторанам, и так родился «Проект Голубь». Хотя обычные голуби, Columba livia, никому не казались умными животными, в лаборатории они проявили себя на удивление послушными объектами. Скиннер поощрял птиц едой за то, что они клевали нужную цель на аэрофотоснимках, и в конечном итоге планировал привязать их к устройству в носовой части боеголовки, которым они управляли бы, клюя цель на изображении, проецируемом через линзу на экран.

Военные никогда не использовали голубей-камикадзе Скиннера, но его эксперименты убедили его, что голубь — «чрезвычайно надёжный инструмент» для изучения глубинных процессов обучения. «Мы использовали голубей не потому, что голубь — умная птица, а потому, что он практичен и может быть преобразован в машину», — сказал он в 1944 году.

Связанная история

После десятилетий неудач инструменты машинного обучения открывают экологам доступ к бесценным акустическим данным.

Люди, ищущие предшественников искусственного интеллекта, часто ссылаются на научно-фантастические произведения таких авторов, как Айзек Азимов, или на мысленные эксперименты, такие как тест Тьюринга. Но не менее важным, хотя и неожиданным и менее оцененным, предшественником являются исследования Скиннера с голубями в середине XX века. Скиннер считал, что ассоциация — обучение путём проб и ошибок связывать действие с наказанием или поощрением — является основой любого поведения, не только у голубей, но и у всех живых организмов, включая человека. Его «бихевиористские» теории вышли из моды у психологов и исследователей животных в 1960-х годах, но были подхвачены специалистами по информатике, которые в конечном итоге легли в основу многих инструментов искусственного интеллекта от ведущих компаний, таких как Google и OpenAI.

Программы этих компаний всё чаще включают в себя машинное обучение, основная концепция которого — подкрепление — напрямую заимствована из школы психологии Скиннера, а его главные создатели, учёные-компьютерщики Ричард Саттон и Эндрю Барто, получили премию Тьюринга 2024 года, которую широко считают Нобелевской премией по информатике. Обучение с подкреплением помогло компьютерам управлять автомобилями, решать сложные математические задачи и побеждать гроссмейстеров в таких играх, как шахматы и го, — но оно достигло этого не путём имитации сложной работы человеческого разума. Скорее, оно значительно ускорило простые ассоциативные процессы голубиного мозга.

Саттон пишет, что это «горький урок» 70 лет исследований искусственного интеллекта: человеческий интеллект не сработал как модель для машинного обучения — вместо этого простые принципы ассоциативного обучения стали движущей силой алгоритмов, способных имитировать работу человека или превосходить его в самых разных задачах. Если искусственный интеллект действительно близок к тому, чтобы сбросить ярмо своих создателей, как опасаются многие, то наши компьютерные властители могут оказаться не столько похожими на нас самих, сколько на «крыс с крыльями» — и обладать мозгом размером с планету. И даже если это не так, голубиный мозг может, по крайней мере, помочь развеять миф о технологии, которая, как многие опасаются (или радуются), «становится человеческой».

В свою очередь, недавние достижения искусственного интеллекта побуждают некоторых исследователей животных переосмыслить эволюцию естественного интеллекта. Йохан Линд, биолог из Стокгольмского университета, написал о «парадоксе ассоциативного обучения», при котором этот процесс в значительной степени отвергается биологами как слишком упрощённый для формирования сложного поведения у животных, но ценится за способность компьютеров к человеческому поведению. Исследование предполагает не только большую роль ассоциативного обучения в жизни разумных животных, таких как шимпанзе и вороны, но и гораздо большую сложность в жизни животных, которых мы долгое время считали простоватыми, например, обыкновенную Columba livia.

Когда Саттон начал работать в сфере искусственного интеллекта, он чувствовал, что у него есть «секретное оружие», как он мне рассказал: он изучал психологию ещё в университете. «Я изучал психологию в литературе о животных», — говорит он.

Иван Павлов начал исследовать механизмы ассоциативного обучения в конце XIX века в своих знаменитых экспериментах по «классическому обусловливанию», которые показали, что у собак наблюдалось слюнотечение при нейтральном стимуле, таком как звонок или мигающий свет, если он предсказуемо сочетался с подачей пищи. В середине XX века Скиннер взял принципы обусловливания Павлова и распространил их с непроизвольных рефлексов животного на его поведение в целом.

Скиннер писал, что «поведение формируется и поддерживается его последствиями» — что случайное действие с желаемым результатом, например, нажатие рычага, высвобождающего кормовую гранулу, будет «подкреплено», так что животное, вероятно, повторит его. Скиннер закреплял поведение своих лабораторных животных шаг за шагом, обучая крыс манипулировать шариками, а голубей — играть простые мелодии на четырёхклавишном пианино. Животные усваивали цепочки поведения методом проб и ошибок, чтобы максимизировать долгосрочное вознаграждение. Скиннер утверждал, что этот тип ассоциативного обучения, который он называл «оперантным обусловливанием» (и который другие психологи называли «инструментальным обучением»), является строительным блоком любого поведения. Он считал, что психология должна изучать только поведение, которое можно наблюдать и измерять, никогда не ссылаясь на «внутренний агент» в разуме.

Когда Ричард Саттон начал работать в сфере искусственного интеллекта, он чувствовал, что у него есть «секретное оружие»: он изучал психологию ещё будучи студентом. «Я изучал психологическую литературу о животных», — говорит он.

Скиннер считал, что даже человеческий язык развивается посредством оперантного обусловливания, когда дети усваивают значение слов через подкрепление. Однако его книга 1957 года на эту тему «Вербальное поведение» вызвала резкую критику Ноама Хомского, и фокус психологии начал смещаться с наблюдаемого поведения на врождённые «когнитивные» способности человеческого разума, такие как логика и символическое мышление. Биологи вскоре также восстали против бихевиоризма, критикуя стремление психологов объяснить разнообразие поведения животных с помощью элементарного и универсального механизма. Они утверждали, что каждый вид выработал определённые формы поведения, соответствующие его среде обитания и образу жизни, и что большинство форм поведения являются унаследованными, а не приобретёнными.

К 70-м годам, когда Саттон начал читать об экспериментах Скиннера и подобных экспериментах, многие психологи и исследователи, интересующиеся интеллектом, переключились с голубей с горошинами мозга, которые обучаются преимущественно ассоциативно, на животных с большим мозгом и более сложным поведением, которое предполагало наличие у них потенциальных когнитивных способностей. «Это, очевидно, было старомодным материалом, который больше не интересовал людей», — сказал он мне. Тем не менее, Саттон нашёл эти старые эксперименты поучительными для машинного обучения: «Я пришёл к ИИ с мышлением теоретика обучения животных и увидел, насколько не хватает чего-то похожего на инструментальное обучение в инженерии».

Многие инженеры во второй половине XX века пытались смоделировать ИИ на основе человеческого интеллекта, создавая замысловатые программы, которые пытались имитировать человеческое мышление и реализовывать правила, управляющие реакцией и поведением человека. Этот подход, обычно называемый «символическим ИИ», был крайне ограничен; программы спотыкались на задачах, которые были легки для людей, таких как распознавание объектов и слов. Было просто невозможно прописать в коде бесчисленные правила классификации, которые люди используют, чтобы, скажем, отделить яблоки от апельсинов или кошек от собак, а без распознавания образов прорывы в более сложных задачах, таких как решение задач, игры и перевод языков, также казались маловероятными. Эти специалисты по информатике, как писал скептик ИИ Хуберт Дрейфус в 1972 году, не достигли ничего, кроме «маленького инженерного триумфа, импровизированного решения конкретной проблемы, не имеющего общей применимости».

Однако исследования голубей предложили другой путь. Исследование 1964 года показало, что голуби могут научиться различать фотографии с людьми и фотографии без людей. Исследователи просто показывали птицам серию изображений и вознаграждали их кормом за клевание изображения с человеком. Сначала птицы клевали случайным образом, но быстро научились определять нужные изображения, включая фотографии, где люди были частично скрыты. Результаты показали, что для сортировки объектов не нужны правила; можно было усваивать понятия и использовать категории исключительно посредством ассоциативного обучения.

Когда Саттон начал работать с Барто над ИИ в конце 70-х, они хотели создать «полноценного, интерактивного целеустремлённого агента», который мог бы исследовать окружающую среду и влиять на неё, как голубь или крыса. «Мы всегда чувствовали, что изучаемые нами проблемы ближе к тому, с чем приходилось сталкиваться животным в процессе эволюции, чтобы действительно выжить», — сказал мне Барто. Агенту требовались две основные функции: поиск, чтобы пробовать и выбирать из множества действий в ситуации, и память, чтобы связывать действие с ситуацией, где оно приводило к вознаграждению. Саттон и Барто назвали свой подход «обучением с подкреплением»; как сказал Саттон: «По сути, это инструментальное обучение». В 1998 году они опубликовали окончательное исследование этой концепции в книге «Обучение с подкреплением: введение».

В течение следующих двух десятилетий, по мере экспоненциального роста вычислительной мощности, появилась возможность обучать ИИ все более сложным задачам — то есть, по сути, проводить «голубя» ИИ через миллионы дополнительных испытаний.

Программы, обученные с использованием сочетания человеческого ввода и обучения с подкреплением, победили экспертов-людей в шахматах и Atari. Затем, в 2017 году, инженеры Google DeepMind создали программу искусственного интеллекта AlphaGo Zero, полностью основанную на обучении с подкреплением, дав ей численное вознаграждение +1 за каждую выигранную партию в го и −1 за каждую проигранную партию. Запрограммированная на поиск максимального вознаграждения, она начала работу без каких-либо знаний о го, но совершенствовалась в течение 40 дней, пока не достигла того, что ее создатели назвали «сверхчеловеческой производительностью». Она не только смогла победить лучших в мире игроков в го, игру, которая считается даже более сложной, чем шахматы, но и фактически разработала новые стратегии, которые теперь используют профессиональные игроки.

Связанная история

К списку видов, использующих «имена», можно добавить мармозеток. Но есть ли у животных что-то ещё, что они могут сказать, остаётся неизвестным.

«Человечество накопило знания о го, сыгранные миллионами партий за тысячи лет», — писали создатели программы в журнале Nature в 2017 году. «За несколько дней, начав с чистого листа, AlphaGo Zero смогла заново открыть большую часть этих знаний о го, а также разработать новые стратегии, которые позволяют по-новому взглянуть на древнейшую из игр». Ведущим исследователем группы был Дэвид Сильвер, изучавший обучение с подкреплением под руководством Саттона в Университете Альберты.

Сегодня всё больше технологических компаний обращаются к обучению с подкреплением в таких продуктах, как чат-боты и агенты для взаимодействия с потребителями. Первое поколение генеративного ИИ, включая большие языковые модели, такие как GPT-2 и GPT-3 от OpenAI, использовало более простую форму ассоциативного обучения, называемую «обучением с учителем», которая обучала модель на наборах данных, размеченных людьми. Программисты часто использовали подкрепление для точной настройки результатов, прося людей оценить производительность программы, а затем передавая эти оценки программе в качестве целей для достижения. (Исследователи называют это «обучением с подкреплением на основе обратной связи»).

Затем, прошлой осенью, OpenAI представила свою серию больших языковых моделей O, которые она классифицирует как модели «рассуждения». Компания-лидер в области ИИ хвасталась тем, что они «обучены рассуждению с помощью обучения с подкреплением» и заявляли, что способны к «длинной внутренней цепочке мыслей». Китайский стартап DeepSeek также использовал обучение с подкреплением для тренировки своего привлекающего внимание «рассуждения» LLM, R1. «Вместо того, чтобы явно обучать модель решению задач, мы просто даём ей нужные стимулы, и она самостоятельно разрабатывает передовые стратегии решения проблем», — пояснили они.

Эти описания могут впечатлить пользователей, но, по крайней мере, с психологической точки зрения, они вызывают недоумение. Компьютеру, обученному обучению с подкреплением, для формирования ассоциаций и максимизации вознаграждения достаточно только поиска и памяти, а не рассуждений или каких-либо других когнитивных механизмов. Некоторые специалисты по информатике критикуют тенденцию антропоморфизировать «мышление» этих моделей, а группа инженеров Apple недавно опубликовала статью, в которой отмечается их неспособность справиться с некоторыми сложными задачами и «поднимаются важные вопросы об их истинных способностях к рассуждению».

Саттон также отверг заявления о рассуждениях как о «маркетинге» в электронном письме, добавив, что «ни один серьёзный исследователь разума не стал бы использовать „рассуждение“ для описания того, что происходит в магистратуре по праву». Тем не менее, он вместе с Сильвером и другими соавторами утверждает, что метод голубей — обучение методом проб и ошибок тому, какие действия принесут вознаграждение, — «достаточен для того, чтобы управлять поведением, которое демонстрирует большинство, если не все, способности, изучаемые в естественном и искусственном интеллекте», включая человеческий язык «во всём его богатстве».

В статье, опубликованной в апреле, Саттон и Сильвер заявили, что «современные технологии с правильно подобранными алгоритмами уже обеспечивают достаточно мощную основу для… быстрого развития ИИ до уровня по-настоящему сверхчеловеческих агентов». Ключевым моментом, по их мнению, является создание агентов ИИ, которые меньше, чем LLM, зависят от человеческого диалога и предубеждений в определении своего поведения.

«Мощные агенты должны иметь собственный поток опыта, который, подобно людям, развивается в течение длительного времени», — писали они. «В конечном счёте, эмпирические данные превзойдут по объёму и качеству данные, генерируемые человеком. Эта смена парадигмы, сопровождаемая алгоритмическими достижениями в обучении с подкреплением, откроет во многих областях новые возможности, превосходящие те, которыми обладает любой человек».

Если компьютеры могут делать все это с помощью мозга, похожего на голубиный, некоторые исследователи животных теперь задаются вопросом, не заслуживают ли настоящие голуби большего признания, чем им обычно приписывают.

«Рассматривая это в свете достижений искусственного интеллекта, распространение ассоциативного обучения на предположительно более сложные формы когнитивной деятельности открывает новые перспективы для понимания того, как могли эволюционировать биологические системы», — написал Эд Вассерман, психолог из Университета Айовы, в недавнем исследовании, опубликованном в журнале Current Biology.

Вассерман обучил голубей успешно выполнять сложную задачу по категоризации, с которой не справились несколько студентов. Студенты пытались найти правило, которое помогло бы им сортировать различные диски; голуби просто выработали чувство принадлежности к той или иной группе.

В одном из экспериментов Вассерман обучил голубей успешно выполнять сложную задачу категоризации, с которой не справились несколько студентов. Студенты тщетно пытались найти правило, которое помогло бы им сортировать различные диски с параллельными чёрными линиями разной ширины и наклона; голуби просто выработали, благодаря практике и ассоциациям, чувство принадлежности к той или иной группе дисков.

Как и Саттон, Вассерман заинтересовался бихевиористской психологией, когда теории Скиннера вышли из моды. Однако он не переключился на компьютерные науки: он остался с голубями. «Голубь живёт или умирает по этим действительно элементарным правилам обучения», — сказал мне недавно Вассерман, — «но они достаточно мощны, чтобы добиться колоссальных успехов в распознавании объектов». В своих самых известных экспериментах Вассерман обучал голубей обнаруживать раковые ткани и симптомы сердечно-сосудистых заболеваний на медицинских снимках так же точно, как опытные врачи с дипломами в рамках за рабочим столом. Учитывая его результаты, Вассерман нашел странным, что так много психологов и этологов считали ассоциативное обучение грубым, механическим механизмом, неспособным развить интеллект умных животных, таких как обезьяны, слоны, дельфины, попугаи и вороны.

Другие исследователи также начали пересматривать роль ассоциативного обучения в поведении животных после того, как ИИ начал превосходить профессионалов-людей в сложных играх. «С развитием искусственного интеллекта, который, по сути, построен на ассоциативных процессах, становится всё более ироничным, что ассоциативное обучение считается слишком простым и недостаточным для создания биологического интеллекта», — писал Линд, биолог из Стокгольмского университета, в 2023 году. В своих биологических исследованиях он часто ссылается на компьютерные науки Саттона и Барто и считает, что именно символический язык человека и его кумулятивная культура действительно выделяют его в отдельную когнитивную категорию.

Этологи обычно предлагают когнитивные механизмы, такие как теория разума (то есть способность приписывать ментальные состояния другим), для объяснения примечательного поведения животных, такого как социальное обучение и использование инструментов. Но Линд построил модели, показывающие, что эти гибкие формы поведения могли развиться посредством ассоциативного обучения, предполагая, что, возможно, нет никакой необходимости задействовать когнитивные механизмы вообще. Если животные учатся связывать поведение с вознаграждением, то само поведение станет приблизительно соответствовать ценности вознаграждения. Новое поведение затем может быть связано с первым поведением, позволяя животному выучить цепочки действий, которые в конечном итоге приводят к вознаграждению. По мнению Линда, исследования, демонстрирующие самоконтроль и планирование у шимпанзе и воронов, вероятно, описывают поведение, приобретенное с опытом, а не врожденные механизмы разума.

Связанная история

Рассуждение — это новый рубеж в развитии искусственного интеллекта, но действия Google указывают на растущую и дорогостоящую проблему: модели слишком много думают без веской причины.

Линд был разочарован тем, что он называет «низким стандартом, принятым в исследованиях познавательных способностей животных». Как он написал в электронном письме, «многие исследователи в этой области, похоже, не беспокоятся об исключении альтернативных гипотез и, похоже, с радостью игнорируют значительную часть современных и исторических знаний». Однако есть некоторые признаки того, что его аргументы начинают приобретать популярность. Группа психологов, не связанных с Линдом, в прошлом году сослалась на его «парадокс ассоциативного обучения», критикуя исследование Current Biology, которое якобы показывало, что вороны использовали «истинный статистический вывод», а не «низкоуровневые стратегии ассоциативного обучения» в ходе эксперимента. Психологи обнаружили, что могут объяснить поведение ворон с помощью простой модели обучения с подкреплением — «именно того самого процесса низкоуровневого ассоциативного обучения, который [авторы оригинальной работы] исключили».

Скиннер, возможно, чувствовал бы себя оправданным подобными аргументами. Он сетовал на когнитивный поворот психологии до самой своей смерти в 1990 году, утверждая, что с научной точки зрения безответственно исследовать разум живых существ. После «Проекта Голубь» он всё больше увлекался «бихевиористскими» решениями общественных проблем. Он прошёл путь от дрессировки голубей для войны до таких изобретений, как «Воздушная ясли», целью которых было «упростить» уход за младенцем, помещая его под стекло в камеру с контролируемым климатом и устраняя необходимость в одежде и постельных принадлежностях. Скиннер отрицал свободу воли, утверждая, что поведение человека определяется факторами окружающей среды, и написал роман «Уолден II» об утопическом сообществе, основанном на его идеях.

Те, кто заботится о животных, могут испытывать беспокойство по поводу возрождения теории бихевиоризма. «Когнитивная революция» порвала с вековым западным мышлением, которое подчёркивало превосходство человека над животными и относилось к другим существам как к машинам, реагирующим на стимул и реакцию. Но утверждение, что животные обучаются ассоциативно, не то же самое, что утверждение об их глупости. Такие учёные, как Линд и Вассерман, не отрицают, что внутренние силы, такие как инстинкты и эмоции, также влияют на поведение животных. Саттон также считает, что животные формируют модели мира на основе своего опыта и используют их для планирования действий. Их точка зрения заключается не в том, что умные животные глупы, а в том, что ассоциативное обучение — гораздо более мощный, по сути, «когнитивный» механизм, чем полагают многие их коллеги. Психологи, недавно раскритиковавшие исследование ворон и статистический вывод, не пришли к выводу о глупости птиц. Напротив, они утверждали, что «модель обучения с подкреплением может формировать сложное, гибкое поведение».

Это во многом согласуется с работами другого психолога, Роберта Рескорлы, чьи работы в 70-х и 80-х годах оказали влияние как на Вассермана, так и на Саттона. Рескорла призывал людей рассматривать ассоциацию не как «низкоуровневый механический процесс», а как «обучение, возникающее в результате воздействия взаимосвязей между событиями окружающей среды» и «основной способ, с помощью которого организм представляет структуру своего мира».

Это справедливо даже для лабораторного голубя, клюющего экраны и кнопки в небольшом экспериментальном ящике, где учёные тщательно контролируют и измеряют стимулы и вознаграждения. Но обучение голубя выходит за рамки ящика. Студенты Вассермана перевозят птиц между вольером и лабораторией в вёдрах, и опытные голуби сразу же запрыгивают в вёдра, как только студенты открывают дверцы. Как и предполагал Рескорла, они изучают структуру своего мира внутри лаборатории и взаимосвязь его частей, таких как ведро и ящик, хотя и не всегда знают, с какой конкретной задачей им предстоит столкнуться внутри.

Сравнительные психологи и исследователи животных уже давно бьются над вопросом, который внезапно стал актуальным из-за ИИ: как нам приписать способность чувствовать другим живым существам?

Те же ассоциативные механизмы, посредством которых голубь познаёт структуру своего мира, могут открыть окно в ту внутреннюю жизнь, о существовании которой Скиннер и многие психологи, работавшие ранее, утверждали, что она не существует. Исследователи в области фармацевтики давно используют голубей в задачах на различение наркотиков, когда им дают, например, амфетамин или седативное средство и вознаграждают пищевой гранулой за правильное определение принятого наркотика. Успех птиц свидетельствует о том, что они не только испытывают внутренние состояния, но и различают их. «Разве это не равносильно интроспекции?» — спросил Вассерман.

Трудно представить себе, чтобы ИИ справился с этой конкретной задачей на равных с голубем — напоминание о том, что, хотя ИИ и животные имеют общие ассоциативные механизмы, жизнь — это нечто большее, чем поведение и обучение. Голубь заслуживает этического рассмотрения как живое существо не из-за того, как он учится, а из-за того, что он чувствует. Голубь может испытывать боль и страдать, в то время как чат-бот ИИ не может, даже если некоторые обширные языковые модели, обученные на корпусе текстов, включающем описания человеческих страданий и научно-фантастические истории о разумных компьютерах, могут обмануть людей, заставив их поверить в обратное.

«Интенсивные государственные и частные инвестиции в исследования ИИ в последние годы привели к появлению тех самых технологий, которые сегодня заставляют нас столкнуться с вопросом о наличии у ИИ сознания», — писали два философа науки в журнале Aeon в 2023 году. «Чтобы ответить на эти актуальные вопросы, нам необходимы аналогичные инвестиции в исследования познавательных способностей и поведения животных». Действительно, специалисты по сравнительной психологии и зоотехники давно бьются над вопросами, которые внезапно стали актуальными из-за ИИ: как приписать способность чувствовать другим живым существам? Как отличить истинную способность чувствовать от весьма убедительного её проявления?

Такое начинание дало бы знания не только о технологиях и животных, но и о нас самих. Большинство психологов, вероятно, не зашли бы так далеко, как Саттон, утверждая, что вознаграждение достаточно для объяснения большей части, если не всего, человеческого поведения, но никто не станет спорить, что люди часто учатся и посредством ассоциации. Более того, большинство студентов Вассермана в конечном итоге добились успеха в его недавнем эксперименте с полосатыми дисками, но только после того, как отказались от поиска правил. Они прибегали, как голуби, к ассоциации и впоследствии не могли легко объяснить, чему научились. Просто при достаточной практике они начали чувствовать категории.

Это ещё один парадокс ассоциативного обучения: то, что долгое время считалось самой сложной формой интеллекта — когнитивная способность, такая как обучение на основе правил, — возможно, делает нас людьми, но мы также обращаемся к ней для решения самых простых задач, например, сортировки предметов по цвету или размеру. Между тем, некоторые из самых сложных проявлений человеческого обучения — например, когда сомелье учится различать вкусы винограда — усваиваются не через правила, а исключительно через опыт.

Обучение через опыт основано на древних ассоциативных механизмах, общих для нас с голубями и бесчисленным множеством других существ, от медоносных пчёл до рыб. Лабораторный голубь — не только часть наших компьютеров, но и нашего мозга, и он — движущая сила некоторых из самых впечатляющих достижений человечества.

Бен Крейр — писатель, пишущий о науке и путешествиях, живущий в Берлине.

Источник: www.technologyreview.com