Многоуровневый подход к сегментации, цветокоррекции и улучшению изображений в зависимости от предметной области.

Делиться

Введение

Хотя замена фона является неотъемлемой частью редактирования изображений, достижение результатов производственного уровня остается серьезной проблемой для разработчиков. Многие существующие инструменты работают как «черные ящики», а это значит, что у нас мало контроля над балансом между качеством и скоростью, необходимыми для реального приложения. Я столкнулся с этими трудностями при создании VividFlow . Проект в основном ориентирован на генерацию видео из изображений, но он также предоставляет пользователям возможность менять фон с помощью подсказок искусственного интеллекта.

Чтобы повысить надежность системы при работе с различными типами изображений, я сосредоточился на трех технических областях, которые существенно повлияли на результаты:

- Трехуровневая стратегия резервного копирования : я обнаружил, что сочетание BiRefNet , U²-Net и традиционных градиентов гарантирует, что система всегда будет создавать пригодную для использования маску, даже если основная модель не сработает.

- Коррекция в цветовом пространстве Lab : Переход к цветовому пространству Lab помог мне устранить артефакты в виде «желтых ореолов», которые часто появляются при смешивании изображений в стандартном цветовом пространстве RGB.

- Специальная логика для мультипликационной графики : я добавил специальный конвейер для обнаружения и сохранения четких контуров и однородных цветов, характерных именно для иллюстраций.

Вот подходы, которые сработали для меня при развертывании приложения на платформе HuggingFace Spaces. В этой статье я хочу поделиться логикой и некоторыми математическими расчетами, лежащими в основе этих решений, и тем, как они помогли системе более стабильно обрабатывать разнообразные и сложные изображения из реального мира.

1. Проблема с RGB: почему фон оставляет следы

Стандартное альфа-смешивание RGB обычно оставляет после себя стойкий визуальный беспорядок при замене фона. Когда вы смешиваете портретный снимок на фоне цветной стены с новым фоном, краевые пиксели обычно сохраняют часть исходного цвета. Это наиболее очевидно, когда исходный и новый фон имеют контрастные цвета, например, когда теплая желтая стена заменена на холодное голубое небо. Часто в результате получается неестественный желтоватый оттенок, который сразу выдает, что изображение является композитным. Именно поэтому, даже если ваша маска сегментации идеально точна, итоговое композитное изображение все равно выглядит явно ненатурально — цветовое искажение выдает редактирование.

Проблема кроется в том, как работает смешивание RGB. Стандартное альфа-композитинг обрабатывает каждый цветовой канал независимо, вычисляя взвешенные средние значения без учета того, как человек на самом деле воспринимает цвет. Чтобы наглядно увидеть эту проблему, рассмотрим пример, визуализированный на рисунке 1 ниже. Возьмем пиксель темных волос (RGB 80, 60, 40), снятый на фоне желтой стены (RGB 200, 180, 120). Во время фотосъемки свет от этой стены отражается на краях волос, создавая цветовой оттенок. Если применить 50% смешивание с новым синим фоном в пространстве RGB, пиксель превратится в размытое среднее значение (RGB 140, 120, 80), которое сохранит явные следы исходного желтого цвета — именно ту проблему желтоватого оттенка, которую мы хотим устранить. Вместо плавного перехода это загрязнение разрушает иллюзию естественной интеграции.

Как показано на рисунке выше, на среднем изображении видно, как смешивание RGB приводит к размытому результату, сохраняющему желтоватый оттенок исходной стены. На крайнем правом изображении показано решение: переключение в цветовое пространство Lab перед окончательным смешиванием позволяет точно удалить это загрязнение. Пространство Lab разделяет яркость (канал L) и насыщенность (каналы a и b), что позволяет целенаправленно корректировать цветовые искажения, не нарушая яркость, определяющую края объектов. Скорректированный результат (RGB 75, 55, 35) обеспечивает естественную темноту волос, устраняя при этом желтоватый оттенок с помощью векторных операций в плоскости ab — математического процесса, который я подробно опишу в разделе 5.

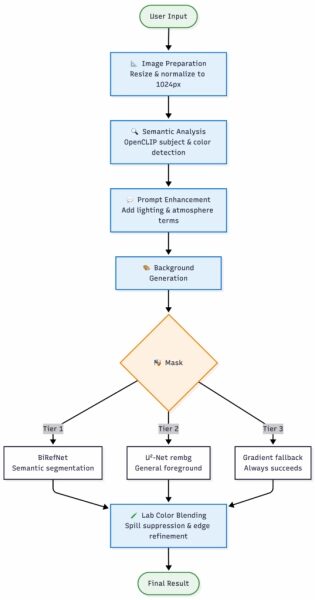

2. Системная архитектура: организация рабочего процесса

Конвейер замены фона координирует работу нескольких специализированных компонентов в тщательно разработанной последовательности, которая обеспечивает как надежность, так и эффективность. Архитектура гарантирует, что даже при возникновении сложных сценариев для отдельных моделей система плавно переключается на альтернативные подходы, сохраняя при этом качество выходных данных без нерационального использования ресурсов графического процессора.

В соответствии с архитектурной схемой, конвейер выполняется в шесть отдельных этапов:

Подготовка изображений : Система изменяет размер и нормализует входные изображения до максимального размера 1024 пикселей, обеспечивая совместимость с архитектурами диффузионных моделей при сохранении соотношения сторон.

Семантический анализ : Кодировщик OpenCLIP анализирует изображение для определения типа объекта (человек, животное, объект, природа или здание) и измеряет характеристики цветовой температуры (теплые и холодные тона).

Улучшение подсказки : На основе семантического анализа система дополняет исходную подсказку пользователя контекстно подходящими описаниями освещения (золотой час, мягкий рассеянный свет, яркий дневной свет) и атмосферными качествами (профессиональный, естественный, элегантный, уютный).

Генерация фона : Stable Diffusion XL синтезирует новую фоновую сцену, используя улучшенную подсказку, настроенную с помощью планировщика DPM-Solver++, работающего в течение двадцати пяти шагов вывода при масштабе управления 7,5.

Надежное создание масок : система использует три постепенно упрощающихся подхода для извлечения переднего плана. BiRefNet обеспечивает высококачественную семантическую сегментацию в качестве первого варианта. Если BiRefNet дает неудовлетворительные результаты, U²-Net через rembg предлагает надежное извлечение общего назначения. Традиционные методы, основанные на градиенте, служат в качестве последнего резервного варианта, гарантируя создание маски независимо от сложности входных данных.

Перцептивное смешивание цветов : этап слияния работает в цветовом пространстве Lab, что позволяет точно удалять цветовые загрязнения фона за счет депроекции хроматического вектора. Адаптивная сила подавления масштабируется в зависимости от сходства цвета каждого пикселя с исходным фоном. Многомасштабное уточнение краев создает естественные переходы вокруг мелких деталей, а результат компонуется обратно в стандартное цветовое пространство с соответствующей гамма-коррекцией.

3. Трехуровневая стратегия производства масок: качество и надежность.

При замене фона качество маски — это предел, итоговое изображение никогда не будет выглядеть лучше, чем маска, на которой оно построено. Однако полагаться только на одну модель сегментации — это верный путь к провалу при работе с реальным разнообразием изображений. Я обнаружил, что трехступенчатая стратегия резервного копирования — лучший способ гарантировать, что каждый пользователь получит пригодный для использования результат, независимо от типа изображения.

- BiRefNet (Лидер качества): Это основной выбор для сложных сцен. Если вы посмотрите на левую панель сравнительного изображения, обратите внимание, насколько чисто она обрабатывает отдельные пряди вьющихся волос. Она использует двустороннюю архитектуру, которая уравновешивает высокоуровневое семантическое понимание с мелкозернистой детализацией. По моему опыту, это единственная модель, которая последовательно избегает «рваного» вида вокруг непослушных волос.

- U²-Net через rembg (сбалансированный резервный вариант): Когда BiRefNet испытывает трудности, часто при работе с мультфильмами или очень мелкими объектами, система автоматически переключается на U²-Net. На среднем изображении края волос немного «размыты» и менее детализированы, чем у BiRefNet, но общая форма тела по-прежнему очень точна. На этом этапе я добавил пользовательское растяжение альфа-канала и морфологические улучшения, чтобы предотвратить случайное обрезание конечностей, таких как руки и ноги.

- Традиционные градиенты (надежная страховка): В качестве крайней меры я использую операторы Собеля и Лапласа для поиска границ на основе интенсивности пикселей. На правой панели показан результат: он намного проще и не учитывает тонкие текстуры волос, но гарантирует отсутствие ошибок в модели. Для придания профессионального вида я применяю управляемый фильтр , используя исходное изображение в качестве сигнала, что помогает сгладить шум, сохраняя при этом четкость структурных границ.

4. Операции в цветовом пространстве для целенаправленного удаления загрязнений.

Решение проблемы цветового смешения в RGB-пространстве заключается в выборе цветового пространства, где яркость и хроматичность четко разделяются. Цветовое пространство Lab, стандартизированное CIE (2004), обеспечивает именно это свойство благодаря своей трехканальной структуре: канал L кодирует яркость по шкале от 0 до 100, а каналы a и b представляют собой цветовые противоположности, охватывающие диапазон от зеленого до красного и от синего до желтого соответственно. В отличие от RGB, где все три канала взаимодействуют друг с другом во время операций смешивания, Lab позволяет точно манипулировать цветовой информацией, не нарушая значений яркости, определяющих границы объектов.

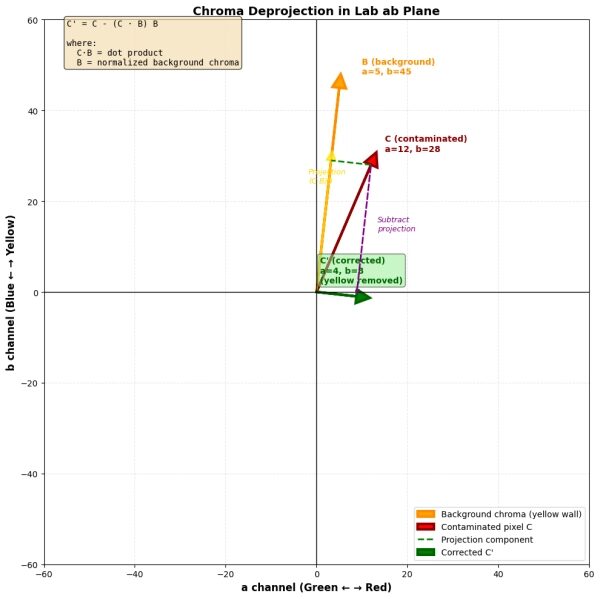

Математическая коррекция осуществляется посредством проекции вектора в хроматическую плоскость ab. Для геометрического понимания этой операции рассмотрим рисунок 3 ниже , который визуализирует процесс в двумерном пространстве ab. Когда краевой пиксель имеет загрязнение желтым фоном, его измеренный вектор хроматичности C представляет собой цветовые координаты пикселя (a, b) в плоскости ab, частично направленные в сторону желтого цвета. На диаграмме загрязненный пиксель отображается красной стрелкой с координатами (a = 12, b = 28), а вектор хроматичности желтого фона B отображается оранжевой стрелкой, направленной в сторону (a = 5, b = 45). Ключевой момент заключается в том, что часть вектора C , совпадающая с вектором B, представляет собой нежелательное влияние фона, а перпендикулярная часть представляет истинный цвет объекта.

Рисунок 3. Векторная проекция в хроматическую плоскость Lab ab с удалением желтого фонового загрязнения.

Как показано на рисунке выше , система удаляет загрязнения путем проецирования C на нормализованное направление фона B̂ и вычитания этой проекции. Математически скорректированный вектор цветности принимает следующий вид:

[mathbf{C}' = mathbf{C} – (mathbf{C} cdot mathbf{hat{B}}) mathbf{hat{B}}]

где C · B̂ обозначает скалярное произведение, измеряющее, какая часть C находится вдоль направления фона. Желтая пунктирная линия на рисунке 3 представляет этот компонент проекции, показывая величину загрязнения в 15 единиц вдоль направления фона. Фиолетовая пунктирная стрелка демонстрирует операцию вычитания, которая дает скорректированную зеленую стрелку C ′ = (a = 4, b = 8). Эта скорректированная хроматическая составляющая демонстрирует существенно уменьшенную желтую составляющую (от b = 28 до b = 8), сохраняя при этом исходный красно-зеленый баланс (a остается близким к своему исходному значению). Операция выполняет именно то, что, по мнению визуального осмотра, необходимо: она удаляет только цветовую составляющую, параллельную направлению фона, сохраняя при этом перпендикулярные компоненты, кодирующие присущую объекту окраску.

Важно отметить, что эта коррекция происходит исключительно в хроматическом измерении, в то время как канал L остается неизменным на протяжении всей операции. Сохранение яркости поддерживает структуру краев, которую зрители воспринимают как естественные границы между элементами переднего и заднего плана. Преобразование скорректированных значений Lab обратно в пространство RGB дает окончательный цвет пикселя, который чисто интегрируется с новым фоном без видимых артефактов смешения.

5. Интенсивность адаптивной коррекции на основе метрики цветового расстояния.

Простое удаление всего фонового цвета с краев чревато чрезмерной коррекцией: края могут стать искусственно серыми или ненасыщенными, теряя естественную теплоту. Чтобы предотвратить это, я реализовал адаптивную модуляцию интенсивности, основанную на степени загрязнения каждого пикселя, используя метрику цветового расстояния ΔE :

[Delta E = sqrt{(Delta L)^2 + (Delta a)^2 + (Delta b)^2}]

где ΔE ниже 1 означает незаметность, а значения выше 5 указывают на четко различимые цвета. Пиксели с ΔE ниже 18 относительно фона классифицируются как загрязненные кандидаты для коррекции.

Интенсивность коррекции обратно пропорциональна интенсивности: пиксели, расположенные очень близко к фоновому цвету, получают сильную коррекцию, а удаленные пиксели — щадящую.

[S = 0.85 times maxleft(0, 1 – frac{Delta E}{18}right)]

Эта формула обеспечивает плавное снижение прочности до нуля по мере приближения ΔE к пороговому значению, избегая резких разрывов.

На рисунке 4 это иллюстрируется увеличенным сравнением краев волос на разных фонах. На левой панели показано исходное изображение с видимым желтым загрязнением вдоль границы волос. На средней панели показано, как стандартное смешивание RGB сохраняет желтоватый ободок, который сразу выдает искусственность композиции. На правой панели показана коррекция на основе Lab, устраняющая цветовые искажения при сохранении естественной текстуры волос; теперь край чисто сливается с синим фоном, точно воздействуя на загрязнение на границе маски, не затрагивая при этом естественный цвет объекта.

6. Специальная обработка для сохранения контурных линий в мультфильмах.

Изображения в стиле мультфильмов и линейной графики представляют собой уникальные проблемы для универсальных моделей сегментации, обученных на фотографических данных. В отличие от естественных фотографий с плавными переходами, персонажи мультфильмов отличаются четкими черными контурами и плоской заливкой цветом. Стандартная сегментация с использованием глубокого обучения часто ошибочно классифицирует черные контуры как фон, при этом недостаточно покрывая области сплошной заливки, создавая видимые пробелы в композициях.

Я разработал автоматизированный конвейер обнаружения, который активируется, когда система идентифицирует характеристики линейной графики по трем признакам: плотность краев (коэффициент Кэнни для пикселей на краях), простота цвета (уникальные цвета относительно площади) и преобладание темных пикселей (яркость ниже 50). При достижении этих пороговых значений запускаются специализированные процедуры улучшения.

На рисунке 5 ниже показан процесс улучшения изображения в четыре этапа. На первом изображении показана оригинальная мультяшная собака с характерными черными контурами и однотонными цветами. На втором изображении показана улучшенная маска; обратите внимание на полностью белый силуэт, охватывающий всего персонажа. На третьем изображении показано обнаружение границ методом Кэнни, определяющее четкие контуры. На четвертом изображении выделены темные области (яркость < 50), которые обозначают черные линии, определяющие форму персонажа.

Процесс улучшения, показанный на рисунке выше, работает в два этапа. Во-первых, защита черной обводки сканирует темные пиксели (яркость < 80), слегка расширяет их и устанавливает альфа-канал маски равным 255 (полная непрозрачность), гарантируя, что черные линии никогда не будут потеряны. Во-вторых, внутреннее улучшение заливки определяет области с высокой степенью достоверности (альфа > 160), применяет морфологическое замыкание для соединения разделенных частей, а затем повышает альфа-канал пикселей средней степени достоверности в этой зоне до минимального значения 220, устраняя пробелы в областях с однородным цветом.

Этот специализированный метод обработки позволил сохранить покрытие маски для персонажей аниме, иллюстраций комиксов и линейных рисунков на этапе разработки. Без него стандартные модели создают маски, технически корректные для фотографий, но не сохраняют четкие контуры и сплошную заливку, которые определяют мультяшные изображения.

Заключение: Инженерные решения важнее выбора модели.

Создание этой системы замены фона укрепило ключевой принцип: высококачественные приложения ИИ требуют продуманной координации множества методов, а не опоры на одну «лучшую» модель. Трехуровневая стратегия генерации масок обеспечивает устойчивость к различным входным данным, операции в цветовом пространстве Lab устраняют артефакты восприятия, которые неизбежно возникают при смешивании RGB, а улучшения, специфичные для мультфильмов, сохраняют художественную целостность для нефотографического контента. В совокупности эти проектные решения создают систему, которая обрабатывает реальное разнообразие, сохраняя при этом прозрачность в отношении того, как применяются коррекции — что крайне важно для разработчиков, интегрирующих ИИ в свои приложения.

В результате этой работы вырисовывается несколько направлений для дальнейшего совершенствования. Внедрение управляемой фильтрации в качестве стандартной постобработки могло бы дополнительно сгладить края маски, сохраняя при этом структурные границы. Эвристические алгоритмы обнаружения мультяшных изображений в настоящее время используют фиксированные пороговые значения, но могли бы выиграть от использования облегченного классификатора, обученного на размеченных примерах. Адаптивное подавление засветки в настоящее время использует линейное затухание, но плавные ступенчатые или двойные плавные ступенчатые кривые могли бы обеспечить более естественные переходы. Наконец, расширение системы для обработки видеовхода потребует механизмов временной согласованности для предотвращения мерцания между кадрами.

Ссылки на проект:

- Живая демонстрация: VividFlow на HuggingFace Spaces

- Исходный код: репозиторий GitHub

Благодарности:

Данная работа основана на вкладе в разработку открытых проектов BiRefNet, U²-Net, Stable Diffusion XL и OpenCLIP. Особая благодарность команде HuggingFace за предоставление инфраструктуры ZeroGPU, которая позволила осуществить это развертывание.

Источник: towardsdatascience.com