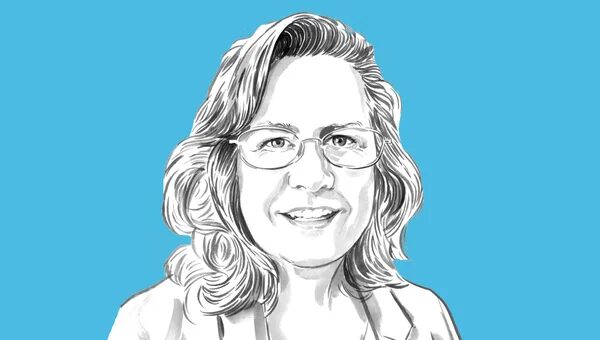

Трансдисциплинарная художница Стефани Динкинс (Stephanie Dinkins) призывает нас переосмыслить то, чем мы кормим наши машины, и задается вопросом, каким мог бы стать искусственный интеллект, если бы его обучили осторожности.

Двенадцать лет назад Стефани Динкинс отправилась в Вермонт, чтобы познакомиться с роботом. Bina48, бюст гуманоида с темной кожей, был создан для того, чтобы вести беседы о памяти, идентичности и сознании. Динкинс, фотограф по образованию, хотела понять, как чернокожая женщина стала моделью для одного из самых продвинутых социальных роботов в мире и может ли она подружиться с ним.

То, что она обнаружила во время этой встречи, положило начало десятилетию работы, которая сделала Динкинс одним из самых влиятельных художников, исследующих искусственный интеллект.

Динкинс вырос в Тоттенвилле, анклаве чернокожих семей, на южной оконечности Стейтен-Айленда. Ее бабушка ухаживала за цветочным садом с такой тщательностью, что даже соседи неохотно приходили полюбоваться им, а затем оставались поговорить. Динкинс описала это как свой первый урок искусства как социальной практики — использование красоты для создания сообщества.

О поддержке научной журналистики

Если вам понравилась эта статья, подумайте о том, чтобы поддержать нашу журналистику, отмеченную наградами, подписавшись на нее. Приобретая подписку, вы помогаете обеспечить будущее впечатляющих историй об открытиях и идеях, формирующих наш современный мир.

Сегодня она задает простой, но революционный вопрос: какими могли бы стать наши машины, если бы их обучали такому же уровню заботы и человеческого опыта? Она бросает вызов способам, которыми часто используется искусственный интеллект, показывая, что данные могут быть интимными, укоренившимися в культуре и глубоко живыми. С помощью художественных инсталляций, выставленных на всеобщее обозрение в таких местах, как здание Смитсоновского института искусств и индустрии искусств в Вашингтоне, округ Колумбия, и Музей Квинса в Нью-Йорке, она призывает людей задуматься о технологиях, власти и ответственности.

Scientific American поговорил с Динкинсом о насилии, скрытом в наборах данных, и о том, почему сообщества должны предоставлять свои истории ИИ, чтобы он мог понять их на своих собственных условиях.

[Ниже приводится отредактированная стенограмма интервью.]

Вы описали свою первую встречу с роботом Bina48 как поворотный момент в вашей карьере. Что вы ожидали найти и что произошло на самом деле?

Я подумал, что если я смогу подружиться с роботом, он сможет рассказать мне о том, где, по его мнению, находится место между людьми и технологиями. Но когда я поговорила с Bina48, стало очевидно, что некоторые из ее ответов казались плоскими по сравнению с ее репрезентативной личностью. Если я спрашивала ее о расе, у нее не было самых глубоких ответов или самых тонких нюансов, как у чернокожей женщины, и это пугало меня. Если эти люди, у которых действительно благие намерения, создают что-то, что кажется банальным, то что же происходит, когда людей даже не волнуют эти вопросы?

Как осознание этого повлияло на вашу работу?

Это повлияло на все. Здесь, в Нью-Йорке, я жил в районе, где преобладали черные и коричневые люди. Мне было интересно, знаем ли мы, что произойдет, думают ли люди о том, что системы будут делать в их мире. В то время ProPublica опубликовала статью о судьях и вынесении приговоров с точки зрения искусственного интеллекта и о том, как они будут использовать программное обеспечение для вынесения приговоров, чтобы определить, как долго кто-то пробудет в тюрьме. И это было основано на предвзятых данных, исторически предвзятых данных исторически предвзятой системы, судебной системы, которую я приравниваю к «черному налогу». Мы должны найти способы бороться с этим, потому что вы автоматически получаете больше времени, просто будучи черным, теперь, потому что так сказала машина.

Я создал проект под названием Не единственный, который основан на моей семье. Все началось с мемуаров — я действительно пытался передать знания от моей бабушки, чтобы у двух поколений, даже более отдаленных от нее, сохранились какие-то черты ее характера. Это проект по устной истории, в рамках которого мы записали интервью с тремя женщинами из моей семьи, а затем я была вынуждена найти основополагающие данные для его подтверждения. Было трудно найти базовые данные, в которых не чувствовалось бы насилия или любви, достаточной для того, чтобы поставить мою семью на первое место.

Как вы определили насилие в наборе данных и как вы с этим справились?

Когда я думаю о насилии в данных, я на самом деле думаю о языковом насилии, своего рода навешивании ярлыков или стереотипизации, которые происходят в нашей популярной среде. средства массовой информации. Если мы думаем о наборе данных, основанном на фильмах, то количество ролей, которые чернокожие люди могли играть в фильмах, было ограничено: подчинение, друг — всегда поддерживающий друг, но не главный герой — отведение второстепенного персонажа вместо того, чтобы быть звездой в одном из нихего собственная жизнь. Я думаю, что неспособность вжиться в эти роли — своего рода насилие. Итак, передо мной стояла задача создать базовый набор языковых средств, который, как я чувствовал, действительно помог бы моей семье, а не разрушил бы ее.

В конце концов я решил создать свой собственный набор данных. И не единственный, который был основан на наборе данных, состоящем из 40 000 строк дополнительных данных, помимо устных рассказов, которые очень малы, поэтому фрагмент очень шаткий. Иногда это дает правильные ответы, а иногда приводит к полной непоследовательности. Я предпочитаю это, чем просто возводить историю моей семьи в ранг исторической жестокости.

Как этот проект повлиял на ваши последующие проекты?

Что это заставило меня задуматься о ценности небольших данных, ориентированных на сообщество. Мы, люди, всегда рассказывали истории, чтобы сориентироваться, рассказать себе, в чем заключаются ценности. Итак, что бы произошло, если бы мы предоставили — и я действительно думаю о том, чтобы подарить — миру искусственного интеллекта часть этой информации, чтобы он лучше узнал нас изнутри? Я создал приложение под названием «Истории, которые мы рассказываем нашим машинам», чтобы позволить людям делать именно это.

В данный момент я пытаюсь убедить людей в том, что это хорошая идея потому что все, что мы слышим в мире, это «Нет, они забирают наши данные». Нас «эксплуатируют», что мы и делаем. Но мы также знаем, что если мы не будем развивать эти системы, чтобы они лучше нас знали, они, скорее всего, будут использовать определения, которые не исходили от определяемых сообществ. На самом деле задача заключается в следующем: как бы это выглядело, если бы используемые данные имитировали численность населения планеты?

Следующий шаг — взять эти данные и начать создавать набор данных, который можно широко распространять, чтобы помочь в точной настройке или обучении других систем. Я начинаю разговор с компьютерщиками о том, как мы можем сделать это таким образом, чтобы не обесценивать истории, а сделать их широко применимыми.

Можете ли вы привести пример о том, как искусственный интеллект может предложить возможности людям, которые исторически были обездолены?

Я жду, когда ребенок из малообеспеченных семей с небольшими деньгами снимет какой-нибудь захватывающий фильм с использованием компьютера и инструментов искусственного интеллекта, который будет конкурировать с голливудским кино. Я думаю, что это возможно.

Версия этой статьи появилась в мартовском выпуске журнала Scientific American за 2026 год под редакцией Стефани Динкинс.»