Новый вид исследования гиперпараметров

Делиться

Введение

С момента своего появления в период 2017-2019 годов нейронные сети, учитывающие физические принципы (PINN), стали очень популярной областью исследований в сообществе научного машинного обучения (SciML) [1,2]. PINN используются для решения обыкновенных и частных дифференциальных уравнений (ЧДУ) путем представления неизвестного поля решений с помощью нейронной сети и нахождения весов и смещений (параметров) сети путем минимизации функции потерь, основанной на управляющем дифференциальном уравнении. Например, оригинальный подход PINN штрафует сумму поточечных ошибок управляющего ЧДУ, тогда как метод Deep Ritz минимизирует функционал «энергии», минимум которого обеспечивает управляющее уравнение [3]. Другой альтернативой является дискретизация решения с помощью нейронной сети, а затем построение слабой формы управляющего уравнения с использованием состязательных сетей [4] или полиномиальных тестовых функций [5,6]. Независимо от выбора функции потерь, дискретизация нейронных сетей успешно использовалась для анализа ряда систем, управляемых ЧДУ. От уравнений Навье-Стокса [7] до сопряженного теплообмена [8] и упругости [9], PINN и их варианты доказали свою ценность как инструментарий вычислительного ученого.

Как и в случае со всеми задачами машинного обучения, важным компонентом получения надежных и точных решений с помощью PINN является настройка гиперпараметров. Аналитик имеет большую свободу в построении метода решения — как обсуждалось выше, выбор функции потерь физического поля не является уникальным, как и выбор оптимизатора, метода обеспечения граничных условий или архитектуры нейронной сети. Например, хотя ADAM исторически был основным оптимизатором для задач машинного обучения, наблюдается всплеск интереса к методам Ньютона второго порядка для задач, учитывающих физические принципы [10,11]. В других исследованиях сравнивались методы обеспечения граничных условий на дискретизации нейронной сети [12]. Лучшие практики для архитектуры PINN в основном исследовались посредством выбора функций активации. Для борьбы со спектральной предвзятостью нейронных сетей [13] использовались синусоидальные функции активации для лучшего представления высокочастотных полей решений [14,15]. В [16] был проведен сравнительный анализ ряда стандартных функций активации на задачах сжимаемого потока жидкости. В [17] было показано, что функции активации с частично обучаемыми признаками повышают точность решения. Хотя большинство PINN основаны на многослойных перцептронных сетях (MLP), сверточные сети были исследованы в [18], а рекуррентные сети — в [19].

Приведенные выше исследования далеко не исчерпывающий список работ, посвященных выбору гиперпараметров для обучения с учетом физических принципов. Однако эти исследования показывают, что функция потерь, оптимизатор, функция активации и базовый класс архитектуры сети (MLP, сверточная, рекуррентная и т. д.) получили внимание в литературе как интересные и важные компоненты структуры решения PINN. Один из гиперпараметров, которому уделялось сравнительно мало внимания, — это размер нейронной сети, дискретизирующей поле решений. Другими словами, насколько нам известно, нет опубликованных работ, в которых задавался бы следующий вопрос: из скольких параметров должна состоять сеть, учитывающая физические принципы? Хотя этот вопрос в некотором смысле очевиден, отсутствие интереса к нему со стороны сообщества неудивительно — за избыточно параметризованную сеть не приходится платить снижением точности решения. На самом деле, избыточно параметризованные сети могут обеспечить полезную регуляризацию поля решений, как это видно на примере явления двойного спуска [20]. Кроме того, в контексте задач классификации, основанных на данных, было показано, что сети с избыточной параметризацией приводят к более плавным ландшафтам функции потерь [21]. Поскольку точность решения не стимулирует уменьшение размера сети, и поскольку задача оптимизации может фактически способствовать избыточной параметризации, многие авторы используют очень большие сети для представления решений ДУЧП.

Хотя точность решения повышается только за счет увеличения количества параметров, вычислительные затраты на решение масштабируются пропорционально размеру сети. В этом исследовании мы рассматриваем три примера из литературы по PINN и показываем, что сети с на порядки меньшим количеством параметров способны удовлетворительно воспроизводить результаты более крупных сетей. Из этих трех примеров следует вывод, что в случае низкочастотных полей решений небольшие сети могут получать точные решения с меньшими вычислительными затратами. Затем мы приводим контрпример, где регрессия к сложной осциллирующей функции постоянно выигрывает от увеличения размера сети. Таким образом, наше предложение заключается в следующем: количество параметров в PINN должно быть как можно меньше, но не меньше.

Примеры

Первые три примера вдохновлены задачами из литературы по перцептронным сетям (PINN). В этих работах для получения решения дифференциального уравнения в частных производных используются большие сети, где размер сети измеряется количеством параметров. Хотя разные архитектуры сетей могут показывать разные результаты при разном количестве параметров, мы используем этот показатель в качестве аппроксимации сложности сети, независимо от архитектуры. В наших примерах мы постепенно уменьшаем количество параметров многослойного перцептрона до тех пор, пока ошибка по сравнению с эталонным решением не начнет возрастать. Эта точка представляет собой нижний предел размера сети для конкретной задачи, и мы сравниваем количество параметров в этой точке с количеством параметров, использованных в оригинальной статье. В каждом случае мы обнаруживаем, что сети из литературы перепараметризованы как минимум на порядок. В четвертом примере мы решаем задачу регрессии, чтобы показать, как малые сети могут не представлять осциллирующие поля, что служит предостережением относительно наших результатов.

Фазовый полевой перелом

Фазово-полевая модель разрушения представляет собой вариационный подход к механике разрушения, который одновременно находит поля смещения и повреждения путем минимизации соответствующим образом определенного энергетического функционала [22]. Наше исследование основано на одномерной примерной задаче, приведенной в [23], в которой используется метод Дипа Ритца для определения полей смещения и повреждения, которые минимизируют энергетический функционал разрушения. Этот энергетический функционал задается следующим образом:

[PiBig(u(x),alpha(x)Big) = Pi^u + Pi^{alpha}=int_0^1 frac{1}{2}(1-alpha)^2 Big(frac{partial u}{partial x}Big)^2 + frac{3}{8}Big( alpha + ell^2 Big(frac{partial alpha}{partial x}Big)^2 Big) dx,]

где ( x ) — пространственная координата, ( u(x) ) — смещение, ( alpha(x)in[0,1] ) — плотность трещин, а ( ell ) — масштаб длины, определяющий ширину сглаженных трещин. Функционал энергии включает две компоненты ( Pi^u ) и ( Pi^{alpha} ), которые представляют собой упругую энергию и энергию разрушения соответственно. Как и в цитируемой работе, мы принимаем (ell=0,05). Поле смещения и фазовое поле дискретизируются с помощью одной нейронной сети ( N: mathbb R rightarrow mathbb R^2 ) с параметрами (boldsymbol theta). Задача определяется приложенным растягивающим смещением на правом конце, которое мы обозначаем ( U ). Граничные условия заложены в два поля с

[ begin{bmatrix}

u(x ; boldsymbol theta) \ alpha (x; boldsymbol theta)

begin{bmatrix} = begin{bmatrix} x(1-x) N_1(x;boldsymbol theta) + Ux \ x(1-x) N_2(x; boldsymbol theta)

end{bmatrix} ,]

где (N_i ) обозначает (i)-й выход сети, а граничные условия Дирихле на плотность трещин используются для подавления растрескивания на краях области. В [23] для представления двух полей решений используется сеть MLP с четырьмя скрытыми слоями и шириной 50. Если пренебречь смещением на последнем слое, это соответствует (7850) обучаемым параметрам. Во всех наших исследованиях мы используем сеть с двумя скрытыми слоями, функциями активации гиперболического тангенса и без смещения на выходном слое, поскольку, по нашему опыту, этих сетей достаточно для представления любого интересующего нас поля решений. Если оба скрытых слоя имеют ширину (M), общее количество параметров в этой сети составляет (M^2+5M). Когда (M=86), мы получаем (7826) обучаемых параметров. В отсутствие аналитического решения мы используем это в качестве эталонного решения для больших сетей, с которым сравниваются меньшие сети.

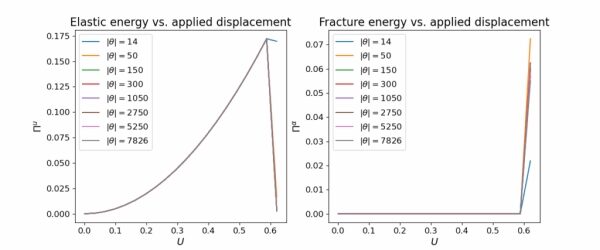

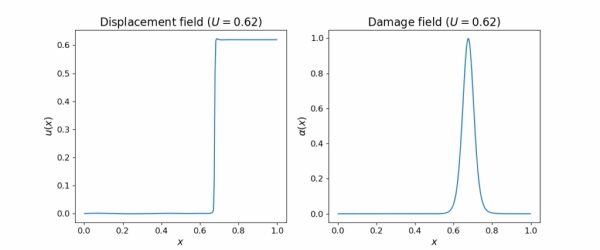

Для генерации полей решений мы минимизируем полную потенциальную энергию, используя оптимизацию ADAM с темпом обучения (1 times 10^{-3}). Полное разрушение стержня наблюдается при (U=0,6). Как и в статье, мы вычисляем упругую энергию и энергию разрушения в диапазоне приложенных смещений, при этом ADAM запускается в течение (3500) эпох на каждом шаге смещения для получения полей решений. Эти «кривые нагрузки» используются для сравнения производительности сетей разных размеров. Наш эксперимент проводится с (8) различными размерами сетей, каждая из которых включает (20) шагов приложенного смещения для построения кривых нагрузки. На рисунке 1 показаны кривые нагрузки, вычисленные для разных размеров сетей. Только когда (|boldsymbol theta|=14) параметров, что соответствует сети шириной (2), мы видим отклонение от кривых нагрузки эталонного решения для большой сети. Самая маленькая сеть, демонстрирующая хорошие результаты, имеет (50) параметров, что в (157раз) меньше, чем сеть, использованная в статье. Рисунок 2 подтверждает, что эта небольшая сеть способна аппроксимировать поле разрывных смещений, а также поле локализованных повреждений.

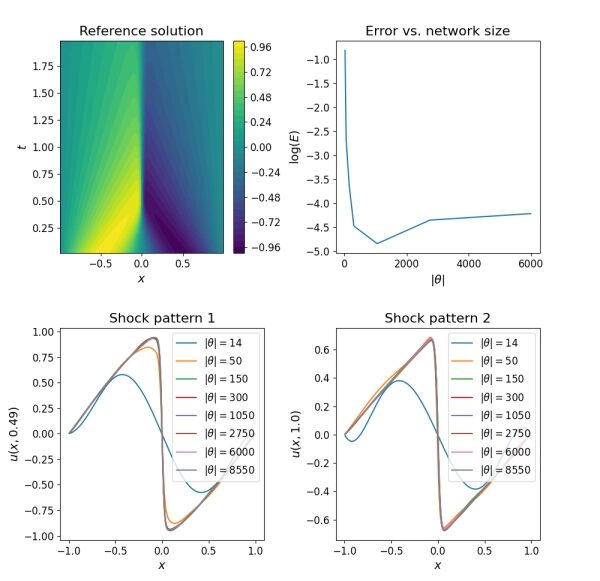

Уравнение Бюргерса

Теперь мы изучим влияние размера сети на распространенную модельную задачу из механики жидкости. Уравнение Бюргерса часто используется для проверки численных методов решения из-за его нелинейности и склонности к образованию резких пиков. Вязкое уравнение Бюргерса с однородными границами Дирихле задается следующим образом:

[frac{partial u}{partial t} + ufrac{partial u}{partial x} = nu frac{partial^2 u}{partial x^2}, quad u(x,0) = u_0(x), quad u(-1,t)=u(1,t) = 0,]

где (xin[-1,1]) — пространственная область, (tin[0,T]) — временная координата, (u(x,t)) — поле скоростей, (nu) — вязкость, и (u_0(x)) — начальный профиль скорости. В [24] для получения решения управляющего дифференциального уравнения используется дискретизация поля скоростей с помощью нейронной сети. Их сеть содержит (3) скрытых слоя с (64) нейронами в каждом слое, что соответствует (8576) обучаемым параметрам. Мы снова используем сеть с двумя скрытыми слоями, которая имеет (5M+M^2) обучаемых параметров, где (M) — ширина каждого слоя. Если мы возьмем (M=90), мы получим (8550) обучаемых параметров в нашей сети. Мы принимаем решение из этой сети за эталонное решение (u_{text{ref}}(x,t)) и вычисляем расхождение между полями скоростей из меньших сетей. Мы делаем это с помощью функции ошибок, заданной следующим образом:

[ E Big( u(x,t)Big)= frac{int_{Omega}| u(x,t) – u_{text{ref}}(x,t)| dOmega}{int_{Omega}| u_{text{ref}}(x,t)| dOmega},]

где (Omega = [-1,1] times [0,T]) — вычислительная область. Для решения уравнения Бюргерса мы используем стандартный подход PINN и минимизируем квадратичную ошибку управляющего уравнения:

[ underset{boldsymbol theta}{text{argmin }} L(boldsymbol theta), quad L(boldsymbol theta) = frac{1}{2} int_{Omega} Big(frac{partial u}{partial t} + ufrac{partial u}{partial x} – nu frac{partial^2 u}{partial x^2}Big)^2 dOmega.]

Поле скоростей дискретизируется с помощью сети MLP (N (x,t;boldsymbol theta)), а граничные и начальные условия задаются с помощью подхода типа функции расстояния [25]:

[ u(x,t;boldsymbol theta) = (1+x)(1-x)Big(t N(x,t; boldsymbol theta) + u_0(x)(1-t/T)Big). ]

В этой задаче мы принимаем вязкость равной (nu=0.01), а конечное время — (T=2). Начальное условие задается формулой (u_0(x) = – sin(pi x)), что приводит к хорошо известной картине ударных волн при (x=0). Мы запускаем оптимизацию ADAM в течение (1,5 times 10^{4}) эпох с темпом обучения (1,5 times 10^{-3}), чтобы решить задачу оптимизации для каждого размера сети. Проходя по (8) размерам сети, мы снова ищем количество параметров, при котором решение отклоняется от эталонного решения. Обратите внимание, что мы проверяем наше эталонное решение с помощью спектрального решателя, чтобы убедиться в точности нашей реализации. Результаты представлены на рисунке 3. Все сети с (|boldsymbol theta|geq 150) параметрами показывают приблизительно одинаковую производительность. Таким образом, исходная сеть перепараметризована в 57 раз.

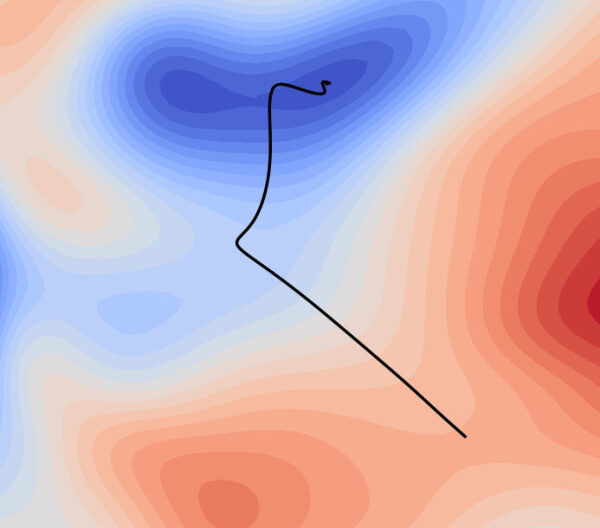

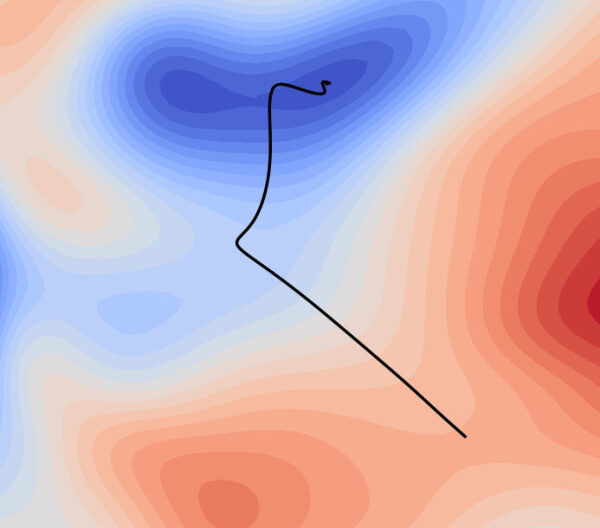

Неохуковская гиперупругость

В этом примере мы рассматриваем нелинейно-упругую деформацию куба при заданном перемещении. Плотность энергии деформации трехмерного гиперупругого твердого тела определяется сжимаемой моделью Неохука [26] как

[PsiBig( mathbf{u}(mathbf{X}) Big) = frac{ell_1}{2}Big( I_1 – 3 Big) – ell_1 ln J + frac{ell_2}{2} Big( ln J Big)^2 ,]

где (ell_1) и (ell_2) — свойства материала, которые мы принимаем за константы. Энергия деформации определяется следующими формулами:

[ mathbf{F} = mathbf{I} + frac{partial mathbf{u}}{partial mathbf{X}}, \

I_1 = mathbf{F} : mathbf{F}, \

J = det(mathbf{F}),]

где (mathbf{u}) — поле смещения, (mathbf{X}) — положение в исходной конфигурации, а (mathbf F) — тензор градиента деформации. Поле смещения получается путем минимизации полной потенциальной энергии, заданной формулой

[ PiBig( mathbf{u}(mathbf{X}) Big) = int_{Omega} PsiBig( mathbf{u}(mathbf{X}) Big) – mathbf{b} cdot mathbf{u} dOmega – int_{partial Omega} mathbf{t} cdot mathbf{u} dS,]

где (Omega) — недеформированная конфигурация тела, (mathbf{b}) — объемная сила, а (mathbf{t}) — приложенное поверхностное натяжение. Наше исследование размера сети вдохновлено работой [27], в которой метод Дипа Ритца используется для получения минимума функционала полной потенциальной энергии гиперупругости. Однако мы выбираем модель энергии деформации Неохука, в отличие от модели Лопеса-Памиеса, которую они используют. Как и в цитируемой работе, мы принимаем недеформированную конфигурацию за единичный куб (Omega=[0,1]^3) и подвергаем куб одноосному деформированному состоянию. Для обеспечения этого деформированного состояния мы прикладываем смещение (U) в направлении (X_3) на верхнюю поверхность куба. На нижней поверхности установлены роликовые опоры, которые обнуляют только компоненту смещения (X_3). Все остальные поверхности свободны от сил натяжения, что слабо обеспечивается выбранным функционалом энергии. Граничные условия удовлетворяются автоматически путем дискретизации смещения следующим образом:

[ begin{bmatrix}

u_1(mathbf{X}; boldsymbol theta) \

u_2(mathbf{X}; boldsymbol theta) \

u_3(mathbf{X}; boldsymbol theta)

end{bmatrix} = begin{bmatrix}

X_3 N_1(mathbf{X}; boldsymbol theta)\

X_3 N_2(mathbf{X}; boldsymbol theta)\

sin(pi X_3) N_3(mathbf{X}; boldsymbol theta) + UX_3

end{bmatrix},]

где ( N_i) — это (i)-й компонент выходного сигнала сети. В цитируемой работе для дискретизации трех компонент поля смещения используется сеть с шестью скрытыми слоями шириной (40). Это соответствует (8480) обучаемым параметрам. Учитывая, что сеть представляет собой отображение ( N: mathbb R^3 rightarrow mathbb R^3), сеть с двумя скрытыми слоями шириной (M) имеет (8M+M^2) обучаемых параметров, когда на выходном слое не применяется смещение. Таким образом, если мы возьмем ( M=88 ), наша сеть будет иметь (8448) обучаемых параметров. Мы будем считать эту архитектуру сети эталонной для больших сетей.

В [27] была вычислена связь между нормальной компонентой первого тензора напряжений Пиолы-Кирхгофа (mathbf{P}) в направлении приложенного смещения и соответствующей компонентой градиента деформации (mathbf{F}) для проверки их реализации в Deep Ritz. Здесь мы изучаем связь между этим растягивающим напряжением и приложенным смещением (U). Первый тензор напряжений Пиолы-Кирхгофа получен с плотностью энергии деформации как

[ mathbf{P} = frac{ partial Psi}{partial mathbf{F}} = ell_1( mathbf{F} – mathbf{F}^{-T} ) + ell_2 mathbf{F}^{-T}log J.]

Учитывая геометрию единичного куба и одноосное напряженно-деформированное состояние, градиент деформации определяется следующим образом:

[ mathbf{F} = begin{bmatrix}

1 & 0 & 0 \ 0 & 1 & 0\ 0 & 0 & 1+U

end{bmatrix}.]

Используя эти два уравнения, мы вычисляем растягивающее напряжение (P_{33}) и энергию деформации как функцию приложенного смещения, которая равна

[ begin{aligned} P_{33} = ell_1Big( 1 + U – frac{1}{1+U}Big) + ell_2frac{log(1+U)}{1+U}, \ Pi = frac{ell_1}{2}(2+(1+U)^2-3) – ell_1 log(1+U) + frac{ell_2}{2}(log(1+U))^2. end{aligned}]

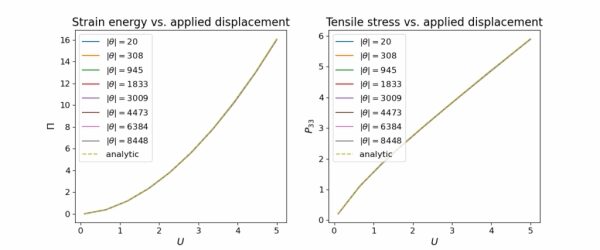

Эти аналитические решения можно использовать для проверки нашей реализации гиперупругой модели, а также для оценки производительности сетей различного размера. Используя модель нейронной сети, при каждом приложенном перемещении вычисляются растягивающее напряжение и энергия деформации с помощью следующих формул:

[ P_{33} = int_{Omega} ell_1( {mathbf{F}} – {mathbf{F}}^{-T} ) + ell_2 {mathbf{F}}^{-T}log J dOmega, quad Pi = int_{Omega} PsiBig( {mathbf{u}}(mathbf{X})Big) dOmega,]

где поле перемещений строится из параметров, полученных методом Дип Ритца. Для вычисления напряжения мы усредняем по всей области, предполагая постоянное напряженное состояние. В этом примере параметры материала установлены равными (ell_1=1) и (ell_2=0,25). Мы итерируем по (8) размерам сети и делаем (10) шагов нагрузки для каждого размера, чтобы получить напряжение и энергию деформации как функцию приложенного перемещения. Результаты показаны на рисунке 4. Все сети точно воспроизводят кривые энергии деформации и напряжения при нагрузке. Это включает даже сеть шириной (2), содержащую всего (20) обучаемых параметров. Таким образом, исходная сеть имеет (424раза) больше параметров, чем необходимо для представления результатов испытания на растяжение.

Контрпример

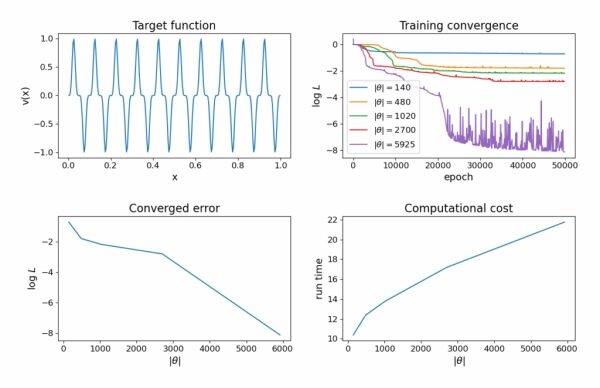

В четвертом и последнем примере мы решаем задачу регрессии, чтобы показать, что небольшие сети не могут аппроксимировать высокочастотные функции. Одномерная задача регрессии задается следующим образом:

[ underset{boldsymbol theta}{text{argmin }} L(boldsymbol theta), quad L(boldsymbol theta) = frac{1}{2}int_0^1Big( v(x) – N(x;boldsymbol theta) Big)^2 dx,]

где ( N) — многослойная перцептронная сеть с двумя скрытыми слоями, а (v(x)) — целевая функция. В этом примере мы берем (v(x)=sin^5(20pi x)). Мы итерируем по (5) различным размерам сети и сообщаем значение сходимости функции потерь (L) в качестве меры ошибки. Мы обучаем модель с использованием оптимизации ADAM в течение (5 times 10^4) эпох и со скоростью обучения (5 times 10^{-3}). Результаты представлены на рисунке 5. В отличие от предыдущих трех примеров, целевая функция достаточно сложна, поэтому для ее представления требуются большие сети. Сходящаяся ошибка монотонно уменьшается с увеличением количества параметров. Мы также измеряем время выполнения процедуры обучения для каждого размера сети и отмечаем зависимость времени выполнения (в секундах) от количества параметров. Этот пример иллюстрирует, что представление осциллирующих функций требует больших сетей, и что количество параметров увеличивает стоимость обучения.

Заключение

Хотя настройка гиперпараметров, управляющих функцией потерь, процессом оптимизации и функцией активации, является распространенной практикой в сообществе PINN, настройка размера сети встречается реже. На трех примерах задач из литературы мы показали, что очень маленьких сетей часто достаточно для представления решений дифференциальных уравнений в частных производных, даже при наличии разрывов и/или других локализованных особенностей. В таблице 1 приведено краткое изложение наших результатов о возможности использования малых сетей. Для подтверждения наших выводов мы затем представили случай регрессии к высокочастотной целевой функции, для точной подгонки которой требовалось большое количество параметров. Таким образом, наши выводы таковы: поля решений, которые не осциллируют, часто могут быть представлены малыми сетями, даже если они содержат локализованные особенности, такие как трещины и ударные волны. Поскольку стоимость обучения масштабируется с количеством параметров, меньшие сети могут ускорить обучение для задач, учитывающих физические принципы, с неосциллирующими полями решений. По нашему опыту, такие поля решений регулярно встречаются в практических задачах из области теплопроводности и статической механики твердых тел. Уменьшение размера сети позволяет решить эти и другие проблемы, предоставляя возможности для повышения вычислительной эффективности решений на основе PINN и, следовательно, повышения их конкурентоспособности по сравнению с традиционными подходами, такими как метод конечных элементов.

| Проблема | Избыточная параметризация |

| Разрыв фазового поля [23] | (157 times ) |

| Уравнение Бюргерса [24] | ( 57 times ) |

| Неохуковская гиперупругость [27] | ( 424 times ) |

Ссылки

[1] Джастин Сириньяно и Константинос Спилиопулос. DGM: алгоритм глубокого обучения для решения дифференциальных уравнений в частных производных. Журнал вычислительной физики, 375:1339–1364, декабрь 2018 г. arXiv:1708.07469 [q-fin].

[2] М. Раисси, П. Пердикарис и Г. Э. Карниадакис. Нейронные сети, основанные на физических принципах: структура глубокого обучения для решения прямых и обратных задач, включающих нелинейные дифференциальные уравнения в частных производных. Журнал вычислительной физики, 378:686–707, февраль 2019 г.

[3] Вэйнан Э. и Бин Ю. Метод глубокого Ритца: численный алгоритм на основе глубокого обучения для решения вариационных задач, сентябрь 2017 г. arXiv:1710.00211 [cs].

[4] Яохуа Чжан, Ган Бао, Сяоцзин Е и Хаомин Чжоу. Слабые состязательные сети для многомерных дифференциальных уравнений в частных производных. Журнал вычислительной физики, 411:109409, июнь 2020 г. arXiv:1907.08272 [math].

[5] Реза Ходайи-Мехр и Майкл М. Завланос. VarNet: Вариационные нейронные сети для решения дифференциальных уравнений в частных производных, декабрь 2019 г. arXiv:1912.07443 [cs].

[6] Е. Харазми, З. Чжан и Г. Э. Карниадакис. Вариационные нейронные сети, основанные на физических принципах, для решения дифференциальных уравнений в частных производных, ноябрь 2019 г. arXiv:1912.00873 [cs].

[7] Сяовэй Цзинь, Шэнцзе Цай, Хуэй Ли и Джордж Эм Карниадакис. NSFnets (сети потока Навье-Стокса): нейронные сети, основанные на физических принципах, для несжимаемых уравнений Навье-Стокса. Журнал вычислительной физики, 426:109951, февраль 2021 г.

[8] Шэнцзе Цай, Чжичэн Ван, Сифан Ван, Парис Пердикарис и Джордж Эм Карниадакис. Нейронные сети, основанные на физических принципах, для задач теплопередачи. Журнал теплопередачи, 143(060801), апрель 2021 г.

[9] Мин Лю, Чжицян Цай и Картик Рамани. Метод глубокого Ритца с адаптивной квадратурой для линейной упругости. Компьютерные методы в прикладной механике и инженерии, 415:116229, октябрь 2023 г.

[10] Сифан Ван, Ананйе Кумар Бхартари, Боуэн Ли и Парис Пердикарис. Выравнивание градиента в нейронных сетях, основанных на физических принципах: перспектива оптимизации второго порядка, сентябрь 2025 г. arXiv:2502.00604 [cs].

[11] Хорхе Ф. Урбан, Петрос Стефаноу и Хосе А. Понс. Раскрытие процесса оптимизации нейронных сетей, основанных на физических принципах: насколько точными и конкурентоспособными могут быть PINN? Журнал вычислительной физики, 523:113656, февраль 2025 г.

[12] Конор Роуэн, Кай Хэмплеман, Курт Мауте и Алиреза Дустан. Обеспечение соблюдения граничных условий с помощью PINN: сравнительное исследование и проверка на 3D-геометриях, декабрь 2025 г. arXiv:2512.14941[math].

[13] Насим Рахаман, Аристид Баратин, Деванш Арпит, Феликс Дракслер, Мин Лин, Фред А. Хампрехт, Йошуа Бенджио и Аарон Курвиль. О спектральном смещении нейронных сетей, май 2019 г. arXiv:1806.08734 [стат].

[14] Мирко Пеццоли, Фабио Антонакки и Аугусто Сарти. Неявное нейронное представление с помощью нейронных сетей, основанных на физических принципах, для реконструкции ранней части импульсных характеристик помещения. В сборнике трудов 10-й конференции Европейской ассоциации акустики Forum Acusticum 2023, страницы 2177–2184, январь 2024 г.

[15] Шагайег Фазлиани, Захари Франджелла и Мадлен Уделл. Улучшение нейронных сетей, основанных на физических принципах, посредством инженерии признаков, июнь 2025 г. arXiv:2502.07209 [cs].

[16] Дуонг В. Дунг, Нгуен Д. Сонг, Прамудита С. Палар и Лави Р. Зухал. О выборе функций активации в нейронной сети, основанной на физических принципах, для решения задач о несжимаемых потоках жидкости. В сборнике трудов форума AIAA SCITECH 2023. Американский институт аэронавтики и астронавтики. Электронная версия: https://arc.aiaa.org/doi/pdf/10.2514/6.2023-1803.

[17] Хунхуэй Ван, Лу Лу, Шицзи Сун и Гао Хуан. Изучение специализированных функций активации для нейронных сетей, основанных на физических принципах. Communications in Computational Physics, 34(4):869–906, июнь 2023 г. arXiv:2308.04073 [cs].

[18] Чжао Чжан, Ся Янь, Пиян Лю, Кай Чжан, Жэньминь Хань и Шэн Ван. Сверточная нейронная сеть, основанная на физических принципах, для моделирования и прогнозирования двухфазных потоков Дарси в гетерогенных пористых средах. Журнал вычислительной физики, 477:111919, март 2023 г.

[19] Пу Рен, Чэнпин Рао, Ян Лю, Цзяньсюнь Ван и Хао Сунь. PhyCRNet: Сверточно-рекуррентная сеть, учитывающая физические принципы, для решения пространственно-временных дифференциальных уравнений в частных производных. Компьютерные методы в прикладной механике и инженерии, 389:114399, февраль 2022 г. arXiv:2106.14103 [cs].

[20] Михаил Белкин, Даниэль Сюй, Сиюань Ма и Сумик Мандал. Согласование современной практики машинного обучения и классического компромисса между смещением и дисперсией. Труды Национальной академии наук, 116(32):15849–15854, август 2019 г. Издатель: Труды Национальной академии наук.

[21] Артур Жако, Франк Габриэль и Клемент Хонглер. Нейронное касательное ядро: сходимость и обобщение в нейронных сетях, февраль 2020 г. arXiv:1806.07572 [cs].

[22] Б. Бурден, Г.А. Франкфорт и Ж.Дж. Мариго. Численные эксперименты по пересмотренному хрупкому разрушению. Журнал механики и физики твердых тел, 48(4):797–826, апрель 2000 г.

[23] М. Манав, Р. Молинаро, С. Мишра и Л. Де Лоренцис. Фазово-полевое моделирование разрушения с помощью глубокого обучения, основанного на физических принципах. Компьютерные методы в прикладной механике и инженерии, 429:117104, сентябрь 2024 г.

[24] Сяньке Ван, Шичао И, Хуанлян Гу, Цзин Сюй и Вэньцзе Сюй. WF-PINNs: решение прямых и обратных задач уравнения Бюргерса с крутыми градиентами с использованием нейронных сетей слабой формы, основанных на физических принципах. Научные отчеты, 15(1):40555, ноябрь 2025 г. Издатель: Nature Publishing Group.

[25] Н. Сукумар и Анкит Шривастава. Точное наложение граничных условий с помощью функций расстояния в глубокой нейронной сети, основанной на физических принципах. Компьютерные методы в прикладной механике и инженерии, 389:114333, февраль 2022 г.

[26] Хавьер Бонет и Ричард Д. Вуд. Нелинейная механика континуума для анализа методом конечных элементов. Издательство Кембриджского университета, Кембридж, 2-е издание, 2008.

[27] Диаб В. Абуэйдда, Сейд Корич, Рашид Абу Аль-Руб, Кори М. Парротт, Кай А. Джеймс и Нахил А. Собх. Метод глубокого обучения для расчета энергии гиперупругости и вязкоупругости. Европейский журнал механики – A/Solids, 95:104639, сентябрь 2022 г. arXiv:2201.08690 [cs].

Источник: towardsdatascience.com