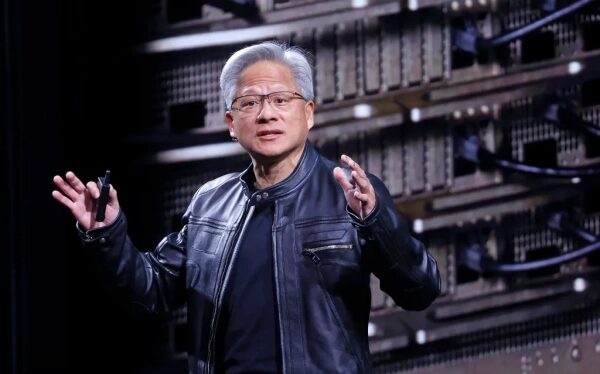

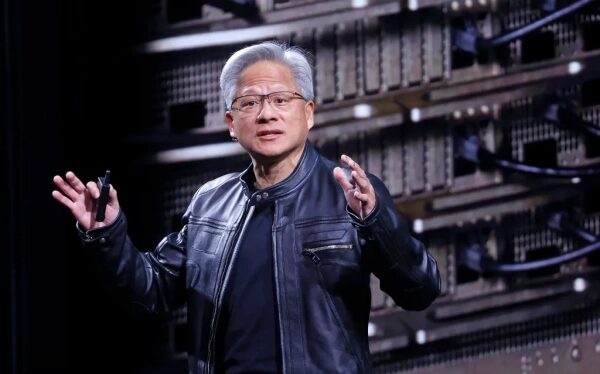

Сегодня на выставке CES генеральный директор Nvidia Дженсен Хуанг официально представил новую вычислительную архитектуру Rubin, которую он назвал передовой в области аппаратного обеспечения для искусственного интеллекта. Новая архитектура в настоящее время находится в производстве, и ожидается, что ее выпуск будет продолжен во второй половине года.

«Vera Rubin разработана для решения этой фундаментальной проблемы: объем вычислительных ресурсов, необходимых для ИИ, стремительно растет», — сказал Хуанг аудитории. «Сегодня я могу сказать вам, что Vera Rubin находится в стадии полномасштабного производства».

Архитектура Rubin, впервые анонсированная в 2024 году, является последним результатом неустанного цикла разработки аппаратного обеспечения Nvidia, который превратил компанию в самую дорогую корпорацию в мире. Архитектура Rubin заменит архитектуру Blackwell, которая, в свою очередь, заменила архитектуры Hopper и Lovelace.

Чипы Rubin уже запланированы к использованию практически всеми крупными поставщиками облачных услуг, включая громкие партнерские соглашения Nvidia с Anthropic, OpenAI и Amazon Web Services. Системы Rubin также будут использоваться в суперкомпьютере HPE Blue Lion и в готовящемся к запуску суперкомпьютере Doudna в Национальной лаборатории имени Лоуренса в Беркли.

Архитектура Rubin, названная в честь астронома Веры Флоренс Купер Рубин, состоит из шести отдельных чипов, предназначенных для совместного использования. В центре архитектуры находится графический процессор Rubin, но она также решает растущие проблемы с хранением данных и межсоединениями благодаря новым улучшениям в системах Bluefield и NVLink соответственно. Архитектура также включает в себя новый центральный процессор Vera, разработанный для агентного мышления.

Объясняя преимущества нового хранилища, старший директор Nvidia по решениям для инфраструктуры ИИ Дион Харрис указал на растущие потребности современных систем ИИ в памяти, связанной с кэшированием.

«Когда вы начинаете внедрять новые типы рабочих процессов, такие как агентный ИИ или долгосрочные задачи, это создает большую нагрузку и предъявляет высокие требования к вашему кэшу ключ-значение», — сказал Харрис журналистам во время телефонного разговора, имея в виду систему памяти, используемую моделями ИИ для сжатия входных данных. «Поэтому мы ввели новый уровень хранения, который подключается к вычислительному устройству извне, что позволяет гораздо эффективнее масштабировать ваш пул хранения».

Как и ожидалось, новая архитектура также представляет собой значительный шаг вперед в скорости и энергоэффективности. Согласно тестам Nvidia, архитектура Rubin будет работать в три с половиной раза быстрее, чем предыдущая архитектура Blackwell, в задачах обучения моделей и в пять раз быстрее в задачах вывода, достигая производительности до 50 петафлопс. Новая платформа также обеспечит в восемь раз большую вычислительную мощность на ватт при выполнении задач вывода.

Новые возможности компании Rubin появились на фоне ожесточенной конкуренции за создание инфраструктуры искусственного интеллекта, в результате которой как лаборатории ИИ, так и облачные провайдеры борются за чипы Nvidia, а также за необходимые для их работы ресурсы. В ходе телефонной конференции по итогам финансового года в октябре 2025 года Хуанг оценил, что в течение следующих пяти лет на инфраструктуру ИИ будет потрачено от 3 до 4 триллионов долларов.

Следите за всеми материалами TechCrunch о ежегодной конференции CES здесь.

Посмотрите, как генеральный директор Nvidia Дженсен Хуанг представляет то, что он назвал передовой технологией в области аппаратного обеспечения для искусственного интеллекта: новую вычислительную архитектуру Rubin.

«Vera Rubin разработана для решения этой фундаментальной проблемы: объем вычислительных ресурсов, необходимых для ИИ, стремительно растет». Хуанг… pic.twitter.com/MhGVqytX04

— TechCrunch (@TechCrunch) 5 января 2026 г.

Источник: techcrunch.com