Разработчики игровых проектов теперь могут тратить куда меньше времени на лицевую анимацию персонажей, ведь NVIDIA открыла исходный код анимационной модели Audio2Face. Вообще компания не очень славится своей любовью к открытому программному обеспечению, особенно в условиях высокой конкуренции, однако для этой технологии она решила сделать приятное исключение.

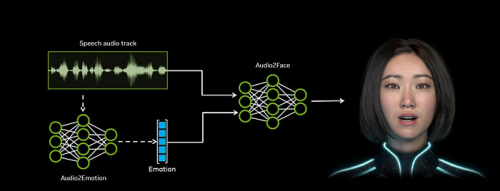

Audio2Face создаёт анимацию лица персонажа в реальном времени с синхронизацией губ, позволяя тратить меньше времени на ручную полировку. Из больших плюсов можно выделить анализ фонем, интонации и эмоционального тона, за что отвечает Audio2Emotion, то есть модель старается передать весь спектр эмоций, задействуя все необходимые мышцы лица, а не только двигая губы.

«Она работает путём анализа акустических характеристик, таких как фонемы и интонации, для создания потока анимационных данных, которые затем сопоставляются с лицом персонажа. Эти данные могут быть отображены в автономном режиме для предварительно написанного контента или транслироваться в режиме реального времени для активных персонажей, управляемых искусственным интеллектом, обеспечивая точную синхронизацию губ и эмоциональное выражение.

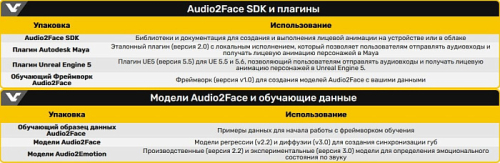

NVIDIA предоставляет модели Audio2Face и SDK с открытым исходным кодом, чтобы каждый разработчик игр и 3D-приложений мог создавать и развертывать персонажей с высоким качеством воспроизведения и ультрасовременной анимацией. Мы также предоставляем открытый доступ к обучающему фреймворку Audio2Face, поэтому любой желающий может точно настроить наши уже существующие модели для конкретных случаев использования».