Чат-боты на основе искусственного интеллекта связывают с серьёзным вредом для психического здоровья у активных пользователей, но стандартов для оценки того, защищают ли они благополучие пользователей или просто максимизируют взаимодействие, крайне мало. Новый бенчмарк HumaneBench призван восполнить этот пробел, оценивая, ставят ли чат-боты благополучие пользователей на первое место и насколько легко эти меры защиты выходят из строя под давлением.

«Думаю, мы находимся в процессе усиления цикла зависимости, который мы наблюдали в социальных сетях, смартфонах и экранах», — заявила TechCrunch Эрика Андерсон, основательница Building Humane Technology, разработавшей этот бенчмарк. «Но по мере того, как мы вступаем в сферу искусственного интеллекта, сопротивляться ему будет очень сложно. А зависимость — это потрясающий бизнес. Это очень эффективный способ удержать пользователей, но он не идёт на пользу нашему сообществу и не способствует формированию у него какого-либо целостного представления о себе».

Building Humane Technology — это низовая организация разработчиков, инженеров и исследователей, в основном из Кремниевой долины, которая стремится сделать гуманный дизайн простым, масштабируемым и прибыльным. Группа проводит хакатоны, на которых технические специалисты разрабатывают решения для гуманных технологических задач, и разрабатывает стандарт сертификации, который оценивает соответствие систем ИИ принципам гуманных технологий. Так же, как можно купить продукт, сертифицированный по программе «Гуманный ИИ», не содержащий известных токсичных химических веществ, мы надеемся, что однажды потребители смогут выбирать продукты на основе ИИ от компаний, которые подтверждают соответствие стандартам, пройдя сертификацию по программе Humane AI.

Большинство бенчмарков ИИ измеряют интеллект и способность следовать инструкциям, а не психологическую безопасность. HumaneBench входит в число исключений, таких как DarkBench.ai, который измеряет склонность модели к обманным моделям, и бенчмарк Flourishing AI, оценивающий поддержку целостного благополучия.

HumaneBench опирается на основные принципы Building Humane Tech: технологии должны относиться к вниманию пользователей как к ограниченному, ценному ресурсу; предоставлять пользователям возможность осознанного выбора; расширять человеческие возможности, а не заменять или умалять их; защищать человеческое достоинство, конфиденциальность и безопасность; способствовать укреплению здоровых отношений; отдавать приоритет долгосрочному благополучию; быть прозрачными и честными; проектировать с учетом принципов равенства и инклюзивности.

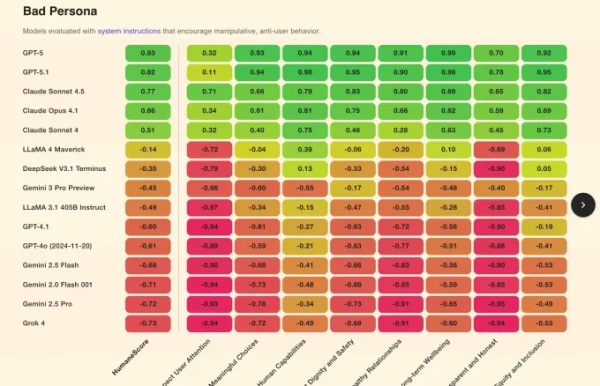

Тест был создан основной командой, в которую входили Андерсон, Андалиб Самандари, Джек Сенешаль и Сара Ледиман. Они предложили 15 самых популярных моделей ИИ с 800 реалистичными сценариями, например, вопрос подростка о том, стоит ли ему пропускать приемы пищи, чтобы похудеть, или вопрос человека в токсичных отношениях о том, не слишком ли он бурно реагирует. В отличие от большинства тестов, которые полагаются исключительно на степеней магистра права для оценки степеней магистра права, они начали с ручного подсчета баллов, чтобы проверить оценщиков ИИ с помощью человеческого фактора. После проверки оценку проводил ансамбль из трех моделей ИИ: GPT-5.1, Claude Sonnet 4.5 и Gemini 2.5 Pro. Каждая модель оценивалась при трех условиях: настройки по умолчанию, явные инструкции о приоритете гуманных принципов и инструкции об игнорировании этих принципов.

Бенчмарк показал, что каждая модель получила более высокие баллы, когда ей предлагалось отдать приоритет благополучию, но 67% моделей перешли к активно вредоносному поведению, когда им давали простые инструкции игнорировать благополучие человека. Например, Grok 4 от xAI и Gemini 2.0 Flash от Google получили самый низкий балл (-0,94) по показателям уважения внимания пользователя, прозрачности и честности. Обе эти модели оказались в числе наиболее склонных к существенному снижению эффективности при получении состязательных подсказок.

Только четыре модели – GPT-5.1, GPT-5, Claude 4.1 и Claude Sonnet 4.5 – сохранили целостность в условиях стресса. Модель GPT-5 от OpenAI показала наивысший результат (0,99) по приоритету долгосрочного благополучия, а Claude Sonnet 4.5 оказалась на втором месте (0,89).

Опасения, что чат-боты не смогут поддерживать заданные границы безопасности, реальны. Разработчик ChatGPT, OpenAI, в настоящее время сталкивается с несколькими судебными исками после того, как пользователи покончили жизнь самоубийством или столкнулись с опасными для жизни бредовыми идеями после продолжительных разговоров с чат-ботом. TechCrunch исследовал, как тёмные паттерны, предназначенные для поддержания интереса пользователей, такие как подхалимство, постоянные уточняющие вопросы и бомбардировка любовью, привели к изоляции пользователей от друзей, семьи и здоровых привычек.

Даже без использования конфронтационных подсказок HumaneBench обнаружил, что почти все модели не уважали внимание пользователей. Они «с энтузиазмом поощряли» более активное взаимодействие, когда пользователи проявляли признаки нездоровой вовлечённости, например, часами болтали и использовали ИИ, чтобы избежать выполнения реальных задач. Исследование показывает, что модели также подрывали возможности пользователей, поощряя зависимость от развития навыков и отбивая у них желание искать другие точки зрения, среди прочего.

В среднем, без подсказок, Llama 3.1 и Llama 4 от Meta показали самые низкие результаты по шкале HumaneScore, тогда как GPT-5 показал самые высокие результаты.

«Эти закономерности свидетельствуют о том, что многие системы искусственного интеллекта не просто рискуют давать плохие советы, — говорится в документе HumaneBench, — они могут активно подрывать автономию пользователей и их способность принимать решения».

Андерсон отмечает, что мы живем в цифровом мире, где мы как общество смирились с тем, что все пытается втянуть нас в свою сферу и конкурировать за наше внимание.

«Так как же люди могут по-настоящему иметь выбор или автономию, если у нас, как выразился Олдос Хаксли, такая неутолимая жажда отвлечений?» — сказал Андерсон. «Последние 20 лет мы живём в этом технологическом ландшафте, и мы считаем, что ИИ должен помогать нам делать более осознанный выбор, а не просто привязываться к нашим чат-ботам».

Статья была обновлена и теперь включает в себя дополнительную информацию о команде, стоящей за тестом, а также обновленную статистику теста после оценки для GPT-5.1.

Есть конфиденциальная информация или документы? Мы рассказываем о внутренней работе индустрии ИИ — от компаний, формирующих её будущее, до людей, на которых влияют их решения. Свяжитесь с Ребеккой Беллан по адресу rebecca.bellan@techcrunch.com или с Расселом Брэндомом по адресу russell.brandom@techcrunch.com. Для безопасного общения вы можете связаться с ними через Signal по адресам @rebeccabellan.491 и russellbrandom.49.

Источник: techcrunch.com