Карл Франзен

По мере того, как большие языковые модели (LLM) расширяют свои контекстные окна для обработки огромных документов и сложных диалогов, они сталкиваются с суровой реальностью аппаратного обеспечения, известной как «узкое место кэша ключ-значение (KV)».

Каждое слово, обрабатываемое моделью, должно храниться в виде многомерного вектора в высокоскоростной памяти. Для задач, требующих обработки длинных текстов, этот «цифровой справочник» быстро разрастается, поглощая видеопамять (VRAM) графического процессора (GPU), используемую во время вывода, и быстро замедляя производительность модели с течением времени.

Но не стоит бояться, Google Research здесь: вчера это подразделение поискового гиганта выпустило свой набор алгоритмов TurboQuant — программный прорыв, предоставляющий математическую основу для экстремального сжатия кэша ключ-значение, что позволяет в среднем в 6 раз сократить объем памяти ключ-значение, используемой данной моделью, и в 8 раз повысить производительность вычислений логитов внимания. Это может снизить затраты для предприятий, внедривших его в свои модели, более чем на 50%.

Теоретически обоснованные алгоритмы и соответствующие исследовательские работы теперь доступны для публичного бесплатного использования, в том числе и для корпоративного применения, предлагая решение, не требующее обучения, позволяющее уменьшить размер модели без ущерба для ее интеллектуальных возможностей.

Появление TurboQuant — это кульминация многолетней исследовательской работы, начавшейся в 2024 году. Хотя лежащие в основе математические модели, включая PolarQuant и квантованный метод Джонсона-Линденштрауса (QJL), были описаны в начале 2025 года, их официальное представление сегодня знаменует переход от академической теории к крупномасштабной производственной реальности.

Выбор времени стратегически выверен, поскольку совпадает с предстоящими презентациями этих результатов на следующих конференциях: Международной конференции по обучению представлениям (ICLR 2026) в Рио-де-Жанейро, Бразилия, и Ежегодной конференции по искусственному интеллекту и статистике (AISTATS 2026) в Танжере, Марокко.

Выпуская эти методологии в рамках открытой исследовательской платформы, Google обеспечивает необходимую «инфраструктуру» для набирающей обороты эры «агентного ИИ»: потребность в массивной, эффективной и доступной для поиска векторизованной памяти, которая, наконец, сможет работать на оборудовании, уже имеющемся у пользователей. Уже сейчас считается, что это оказывает влияние на фондовый рынок, снижая цены на услуги поставщиков памяти, поскольку трейдеры рассматривают выпуск как признак того, что потребуется меньше памяти (возможно, это неверно, учитывая парадокс Джевонса).

Архитектура памяти: решение проблемы «налога на эффективность».

Чтобы понять, почему TurboQuant важен, необходимо сначала разобраться с «налогом на память» современного ИИ. Традиционное векторное квантование исторически было процессом с «утечкой памяти».

При сжатии десятичных чисел высокой точности в простые целые числа накапливается возникающая «ошибка квантования», в конечном итоге приводящая к тому, что модели начинают искажать реальность или терять семантическую согласованность.

Кроме того, большинство существующих методов требуют наличия «констант квантования» — метаданных, хранящихся вместе со сжатыми битами, которые указывают модели, как их декомпрессировать. Во многих случаях эти константы добавляют настолько большой излишек — иногда от 1 до 2 бит на число — что полностью сводят на нет преимущества сжатия.

TurboQuant разрешает этот парадокс с помощью двухэтапной математической защиты. На первом этапе используется PolarQuant, которая переосмысливает способ отображения многомерного пространства.

Вместо стандартных декартовых координат (X, Y, Z) PolarQuant преобразует векторы в полярные координаты, состоящие из радиуса и набора углов.

Прорыв заключается в геометрии: после случайного вращения распределение этих углов становится очень предсказуемым и концентрированным. Поскольку «форма» данных теперь известна, системе больше не нужно хранить дорогостоящие константы нормализации для каждого блока данных. Она просто отображает данные на фиксированную круговую сетку, устраняя накладные расходы, присущие традиционным методам.

Второй этап выступает в роли математической проверки ошибок. Даже при эффективности PolarQuant остается некоторая остаточная погрешность. TurboQuant применяет к этим оставшимся данным 1-битное квантованное преобразование Джонсона-Линденштрауса (QJL). Уменьшая каждое число ошибки до простого знакового бита (+1 или -1), QJL служит оценщиком с нулевым смещением. Это гарантирует, что когда модель вычисляет «оценку внимания» — важнейший процесс определения наиболее релевантных слов в подсказке — сжатая версия остается статистически идентичной высокоточной исходной версии.

Показатели производительности и надежность в реальных условиях эксплуатации.

Настоящей проверкой любого алгоритма сжатия является тест «Иголка в стоге сена», который оценивает, может ли ИИ найти одно конкретное предложение, скрытое в 100 000 словах.

В ходе тестирования на моделях с открытым исходным кодом, таких как Llama-3.1-8B и Mistral-7B, TurboQuant показал идеальные показатели полноты, повторяя производительность несжатых моделей и одновременно уменьшая объем памяти в кэше ключ-значение как минимум в 6 раз.

Такая «нейтральность качества» редко встречается в мире экстремального квантования, где 3-битные системы обычно страдают от значительного ухудшения логики.

TurboQuant выходит за рамки чат-ботов и меняет подход к поиску в многомерном пространстве. Современные поисковые системы все чаще полагаются на «семантический поиск», сравнивая значения миллиардов векторов, а не просто сопоставляя ключевые слова. TurboQuant неизменно демонстрирует более высокие показатели полноты поиска по сравнению с существующими передовыми методами, такими как RabbiQ и квантизация продуктов (PQ), при этом практически не требуя времени на индексирование.

Это делает его идеальным кандидатом для приложений реального времени, где данные постоянно добавляются в базу данных и должны быть доступны для поиска немедленно. Кроме того, на таком оборудовании, как ускорители NVIDIA H100, 4-битная реализация TurboQuant обеспечила 8-кратное повышение производительности при вычислении журналов внимания, что является критически важным ускорением для реальных внедрений.

Реакция сообщества Rapt

Реакция на X, полученный в результате поиска Grok, включала в себя смесь технического восторга и непосредственного практического экспериментирования.

Первоначальное объявление от @GoogleResearch вызвало огромный отклик, собрав более 7,7 миллионов просмотров, что свидетельствует о том, что отрасль остро нуждается в решении проблемы нехватки памяти.

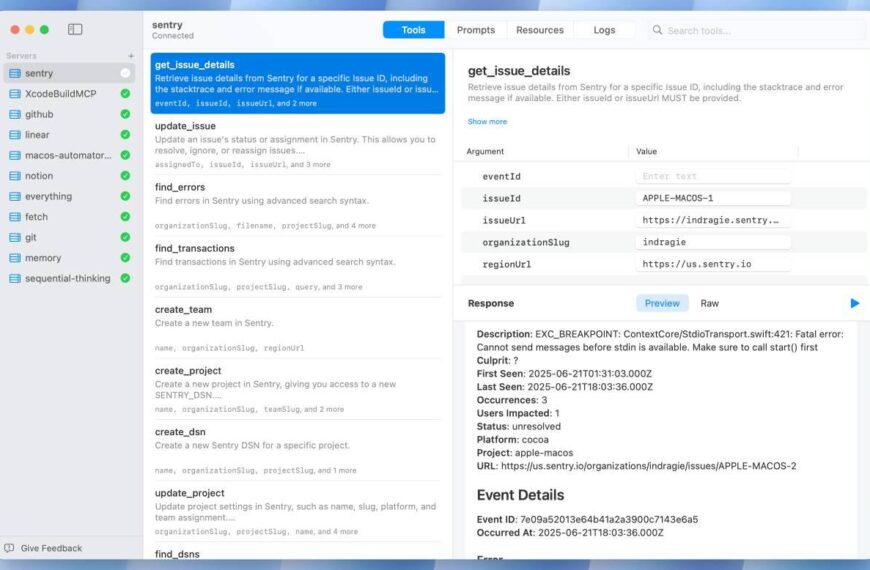

В течение 24 часов после релиза участники сообщества начали переносить алгоритм в популярные локальные библиотеки ИИ, такие как MLX для Apple Silicon и llama.cpp.

Технический аналитик @Prince_Canuma поделился одним из наиболее убедительных предварительных результатов тестирования, реализовав TurboQuant в MLX для проверки модели Qwen3.5-35B.

При длине контекста от 8,5 тыс. до 64 тыс. токенов он сообщил о 100% точном совпадении на каждом уровне квантизации, отметив, что 2,5-битный TurboQuant уменьшил кэш ключ-значение почти в 5 раз без потери точности. Эта проверка в реальных условиях подтвердила внутренние исследования Google, доказав, что преимущества алгоритма легко переносятся на модели сторонних разработчиков.

Другие пользователи сосредоточились на демократизации высокопроизводительного ИИ. @NoahEpstein_ представил простой и понятный анализ, утверждая, что TurboQuant значительно сокращает разрыв между бесплатным локальным ИИ и дорогостоящими облачными подписками.

Он отметил, что модели, работающие локально на потребительском оборудовании, таком как Mac Mini, «стали значительно лучше», что позволяет вести диалоги с 100 000 токенов без типичного ухудшения качества.

Аналогичным образом, @PrajwalTomar_ подчеркнул преимущества в плане безопасности и скорости, которые дает запуск «невероятных моделей ИИ локально бесплатно», выразив «огромное уважение» к решению Google поделиться результатами исследований, а не держать их в секрете.

Влияние рынка и будущее аппаратного обеспечения

Выход TurboQuant уже начал оказывать влияние на всю технологическую экономику. После объявления во вторник аналитики отметили тенденцию к снижению цен на акции крупных поставщиков памяти, включая Micron и Western Digital.

Реакция рынка отражает понимание того, что если гиганты в области искусственного интеллекта смогут сократить свои потребности в памяти в шесть раз исключительно за счет программного обеспечения, то ненасытный спрос на высокоскоростную память (HBM) может быть смягчен повышением эффективности алгоритмов.

По мере приближения к 2026 году появление TurboQuant говорит о том, что следующая эра прогресса в области ИИ будет определяться как математической элегантностью, так и грубой силой. Переосмысливая эффективность за счет экстремального сжатия, Google обеспечивает «более интеллектуальное перемещение памяти» для многошаговых агентов и плотных конвейеров поиска. Отрасль смещается от фокуса на «более крупные модели» к «более качественной памяти», что может снизить затраты на обслуживание ИИ во всем мире.

Стратегические аспекты для лиц, принимающих решения на предприятиях.

Для предприятий, которые в настоящее время используют или совершенствуют собственные модели ИИ, выпуск TurboQuant предоставляет редкую возможность для немедленного улучшения операционной деятельности.

В отличие от многих прорывов в области ИИ, требующих дорогостоящего переобучения или специализированных наборов данных, TurboQuant не требует обучения и не обращает внимания на данные.

Это означает, что организации могут применять эти методы квантования к своим существующим точно настроенным моделям — будь то на основе Llama, Mistral или собственной модели Google Gemma — чтобы немедленно добиться экономии памяти и ускорения без риска потери специализированной производительности, которую они стремились создать.

С практической точки зрения, корпоративным ИТ-командам и командам DevOps следует рассмотреть следующие шаги для интеграции результатов данного исследования в свою деятельность:

Оптимизация конвейеров вывода: интеграция TurboQuant в производственные серверы вывода может сократить количество графических процессоров, необходимых для обслуживания приложений с длительным контекстом, что потенциально может снизить затраты на облачные вычисления на 50% и более.

Расширение возможностей контекстной обработки: Предприятия, работающие с большими объемами внутренней документации, теперь могут предлагать гораздо более длительные контекстные окна для задач генерации с расширенным поиском (RAG) без значительных затрат на видеопамять, которые ранее делали такие функции экономически нецелесообразными.

Улучшение локального развертывания: для организаций со строгими требованиями к конфиденциальности данных TurboQuant позволяет запускать высокопроизводительные крупномасштабные модели на локальном оборудовании или периферийных устройствах, которые ранее были недостаточны для 32-битных или даже 8-битных весов моделей.

Пересмотрите подход к закупке оборудования: прежде чем инвестировать в масштабные кластеры графических процессоров с большим объемом памяти HBM, руководителям производственных операций следует оценить, насколько можно устранить узкие места за счет повышения эффективности с помощью программного обеспечения.

В конечном итоге, TurboQuant доказывает, что предел возможностей ИИ заключается не только в количестве транзисторов, которые можно разместить на чипе, но и в том, насколько элегантно можно преобразовать бесконечную сложность информации в конечное пространство цифрового бита. Для предприятий это больше, чем просто научная статья; это тактическое решение, превращающее существующее оборудование в значительно более мощный инструмент.

Подпишитесь, чтобы получать самые свежие новости!

Подробные аналитические данные для руководителей предприятий в области искусственного интеллекта, данных и безопасности.

Отправляя свой адрес электронной почты, вы соглашаетесь с нашими Условиями использования и Политикой конфиденциальности.

Получайте обновления ! Вы подписаны! Наши последние новости скоро поступят на вашу электронную почту.

Источник: venturebeat.com