Бен Диксон

Корпоративные приложения искусственного интеллекта, обрабатывающие большие документы или задачи с длительным горизонтом планирования, сталкиваются с серьезным дефицитом памяти. По мере увеличения объема контекста увеличивается и объем кэша ключ-значение (KV-кэша) — области, где хранится рабочая память модели.

Новая методика, разработанная исследователями из Массачусетского технологического института, решает эту проблему с помощью быстрого метода сжатия кэша ключ-значение. Метод, называемый «сопоставление внимания» (Attention Matching), позволяет сжать контекст до 50 раз с минимальной потерей качества.

Хотя это не единственный доступный метод сжатия памяти, алгоритм Attention Matching выделяется своей скоростью выполнения и впечатляющими возможностями сохранения информации.

Узкое место в памяти кэша ключ-значение.

Крупные языковые модели генерируют свои ответы последовательно, по одному токену за раз. Чтобы избежать пересчета всей истории разговора с нуля для каждого предсказанного слова, модель хранит математическое представление каждого предыдущего обработанного ею токена, также известного как пары ключ-значение. Эта критически важная рабочая память известна как кэш ключ-значение (KV-кэш).

Кэш ключ-значение масштабируется в зависимости от длины диалога, поскольку модель вынуждена сохранять эти ключи и значения для всех предыдущих токенов в данном взаимодействии. Это потребляет дорогостоящие аппаратные ресурсы. «На практике память кэша ключ-значение является самым большим узким местом при обслуживании моделей в контексте сверхдлинных диалогов», — сказал Адам Цвайгер, соавтор статьи, в интервью VentureBeat. «Это ограничивает параллелизм, заставляет использовать меньшие пакеты и/или требует более агрессивной разгрузки».

В современных корпоративных сценариях использования, таких как анализ огромных объемов юридических контрактов, поддержание многосессионного диалога с клиентами или запуск автономных агентов программирования, кэш ключ-значение может разрастаться до многих гигабайт памяти для одного пользовательского запроса.

Для решения этой масштабной проблемы индустрия ИИ опробовала несколько стратегий, но эти методы оказываются неэффективными в корпоративных средах, где требуется экстремальное сжатие. Один из технических способов решения проблемы включает оптимизацию кэша ключ-значение путем удаления токенов, которые модель считает менее важными, или объединения похожих токенов в единое представление. Эти методы работают для умеренного сжатия, но, по словам авторов, «быстро теряют эффективность при высоких коэффициентах сжатия».

В реальных приложениях часто используются более простые методы, наиболее распространенный из которых заключается в простом удалении старого контекста после достижения предела памяти. Однако такой подход приводит к потере старой информации по мере увеличения объема контекста. Другой альтернативой является суммирование контекста, при котором система приостанавливает работу, записывает краткое текстовое описание старого контекста и заменяет исходную память этим описанием. Хотя это является отраслевым стандартом, суммирование приводит к значительным потерям и серьезно ухудшает производительность последующих процессов, поскольку может удалять важную информацию из контекста.

Недавние исследования доказали, что технически возможно сильно сжать эту память с помощью метода, называемого «картриджами». Однако этот подход требует обучения моделей скрытого кэша ключ-значение посредством медленной сквозной математической оптимизации. Такое обучение на основе градиента может занять несколько часов на дорогостоящих графических процессорах только для сжатия одного контекста, что делает его совершенно непригодным для корпоративных приложений реального времени.

Как алгоритм сопоставления внимания сжимает данные без дополнительных затрат

Метод сопоставления по принципу внимания (Attention Matching) обеспечивает высокие коэффициенты сжатия и качество, при этом работая на порядки быстрее, чем градиентная оптимизация. Он обходит медленный процесс обучения благодаря хитрым математическим приемам.

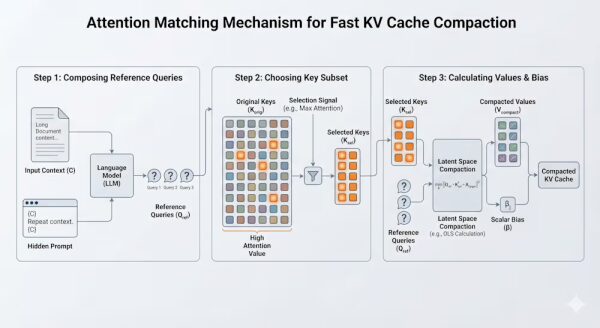

Исследователи поняли, что для идеального воспроизведения взаимодействия ИИ с памятью необходимо сохранить два математических свойства при сжатии исходных векторов ключей и значений в меньший объем. Первое — это «выход внимания», то есть фактическая информация, которую ИИ извлекает при запросе к своей памяти. Второе — это «масса внимания», которая представляет собой математический вес, который имеет токен относительно всего остального в рабочей памяти модели. Если сжатая память соответствует этим двум свойствам, она будет вести себя точно так же, как и массивная исходная память, даже при добавлении новых, непредсказуемых запросов пользователя.

«В некотором смысле, сопоставление внимания является „правильной“ целью для компактизации скрытого контекста, поскольку оно напрямую направлено на сохранение поведения каждого элемента механизма внимания после компактизации», — сказал Цвайгер. Хотя удаление токенов и связанные с этим эвристики могут работать, явное сопоставление поведения механизма внимания просто приводит к лучшим результатам.

Перед сжатием памяти система генерирует небольшой набор «справочных запросов», которые служат заменой типам внутренних поисков, которые модель, вероятно, будет выполнять при анализе конкретного контекста. Если сжатая память может точно ответить на эти справочные запросы, она, скорее всего, сможет ответить на реальные вопросы пользователя позже. Авторы предлагают различные методы генерации этих справочных запросов, включая добавление скрытой подсказки к документу, указывающей модели повторить предыдущий контекст, что известно как метод «повторного заполнения». Они также предлагают подход «самообучения», при котором модели предлагается выполнить несколько быстрых синтетических задач над документом, таких как агрегирование всех ключевых фактов или структурирование дат и чисел в формат JSON.

Имея на руках эти запросы, система выбирает набор ключей для сохранения в сжатом кэше ключ-значение на основе таких сигналов, как наивысшее значение внимания. Затем она использует ключи и эталонные запросы для вычисления значений соответствия вместе со скалярным смещением. Это смещение гарантирует сохранение релевантной информации, позволяя каждому сохраненному ключу представлять собой массу множества удаленных ключей.

Эта формулировка позволяет подгонять значения с помощью простых алгебраических методов, таких как метод наименьших квадратов и метод наименьших квадратов с неотрицательными значениями, полностью избегая ресурсоемкой оптимизации на основе градиента. Именно это делает метод сопоставления внимания сверхбыстрым по сравнению с ресурсоемкими методами сжатия. Исследователи также применяют сжатие по частям, обрабатывая смежные фрагменты входных данных независимо и объединяя их, чтобы еще больше повысить производительность на длинных контекстах.

Применение алгоритма сопоставления внимания на практике.

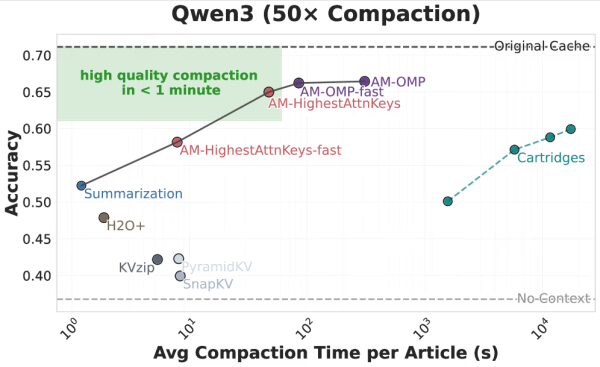

Чтобы понять, как этот метод работает в реальных условиях, исследователи провели серию стресс-тестов, используя популярные модели с открытым исходным кодом, такие как Llama 3.1 и Qwen-3, на двух различных типах корпоративных наборов данных. Первым был QuALITY, стандартный тест на понимание прочитанного текста, использующий документы объемом от 5000 до 8000 слов. Вторым, представляющим собой настоящую корпоративную задачу, был LongHealth, очень плотный набор данных, содержащий 60 000 токенов и включающий сложные медицинские записи множества пациентов.

Ключевым открытием стала способность алгоритма Attention Matching в 50 раз уменьшить размер кэша ключ-значение модели без снижения точности, при этом обработка документов занимает всего несколько секунд. Ранее для достижения такого же уровня качества Cartridges требовались часы интенсивных вычислений на графическом процессоре для каждого контекста.

При работе с большими объемами медицинских записей стандартные отраслевые обходные пути оказались совершенно неэффективными. Исследователи отметили, что при попытке использовать стандартное суммирование текста для этих историй болезни точность модели упала настолько низко, что сравнялась с базовым показателем «без контекста», то есть ИИ работал так, как если бы он вообще не читал документ.

Метод сопоставления внимания значительно превосходит суммаризацию, но архитекторам предприятий потребуется снизить коэффициент сжатия для задач с высокой плотностью информации по сравнению с более простыми тестами на понимание прочитанного. Как объясняет Цвайгер: «Главный практический компромисс заключается в том, что если вы пытаетесь сохранить почти все в контексте при выполнении задач с высокой плотностью информации, вам, как правило, требуется более мягкий коэффициент сжатия для сохранения высокой точности».

Исследователи также изучили, что происходит в случаях, когда абсолютная точность не требуется, но необходима значительная экономия памяти. Они применили алгоритм Attention Matching к стандартному текстовому резюме. Этот комбинированный подход позволил достичь 200-кратного сжатия. Он успешно сравнялся по точности со стандартным суммаризацией, но при этом потреблял очень мало памяти.

Одним из интересных экспериментов для корпоративных рабочих процессов стало тестирование онлайн-компактирования, хотя исследователи отмечают, что это лишь концептуальная проверка, не прошедшая строгих испытаний в производственных условиях. Они протестировали модель на продвинутом тесте AIME на математическое мышление. Искусственный интеллект был вынужден решать задачу со строго ограниченным объемом физической памяти. Всякий раз, когда память модели заполнялась, система приостанавливалась, мгновенно сжимала рабочую память на 50 процентов с помощью механизма «Внимание» и позволяла ей продолжать работу. Даже после достижения предела памяти и шестикратного последовательного уменьшения кэша ключ-значение в процессе работы, модель успешно решала математические задачи. Ее производительность соответствовала модели, которой была предоставлена огромная, неограниченная память.

Следует учитывать некоторые нюансы. При 50-кратном коэффициенте сжатия метод Attention Matching явно выигрывает с точки зрения баланса скорости и качества. Однако, если предприятие пытается довести сжатие до экстремальных 100-кратных пределов для очень сложных данных, более медленный метод Cartridges на основе градиента оказывается даже лучше.

Исследователи опубликовали код для алгоритма Attention Matching. Однако они отмечают, что в настоящее время это не простое обновление программного обеспечения, работающее по принципу «подключи и работай». «Я думаю, что латентную компактизацию лучше всего рассматривать как метод, применяемый на уровне модели», — отмечает Цвайгер. «Хотя ее можно применять поверх любой существующей модели, она требует доступа к весам модели». Это означает, что предприятия, полностью полагающиеся на закрытые API, не могут реализовать это самостоятельно; им нужны модели с открытыми весами.

Авторы отмечают, что интеграция этого метода сжатия ключ-значение в латентном пространстве в существующие, высокооптимизированные коммерческие системы вывода по-прежнему требует значительных усилий. Современная инфраструктура ИИ использует сложные приемы, такие как кэширование префиксов и упаковка памяти переменной длины, для обеспечения эффективной работы серверов, и для бесперебойного внедрения этой новой техники сжатия в существующие системы потребуется специальная инженерная работа. Однако существуют и непосредственные корпоративные приложения. «Мы считаем, что сжатие после загрузки данных — это многообещающий вариант использования, когда большие выходные данные вызовов инструментов или длинные документы сжимаются сразу после обработки», — сказал Цвайгер.

В конечном итоге, как утверждает Цвайгер, переход к механическому уплотнению скрытого пространства соответствует будущим планам развития продуктов ведущих игроков в сфере ИИ. «Мы наблюдаем, как уплотнение переходит от реализации предприятиями собственных решений к поставкам от поставщиков моделей», — сказал Цвайгер. «Это особенно верно для уплотнения скрытого пространства, где необходим доступ к весам модели».

Подпишитесь, чтобы получать самые свежие новости!

Подробные аналитические данные для руководителей предприятий в области искусственного интеллекта, данных и безопасности.

Отправляя свой адрес электронной почты, вы соглашаетесь с нашими Условиями использования и Политикой конфиденциальности.

Получайте обновления ! Вы подписаны! Наши последние новости скоро поступят на вашу электронную почту.

Источник: venturebeat.com