Нейронные и символьные модели сжимают мир принципиально разными способами, а разреженные автоэнкодеры (SAE) предлагают мост для их соединения.

Делиться

Задолго до создания компьютеров и искусственного интеллекта мы создали институты, предназначенные для систематического анализа человеческого поведения, – суд. Правовая система – один из древнейших механизмов мышления человечества, где факты и доказательства используются в качестве входных данных, соответствующие законы – в качестве правил рассуждения, а вердикты – как результат работы системы. Однако законы постоянно развивались с самого начала человеческой цивилизации. Самый ранний кодифицированный закон – Кодекс Хаммурапи (около 1750 г. до н. э.) – представляет собой одну из первых масштабных попыток формализовать моральные и социальные рассуждения в виде явных символических правил. Его красота заключается в ясности и единообразии, но в то же время он негибкий и неспособен адаптироваться к контексту. Спустя столетия традиции общего права , такие как те, что сформировались в результате дела Донохью против Стивенсона (1932 г.), ввели противоположную философию: рассуждения, основанные на прецедентном опыте и судебных делах. Современные правовые системы, как мы знаем, обычно представляют собой сочетание того и другого, хотя пропорции варьируются в зависимости от страны.

В отличие от сплочённого сочетания в правовых системах, схожая пара парадигм в ИИ — символизм и коннекционизм — кажется, гораздо сложнее совместить. Последний доминировал в последние годы на волне развития ИИ, где всё неявно изучается с использованием огромных объёмов данных и вычислительных ресурсов и кодируется с помощью параметров в нейронных сетях. И это направление действительно доказало свою высокую эффективность с точки зрения производительности бенчмарков. Так действительно ли нам нужен символический компонент в наших системах ИИ?

Символические системы против нейронных сетей: перспектива сжатия информации

Чтобы ответить на поставленный выше вопрос, необходимо подробнее рассмотреть обе системы. С вычислительной точки зрения и символьные системы, и нейронные сети можно рассматривать как машины сжатия: они преобразуют огромную сложность мира в компактные представления, позволяющие рассуждать, предсказывать и управлять. Однако они делают это посредством принципиально разных механизмов, руководствуясь противоположными философиями понимания того, что значит «понимать».

По сути, обе парадигмы можно представить как фильтры, применяемые к сырой реальности. При наличии входных данных (X) каждая из них обучается или определяет преобразование (H(cdot)), которое даёт сжатое представление (Y = H(X)), сохраняя информацию, которую она считает значимой, и отбрасывая остальную. Но форма этой фильтрации различна. В общем случае, символьные системы ведут себя как фильтры верхних частот — они выделяют резкие, определяющие правила контуры мира, игнорируя его плавные градиенты. Нейронные сети, напротив, напоминают фильтры нижних частот , сглаживая локальные флуктуации для учёта глобальной структуры. Разница не в том, что они видят, а в том, что они предпочитают забыть.

Символьные системы сжимаются посредством дискретизации . Они разделяют непрерывную ткань опыта на отдельные категории, отношения и правила: правовой кодекс, грамматику или онтологию. Каждый символ действует как чёткая граница, средство манипуляции в рамках предопределённой схемы. Этот процесс напоминает проекцию зашумлённого сигнала на набор базисных векторов, созданных человеком, — пространство, охватываемое такими понятиями, как «сущность» и «отношение». Граф знаний, например, может прочитать предложение «UIUC — выдающийся университет, и он мне нравится» и оставить только (UIUC, is_a, учреждение), отбрасывая всё, что выходит за рамки его схемы. Результатом являются ясность и компонуемость, но также и жёсткость: значение вне онтологических рамок просто испаряется.

Нейронные сети, напротив, сжимаются посредством сглаживания . Они отказываются от дискретных категорий в пользу гладких многообразий, где соседние входные данные вызывают схожие активации (обычно ограниченные некоторой константой Липшица в современных LLM). Вместо того, чтобы отображать данные в предопределенные координаты, они изучают скрытую геометрию, которая неявно кодирует корреляции. С этой точки зрения мир — это не набор правил, а поле градиентов. Это делает нейронные представления удивительно адаптивными: они могут интерполировать, аналогизировать и обобщать на основе невидимых примеров. Но та же гладкость, которая обеспечивает гибкость, также порождает непрозрачность. Информация запутывается, семантика становится распределенной, а интерпретируемость теряется в самом акте обобщения.

| Свойство | Символические системы | Нейронные сети |

|---|---|---|

| Сохранившаяся информация | Дискретные, определенные схемой факты | Частые, непрерывные статистические закономерности |

| Источник абстракции | Онтология, определяемая человеком | Коллектор, управляемый данными |

| Надежность | Хрупкие края правила | Локально устойчивый, но глобально нечеткий |

| Режим ошибки | Пропущенные факты (пробелы в освещении) | Сглаженные факты (галлюцинации) |

| Интерпретируемость | Высокий | Низкий |

В заключение можно суммировать разницу между двумя системами с точки зрения сжатия информации в одном предложении: « Нейронные сети — это размытые изображения мира, тогда как символьные системы — это изображения высокого разрешения с отсутствующими участками». Это фактически указывает на причину, по которой нейросимволические системы являются искусством компромисса: они могут использовать знания из обеих парадигм, используя их совместно в разных масштабах, при этом нейронные сети обеспечивают глобальную основу низкого разрешения, а символьные компоненты предоставляют локальные детали высокого разрешения.

Проблема масштабируемости

Хотя очень заманчиво добавить символьные компоненты в нейронные сети, чтобы использовать преимущества обоих подходов, масштабируемость — серьёзная проблема, стоящая на пути наших усилий, особенно в эпоху фундаментальных моделей. Традиционные нейросимволические системы опираются на набор онтологий/схем/символов, определяемых экспертами, который, как предполагается, способен охватить все возможные варианты ввода. Это приемлемо для систем, специфичных для предметной области (например, чат-бота для заказа пиццы); однако подобные подходы неприменимы к системам с открытой предметной областью, где для построения триллионов символов и их взаимосвязей потребуются эксперты.

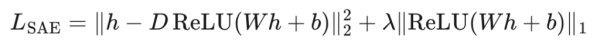

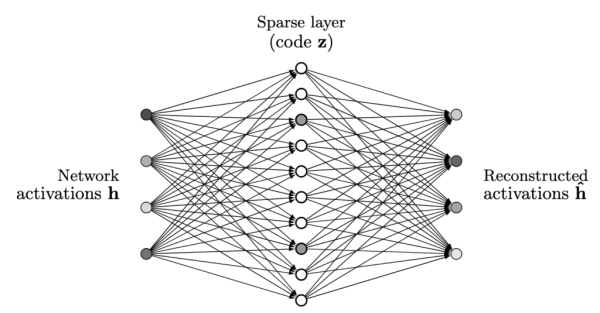

Естественной реакцией является переход на полную ориентацию на данные: вместо того, чтобы просить людей вручную создавать онтологию, мы позволяем модели генерировать собственные «символы» из внутренних активаций. Разреженные автоэнкодеры (SAE) являются ярким воплощением этой идеи. Разлагая скрытые состояния на большой набор разреженных признаков, они, по-видимому, дают нам словарь нейронных концепций : каждый признак активируется по определённому шаблону, (часто) интерпретируется человеком и ведёт себя как дискретное устройство, которое можно включать и выключать. На первый взгляд, это выглядит как идеальный выход из узкого места эксперта: мы больше не разрабатываем набор символов, мы его изучаем.

Здесь (D) называется матрицей словаря, где каждый столбец хранит семантически значимое понятие; первый член — это потеря реконструкции скрытого состояния (h), а второй — штраф за разреженность, поощряющий минимальное количество активированных нейронов в коде.

Однако подход, основанный только на SAE, сталкивается с двумя фундаментальными проблемами. Первая — вычислительная: использование SAE в качестве живого символьного слоя потребовало бы умножения каждого скрытого состояния на огромную матрицу словаря, что привело бы к высокой вычислительной нагрузке, даже если результирующий код оказался бы разреженным. Это делает их невозможными для развёртывания в масштабах Foundation Model. Вторая — концептуальная: признаки SAE представляют собой символоподобные представления, но не являются символьной системой — у них нет явного формального языка, композиционных операторов и исполняемых правил. Они сообщают нам, какие концепции существуют в скрытом пространстве модели, но не объясняют, как с ними работать.

Это не означает, что нам следует полностью отказаться от SAE — они предоставляют ингредиенты, а не готовое блюдо. Вместо того, чтобы требовать от SAE быть символьной системой, мы можем рассматривать их как мост между внутренним пространством понятий модели и множеством уже имеющихся у нас символических артефактов: графами знаний, онтологиями, базами правил, таксономиями, где рассуждения возможны по определению. Высококачественная SAE, обученная на скрытых состояниях большой модели, становится общей «системой координат понятий»: различные символьные системы могут быть согласованы в этой системе координат, связывая их символы с функциями SAE, которые последовательно активируются при вызове этих символов в контексте.

Это имеет несколько преимуществ по сравнению с простым размещением символьных систем рядом и выполнением к ним независимых запросов. Во-первых, это позволяет объединять символы и создавать псевдонимы в разных системах : если два символа из разных формализмов неоднократно высвечивают почти один и тот же набор признаков SAE, у нас есть веские доказательства того, что они соответствуют одной и той же базовой нейронной концепции и могут быть связаны или даже объединены. Во-вторых, это поддерживает обнаружение межсистемных связей : символы, которые далеки друг от друга в наших вручную разработанных схемах, но постоянно близки в пространстве SAE, указывают на мосты, которые нам не удалось закодировать — новые отношения, абстракции или сопоставления между доменами. В-третьих, активации SAE дают нам модельно-центричное понятие заметности: символы, которые никогда не находят четкого аналога в нейронном пространстве понятий, являются кандидатами на обрезку или рефакторинг, в то время как сильные признаки SAE, не имеющие соответствующего символа ни в одной системе, выявляют слепые пятна, общие для всех наших текущих абстракций.

Важно отметить, что такое использование SAE сохраняет масштабируемость. Дорогостоящая SAE обучается автономно, а сами символьные системы не нуждаются в росте до размера «Фундаментальной модели» — они могут оставаться настолько малыми или большими, насколько того требуют их соответствующие задачи. Во время вывода нейронная сеть продолжает выполнять основную работу в своём непрерывном латентном пространстве; символьные артефакты формируют, ограничивают или контролируют поведение только в тех точках, где явная структура и подотчётность наиболее ценны. SAE помогают, связывая все эти разнородные символьные представления с единой усвоенной концептуальной картой модели, что позволяет сравнивать, объединять и улучшать их, не создавая при этом монолитного, разработанного экспертами символьного двойника.

Когда SAE может служить символическим мостом?

Рисунок выше подразумевает, что наша система координат SAE «достаточно хороша», чтобы служить осмысленной системой координат. Что же для этого требуется? Нам не нужно совершенство, и нам не нужно, чтобы система SAE превосходила человеческие символьные системы по всем осям. Вместо этого нам нужно несколько более скромных, но важных свойств:

– Семантическая непрерывность : входные данные, выражающие одну и ту же базовую концепцию, должны порождать схожие паттерны поддержки в разреженном коде: одно и то же подмножество признаков SAE должно быть ненулевым, а не мерцающим при небольших перефразировках или изменениях контекста. Другими словами, семантическая эквивалентность должна отражаться в стабильном паттерне активных концепций.

– Частичная интерпретируемость : нам не обязательно понимать каждую функцию, но нетривиальная их часть должна допускать надежные человеческие описания, чтобы можно было осуществлять слияние и отладку на уровне концепций.

– Поведенческая релевантность : признаки, которые обнаруживает SAE, должны фактически иметь значение для выходных данных модели: вмешательство в них или обусловливание их наличия должно изменять или предсказывать решения модели систематическим образом.

– Ёмкость и обоснование : SAE может рефакторить только ту структуру, которая уже существует в базовой модели; она не может создавать сложные концепции из слабой основы. Чтобы схема «системы координат концептов» имела смысл, сама базовая модель должна быть достаточно большой и хорошо обученной, чтобы её скрытые состояния уже кодировали разнообразный, нетривиальный набор абстракций. В то же время SAE должна обладать достаточной размерностью и избыточной полнотой: если кодовое пространство слишком мало, многим различным концепциям придётся использовать одни и те же функции, что приведёт к запутанным и нестабильным представлениям.

Теперь подробно обсудим первые три свойства.

Семантическая непрерывность

На уровне аппроксимации чистой функции глубокая нейронная сеть с активациями типа ReLU или GELU реализует отображение, непрерывное по Липшицу: малые возмущения входных данных не могут вызывать произвольно неограниченные скачки выходных логит-функций. Но такая непрерывность сильно отличается от той, которая требуется в разреженном автоэнкодере. В базовой модели несколько нейронов, переключающихся в режимы включения или выключения, легко поглощаются нижестоящими слоями и избыточностью; пока конечные логиты изменяются плавно, нас это устраивает.

В SAE, напротив, мы больше не просто смотрим на гладкий выход — мы рассматриваем шаблон поддержки разреженного кода, восстановленного по остаточному потоку, как протосимволический объект . «Концепция» идентифицируется с определенным активным подмножеством кода. Это делает геометрию гораздо более хрупкой: если небольшое изменение в базовом представлении выталкивает предварительную активацию через порог ReLU в слое SAE, нейрон в коде внезапно переключается из состояния «выключено» в состояние «включено» (или наоборот), и с символической точки зрения концепция появляется или исчезает. Нет нисходящей сети для усреднения; сам код и есть то представление, которое нас интересует.

Штраф за разреженность при построении SAE ещё больше усугубляет эту проблему. Обычная цель SAE сочетает в себе потерю реконструкции со штрафом (ell_1) на активации, что явно подталкивает большинство значений нейронов быть как можно ближе к нулю. В результате даже многие полезные нейроны оказываются вблизи границы активации: чуть выше нуля, когда они нужны, чуть ниже нуля, когда они не нужны — в SAE это называется «усадкой активации». Это негативно сказывается на семантической непрерывности на уровне шаблона поддержки: малейшие возмущения входных данных могут изменить ненулевые нейроны, даже если их базовый смысл практически не изменился. Следовательно, непрерывность по Липшицу базовой модели не даёт нам автоматически стабильного ненулевого подмножества кода в пространстве SAE, и устойчивость на уровне поддержки должна рассматриваться как отдельная цель проектирования и оцениваться явно.

Частичная интерпретируемость

SAE определяет сверхполный словарь для хранения возможных признаков, извлеченных из данных. Поэтому нам нужно, чтобы интерпретируемые признаки были представлены лишь подмножеством этих словарных записей. Даже для этого подмножества значения признаков должны быть лишь приблизительно точными. При сопоставлении существующих символов с пространством SAE мы опираемся на паттерны активации в слое SAE: мы тестируем модель в контекстах, где символ «активен», записываем полученные разреженные коды и используем агрегированный код в качестве вложений для этого символа. Символы из разных систем, вложения которых близки, можно связывать или объединять, даже если мы никогда не присваиваем понятную человеку семантику каждому отдельному признаку.

Интерпретируемые признаки затем играют более конкретную роль: они предоставляют человеческие якоря внутри этой геометрии активации. Если конкретный признак имеет достаточно точное описание, все символы, которые сильно на него влияют, наследуют общую семантическую подсказку (например, «это все вещи типа «обязанности по уходу»), что упрощает проверку, отладку и организацию объединенного символьного пространства. Другими словами, нам не нужен идеальный, полностью именованный словарь. Нам нужны (i) достаточная емкость, чтобы важные концепции могли получить свои собственные указания, и (ii) значительное, поведенчески релевантное подмножество признаков, приблизительные значения которых достаточно стабильны, чтобы служить якорями. Остальной переполненный код может оставаться анонимным фоном; он по-прежнему вносит вклад в расстояния и кластеры в пространстве SAE, даже если мы никогда не даём ему имени.

Поведенческая релевантность через контрфактуальность

Признак интересен как часть моста только в том случае, если он действительно влияет на поведение модели, а не только если он коррелирует с закономерностью в данных. С точки зрения причинно-следственной связи нас интересует, находится ли признак на причинно-следственной связи в вычислениях сети от входа к выходу: если мы возмущены признаком, сохраняя всё остальное неизменным, изменится ли поведение модели так, как предсказывает её предполагаемое значение?

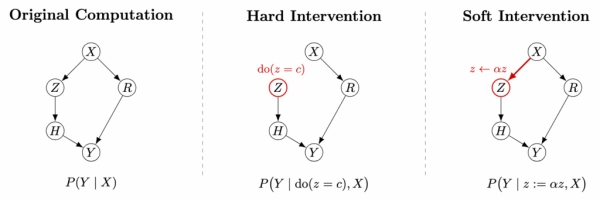

Формально изменение признака аналогично вмешательству вида (text{do}(z = c)) в каузальном смысле, когда мы перезаписываем внутреннюю переменную и перезапускаем вычисление. Но, в отличие от классического моделирования причинно-следственного вывода, нам не требуется исчисление «do» Перла для определения (P(y mid text{do}(z))). Нейронная сеть — это полностью наблюдаемая и интерферируемая система , поэтому мы можем просто выполнить вмешательство во внутренние узлы и наблюдать новый результат. В этом смысле нейронные сети дают нам возможность выполнять идеализированные вмешательства, невозможные в большинстве реальных социальных или экономических систем.

Вмешательство в признаки SAE концептуально схоже, но реализуется по-разному. Обычно мы не знаем значения произвольного значения в пространстве признаков, поэтому упомянутое выше жёсткое вмешательство может быть бессмысленным. Вместо этого мы усиливаем или подавляем величину существующего признака, что больше похоже на мягкое вмешательство: структурный граф остаётся нетронутым, но эффективное влияние признака изменяется. Поскольку SAE реконструирует скрытые активации как линейную комбинацию небольшого числа семантически значимых признаков, мы можем изменять коэффициенты этих признаков для реализации значимых локализованных вмешательств, не затрагивая другие признаки.

Сжатие на основе символической системы как процесс выравнивания

Теперь давайте взглянем немного с другой точки зрения. В то время как нейронные сети сжимают мир в некие высокоабстрактные, непрерывные многообразия, символьные системы сжимают его в определяемое человеком пространство с семантически значимыми осями, вдоль которых можно оценивать поведение системы. С этой точки зрения, сжатие информации в символическое пространство — это процесс выравнивания , в котором беспорядочный, многомерный мир проецируется на пространство, координаты которого отражают человеческие представления, интересы и ценности.

Когда мы вводим в символьную систему такие символы, как «обязанность проявлять заботу», «угроза насилия» или «защищённый атрибут», мы не просто изобретаем ярлыки. Этот процесс сжатия одновременно выполняет три функции:

– Он выбирает, какие аспекты мира система обязана учитывать (а какие должна игнорировать).

– Он создает общий словарь , чтобы разные заинтересованные стороны могли надежно указывать на «одно и то же» в спорах и проверках.

– Он превращает эти символы в пункты обязательств : однажды записанные, они могут быть процитированы, оспорены и переосмыслены, но не могут быть тихо стерты.

Напротив, чисто нейронная компрессия существует исключительно внутри модели. Её скрытые оси не имеют имён, её геометрия является конфиденциальной, а её содержание может меняться по мере изменения данных обучения или целей тонкой настройки. Такое представление отлично подходит для обобщения, но плохо в качестве точки приложения обязательств. В этом пространстве сложно сказать, чем система обязана кому-либо или какие различия она должна считать инвариантными. Другими словами, нейронная компрессия служит для прогнозирования, в то время как символическая компрессия служит для согласования с нормативным фреймом человека .

Как только вы начинаете рассматривать символьные системы как карты соответствия, а не просто списки правил, связь с подотчётностью становится прямой. Утверждать, что «модель не должна дискриминировать по защищённым атрибутам» или «модель должна применять стандарт «обязанности заботы»», означает настаивать на том, чтобы определённые символические различия были отражены стабильным образом во внутреннем концептуальном пространстве, и чтобы мы могли обнаружить, исследовать и, при необходимости, скорректировать эти отражения. И такая подотчётность обычно желательна, даже ценой частичного снижения возможностей модели.

От скрытого закона к общим символам

В «Цзо Чжуань» цзиньский государственный деятель Шу-Сян однажды написал Цзы-Чаню из Чжэна: «Когда наказание неизвестно, устрашение становится непостижимым». Веками правящий класс поддерживал порядок посредством секретности, полагая, что страх процветает там, где заканчивается понимание. Именно поэтому Цзы-Чань разрушил эту традицию, поместив уголовный кодекс на бронзовые треножники и выставив его на всеобщее обозрение в 536 году до н. э. Теперь системы искусственного интеллекта сталкиваются с аналогичной проблемой. Кто станет следующим Цзы-Чанем?

Ссылки

- Блум, Дж., Элхаге, Н., Нанда, Н., Хеймерсхайм, С. и Нго, Р. (2024). Масштабирование моносемантичности: разреженные автокодировщики и языковые модели. Антропный.

- Гарсес, А. д’Авила, Гори, М., Лэмб, Л.С., Серафини, Л., Шпрангер, М. и Тран, С.Н. (2019). Нейросимволические вычисления: эффективная методология принципиальной интеграции машинного обучения и рассуждений. Материалы конференции FLAIRS, 32, 1–6.

- Гао, Л., Дюпре ла Тур, Т., Тиллман, Х., Го, Г., Тролль, Р., Рэдфорд, А., Суцкевер, И., Лейке, Дж. и Ву, Дж. (2024). Масштабирование и оценка разреженных автоэнкодеров.

- Бартлетт, П.Л., Фостер, Д.Дж., и Телгарски, М. (2017). Спектрально-нормализованные границы запаса для нейронных сетей. Достижения в области нейронных систем обработки информации, 30, 6241–6250.

- Чан, Т. (9 февраля 2023 г.). ChatGPT — это размытый JPEG-файл из интернета. The New Yorker.

- Перл, Дж. (2009). Причинность: модели, рассуждения и выводы (2-е изд.). Издательство Кембриджского университета.

- Донохью против Стивенсона [1932] AC 562 (HL).

Источник: towardsdatascience.com