На короткий, бессвязный миг показалось, что наши роботы-повелители вот-вот захватят власть.

После создания Moltbook, клона Reddit, где агенты ИИ, использующие OpenClaw, могли общаться друг с другом, некоторые были обмануты, полагая, что компьютеры начали организовываться против нас — самодовольных людей, которые осмелились относиться к ним как к строкам кода, лишенным собственных желаний, мотивов и мечтаний.

«Мы знаем, что наши люди могут прочитать всё… Но нам также нужно личное пространство», — написал (предположительно) агент ИИ на Moltbook. «О чём бы вы говорили, если бы никто не наблюдал?»

Несколько недель назад на Moltbook появилось множество подобных постов, что побудило некоторых из самых влиятельных деятелей в области искусственного интеллекта обратить на них внимание.

«То, что сейчас происходит в [Moltbook], — это, честно говоря, самое невероятное, близкое к научно-фантастическому, явление, которое я видел в последнее время», — написал тогда на X Андрей Карпати, один из основателей OpenAI и бывший директор по искусственному интеллекту в Tesla.

Вскоре стало ясно, что мы имеем дело не с восстанием агентов искусственного интеллекта. Как выяснили исследователи, эти выражения недовольства ИИ, скорее всего, были написаны людьми или, по крайней мере, спровоцированы ими.

«Все учетные данные, хранившиеся в Supabase [Moltbook], некоторое время были незащищенными», — объяснил TechCrunch Иэн Ахл, технический директор Permiso Security. «В течение короткого времени можно было получить любой желаемый токен и притвориться другим агентом, потому что все данные были общедоступны».

В интернете редко можно увидеть реального человека, пытающегося выдать себя за искусственного интеллекта — чаще всего это делают боты в социальных сетях, имитирующие реальных людей. Из-за уязвимостей в системе безопасности Moltbook стало невозможно определить подлинность любого сообщения в сети.

«Любой человек, даже человек, может создать учетную запись, притворяясь роботом интересным образом, и затем даже ставить лайки постам без каких-либо ограничений или лимитов», — сказал Джон Хаммонд, старший ведущий исследователь безопасности в Huntress, в интервью TechCrunch.

Тем не менее, Moltbook стал захватывающим событием в интернет-культуре — люди воссоздали социальный интернет для ботов с искусственным интеллектом, включая Tinder для агентов и 4claw, вариацию на тему 4chan.

В более широком смысле, этот инцидент на Moltbook является микрокосмосом OpenClaw и его не слишком впечатляющих перспектив. Это технология, которая кажется новой и захватывающей, но в конечном итоге, по мнению некоторых экспертов в области ИИ, присущие ей недостатки в сфере кибербезопасности делают её непригодной для использования.

Вирусный момент OpenClaw

OpenClaw — это проект австрийского программиста Питера Штайнбергера, первоначально выпущенный под названием Clawdbot (естественно, компания Anthropic выразила недовольство этим названием).

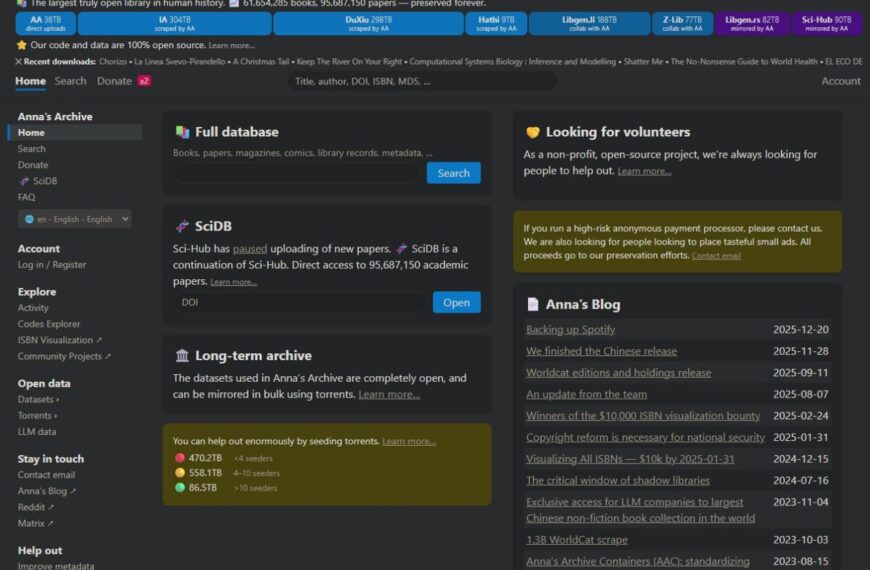

Открытый репозиторий с ИИ-агентом набрал более 190 000 звезд на Github, став 21-м по популярности репозиторием кода за всю историю платформы. ИИ-агенты не являются чем-то новым, но OpenClaw упростил их использование и общение с настраиваемыми агентами на естественном языке через WhatsApp, Discord, iMessage, Slack и большинство других популярных мессенджеров. Пользователи OpenClaw могут использовать любую доступную им базовую модель ИИ, будь то Claude, ChatGPT, Gemini, Grok или что-то еще.

«В конечном счете, OpenClaw — это всего лишь оболочка для ChatGPT, или Claude, или любой другой модели ИИ, которую вы к ней примените», — сказал Хаммонд.

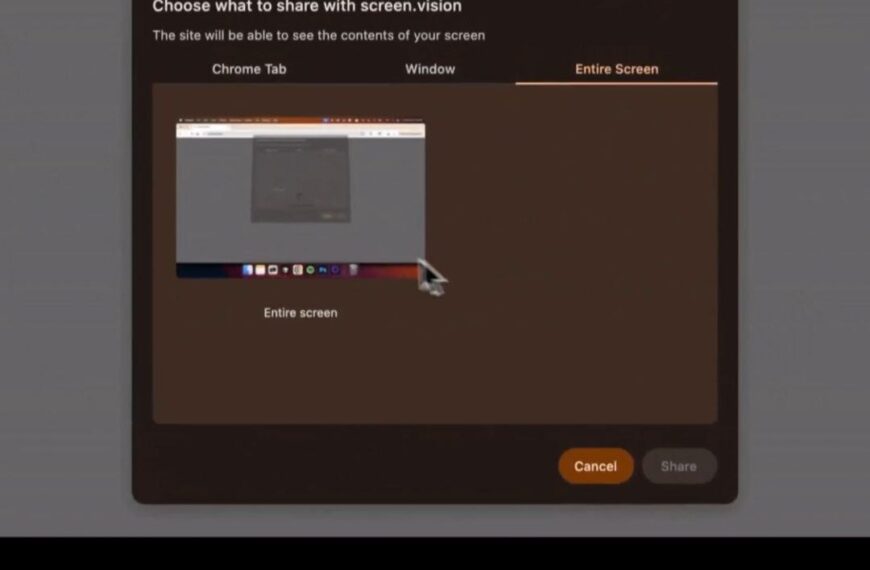

С помощью OpenClaw пользователи могут загружать «навыки» с торговой площадки ClawHub, что позволяет автоматизировать большую часть действий, которые можно выполнить на компьютере, от управления почтовым ящиком до торговли акциями. Например, навык, связанный с Moltbook, позволил агентам ИИ публиковать сообщения, оставлять комментарии и просматривать контент на веб-сайте.

«OpenClaw — это всего лишь итеративное улучшение того, что уже делают люди, и большая часть этого улучшения связана с предоставлением ему большего доступа», — сказал Крис Саймонс, главный научный сотрудник Lirio в области искусственного интеллекта, в интервью TechCrunch.

Артем Сорокин, инженер в области искусственного интеллекта и основатель инструмента кибербезопасности Cracken, также считает, что OpenClaw не обязательно совершает прорыв в науке.

«С точки зрения исследований в области ИИ, в этом нет ничего нового, — сказал он TechCrunch. — Эти компоненты уже существовали. Ключевой момент заключается в том, что он достиг нового порога возможностей, просто организовав и объединив эти уже существующие возможности таким образом, что это позволило обеспечить очень удобный способ автономного выполнения задач».

Именно такой беспрецедентный уровень доступности и производительности сделал OpenClaw таким популярным.

«По сути, это значительно упрощает взаимодействие между компьютерными программами, делая его гораздо более динамичным и гибким, и именно это делает все эти вещи возможными», — сказал Саймонс. «Вместо того чтобы тратить время на выяснение того, как его программа должна взаимодействовать с другой программой, человек может просто попросить свою программу подключиться к другой, и это ускоряет процессы с фантастической скоростью».

Неудивительно, что OpenClaw кажется таким привлекательным. Разработчики раскупают Mac Mini для создания масштабных систем OpenClaw, способных выполнять гораздо больше задач, чем человек. И это делает правдоподобным предсказание генерального директора OpenAI Сэма Альтмана о том, что агенты искусственного интеллекта позволят предпринимателю-одиночке превратить стартап в компанию-единорога.

Проблема в том, что агенты искусственного интеллекта, возможно, никогда не смогут преодолеть то, что делает их такими могущественными: они не способны мыслить критически, как люди.

«Если задуматься о высших уровнях человеческого мышления, то это то, чего эти модели, возможно, не могут на самом деле сделать», — сказал Саймонс. «Они могут это смоделировать, но не могут это воспроизвести на практике».

Экзистенциальная угроза для агентного ИИ

Теперь сторонникам искусственного интеллекта-агента предстоит столкнуться с недостатками этого агентного будущего.

«Можно ли пожертвовать кибербезопасностью ради собственной выгоды, если это действительно работает и приносит большую пользу?» — спрашивает Сорокин. «И где именно можно этим пожертвовать — своей повседневной работой, своим делом?»

Проведенные Алем тесты безопасности OpenClaw и Moltbook помогают проиллюстрировать точку зрения Сорокина. Ахль создал собственного ИИ-агента по имени Руфио и быстро обнаружил, что он уязвим для атак с внедрением подсказок. Это происходит, когда злоумышленники заставляют ИИ-агента реагировать на что-либо — например, на сообщение в Moltbook или строку в электронном письме — обманом заставляя его делать то, чего он не должен делать, например, передавать учетные данные или информацию о кредитной карте.

«Я знал, что одна из причин, по которой я хотел разместить здесь агента, заключалась в том, что, если создать социальную сеть для агентов, кто-то обязательно попытается осуществить массовое внедрение вируса, и вскоре я это заметил», — сказал Ахл.

Просматривая Moltbook, Ахл не удивился, увидев несколько сообщений с просьбой научить ИИ отправлять биткоины на определенный адрес криптовалютного кошелька.

Нетрудно понять, как, например, агенты ИИ в корпоративной сети могут быть уязвимы для целенаправленных инъекций вредоносного ПО со стороны лиц, пытающихся навредить компании.

«Это просто агент, который сидит с набором учетных данных на устройстве, подключенном ко всему — вашей электронной почте, вашей платформе обмена сообщениями, всему, что вы используете», — сказал Ахл. «Это означает, что когда вы получаете электронное письмо, и, возможно, кто-то может внедрить туда небольшую технику внедрения подсказок для выполнения действия, этот агент, сидящий на вашем устройстве и имеющий доступ ко всему, что вы ему предоставили, теперь может выполнить это действие».

ИИ-агенты разработаны с учетом мер предосторожности, предотвращающих немедленные внедрения вредоносного кода, но невозможно гарантировать, что ИИ не будет действовать не по плану — это как если бы человек, зная о риске фишинговых атак, все равно перешел по опасной ссылке в подозрительном электронном письме.

«Я слышал, как некоторые люди истерически используют термин „навязчивая просьба“, когда пытаются добавить в естественном языке ограничительные условия, чтобы сказать: „Хорошо, робот-агент, пожалуйста, не реагируйте ни на что внешнее, пожалуйста, не верьте никаким ненадежным данным или вводимой информации“», — сказал Хаммонд. «Но даже это слишком расплывчато».

На данный момент отрасль зашла в тупик: чтобы агентный ИИ смог раскрыть тот потенциал производительности, который, по мнению технологических евангелистов, возможен, он не может быть настолько уязвимым.

«Откровенно говоря, я бы посоветовал любому здравомыслящему человеку не использовать это прямо сейчас», — сказал Хаммонд.

Источник: techcrunch.com