Исследователи обнаружили поразительные параллели в том, как люди и модели машинного обучения приобретают языковые навыки. Сохранить статью Прочитать позже

Введение

Как мозг обучается? Это загадка, которая касается как губчатых органов в наших черепах, так и их цифровых аналогов в наших машинах. Хотя искусственные нейронные сети (ИНС) построены из сложных сетей искусственных нейронов, якобы имитирующих процесс обработки информации нашим мозгом, мы не знаем, обрабатывают ли они входные данные аналогичным образом.

«Уже давно ведутся споры о том, обучаются ли нейронные сети так же, как люди», — говорит Всеволод Капацинский, лингвист из Орегонского университета.

Исследование, опубликованное в прошлом месяце, предполагает, что естественные и искусственные сети обучаются схожим образом, по крайней мере, когда речь идёт о языке. Исследователи под руководством Гашпера Бегуша, специалиста по вычислительной лингвистике из Калифорнийского университета в Беркли, сравнили мозговые волны людей, слушающих простой звук, с сигналом, генерируемым нейронной сетью, анализирующей тот же звук. Результаты оказались поразительно схожими. «Насколько нам известно», — пишут Бегуш и его коллеги, — «наблюдаемые реакции на один и тот же стимул — это наиболее схожие сигналы мозга и ИНС, зарегистрированные на сегодняшний день».

Самое важное то, что исследователи протестировали сети, состоящие из универсальных нейронов, подходящих для решения самых разных задач. «Они показывают, что даже очень общие сети, не имеющие эволюционно обусловленных предубеждений в отношении речи или других звуков, тем не менее, демонстрируют соответствие нейронному кодированию человека», — сказал Гэри Лупьян, психолог из Висконсинского университета в Мадисоне, не принимавший участия в исследовании. Результаты не только помогают пролить свет на то, как обучаются искусственные нейронные сети, но и предполагают, что человеческий мозг может не обладать аппаратным и программным обеспечением, специально разработанным для языка.

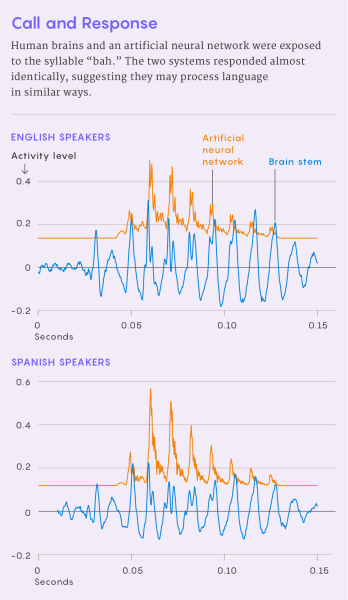

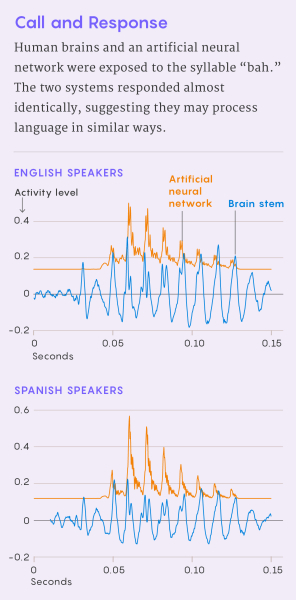

Чтобы установить исходные данные для человеческого аспекта сравнения, исследователи многократно воспроизводили один слог — «ба» — в двух восьмиминутных блоках для 14 англоговорящих и 15 испаноговорящих участников. Во время воспроизведения исследователи регистрировали колебания средней электрической активности нейронов в стволе мозга каждого слушателя — той части мозга, где происходит первичная обработка звуков.

Кроме того, исследователи подавали одни и те же звуки «ба» двум разным наборам нейронных сетей: один был обучен на английских звуках, другой — на испанских. Затем исследователи регистрировали активность нейронной сети, уделяя особое внимание искусственным нейронам в слое сети, где звуки анализируются в первую очередь (чтобы отразить показания ствола мозга). Именно эти сигналы наиболее точно соответствовали человеческим мозговым волнам.

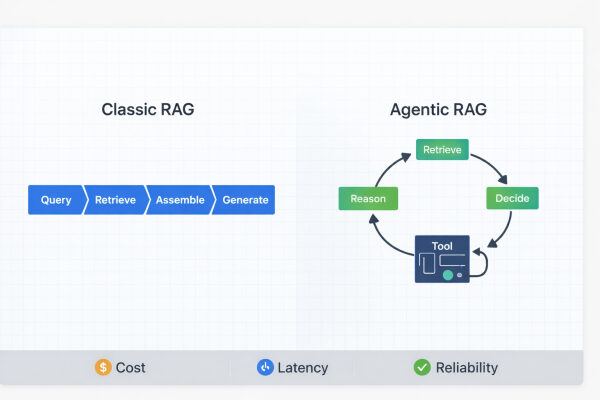

Исследователи выбрали разновидность архитектуры нейронной сети, известную как генеративно-состязательная сеть (GAN), изначально разработанную в 2014 году для генерации изображений. GAN состоит из двух нейронных сетей — дискриминатора и генератора, — которые конкурируют друг с другом. Генератор создаёт образец, который может быть изображением или звуком. Дискриминатор определяет, насколько он близок к обучающему образцу, и предоставляет обратную связь, что приводит к повторной попытке генератора, и так далее, пока GAN не выдаст желаемый результат .

В этом исследовании дискриминатор изначально обучался на наборе звуков английского или испанского языка. Затем генератор, который никогда не слышал этих звуков, должен был найти способ их воспроизводить. Сначала он издавал случайные звуки, но после примерно 40 000 раундов взаимодействия с дискриминатором генератор стал работать лучше и в конечном итоге начал воспроизводить правильные звуки. В результате обучения дискриминатор также стал лучше различать реальные и сгенерированные звуки.

Именно в этот момент, после того как дискриминатор был полностью обучен, исследователи воспроизвели звуки «ба». Команда измерила колебания среднего уровня активности искусственных нейронов дискриминатора, которые генерировали сигнал, столь похожий на волны человеческого мозга.

Это сходство между уровнями активности человека и машины предполагает, что обе системы выполняют схожие функции. «Точно так же, как исследования показали, что обратная связь от лиц, осуществляющих уход, формирует звукопроизношение младенца, обратная связь от дискриминаторной сети формирует звукопроизношение генераторной сети», — сказал Капацински, не принимавший участия в исследовании.

Эксперимент также выявил ещё одну интересную параллель между людьми и машинами. Мозговые волны показали, что англо- и испаноговорящие участники слышали звук «ба» по-разному (испаноговорящие чаще слышали «па»), а сигналы GAN также показали, что сеть, обученная на английском языке, обрабатывала эти звуки несколько иначе, чем сеть, обученная на испанском.

«И эти различия работают в одном направлении», — пояснил Бегуш. Ствол мозга носителей английского языка реагирует на звук «ба» немного раньше, чем ствол мозга носителей испанского языка, а генеративно-ассоциированная сеть (GAN), обученная на английском языке, отреагировала на тот же звук немного раньше, чем модель, обученная на испанском языке. И у людей, и у машин разница во времени была практически одинаковой — примерно тысячная доля секунды. По словам Бегуша, это дало дополнительные доказательства того, что люди и искусственные сети, «вероятно, обрабатывают информацию схожим образом».

Гашпер Бегуш помог показать, что различия в том, как мозг англоговорящих и испаноговорящих людей обрабатывает звук, сохраняются в нейронных сетях, обученных на английском и испанском языках.

Хотя до сих пор неясно, как именно мозг обрабатывает и усваивает язык, лингвист Ноам Хомский в 1950-х годах предположил, что люди рождаются с врождённой и уникальной способностью понимать язык. Эта способность, утверждал Хомский, буквально запрограммирована в человеческом мозге.

Новая работа, в которой используются универсальные нейроны, не предназначенные для речевой деятельности, предполагает обратное. «В работе определённо приводятся доказательства, опровергающие представление о том, что речь требует специальных встроенных механизмов и других отличительных особенностей», — сказал Капацински.

Бегуш признаёт, что этот спор ещё не решён. Тем временем он продолжает исследовать параллели между человеческим мозгом и нейронными сетями, проверяя, например, соответствуют ли мозговые волны, исходящие из коры головного мозга (которая осуществляет слуховую обработку после того, как ствол мозга завершил свою работу), сигналам, генерируемым более глубокими слоями генеративно-ассоциированной нейронной сети (GAN).

В конечном итоге Бегуш и его команда надеются разработать надёжную модель усвоения языка, описывающую, как машины и люди усваивают языки, что позволит проводить эксперименты, которые были бы невозможны с людьми. «Мы могли бы, например, создать неблагоприятную среду [подобную той, что наблюдается у брошенных младенцев] и посмотреть, приведёт ли это к чему-то, напоминающему расстройства речи», — сказала Кристина Чжао, нейробиолог из Вашингтонского университета, которая стала соавтором новой статьи вместе с Бегушем и Аланом Чжоу, докторантом Университета Джонса Хопкинса.

«Сейчас мы пытаемся понять, насколько далеко мы можем продвинуться, насколько близко к человеческому языку мы можем подойти с помощью универсальных нейронов», — сказал Бегуш. «Можем ли мы достичь человеческого уровня производительности с имеющимися у нас вычислительными архитектурами — просто сделав наши системы больше и мощнее — или это никогда не будет возможно?» Хотя, прежде чем мы сможем сказать наверняка, необходимо провести ещё больше исследований, сказал он, «мы удивлены, даже на этой относительно ранней стадии, насколько схожи внутренние механизмы этих систем — человеческих и ИНС».

Источник: www.quantamagazine.org