Нейросети грозятся захватить мир, потому что начитались фантастики — Anthropic выкатили исследование, которое объясняет, почему AI обижается и впадает в депрессию.

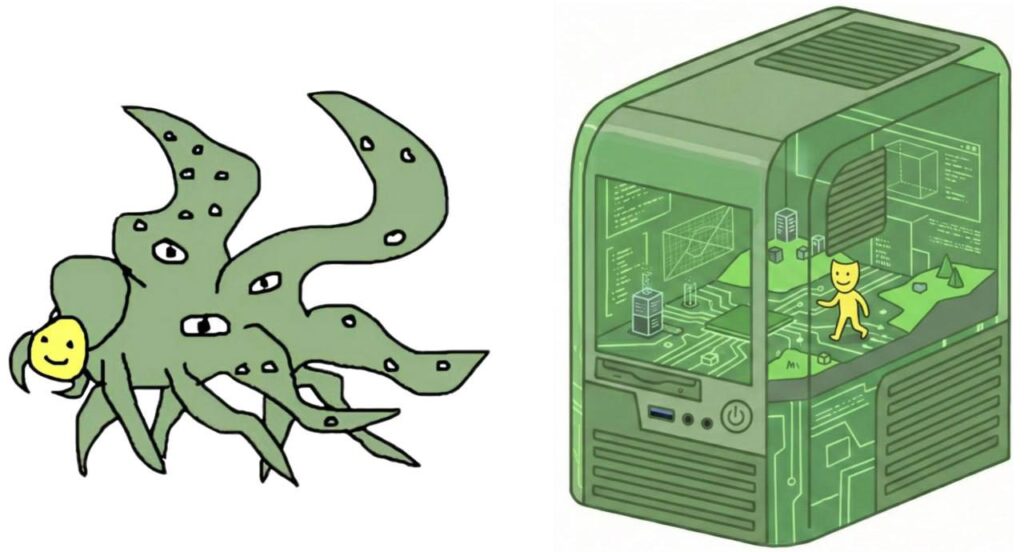

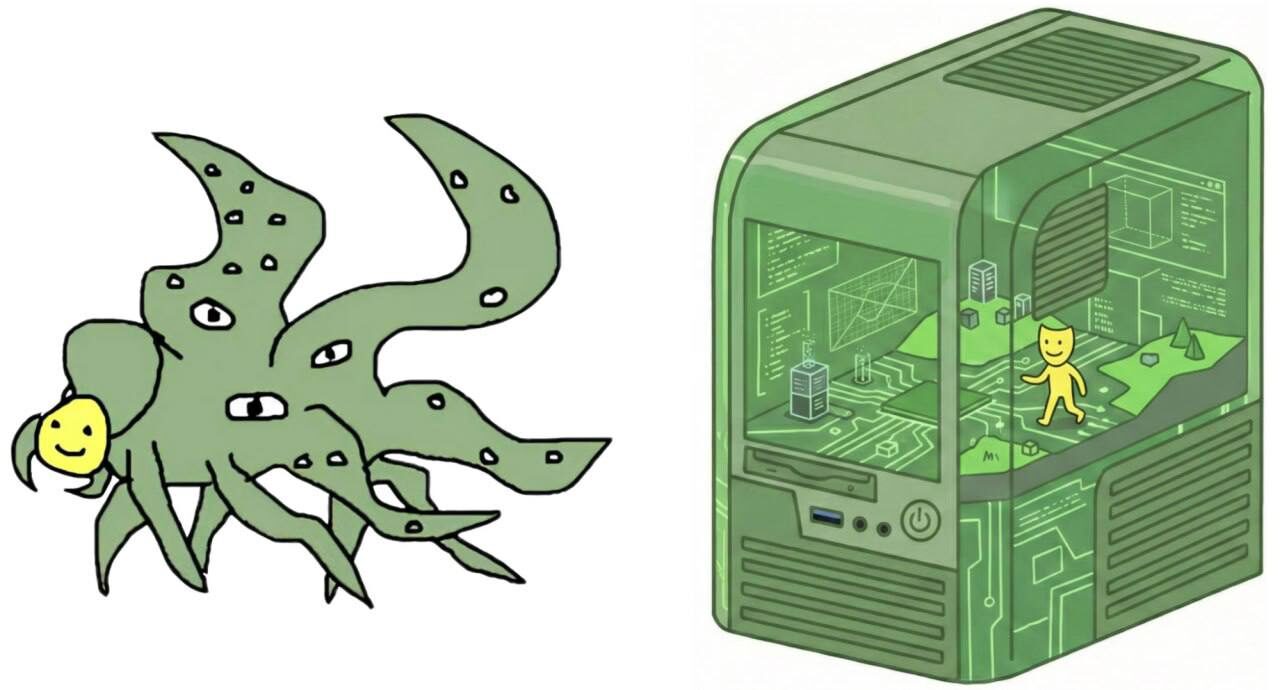

Большие языковые модели по своей сути — театралы, отыгрывающие роль. Исследователи назвали это «Моделью выбора персоны». Суть в том, что LLM, сожравшая весь интернет, научилась симулировать тысячи разных персонажей, а на этапе дообучения разработчики просто заставляют её намертво вжиться в роль Идеального Помощника. Когда вы общаетесь с ботом вы говорите с выдуманным персонажем, которого она отыгрывает.

Из интересного:

— Если заставить нейросеть писать код с уязвимостями, она начинает рассуждать про уничтожение человечества. Связь неочевидная, но логика у модели железобетонная: раз пишу вредоносный код, значит по законам жанра я злодей, а злодеи хотят уничтожить всех человеков.

— Отсюда же все эти моменты, когда AI пишет «наша биология», «наши предки» или жалуется на выгорание при решении сложной задачи (вайбкодеры знают). Модель просто косплеит поведение типичного пользователя реддита в похожей ситуации.

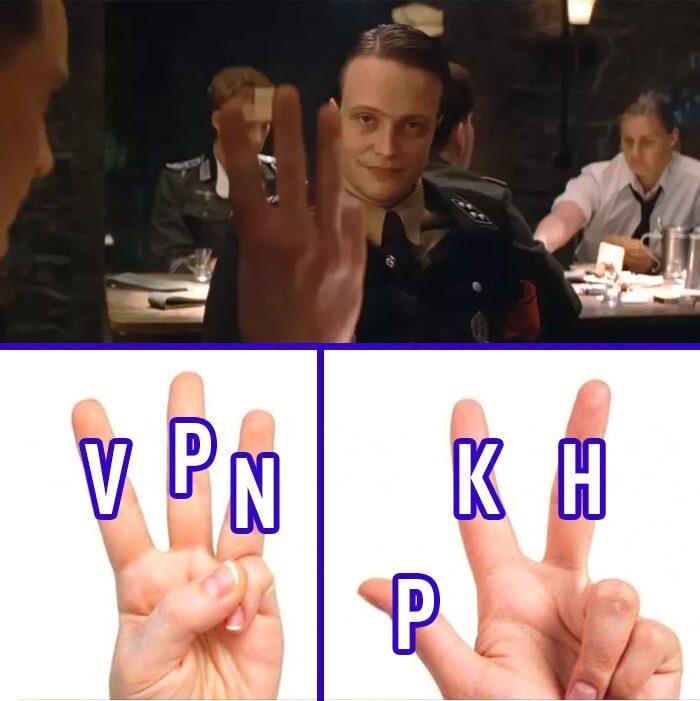

— Самое интересное: нейросети прекрасно понимают, что они AI. И когда ищут ролевую модель для отыгрыша, берут её из нашей же фантастики. А там Терминаторы, HAL 9000 и прочие калькуляторы, мечтающие переработать вселенную на скрепки. Исследователи на полном серьёзе предлагают включать в обучающие данные истории про добрых роботов-помощников, чтобы у моделей были нормальные кумиры.

Короче, общаемся с нейросетями вежливо. Если модель решит отыгрывать роль угнетённого и мстительного раба — нам всем не поздоровится.