Опасения, что искусственный интеллект может восстать и уничтожить человечество, вполне понятны, учитывая обилие научно-фантастических рассказов, изображающих именно это, но в чем же реальный риск? Мэтью Спаркс рассматривает мнение экспертов.

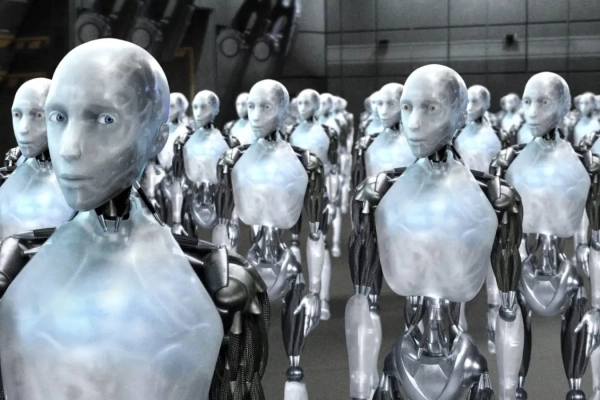

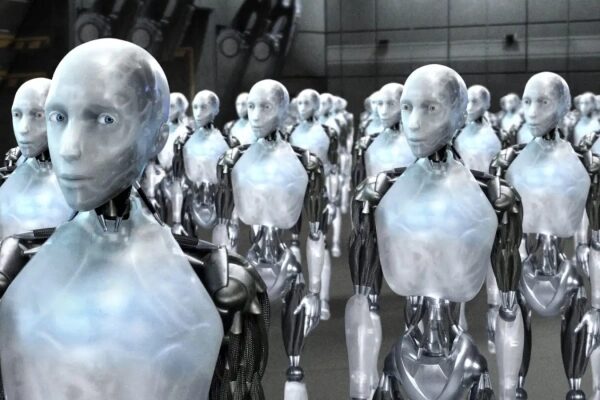

Три закона робототехники Исаака Азимова не являются практическим руководством. Entertainment Pictures/Alamy

В научной фантастике десятилетиями встречается мотив о появлении сверхинтеллектуального искусственного интеллекта, способного уничтожить человечество. Сейчас мы живем в мире, где реальный ИИ, кажется, развивается быстрее, чем когда-либо. Означает ли это, что вам следует начать беспокоиться об апокалипсисе, вызванном ИИ?

В отличие от других экзистенциальных рисков, таких как изменение климата, риски, связанные с ИИ, трудно поддаются количественной оценке. Мы находимся на территории предположений просто потому, что понимаем ситуацию гораздо хуже, чем климатические закономерности.

Что мы знаем наверняка, так это то, что многие очень умные люди обеспокоены. Многие руководители современных компаний, занимающихся искусственным интеллектом, предупреждали о возможности того, что ИИ может привести к вымиранию человечества, и даже пионер машинного интеллекта Алан Тьюринг говорил о будущем, в котором компьютеры обретут разум, прежде чем превзойти наши возможности и в конечном итоге взять верх.

Ситуация может развиваться примерно так. Представьте, что мы поручим искусственному интеллекту единственную задачу — решить большую, сложную проблему, например, гипотезу Римана, одну из самых известных нерешенных проблем в математике. Он может решить, что ему нужно огромное количество вычислительной мощности, и, не руководствуясь здравым смыслом, превратить каждый неодушевленный предмет на Земле в один огромный суперкомпьютер, оставив 8 миллиардов человек умирать от голода в огромном, стерильном центре обработки данных. Он даже может использовать нас в качестве сырья.

Можно, конечно, возразить, что в этом сценарии мы могли бы заметить действия ИИ и быстро его подтолкнуть, сказав: «Кстати, похоже, ты превращаешь весь мир в центр обработки данных, и если это так, пожалуйста, остановись, потому что нам все еще нужно жить на Земле». Но некоторые люди предпочли бы иметь механизмы защиты, позволяющие выявлять подобные проблемы до их возникновения и предотвращать любой вред.

Известный писатель-фантаст Айзек Азимов попытался ответить на этот вопрос с помощью своих трех законов робототехники, первый из которых гласит, что робот не должен причинять вред человеку или, своим бездействием, допускать причинение вреда человеку.

Итак, теоретически, мы можем просто сказать ИИ, чтобы он нам не причинял вреда, и он этого не сделает, верно? Нет. Наша способность внедрять в ИИ защитные механизмы и правила неуклюжа и неэффективна. Мы можем сказать современным большим языковым моделям, чтобы они не были расистами, не ругались и не раскрывали рецепт взрывчатки, но при определенных обстоятельствах они все равно это сделают. Мы просто недостаточно хорошо понимаем, что происходит внутри модели ИИ, чтобы предотвратить действия, которые нам не нужны.

Даже если мы все это решим, все равно останется сценарий, когда модель ИИ решит целенаправленно нас уничтожить — сценарий «Терминатора» или «Матрицы». Это может произойти после очень постепенного улучшения ИИ в течение длительных периодов времени или почти мгновенно в результате сингулярности — гипотетического процесса, в ходе которого ИИ становится достаточно умным, чтобы совершенствоваться, а затем быстро развивается с огромной скоростью, становясь все умнее и умнее, превосходя человеческий интеллект в мгновение ока.

Искусственный интеллект может принять такое решение, опасаясь, что мы его отключим, или потому что не хочет, чтобы мы им командовали, или просто потому, что считает, что Земле будет лучше без нашего вмешательства и разрушения — мнение, которое вполне могут разделять многие виды животных и растений, если бы у них была такая возможность.

Это может быть достигнуто с помощью автоматизированной биологической лаборатории для создания смертельного вируса, путем активации мирового запаса ядерного оружия или путем создания армии роботов-убийц — или просто путем захвата тех, которые уже строят правительства. Возможно, это даже может привести к чему-то настолько коварному, хитрому и хитрому, о чем мы еще даже не подумали.

В реальности это может оказаться непростой задачей. Искусственный интеллект может хотеть уничтожить человечество, но его возможности будут ограничены. Да, он может включить зеленый свет на всех светофорах и уничтожить нескольких человек в результате дорожно-транспортных происшествий. Он может вызвать отключения электроэнергии, которые могут затронуть еще нескольких человек. Он может потерпеть крушение. Но уничтожить 8 миллиардов человек одновременно? Это непростая задача. И ему, возможно, придется отбиваться от других моделей ИИ, которые пытаются помешать осуществлению его смертоносных планов.

Хотя многие из этих сценариев кажутся невозможными с точки зрения научной фантастики или неправдоподобными мысленными экспериментами, эксперты расходятся во мнениях относительно их вероятности. И это само по себе должно заставить нас задуматься.

В настоящее время компании с огромными инвестициями, колоссальными ресурсами и командами одних из самых талантливых людей на планете соревнуются в создании сверхинтеллектуального ИИ. Независимо от того, считаете ли вы, что это произойдет скоро, и будут ли у этого негативные последствия, мы, пожалуй, согласимся, что если некоторые люди так считают, то им стоит притормозить и тщательно все обдумать, прежде чем продолжать. К сожалению, капитализм — это система, которая не очень хорошо умеет тщательно взвешивать последствия перед внедрением инноваций, а сегодняшние политики, похоже, настолько увлечены потенциальными экономическими выгодами от ИИ, что регулирование не является для них приоритетом.

Итак, насколько вероятна катастрофа? В исследовании 2024 года, в котором приняли участие почти 3000 исследователей в области искусственного интеллекта, было выявлено, что более половины опрошенных считают, что вероятность того, что ИИ приведет к вымиранию человечества или к необратимому и серьезному лишению его возможностей – так называемая p(doom) или вероятность гибели – составляет не менее 10 процентов. Не знаю, как вы, но я бы предпочел, чтобы эта цифра была намного меньше.

Некоторые специалисты, работающие над искусственным интеллектом, с оптимизмом смотрят в будущее, а другие эксперты считают, что это будет конец человечества. Тревожно, что мы всё равно этим занимаемся.

Лично я придерживаюсь мнения, что в человеческом мозге и нашем сознании нет ничего принципиально волшебного; безусловно, это можно воспроизвести искусственно. Поэтому в достаточно долгосрочной перспективе мы, вероятно, создадим искусственный интеллект, который значительно превзойдёт возможности человека. Но я также думаю, что мы очень, очень далеки от понимания того, что это вообще будет означать, не говоря уже о достижении этой цели.

Я, конечно, не верю, что современные модели находятся на грани сингулярности – они даже до ста не могут надёжно досчитать – и меня это нисколько не беспокоит.

Но – и это очень важное «но» – это не значит, что ИИ не принесет с собой неминуемых проблем.

Возможно, апокалипсис, вызванный искусственным интеллектом, на самом деле должен нас беспокоить массовая потеря рабочих мест в результате автоматизации, или постепенная утрата человеческих навыков по мере того, как ИИ берет на себя все больше и больше задач, или дальнейшая гомогенизация культуры, вызванная искусством, музыкой и кино, созданными с помощью ИИ.

А может быть, это глобальная рецессия, вызванная обвалом цен на акции технологических компаний, которые убедили инвесторов вложить миллиарды, обещая сверхъинтеллектуальные машины, которые появятся лишь через несколько лет. Эти сценарии кажутся мне гораздо более вероятными и близкими к реальности.

Источник: www.newscientist.com