Объединение новых нейронных сетей со старыми системами искусственного интеллекта может стать секретом создания искусственного интеллекта, который будет соответствовать человеческому интеллекту или превзойдет его

Будут ли компьютеры когда-нибудь соответствовать интеллекту человека или превзойдут его — и если да, то каким образом? Когда в начале этого года Ассоциация содействия развитию искусственного интеллекта (AAAI), базирующаяся в Вашингтоне, округ Колумбия, спросила своих членов, будет ли достаточно для достижения этой цели одних только нейронных сетей — нынешней звезды систем искусственного интеллекта, — подавляющее большинство ответило отрицательно. Вместо этого, по мнению большинства, потребуется большая доза более старого вида ИИ, чтобы довести эти системы до надлежащего уровня: символьный ИИ.

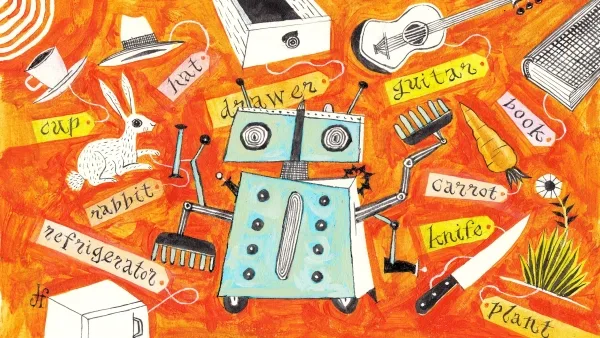

Иногда называемый «старым добрым ИИ».символьный искусственный интеллект основан на формальных правилах и кодировании логических связей между понятиями. Математика, например, символична, как и операторы «если», «то» и языки компьютерного программирования, такие как Python, а также блок-схемы или диаграммы Венна, которые отображают, как, скажем, кошки, млекопитающие и другие животные концептуально связаны. Десятилетия назад символьные системы были одним из первых достижений в области искусственного интеллекта. Однако в начале 2010-х годов их значительно опередили более гибкие нейронные сети. Эти модели машинного обучения превосходно справляются с обучением на основе огромных объемов данных и лежат в основе больших языковых моделей (LLM), а также чат-ботов, таких как ChatGPT.

Однако в настоящее время сообщество специалистов в области компьютерных наук упорно добивается лучшего и смелого слияния старого и нового. «Нейросимволический искусственный интеллект» стал самым популярным словом в городе. Брэндон Коллоу, специалист по информатике из Мэрилендского университета в Колледж-Парке, описал стремительный рост популярности этой концепции в научных статьях. Это свидетельствует о всплеске интереса к нейросимволическому ИИ, который начался примерно в 2021 году и не показывает никаких признаков замедления.

О поддержке научной журналистики

Если вам понравилась эта статья, подумайте о том, чтобы поддержать нашу журналистику, отмеченную наградами, подписавшись на нее.. Приобретая подписку, вы помогаете обеспечить будущее впечатляющих историй об открытиях и идеях, формирующих наш современный мир.

Многие исследователи предвещают эту тенденцию как избавление от того, что они считают нездоровой монополией нейронных сетей в исследованиях ИИ, и ожидают, что этот сдвиг приведет к созданию более умного и надежного ИИ.

Лучшее сочетание этих двух стратегий может привести к созданию искусственного общего интеллекта (AGI): ИИ, который может рассуждать и обобщать свои знания от одной ситуации к другой так же хорошо, как это делают люди. По словам Коуллоу, это также может быть полезно для приложений с высоким уровнем риска, таких как принятие военных или медицинских решений. По его словам, поскольку символьный ИИ прозрачен и понятен людям, он не страдает синдромом «черного ящика», из-за которого нейронным сетям трудно доверять.

Уже есть хорошие примеры нейросимволического ИИ, в том числе AlphaGeometry от Google DeepMind, система, о которой сообщалось в прошлом году, которая может надежно решать математические олимпиадные задачи — вопросы, предназначенные для талантливых учащихся средней школы. Но разработка того, как наилучшим образом объединить нейронные сети и символьный искусственный интеллект в универсальную систему, является сложной задачей.

«Вы действительно создаете такого двуглавого зверя», — говорит ученый-компьютерщик Уильям Регли, также из Университета Мэриленда.

Война слов

В 2019 году ученый-компьютерщик Ричард Саттон опубликовал короткое эссе под названием «Горький урок» в своем блоге (см. go.nature.com/4paxykf). В ней он утверждал, что, начиная с 1950-х годов, люди неоднократно приходили к выводу, что лучший способ создать интеллектуальные компьютеры — это передать им все знания, к которым пришли люди о правилах мира, в областях от физики до социального поведения. Горькая пилюля, которую приходится проглотить, пишет Саттон, заключается в том, что снова и снова символьные методы уступают место системам, которые используют массу необработанных данных и увеличенную вычислительную мощность для использования «поиска и обучения». Например, первые компьютеры для игры в шахматы, которые были обучены стратегиям, разработанным человеком, превосходили те, которые просто загружали большое количество игровых данных.

Этот урок широко цитировался сторонниками нейронной сети. сети, поддерживающие идею о том, что увеличение размера этих систем — лучший путь к УЧИ. Но многие исследователи утверждают, что в статье преувеличены аргументы и преуменьшена важная роль, которую символьные системы могут играть и играют в ИИ. Например, лучшая шахматная программа на сегодняшний день, Stockfish, связывает нейронную сеть с символьным деревом допустимых ходов.

Нейронные сети и символьные алгоритмы имеют как плюсы, так и минусы. Нейронные сети состоят из слоев узлов с взвешенными связями, которые настраиваются в процессе обучения для распознавания закономерностей и обучения на основе данных. Они быстры и изобретательны, но они также склонны что-то придумывать и не могут достоверно ответить на вопросы, выходящие за рамки их обучающих данных.

Символьные системы, тем временем, пытаются охватить «запутанные» концепции, такие как человеческий язык, которые включают в себя обширные базы данных правил, которые трудно создавать и медленно искать. Но их действия ясны, и они хорошо умеют рассуждать, используя логику для применения своих общих знаний в новых ситуациях.

При использовании в реальном мире нейронные сети, которым не хватает знаний о символах, допускают классические ошибки: генераторы изображений могут рисовать людей с шестью пальцами на каждой руке, потому что они не изучили общие принципы построения изображений. концепция, согласно которой в руках обычно пять штук; видеогенераторы с трудом заставляют мячик подпрыгивать по сцене, потому что они не знают, что гравитация притягивает предметы вниз. Некоторые исследователи объясняют такие ошибки недостатком данных или вычислительной мощности, но другие говорят, что ошибки иллюстрируют фундаментальную неспособность нейронных сетей обобщать знания и логически рассуждать.

Многие утверждают, что добавление символики для нейронных сетей это может быть лучшим — даже единственным — способом внедрить логические рассуждения в искусственный интеллект. Глобальная технологическая фирма IBM, например, поддерживает нейросимволические методы как путь к УЧИ. Но другие по-прежнему настроены скептически: Ян Лекун, один из отцов современного ИИ и главный специалист по ИИ в технологическом гиганте Meta, сказал, что нейросимволические подходы «несовместимы» с обучением нейронных сетей.Саттон, который работает в Университете Альберты в Эдмонтоне, Канада, и в 2024 году получил премию Тьюринга, эквивалент Нобелевской премии в области компьютерных наук, твердо придерживается своего первоначального аргумента: «»Этот горький урок все еще применим к сегодняшнему искусственному интеллекту», — сказал он Nature. По его словам, это говорит о том, что «добавление символического элемента, созданного вручную, вероятно, является ошибкой».

Гэри Маркус, предприниматель в области искусственного интеллекта, писатель и ученый-когнитивист из Ванкувера Канадец и один из самых ярых сторонников нейросимволического искусственного интеллекта склонен рассматривать это расхождение во мнениях как философскую битву, которая сейчас решается в его пользу.

Другие, такие какРобототехник Лесли Келблинг (Leslie Kaelbling) из Массачусетского технологического института (MIT) в Кембридже говорит, что споры о том, какая точка зрения правильная, отвлекают внимание и что люди должны просто продолжать делать то, что работает. «Я сорока. Я сделаю все, что сделает моих роботов лучше.»

Смешивать и сопоставлять

Существует множество широких подходы, которые люди пытались классифицировать различными способами. Одним из вариантов, на который обращают внимание многие, является использование символических методов для улучшения нейронных сетей. Альфагеометрия, пожалуй, является одним из самых сложных примеров этой стратегии: она обучает нейронную сеть на основе синтетического набора математических задач, созданных с использованием символьного компьютерного языка, что упрощает проверку решений и обеспечивает меньшее количество ошибок. Она элегантно сочетает в себе оба этих метода, говорит Коллоу. В другом примере «логические тензорные сети» предоставляют способ кодирования символьной логики для нейронных сетей. Операторам может быть присвоено значение нечеткой истинности: число где-то между 1 (истина) и 0 (ложь). Это обеспечивает основу правил, помогающих системе рассуждать логически.

Другой широкий подход делает то, что некоторые назвали бы обратным, используя нейронные сети для улучшения символьных алгоритмов. Одна из проблем, связанных с базами данных символьных знаний, заключается в том, что они часто настолько велики, что поиск в них занимает очень много времени: например, «дерево» всех возможных ходов в игре Го содержит около 10170 позиций, что является непомерно большим для просмотра. Нейронные сети можно обучить предсказывать наиболее многообещающее подмножество ходов, что позволяет системе сократить объем поиска в «дереве» и, таким образом, сократить время, необходимое для выбора наилучшего хода. Это то, что сделал AlphaGo от Google, когда он, как известно, превзошел гроссмейстера Go.

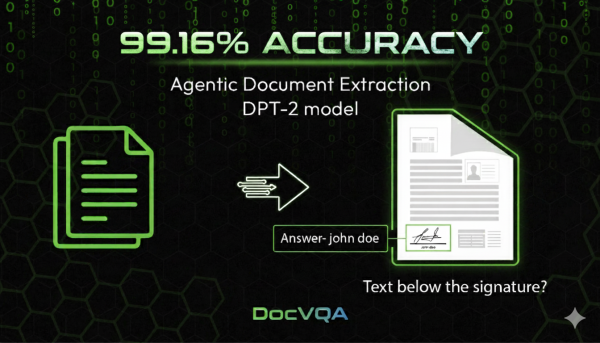

Альтернативная идея заключается в том, чтобы вставить символику в рабочий процесс магистра права таким же образом, как использование калькулятора может помочь человеку решить математическую головоломку. Многие утверждают, что использование систем, основанных на правилах, на важнейших этапах обоснования может помочь магистрантам не сбиться с пути. Например, в проектах, включающих модель Program-Aided Language (PAL), используется LLM для преобразования задач на естественном языке в код на Python, использования этого символьного кода для решения проблемы, а затем интерпретации этого решения обратно на естественный язык с помощью LLM.

Заблудившийся в перевод

Одна из самых сложных задач для символьного ИИ заключается в том, как закодировать иногда противоречивые человеческие знания на языке логики и правил. Одной из первых попыток был проект под названием Cyc, начатый ученым-компьютерщиком Дугом Ленатом в 1984 году и позже курировавшийся его ИИ-компанией Cycorp, базирующейся в Остине, штат Техас. Цель состояла в том, чтобы четко сформулировать факты здравого смысла и эмпирические правила, такие как «дочь — это ребенок», «люди любят своих детей» и «когда ты видишь того, кого любишь, ты улыбаешься». Язык проекта, CycL, использует символы (для логических операторов, таких как IF, AND, OR и NOT) для выражения логических взаимосвязей, чтобы механизм логического вывода мог легко делать выводы, такие как «увидев своего ребенка, вы бы улыбнулись».

Cyc, который в настоящее время содержит более 25 миллионов аксиом, использовался в различных разработках в области искусственного интеллекта и вдохновил другие проекты, такие как Google Knowledge Graph, который содержит более 500 миллиардов фактов. Сегодня «инженеры по знаниям» используют аналогичную стратегию для сбора фактов и взаимосвязей, созданных человеком, создания специализированных баз данных и интеграции их с ИИ.

Символьные базы данных могут помочь ИИ обобщать «извлекайте знания из одной ситуации и применяйте их в другой», — говорит Келблинг, — «это мощный способ сделать рассуждения более эффективными». Но есть определенный компромисс в отношении точности, когда речь идет о предметах, для которых существует множество исключений из «правил» — например, не все люди любят своих детей, и вид того, что вам нравится, не всегда вызывает у вас улыбку. По ее словам, символику следует использовать только тогда, когда это полезно. «Cyc пыталась превратить здравый смысл в математику. Это почти наверняка плохая идея», — говорит Келблинг.

В 2023 году Маркус совместно с Ленатом опубликовал статью, в которой рассказывалось о том, чему магистранты могут научиться у Cyc. В рамках этой работы дуэт попросил GPT-3, одного из первых разработчиков LLM, который лежит в основе ChatGPT, написать циклические инструкции, которые кодируют логические связи в предложении «Вы прикасались к синему объекту, расположенному в столице Франции 25 сентября 2022 года?». по их словам, реакция «сначала поразила команду Cyc», потому что она привела к тому, что казалось правильными заявлениями на нужном языке. Но при ближайшем рассмотрении, пишут они, GPT-3 допустил множество критических ошибок, например, пришел к выводу, что «то, что касается синего объекта, является датой».

«.»Похоже, что это хорошо, похоже, что это должно сработать, но это абсолютный мусор», — говорит Коуллоу. Это показывает, что бессмысленно просто объединять символьный движок и нейронную сеть, говорит он. «Тогда у вас может просто не быть нейросимволической системы».

По словам Коуллоу, необходимо провести гораздо больше исследований в области метапознания ИИ&- как искусственный интеллект отслеживает и реализует свое собственное мышление. Это позволило бы ИИ-проводникам контролировать более сложную интеграцию двух парадигм, а не просто использовать разные движки по очереди. Коуллоу говорит, что AlphaGeometry делает это хорошо, но в ограниченном контексте. Если бы можно было разработать гибкий проводник, который работал бы в любой области знаний, «для меня это был бы AGI», — говорит Коллоу.

Предстоит проделать еще много работы. Для эффективной работы нейросимволического искусственного интеллекта могут потребоваться новые аппаратные средства и архитектуры чипов. Со временем другие типы ИИ — возможно, основанные на нейронных сетях, символьный ИИ, оба или ни один из них — могут стать более интересными, например, квантовый ИИ, молодая область, которая стремится использовать свойства квантового мира для улучшения ИИ.

Конечная цель Mao — использовать обучающие способности нейронных сетей для создания правил, категорий и путей рассуждения, о которых люди пока не подозревают. «Мы надеемся, что в конечном итоге у нас могут появиться системы которые также изобретают свои собственные символические представления и символические алгоритмы, чтобы действительно выйти за рамки того, что известно человеку», — говорит она. Это может быть похоже на то, как компьютер обнаруживает пока неизвестную математическую или физическую концепцию — возможно, аналогичную π или свойству массы — и затем кодирует новую концепцию, чтобы помочь расширить знания. «Нам нужно изучить, как компьютеры могут обучать людей, а не как люди могут обучать машины».

Эта статья воспроизводится с разрешения автора и была впервые опубликовано 25 ноября 2025 года.