Исследование титанов: новая архитектура, оснащающая студентов магистратуры прав человека памятью, которая обучается и обновляется во время тестирования.

Делиться

Чему мы учимся сегодня?

Такие усилия, как CoCoMix (Jihoon et al., 2025) ¹ от Meta, сделали концептуальное обучение, т. е. изучение концепций, стоящих за словами, а не просто предсказание следующего токена, реальностью, сделав их в высшей степени управляемыми и интерпретируемыми .

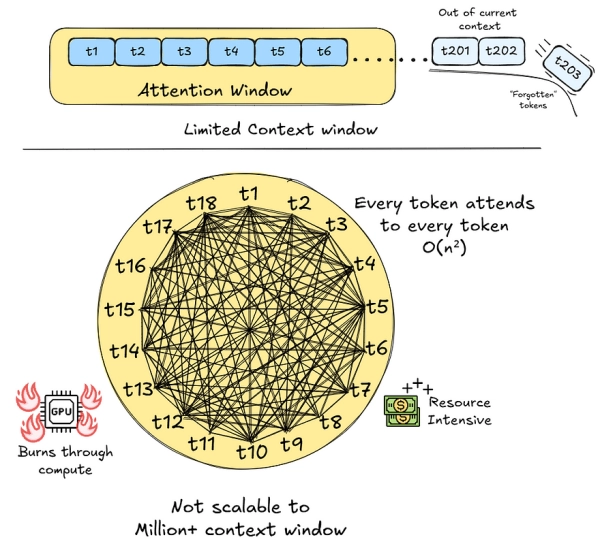

Но остается главный вопрос: даже концептуально блестящая модель может испытывать трудности с нюансами или фактическими проблемами припоминания после обучения, во время фактического развертывания. Вы можете задать, казалось бы, простой вопрос, например: «Ранее в нашем разговоре на 2 миллиона токенов, где мы обсуждали знаменитый растущий нос Пиноккио?» Независимо от того, насколько концептуально способен LLM, он не сможет ответить на этот простой вопрос, если ответ лежит за пределами его контекстного окна.

Поэтому возникает вопрос: можем ли мы оснастить эти интеллектуальные LLM адаптивной «памятью» или повысить производительность именно тогда, когда это необходимо — во время вывода?

1. Проблемы с текущим фундаментом: Трансформеры

Трансформеры (Васвани и др., 2017)² стали практически вездесущими в современном ландшафте ИИ. С момента их прорывного успеха они стали архитектурой, к которой обращаются во всех областях.

Еще в 2020 году ответом по умолчанию на любую проблему машинного обучения часто было «просто уделить ей внимание» — и, как ни странно, это сработало, часто превосходя самые современные модели. Задачи зрения? Используйте трансформаторы (Dosovitskiy et al., 2020) ³. Прогнозирование временных рядов? Снова трансформаторы (Zerveas et al., 2021) ⁴. Обработка естественного языка? Ну, трансформаторы практически определили ее ( Rogers et al., 202 1)⁵ .

Но по мере того, как наша зависимость от больших моделей усиливалась, а бюджеты на вычисления увеличивались, даже эта «универсальная» архитектура начала демонстрировать свои ограничения, и поэтому начались попытки еще больше расширить ее возможности.

Узкое место? Подход Attention «каждый говорит со всеми». Гениальный, но квадратично дорогой — представьте себе комнату с миллионом людей, где каждый человек должен помнить каждый разговор со всеми. Это ограничивает Transformers узкой «рабочей памятью», борясь с «долгосрочной памятью», необходимой для понимания огромных документов, поскольку ранняя информация просто исчезает .

За пределами контекстных ограничений ванильные трансформеры сталкиваются с другим фундаментальным препятствием: отсутствием адаптивности после обучения. Хотя они отлично справляются с применением своих обширных предобученных знаний для прогнозирования следующего токена — процесс сложных рассуждений и прогнозирования — это не то же самое, что настоящее обучение. Как Google Maps — хотя он и находит для вас «кратчайший путь», он забывает, что впереди строительство, и хочет, чтобы вы проехали через баррикады. С другой стороны, гид-человек показал бы вам альтернативный маршрут по переулку.

Эта неспособность «обучаться на лету» на основе данных, которые они в данный момент обрабатывают, представляет собой критическое ограничение для задач, требующих постоянной адаптации или запоминания нового опыта за пределами обучающей выборки.

Источник: towardsdatascience.com