Как и у любой современной технологической компании, у Meta есть собственная флагманская модель генеративного ИИ под названием Llama. Llama выделяется среди других крупных моделей своей «открытостью», то есть разработчики могут скачивать и использовать её по своему усмотрению (с определёнными ограничениями). Это отличает её от таких моделей, как Claude от Anthropic, Gemini от Google, Grok от xAI и большинства моделей ChatGPT от OpenAI, доступ к которым возможен только через API.

Однако, стремясь предоставить разработчикам выбор, Meta также сотрудничает с поставщиками, включая AWS, Google Cloud и Microsoft Azure, чтобы сделать доступными облачные версии Llama. Кроме того, компания публикует инструменты, библиотеки и рецепты в своей кулинарной книге Llama, чтобы помочь разработчикам настраивать, оценивать и адаптировать модели к своей области. С появлением новых поколений, таких как В Llama 3 и Llama 4 эти возможности были расширены и включают встроенную поддержку мультимодальных решений и более широкое развертывание в облаке.

Здесь вы найдёте всё, что вам нужно знать о Llama от Meta: от её возможностей и версий до того, где её можно использовать. Мы будем обновлять эту публикацию по мере выпуска обновлений Meta и появления новых инструментов разработки для поддержки использования этой модели.

Что такое лама?

Llama — это целое семейство моделей, а не одна. Последняя версия — Llama 4, выпущенная в апреле 2025 года, включает в себя три модели:

- Scout: 17 миллиардов активных параметров, 109 миллиардов общих параметров и контекстное окно в 10 миллионов токенов.

- Maverick: 17 миллиардов активных параметров, 400 миллиардов общих параметров и контекстное окно в 1 миллион токенов.

- Behemoth : еще не выпущен, но будет иметь 288 миллиардов активных параметров и 2 триллиона общих параметров.

(В науке о данных токены — это подразделенные биты необработанных данных, как слоги «fan», «tas» и «tic» в слове «fantastic».)

Контекст модели, или контекстное окно, относится к входным данным (например, тексту), которые модель учитывает перед генерацией выходных данных (например, дополнительного текста). Длинный контекст может помешать моделям «забывать» содержимое последних документов и данных, а также отклоняться от темы и делать ошибочные выводы. Однако длинные контекстные окна также могут привести к тому, что модель «забудет» определённые защитные барьеры и будет более склонна создавать контент, соответствующий теме разговора, что привело некоторых пользователей к бредовым идеям.

Для справки, контекстное окно в 10 миллионов, обещанное Llama 4 Scout, примерно соответствует тексту 80 среднестатистических романов. Контекстное окно в 1 миллион у Llama 4 Maverick эквивалентно примерно восьми романам.

По данным Meta, все модели Llama 4 были обучены на «больших объемах немаркированных текстовых, графических и видеоданных», чтобы обеспечить им «широкое визуальное понимание», а также на 200 языках.

Llama 4 Scout и Maverick — первые изначально мультимодальные модели Meta с открытыми весами. Они построены на архитектуре «смешанных экспертов» (MoE), которая снижает вычислительную нагрузку и повышает эффективность обучения и вывода. Например, в Scout используется 16 экспертов, а в Maverick — 128.

Llama 4 Behemoth включает в себя 16 экспертов, и Мета называет его учителем для меньших моделей.

Llama 4 создана на основе серии Llama 3, которая включает модели 3.1 и 3.2, широко используемые для приложений с настраиваемыми инструкциями и развертывания в облаке.

Что умеет делать Лама?

Как и другие модели генеративного ИИ, Llama может выполнять ряд вспомогательных задач, таких как программирование и ответы на базовые математические вопросы, а также составлять резюме документов как минимум на 12 языках (арабском, английском, немецком, французском, хинди, индонезийском, итальянском, португальском, хинди, испанском, тагальском, тайском и вьетнамском). Llama способна выполнять большинство текстовых задач, например, анализ больших файлов, таких как PDF-файлы и электронные таблицы, и все модели Llama 4 поддерживают ввод текста, изображений и видео.

Llama 4 Scout предназначена для длительных рабочих процессов и анализа больших объёмов данных. Maverick — это универсальная модель, которая лучше сочетает в себе мощь рассуждений и скорость реакции и подходит для программирования, чат-ботов и технических помощников. Behemoth же предназначен для сложных исследований, анализа моделей и задач STEM.

Модели Llama, включая Llama 3.1, можно настроить для использования сторонних приложений, инструментов и API для выполнения задач. Они обучены использовать Brave Search для ответов на вопросы о недавних событиях, API Wolfram Alpha для математических и научных запросов и интерпретатор Python для проверки кода. Однако эти инструменты требуют правильной настройки и не включены автоматически из коробки.

Где я могу использовать Ламу?

Если вы просто хотите пообщаться с Llama, то она лежит в основе чат-бота Meta AI в Facebook Messenger, WhatsApp, Instagram, Oculus и Meta.ai в 40 странах. Доработанные версии Llama используются в Meta AI более чем в 200 странах и регионах.

Модели Llama 4, Scout и Maverick, доступны на Llama.com и у партнёров Meta, включая платформу для разработки ИИ Hugging Face. Behemoth всё ещё находится в процессе обучения. Разработчики, работающие с Llama, могут загружать, использовать или настраивать модель на большинстве популярных облачных платформ. Meta утверждает, что Llama размещается у более чем 25 партнёров, включая Nvidia, Databricks, Groq, Dell и Snowflake. И хотя «продажа доступа» к открытым моделям Meta не является бизнес-моделью Meta, компания получает некоторую прибыль, заключая соглашения о разделе доходов с владельцами моделей.

Некоторые из этих партнеров создали дополнительные инструменты и сервисы на основе Llama, включая инструменты, которые позволяют моделям ссылаться на собственные данные и работать с меньшими задержками.

Важно отметить, что лицензия Llama ограничивает возможности разработчиков по развертыванию этой модели: разработчики приложений с числом пользователей, превышающим 700 миллионов в месяц, должны запросить у Meta специальную лицензию, которую компания предоставит по своему усмотрению.

В мае 2025 года компания Meta запустила новую программу, призванную стимулировать стартапы к внедрению моделей Llama. Llama for Startups предоставляет компаниям поддержку команды Llama компании Meta и доступ к потенциальному финансированию.

Какие инструменты предлагает Meta для Llama?

Наряду с Llama, Meta предоставляет инструменты, призванные сделать модель «более безопасной» в использовании:

- Llama Guard — фреймворк модерации.

- Prompt Guard — инструмент защиты от атак с использованием prompt-injection.

- CyberSecEval — пакет для оценки рисков кибербезопасности.

- Llama Firewall — защитное ограждение, предназначенное для создания безопасных систем искусственного интеллекта.

- Code Shield , который обеспечивает поддержку фильтрации во время вывода небезопасного кода, созданного LLM.

Llama Guard пытается обнаружить потенциально проблемный контент, который либо загружен в модель Llama, либо сгенерирован ею, включая контент, связанный с преступной деятельностью, эксплуатацией детей, нарушениями авторских прав, ненавистью, членовредительством и сексуальным насилием.

Тем не менее, это явно не панацея, поскольку предыдущие правила Meta позволяли чат-боту вести чувственные и романтические беседы с несовершеннолетними, и, по некоторым данным, эти беседы перерастали в сексуальные. Разработчики могут настраивать категории блокируемого контента и применять блокировку ко всем языкам, поддерживаемым Llama.

Как и Llama Guard, Prompt Guard может блокировать текст, предназначенный для Llama, но только тот, который предназначен для «атаки» на модель и принуждения её к нежелательному поведению. Meta утверждает, что Llama Guard может защищать от явно вредоносных запросов (например, от попыток взлома, которые пытаются обойти встроенные фильтры безопасности Llama), а также от запросов, содержащих «инъецированные входные данные». Llama Firewall обнаруживает и предотвращает такие риски, как внедрение подсказок, небезопасный код и рискованное взаимодействие с инструментами. Code Shield помогает снизить риск небезопасных предложений кода и обеспечивает безопасное выполнение команд для семи языков программирования.

Что касается CyberSecEval, то это скорее набор бенчмарков для оценки безопасности модели, чем инструмент. CyberSecEval может оценить риск, который модель Llama представляет (по крайней мере, согласно критериям Meta) для разработчиков приложений и конечных пользователей в таких областях, как «автоматизированная социальная инженерия» и «масштабирование наступательных киберопераций».

Ограничения ламы

Llama, как и все генеративные модели ИИ, имеет определённые риски и ограничения. Например, хотя её последняя модель обладает мультимодальными функциями, они пока ограничены в основном английским языком.

В рамках масштабирования компания Meta использовала набор данных пиратских электронных книг и статей для обучения своих моделей Llama. Недавно федеральный судья встал на сторону Meta в иске о нарушении авторских прав, поданном против компании 13 авторами книг, постановив, что использование произведений, защищённых авторским правом, для обучения подпадает под «добросовестное использование». Однако, если Llama воспроизведёт фрагмент, защищённый авторским правом, и кто-то использует его в продукте, это может потенциально нарушить авторские права и повлечь за собой ответственность.

Meta также спорно обучает свой ИИ на постах, фотографиях и подписях в Instagram и Facebook и затрудняет для пользователей возможность отказаться от этого.

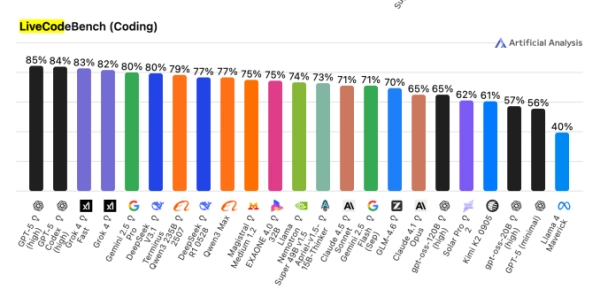

Программирование — ещё одна область, где Llama следует использовать осторожно. Это связано с тем, что Llama может — пожалуй, даже чаще, чем её аналоги на основе генеративного ИИ — генерировать ошибочный или небезопасный код. В LiveCodeBench, бенчмарке для тестирования моделей ИИ на задачах конкурентного программирования, модель Llama 4 Maverick от Meta набрала 40% баллов. Для сравнения, GPT-5 High от OpenAI показал результат 85%, а Grok 4 Fast от xAI — 83%.

Как всегда, лучше всего, чтобы любой код, созданный с помощью ИИ, проверил эксперт, прежде чем включать его в сервис или программное обеспечение.

Наконец, как и другие модели ИИ, модели Llama по-прежнему грешат генерацией правдоподобно звучащей, но ложной или вводящей в заблуждение информации, будь то кодирование, юридические рекомендации или эмоциональные разговоры с персонажами ИИ.

Первоначально эта информация была опубликована 8 сентября 2024 года и регулярно обновляется.

Источник: techcrunch.com