Расшифровка нейронной сети: от принципа её работы до того, где искать и что она раскрывает.

Делиться

Введение

Давайте обсудим, как исследовать и манипулировать нейронной сетью LLM. Это тема исследований в области механистической интерпретируемости, и она может ответить на множество интересных вопросов.

Запомните: LLM — это глубокая искусственная нейронная сеть, состоящая из нейронов и весов, определяющих силу связей между этими нейронами. Что заставляет нейронную сеть прийти к своему выводу? Насколько адекватно она учитывает и анализирует обрабатываемую информацию?

Подобные вопросы исследовались в огромном количестве публикаций, по крайней мере, с тех пор, как глубокие нейронные сети начали демонстрировать свои перспективы. Следует отметить, что механистическая интерпретируемость существовала и до появления LLM и уже была захватывающим аспектом исследований в области объяснимого ИИ с использованием более ранних глубоких нейронных сетей. Например, выявление существенных признаков, которые заставляют сверточную нейронную сеть (CNN) прийти к заданной классификации объекта или направлению движения транспортного средства, может помочь нам понять, насколько надежна и устойчива сеть в критически важных для безопасности ситуациях.

Но с появлением LLM эта тема действительно получила развитие и стала намного интереснее. Реальны ли человекоподобные когнитивные способности LLM или это вымысел? Как информация передается по нейронной сети? Скрыто ли какое-либо знание внутри LLM?

В этом посте вы найдете:

- Краткий обзор архитектуры LLM

- Введение в методы интерпретируемости

- Варианты использования

- Обсуждение предыдущих исследований

В следующей статье мы рассмотрим код на Python, который позволит применить некоторые из этих навыков, визуализировать активации нейронной сети и многое другое.

Повторение: разработка магистерской программы (LLM).

Для целей данной статьи нам необходимо базовое понимание тех участков нейронной сети, к которым стоит подключаться, чтобы получить потенциально полезную информацию в процессе. Поэтому этот раздел представляет собой краткое напоминание о компонентах LLM.

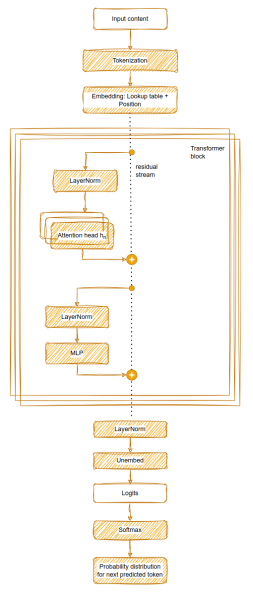

LLM-модели используют последовательность входных токенов для прогнозирования следующего токена.

Токенизатор: Первоначально предложения разбиваются на токены. Цель словаря токенов — преобразовать часто используемые подслова в отдельные токены. Каждый токен имеет уникальный идентификатор.

Однако токены могут быть запутанными и неудобными, поскольку они дают неточное представление многих вещей, включая числа и отдельные символы. Просить LLM вычислять или подсчитывать буквы — довольно несправедливо. (С помощью специализированных схем встраивания их производительность может улучшиться [1].)

Встраивание: Для присвоения каждому идентификатору токена вектора встраивания заданной размерности используется таблица поиска. Таблица поиска обучается (т.е. выводится в процессе обучения нейронной сети) и, как правило, располагает совместно встречающиеся токены ближе друг к другу в пространстве встраивания. Размерность векторов встраивания является важным компромиссом между возможностями LLM и вычислительными затратами. Поскольку порядок токенов в противном случае не был бы очевиден на последующих этапах, к этим векторам встраивания добавляется позиционное кодирование. В ротационном позиционном кодировании может использоваться косинус положения токена. Векторы встраивания всех входных токенов предоставляют матрицу, которую обрабатывает LLM, — начальные скрытые состояния. Поскольку LLM работает с этой матрицей, которая перемещается по слоям как остаточный поток (также называемый скрытым состоянием или пространством представлений), она работает в латентном пространстве.

Модалии, отличные от текста: LLM-ы могут работать и с другими модальностями, помимо текста. В таких случаях токенизатор и эмбеддинг изменяются для поддержки различных модальностей, таких как звук или изображения.

Блоки трансформеров: Несколько блоков трансформеров (десятки) уточняют остаточный поток, добавляя контекст и дополнительный смысл. Каждый слой трансформера состоит из компонента внимания [2] и компонента MLP. На эти компоненты подается нормализованное скрытое состояние. Затем выход добавляется к остаточному потоку.

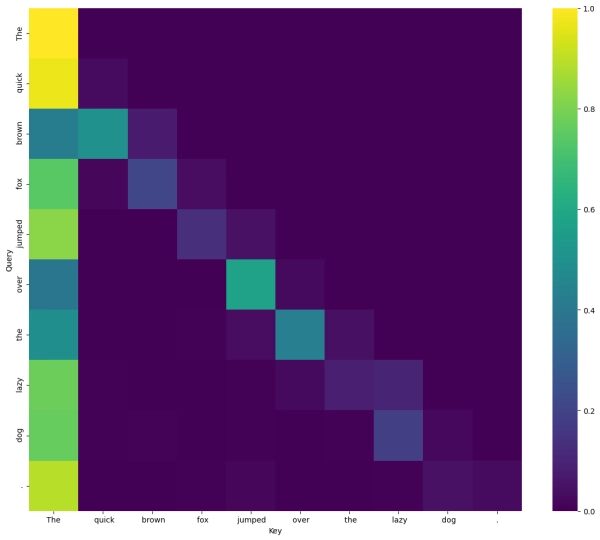

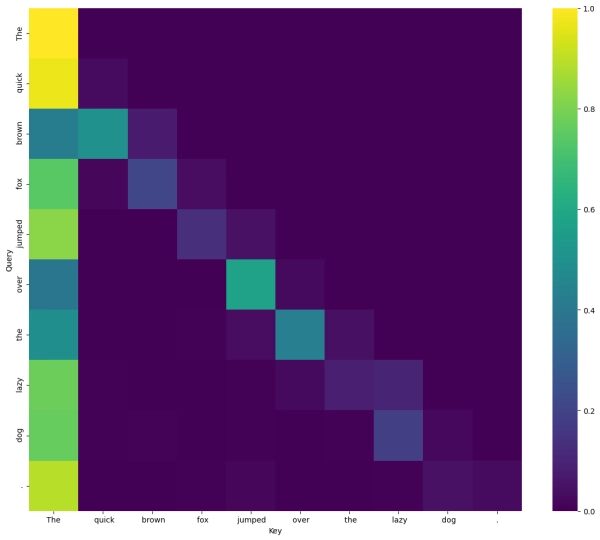

- Внимание: Несколько (а то и десятки) механизмов внимания добавляют взвешенную информацию из исходных токенов к целевым токенам (в остаточном потоке). «Природа» каждого механизма внимания параметризуется с помощью трех обученных матриц WQ, WK, WV, которые, по сути, определяют, на чем специализируется механизм внимания. Запросы, ключи и значения вычисляются путем умножения этих матриц на скрытые состояния для всех токенов. Затем для каждого целевого токена вычисляются веса внимания на основе функции softmax масштабированных скалярных произведений запроса и векторов ключей исходных токенов. Этот вес внимания описывает силу связи между источником и получателем для данной специализации механизма внимания. Наконец, механизм выдает взвешенную сумму векторов значений исходных токенов, и все выходные данные механизма объединяются и проходят через обученную проекцию выходных данных WO.

- MLP: Полностью связанная нейронная сеть прямого распространения. Операция линейного-нелинейного-линейного преобразования применяется независимо в каждой позиции. Сети MLP обычно содержат большую часть параметров, характерных для LLM.

Сети MLP хранят большую часть знаний. Более поздние слои, как правило, содержат больше семантических и менее поверхностных знаний [3]. Это важно при принятии решения о том, где проводить зондирование или вмешательство. (Приложив некоторые усилия, эти представления знаний могут быть изменены в обученной сети LLM посредством модификации весов [4] или вмешательства в остаточный поток [5].)

Деэмбединг: Итоговые значения остаточного потока нормализуются и линейно преобразуются обратно в размер словаря для получения логитов для каждой позиции входного токена. Как правило, нам нужен только прогноз для токена, следующего за последним входным токеном, поэтому мы используем его. Функция softmax преобразует логиты для конечной позиции в распределение вероятностей. Затем из этого распределения выбирается один вариант (например, наиболее вероятный или вариант, основанный на выборке) в качестве следующего прогнозируемого токена.

Если вы хотите узнать больше о том, как работают LLM, и получить дополнительное понимание, объяснение Стивена Макэлиса [6] превосходно.

Теперь, когда мы рассмотрели архитектуру, возникает вопрос: что означают прерывистые состояния остаточного потока? Как они связаны с выходными данными LLM? Почему это работает?

Введение в методы интерпретируемости

Давайте рассмотрим наш инструментарий. Какие компоненты помогут нам ответить на наши вопросы, и какие методы мы можем применить для их анализа? В нашем распоряжении следующие варианты:

- Нейроны:

Мы могли наблюдать активацию отдельных нейронов. - Внимание:

Мы могли наблюдать за работой отдельных модулей внимания в каждом слое.

Мы могли наблюдать за запросами, ключами, значениями и весовыми коэффициентами внимания каждого элемента механизма внимания для каждой позиции и слоя.

Мы могли наблюдать объединенные выходные данные всех механизмов внимания в каждом слое. - МЛП:

Мы могли наблюдать выходные данные многослойного перцептрона (MLP) в каждом слое.

Мы смогли наблюдать нейронную активацию внутри сетей MLP.

Мы могли бы наблюдать среднее значение/дисперсию LayerNorm, чтобы отслеживать масштаб, насыщенность и выбросы. - Остаточный поток:

Мы могли наблюдать остаточный поток в каждой точке, в каждом слое.

Мы могли бы извлечь остаточный поток на промежуточных слоях, чтобы посмотреть, что произойдет, если мы остановимся на этом — более ранние слои часто дают более неглубокие предсказания. (Это полезный диагностический метод, но не совсем надежный — отображение извлечения было обучено для последнего слоя.)

Мы также можем получить дополнительную информацию:

- Линейные зонды и классификаторы: Мы можем создать систему, которая классифицирует записанный остаточный поток в ту или иную группу или измеряет какую-либо характеристику внутри него.

- Атрибуция на основе градиента: Мы можем вычислить градиент выбранного выходного значения относительно некоторых или всех нейронных значений. Величина градиента указывает на то, насколько чувствительно предсказание к изменениям этих значений.

Всё это можно сделать, пока данная статическая модель LLM выполняет логический вывод на основе заданного запроса, или пока мы активно вмешиваемся:

- Сравнение множественных выводов: Мы можем переключать, обучать, модифицировать или изменять LLM, а также заставлять его обрабатывать различные подсказки и записывать вышеупомянутую информацию.

- Абляция: Мы можем обнулить нейроны, блоки MLP или векторы в остаточном потоке и наблюдать, как это влияет на поведение. Например, это позволяет нам измерить вклад блока, нейрона или пути в предсказание токена.

- Управление: Мы можем активно управлять LLM, заменяя или иным образом изменяя активации в остаточном потоке.

Варианты использования

Обсуждаемые методы обеспечения интерпретируемости представляют собой обширный арсенал, который может быть применен к множеству различных сценариев использования.

- Улучшение производительности модели или управление поведением посредством управления активацией: например, помимо системного запроса, поведение модели может динамически направляться к определенному признаку или фокусу без изменения самой модели.

- Объяснимость: Такие методы, как управляющие векторы, разреженные автокодировщики и трассировка цепей, могут быть использованы для понимания того, что делает модель и почему, на основе ее активаций.

- Безопасность: Выявление и предотвращение нежелательных функций во время обучения или внедрение контроля в процессе выполнения для прерывания работы модели, которая отклоняется от нормы. Выявление новых или рискованных возможностей.

- Выявление отклонений: В процессе разработки модели важно понимать, когда и в какой степени новая обученная модель ведет себя иначе.

- Улучшение процесса обучения: понимание вклада различных аспектов поведения модели в ее общую производительность оптимизирует разработку модели. Например, можно исключить ненужные шаги в рамках «цепочки рассуждений» во время обучения, что приводит к созданию более компактных, быстрых или потенциально более мощных моделей.

- Научные и лингвистические выводы: используйте модели в качестве объекта исследования для лучшего понимания искусственного интеллекта, усвоения языка и когнитивных процессов.

Исследование интерпретируемости LLM

Область интерпретируемости неуклонно развивалась в последние несколько лет, отвечая на захватывающие вопросы. Всего три года назад было неясно, воплотятся ли в жизнь изложенные ниже выводы. Это краткая история ключевых открытий:

- Обучение в контексте и понимание образов: Во время обучения LLM некоторые элементы внимания приобретают способность взаимодействовать в качестве идентификаторов образов, что значительно расширяет возможности обучения LLM в контексте [7]. Таким образом, некоторые аспекты LLM представляют собой алгоритмы, которые обеспечивают возможности, применимые за пределами пространства обучающих данных.

- Понимание мира: Запоминают ли LLM все свои ответы или же они понимают содержание, чтобы сформировать внутреннюю ментальную модель перед ответом? Эта тема активно обсуждалась, и первые убедительные доказательства того, что LLM создают внутреннюю модель мира, были опубликованы в конце 2022 года. Для демонстрации этого исследователи восстановили состояние доски игры Отелло из остаточного потока [8, 9]. Вскоре последовало множество других указаний. Были идентифицированы нейроны пространства и времени [10].

- Запоминание или обобщение: просто ли LLM повторяют то, что видели раньше, или же они рассуждают самостоятельно? Доказательства здесь были несколько неясными [11]. Интуитивно, меньшие LLM формируют модели меньшего мира (т.е. в 2023 году доказательства обобщения были менее убедительными, чем в 2025 году). Новые эталонные тесты [12, 13] направлены на ограничение загрязнения материалом, который может содержаться в обучающих данных модели, и сосредоточены конкретно на способности к обобщению. Их эффективность в этом отношении по-прежнему существенна.

В процессе обучения LLM развивают более глубокие способности к обобщению некоторых концепций. Для количественной оценки этого использовались показатели из методов интерпретируемости [14]. - Суперпозиция: Правильно обученные нейронные сети сжимают знания и алгоритмы в приближения. Поскольку признаков больше, чем измерений, которые их указывают, это приводит к так называемой суперпозиции, когда полисемантические нейроны могут вносить вклад в несколько признаков модели [15]. См. «Суперпозиция: что затрудняет объяснение нейронной сети» (Шуянг) для объяснения этого явления. В основном, поскольку нейроны выполняют множество функций, интерпретация их активации может быть неоднозначной и сложной. Это главная причина, по которой исследования интерпретируемости больше сосредоточены на остаточном потоке, чем на активации отдельных полисемантических нейронов.

- Инженерное представление: Помимо поверхностных фактов, таких как состояния доски, пространство и время, можно определить семантически значимые направления векторов в остаточном потоке [16]. После определения направления его можно исследовать или изменить. Это можно использовать, среди прочего, для выявления или влияния на скрытое поведение.

- Скрытые знания: Обладают ли модели LLM внутренними знаниями, которые они хранят при себе? Да, обладают, и методы обнаружения скрытых знаний направлены на их извлечение [17, 18]. Если модель знает что-то, что не отражено в результатах ее прогнозирования, это имеет большое значение для объяснимости и безопасности. Были предприняты попытки проверить такие скрытые цели, которые могут быть внедрены в модель непреднамеренно или преднамеренно, в исследовательских целях [19].

- Управление: Остаточный поток можно обрабатывать с помощью такого дополнительного вектора активации, чтобы целенаправленно изменять поведение модели [20]. Чтобы определить этот вектор управления, можно записать остаточный поток во время двух последовательных запусков (выводов) с противоположными подсказками и вычесть одну из другой. Например, это может изменить стиль сгенерированного результата с радостного на грустный или с безопасного на опасный. Вектор активации обычно вводится в средний слой нейронной сети. Аналогично, вектор управления можно использовать для измерения того, насколько сильно модель реагирует в заданном направлении.

Были предприняты попытки применения методов управления для уменьшения лжи, галлюцинаций и других нежелательных тенденций в моделях с низкой степенью свободы. Однако это не всегда работает надежно. Были предприняты усилия по разработке показателей того, насколько хорошо модель может быть направлена к заданной концепции [21]. - Шахматы: Состояние доски в шахматных партиях, а также оценка языковой моделью уровня мастерства противника также могут быть восстановлены из остаточного потока [22]. Модификация вектора, представляющего ожидаемый уровень мастерства, также использовалась для улучшения производительности модели в игре.

- Отказы: Было установлено, что отказы можно предотвратить или вызвать с помощью направляющих векторов [23]. Это говорит о том, что некоторые действия, направленные на обеспечение безопасности, могут быть доступны линейно.

- Эмоции: LLM могут выводить эмоциональные состояния из заданного входного текста, которые можно измерить. Результаты являются последовательными и психологически правдоподобными в свете теории когнитивной оценки [24]. Это интересно, поскольку предполагает, что LLM могут отражать многие из наших человеческих тенденций в своих моделях мира.

- Особенности: Как уже упоминалось ранее, нейроны в LLM не очень помогают понять, что происходит внутри.

Первоначально OpenAI пыталась заставить GPT-4 угадывать, на какие признаки реагируют нейроны, основываясь на их активации в ответ на различные примеры текста [25]. В 2023 году Anthropic и другие присоединились к этой важной теме и применили автокодирующие нейронные сети для автоматизации интерпретации остаточного потока [26, 27]. Их работа позволяет отображать остаточный поток в моносемантические признаки, описывающие интерпретируемый атрибут происходящего. Однако позже было показано, что не все эти признаки являются одномерно линейными [28].

Автоматизация анализа признаков остается предметом интереса и исследований, и в этой области ведется все больше работы [29].

В настоящее время компании Anthropic, Google и другие активно вносят свой вклад в Neuronpedia, площадку для исследователей, изучающих интерпретируемость. - Галлюцинации: LLM часто выдают ложные утверждения или «галлюцинируют». Для выявления причин галлюцинаций и их смягчения использовались механистические вмешательства [30, 31].

Были также выявлены признаки, подходящие для исследования и влияния на галлюцинации [32]. Соответственно, модель обладает некоторым «самопознанием» о том, когда она выдает неверные утверждения. - Трассировка цепей: В LLM анализ цепей, то есть анализ взаимодействия голов внимания и MLP, позволяет конкретно приписывать поведение таким цепям [33, 34]. Используя этот метод, исследователи могут определить не только местонахождение информации в остаточном потоке, но и то, как данная модель ее вычислила. Продолжаются работы по масштабированию этого процесса.

- Сравнение человеческого мозга и выводы: Нейронная активность человека была сравнена с активациями в модели преобразования речи в текст Whisper от OpenAI [35]. Были обнаружены удивительные сходства. Однако это не следует чрезмерно интерпретировать; это может быть просто признаком того, что LLM приобрели эффективные стратегии. Исследования интерпретируемости позволяют проводить подобные анализы.

- Самореферентный взгляд от первого лица и заявления о сознании: Интересно, что подавление признаков, связанных с обманом, привело к большему количеству заявлений о сознании и более глубоким самореферентным высказываниям со стороны LLM [36]. Опять же, результаты не следует переоценивать, но их интересно учитывать, поскольку LLM становятся все более способными и все чаще бросают нам вызов.

Этот обзор продемонстрировал эффективность причинно-следственных вмешательств во внутренние активации. Вместо того чтобы полагаться на корреляционные наблюдения за системой типа «черный ящик», систему можно разобрать и проанализировать.

Заключение

Интерпретируемость — это захватывающая область исследований, которая позволяет получить неожиданные представления о поведении и возможностях моделей с большой размерностью. Она даже может выявить интересные параллели с человеческим познанием. Многие (в основном узкие) модели поведения могут быть объяснены с помощью данной модели, что позволяет получить ценные результаты. Однако огромное количество моделей и число возможных вопросов, вероятно, не позволят нам полностью расшифровать любую крупную модель — или даже все из них — поскольку огромные временные затраты могут просто не принести достаточной пользы. Именно поэтому происходит переход к автоматизированному анализу, позволяющему систематически применять механистические знания.

Эти методы являются ценным дополнением к нашему инструментарию как в промышленности, так и в научных исследованиях, и все пользователи будущих систем искусственного интеллекта могут извлечь выгоду из этих новых знаний. Они позволяют повысить надежность, объяснимость и безопасность.

Контакт

Это сложная и обширная тема, и я буду рад любым замечаниям, комментариям и исправлениям. Не стесняйтесь отправлять сообщения на адрес jvm (at) taggedvision.com

Ссылки

- [1] Маклейш, Шон, Арпит Бансал, Алекс Стейн, Нил Джайн, Джон Кирхенбауэр, Брайан Р. Бартольдсон, Бхавья Кайльхура и др. 2024. «Трансформеры могут выполнять арифметические операции с правильными вложениями». Достижения в системах обработки нейронной информации 37: 108012–41. doi:10.52202/079017–3430.

- [2] Васвани, Ашиш, Ноам Шазир, Ники Пармар, Якоб Ушкорейт, Лайон Джонс, Эйдан Н. Гомес, Лукаш Кайзер и Илья Полосухин. 2017. «Внимание — это все, что вам нужно». Достижения в области нейронных систем обработки информации, 2017–декабрь (Nips): 5999–6009.

- [3] Гева, Мор, Роэй Шустер, Джонатан Берант и Омер Леви. 2021. «Трансформаторные слои прямой связи — это запоминающие устройства с ключевым значением». doi:10.48550/arXiv.2012.14913.

- [4] Мэн, Кевин, Арнаб Сен Шарма, Алекс Андонян, Йонатан Белинков и Дэвид Бау. 2023. «Массовое редактирование памяти в трансформаторе». doi:10.48550/arXiv.2210.07229.

- [5] Эрнандес, Эван, Белинда З. Ли и Джейкоб Андреас. «Проверка и редактирование представлений знаний в языковых моделях». https://github.com/evandez/REMEDI.

- [6] Стивен Макэлис. 2025. «Понимание LLM: выводы из механистической интерпретируемости». https://www.lesswrong.com/posts/XGHf7EY3CK4KorBpw/understanding-llms-insights-from-mechanistic

- [7] Олссон и др., «Обучение в контексте и индукционные головки», Тема обсуждения трансформаторных цепей, 2022. https://transformer-circuits.pub/2022/in-context-learning-and-induction-heads/index.html

- [8] Ли, Кеннет, Аспен К. Хопкинс, Дэвид Бау, Фернанда Вьегас, Ханспетер Пфистер и Мартин Ваттенберг. 2023. «Возникающие представления мира: исследование модели последовательности, обученной на синтетической задаче». https://arxiv.org/abs/2210.13382v4.

- [9] Нанда, Нил, Эндрю Ли и Мартин Ваттенберг. 2023. «Возникающие линейные представления в мировых моделях самообучающихся моделей последовательностей». https://arxiv.org/abs/2309.00941v2

- [10] Гурни, Уэс и Макс Тегмарк. 2023. «Языковые модели представляют пространство и время». https://arxiv.org/abs/2310.02207v1.

- [11] Ву, Чжаофэн, Линьлу Цю, Алексис Росс, Экин Акюрек, Боюань Чен, Байлин Ван, Наджунг Ким, Джейкоб Андреас и Юн Ким. 2023. «Рассуждение или декламация? Изучение возможностей и ограничений языковых моделей с помощью контрфактических задач». https://arxiv.org/abs/2307.02477v1.

- [12] «Исследование устойчивости LLM в математическом рассуждении: сравнение с математически эквивалентным преобразованием сложных математических задач». 2025. https://openreview.net/forum?id=Tos7ZSLujg

- [13] Уайт, Колин, Сэмюэл Дули, Мэнли Робертс, Арка Пал, Бен Фойер, Сиддхартха Джайн, Равид Шварц-Зив и др. 2025. «LiveBench: сложный, ограниченный по загрязнению эталонный тест LLM». doi:10.48550/arXiv.2406.19314.

- [14] Нанда, Нил, Лоуренс Чан, Том Либерум, Джесс Смит и Джейкоб Штайнхардт. 2023. «Меры прогресса для понимания через механистическую интерпретируемость». doi:10.48550/arXiv.2301.05217.

- [15] Эльхаге, Нельсон, Тристан Хьюм, Кэтрин Олссон, Николас Шифер, Том Хенигэн, Шауна Кравец, Зак Хэтфилд-Доддс и др. 2022. «Игрушечные модели суперпозиции». https://arxiv.org/abs/2209.10652v1 (18 февраля 2024 г.).

- [16] Зоу, Энди, Лонг Фан, Сара Чен, Джеймс Кэмпбелл, Филип Го, Ричард Рен, Александр Пан и др. 2023. «ИНЖЕНЕРИЯ ПРЕДСТАВЛЕНИЯ: ПОДХОД СВЕРХУ К ПРОЗРАЧНОСТИ ИИ».

- [17] Бернс, Коллин, Хаотянь Йе, Дэн Кляйн и Джейкоб Штайнхардт. 2022. «Обнаружение скрытых знаний в языковых моделях без контроля».

- [18] Цивинский, Бартош, Эмиль Рид, Сентхоран Раджаманохаран и Нил Нанда. 2025. «К выявлению скрытых знаний из LLM с помощью механистической интерпретируемости». doi:10.48550/arXiv.2505.14352.

- [19] Маркс, Самуэль, Йоханнес Тройтляйн, Трентон Брикен, Джек Линдси, Джонатан Маркус, Сиддхарт Мишра-Шарма, Даниэль Зиглер и др. «АУДИТ ЯЗЫКОВЫХ МОДЕЛЕЙ НА ПРЕДМЕТ СКРЫТЫХ ЦЕЛЕЙ».

- [20] Тернер, Александр Матт, Лиза Тиргарт, Дэвид Уделл, Гэвин Лич, Улисс Мини и Монте МакДиармид. 2023. «Добавление активации: управление языковыми моделями без оптимизации». https://arxiv.org/abs/2308.10248v3.

- [21] Рютте, Димитри фон, Сотирис Анагностидис, Грегор Бахманн и Томас Хофманн. 2024. «Руководство языковой модели по латентному пространству». doi:10.48550/arXiv.2402.14433.

- [22] Карвонен, Адам. «Возникающие модели мира и оценка скрытых переменных в языковых моделях игры в шахматы». https://github.com/adamkarvonen/chess.

- [23] Ардити, Энди, Оскар Обесо, Аакиб Сайед, Даниэль Палека, Нина Паникссери, Уэс Гурни и Нил Нанда. 2024. «Отказ в языковых моделях опосредуется одним направлением». doi:10.48550/arXiv.2406.11717.

- [24] Так, Ала Н., Амин Банайеанзаде, Анахита Болурани, Мина Киан, Робин Цзя и Джонатан Гратч. 2025. «Механистическая интерпретируемость вывода эмоций в больших языковых моделях». doi:10.48550/arXiv.2502.05489.

- [25] Стивен Биллс, Ник Каммарата, Дэн Моссинг, Хенк Тиллман, Лео Гао, Габриэль Го, Илья Суцкевер, Ян Лейке, Джефф и Уильям Сондерс Ву. 2023. «Языковые модели могут объяснять нейроны в языковых моделях». https://openaipublic.blob.core.windows.net/neuron-explainer/paper/index.html.

- [26] «К моносемантичности: декомпозиция языковых моделей с помощью обучения словарям». https://transformer-circuits.pub/2023/monosemantic-features/index.html.

- [27] Каннингем, Хоги, Эйдан Эварт, Логан Риггс, Роберт Хубен и Ли Шарки. 2023. «РАЗРЕЗНЫЕ АВТОКОДЕРЫ НАХОДЯТ ВЫСОКО ИНТЕРПРЕТИРУЕМЫЕ ПРИЗНАКИ В ЯЗЫКОВЫХ МОДЕЛЯХ».

- [28] Энгельс, Джошуа, Эрик Дж. Мишо, Исаак Ляо, Уэс Гурни и Макс Тегмарк. 2025. «Не все характеристики языковой модели являются одномерно линейными». doi:10.48550/arXiv.2405.14860.

- [29] Шахам, Тамар Ротт, Сара Шветтманн, Франклин Ванг, Ачьюта Раджарам, Эван Эрнандес, Джейкоб Андреас и Антонио Торральба. 2025. «Мультимодальный автоматизированный агент интерпретируемости». doi:10.48550/arXiv.2404.14394.

- [30] Чэнь, Шици, Мяо Сюн, Цзюньтэн Лю, Чжэнсюань Ву, Тэн Сяо, Сыян Гао и Цзюньсянь Хэ. 2024. «Острота в контексте как предупреждение: перспектива внутреннего представления для смягчения галлюцинаций». doi:10.48550/arXiv.2403.01548.

- [31] Ю, Лэй, Мэн Цао, Джеки Ч. К. Ченг и Юэ Донг. 2024. «Механистическое понимание и смягчение нефактических галлюцинаций языковой модели». В сборнике «Результаты Ассоциации вычислительной лингвистики: EMNLP 2024», под ред. Ясера Аль-Онаизана, Мохита Бансала и Юн-Нун Чена. Майами, Флорида, США: Ассоциация вычислительной лингвистики, 7943–56. doi:10.18653/v1/2024.findings-emnlp.466.

- [32] Феррандо, Хавьер, Оскар Обесо, Сентхуран Раджаманохаран и Нил Нанда. 2025. «ЗНАЮ ЛИ Я ЭТО СУЩНОСТЬ? ЗНАНИЕ И ГАЛЛЮЦИНАЦИИ В ЯЗЫКОВЫХ МОДЕЛЯХ».

- [33] Линдси и др., О биологии большой языковой модели (2025), Трансформаторные схемы

- [34] Ван, Кевин, Александр Вариенжин, Артур Конми, Бак Шлегерис и Джейкоб Штайнхардт. 2022. «Интерпретируемость в реальных условиях: схема для косвенной идентификации объектов в GPT-2 Small». http://arxiv.org/abs/2211.00593.

- [35] «Расшифровка обработки языка в человеческом мозге с помощью представлений LLM». https://research.google/blog/deciphering-language-processing-in-the-human-brain-through-llm-representations/

- [36] Берг, Кэмерон, Диого де Лусена и Джадд Розенблатт. 2025. «Крупные языковые модели сообщают о субъективном опыте в условиях самореферентной обработки». doi:10.48550/arXiv.2510.24797.

Источник: towardsdatascience.com