LLM-ревизор для ПК: подбор локальных моделей под конкретное железо

Вышла утилита, которая анализирует конфигурацию компьютера и рекомендует оптимальные локальные нейросети и инструменты под задачи.

Что умеет:

— База из 35 моделей Ollama в диапазоне 1–32B

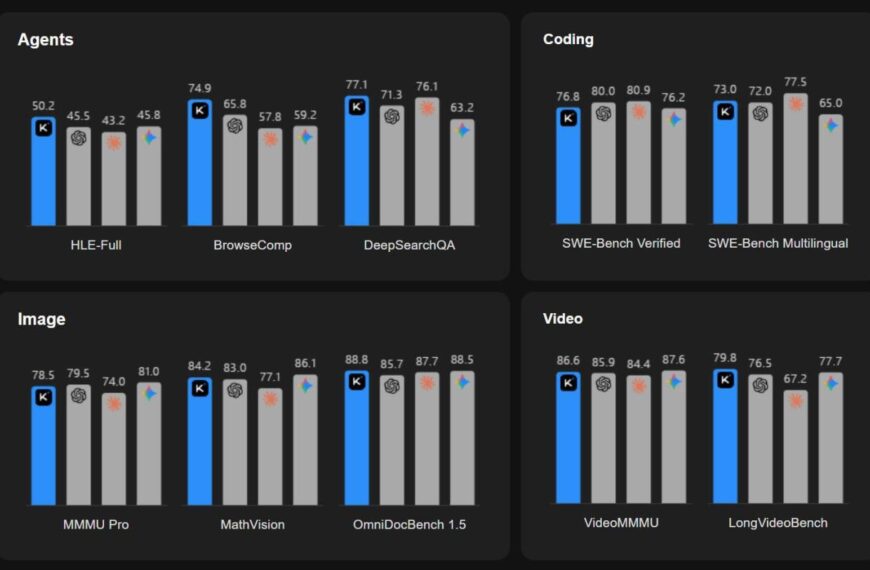

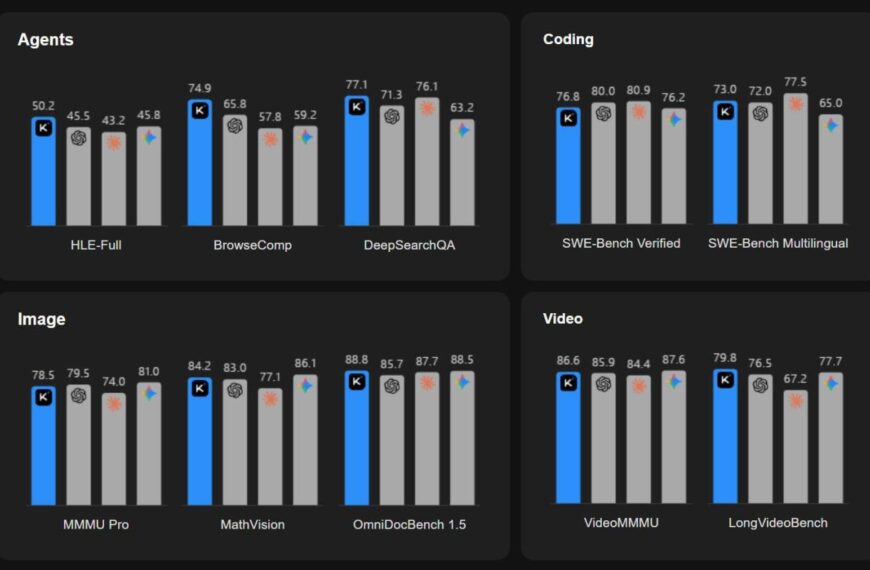

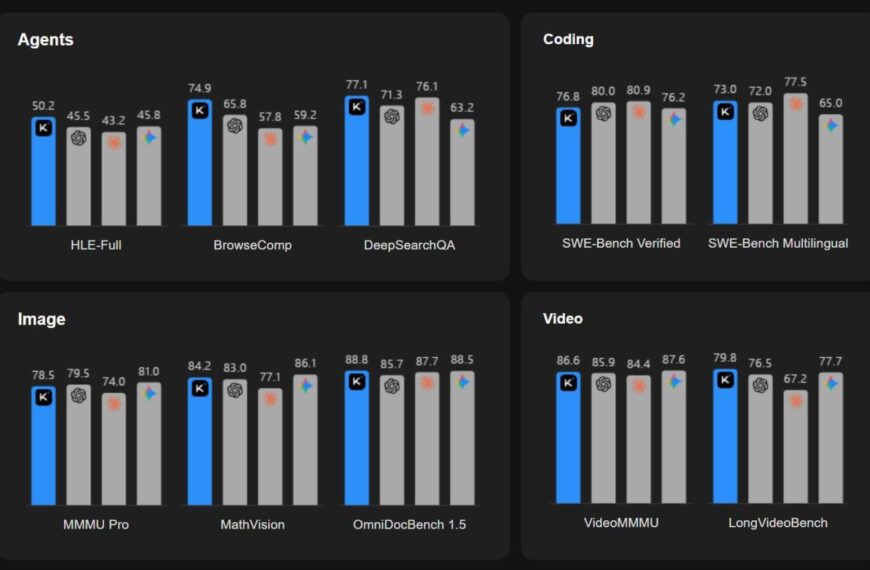

— Прогон бенчмарков: скорость, качество ответов, точность и дополнительные метрики

— Формирование итоговой подборки моделей и ИИ-инструментов под конкретный ПК и сценарии

Вывод: быстрый способ понять, какие локальные LLM реально потянут железо без ручного перебора.