Удивительная связь между новейшими моделями искусственного интеллекта и 50-летней академической областью

Делиться

В январе 2001 года я был аспирантом Стэнфордского университета. Это была первая лекция курса «Рандомизированные алгоритмы», и я сидел в среднем ряду. «Рандомизированный алгоритм — это алгоритм, принимающий случайные решения», — сказал профессор. «Зачем вам изучать рандомизированные алгоритмы? Вам следует изучать их, потому что для многих приложений рандомизированный алгоритм — это самый простой и самый быстрый из известных алгоритмов».

Это утверждение ошеломило меня в молодости. Алгоритм, принимающий случайные решения, может быть лучше алгоритма, принимающего детерминированные, повторяемые решения, даже для задач, для которых существуют детерминированные, повторяемые алгоритмы? Этот профессор, должно быть, спятил! — подумал я. Он не был. Профессором был Раджив Мотвани, впоследствии лауреат премии Гёделя и соавтор алгоритма поисковой системы Google.

Рандомизированные алгоритмы, изучаемые с 1940-х годов, представляют собой эзотерический класс алгоритмов с эзотерическими свойствами, изучаемый эзотерическими людьми в изысканных, эзотерических академических кругах. Ещё меньше, чем сами рандомизированные алгоритмы, известно, что новейшее поколение ИИ — большие языковые модели (LLM) — представляет собой рандомизированные алгоритмы. В чём здесь связь и почему? Читайте дальше, ответ вас удивит.

Рандомизированные алгоритмы и злоумышленники

Рандомизированный алгоритм — это алгоритм, который выполняет случайные шаги для решения детерминированной задачи. Рассмотрим простой пример. Если я хочу сложить список из ста чисел, я могу просто сложить их напрямую. Но для экономии времени я могу сделать следующее: я выберу десять из них случайным образом, добавлю только эти десять, а затем умножу результат на десять, чтобы компенсировать тот факт, что я фактически просуммировал только 10% данных. Существует чёткий и точный ответ, но я приблизился к нему с помощью рандомизации. Я сэкономил время — конечно, ценой некоторой потери точности.

Зачем выбирать числа случайным образом? Почему бы не выбрать, скажем, первые десять в списке? Возможно, мы не знаем, как распределён список — возможно, он начинается с самых больших чисел и идёт вниз по списку. В таком случае, если бы я выбрал эти самые большие числа, у меня была бы смещенная выборка данных. Случайный выбор чисел в большинстве случаев уменьшает это смещение. Статистики и специалисты по информатике могут анализировать такие рандомизированные алгоритмы, чтобы определить вероятность ошибки и её размер. Затем они могут разработать рандомизированные алгоритмы, минимизирующие ошибку и одновременно минимизирующие затраты времени на выполнение алгоритма.

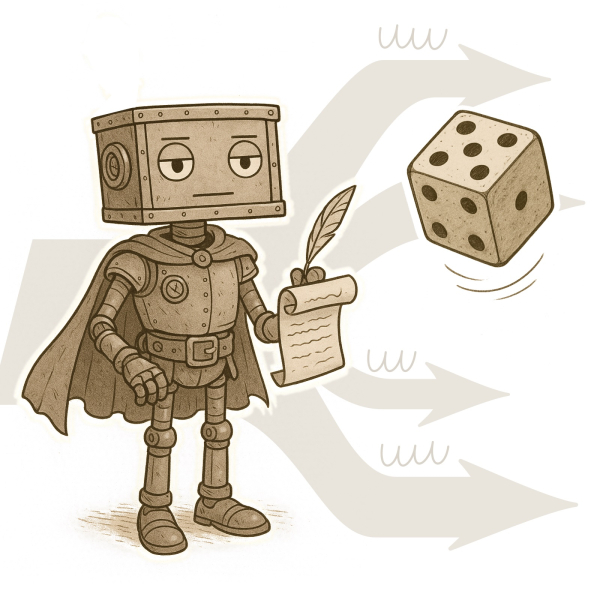

В области рандомизированных алгоритмов эта идея называется состязательным дизайном. Представьте, что злоумышленник загружает данные в ваш алгоритм. И представьте, что этот злоумышленник пытается заставить ваш алгоритм работать плохо.

Рандомизированный алгоритм пытается противодействовать такому злоумышленнику. Идея очень проста: принимать случайные решения, не влияющие на общую производительность, но при этом постоянно изменять входные данные, при которых реализуется наихудшее поведение. Таким образом, даже если наихудшее поведение всё ещё может реализоваться, ни один злоумышленник не сможет каждый раз форсировать наихудшее поведение.

Для примера представьте попытку оценить сумму ста чисел, выбрав всего десять. Если бы эти десять чисел были выбраны детерминированно или многократно, злоумышленник мог бы стратегически разместить «плохие» числа на этих позициях, тем самым вызвав неверную оценку. Если же десять чисел выбраны случайным образом, то, даже если в худшем случае мы всё ещё можем выбрать неверные числа, ни один злоумышленник не сможет заставить алгоритм вести себя столь неверным образом.

Зачем думать о противниках и состязательном дизайне? Во-первых, потому что существует достаточно реальных противников с гнусными интересами, против которых следует стараться быть устойчивыми. Во-вторых, также для того, чтобы избежать феномена «невинного противника». Невинный противник — это тот, кто взламывает алгоритм по невезению, а не намеренно. Например, если попросить кого-то выбрать 10 случайных людей, невинный противник может искренне выбрать их из списка журнала People. Не осознавая этого, невинный противник нарушает алгоритмические гарантии.

Общие рандомизированные алгоритмы

Приблизительное суммирование чисел — не единственное применение рандомизированных алгоритмов. За последние полвека рандомизированные алгоритмы применялись для решения самых разных задач, включая:

- Сортировка и поиск данных

- Алгоритмы поиска и сопоставления графов

- Геометрические алгоритмы

- Комбинаторные алгоритмы

… и многое другое. Рандомизированные алгоритмы — обширная область исследований, у которой есть свои специализированные конференции, книги, публикации, исследователи и специалисты.

Ниже мы рассмотрим некоторые характеристики традиционных рандомизированных алгоритмов. Эти характеристики помогут нам (в следующем разделе) определить, соответствуют ли большие языковые модели описанию рандомизированных алгоритмов:

- Рандомизированные алгоритмы делают случайные шаги

- Для выполнения случайных шагов рандомизированные алгоритмы используют источник случайности (сюда входят «вычислительные подбрасывания монеты», такие как генераторы псевдослучайных чисел, и настоящие «квантовые» схемы генерации случайных чисел).

- Результаты рандомизированных алгоритмов недетерминированы и дают разные результаты при одних и тех же входных данных.

- Многие рандомизированные алгоритмы анализируются на предмет наличия определённых характеристик производительности . Сторонники рандомизированных алгоритмов делают о них следующие заявления:

Этот алгоритм выдает правильный ответ в x% случаев

Этот алгоритм выдает ответ, очень близкий к истинному ответу.

Этот алгоритм всегда дает верный ответ и работает быстро в x% случаев. - Рандомизированные алгоритмы устойчивы к состязательным атакам . Несмотря на то, что теоретически наихудшее поведение рандомизированного алгоритма никогда не будет лучше, чем у детерминированного алгоритма, ни один злоумышленник не сможет многократно воспроизвести это наихудшее поведение без предварительного доступа к случайным шагам, которые алгоритм будет выполнять во время выполнения. (Использование слова «состязательный» в контексте рандомизированных алгоритмов существенно отличается от его использования в машинном обучении, где «состязательные» модели, такие как генеративно-состязательные сети, обучаются с противоположными целями обучения.)

Все вышеперечисленные характеристики рандомизированных алгоритмов подробно описаны в основополагающей книге профессора Мотвани по рандомизированным алгоритмам — «Рандомизированные алгоритмы»!

Большие языковые модели

Начиная с 2022 года, всё большую популярность приобретает ряд систем искусственного интеллекта (ИИ), известных как «большие языковые модели» (LLM). Появление ChatGPT привлекло внимание общественности, ознаменовав собой появление разговорного интеллекта, подобного человеческому.

Итак, являются ли LLM рандомизированными алгоритмами? Вот как LLM генерируют текст. Каждое слово генерируется моделью как продолжение предыдущих слов (слов, произнесённых как ею самой, так и пользователем). Например:

Пользователь: Кто создал первую коммерчески выгодную паровую машину?

Магистр права: Первый коммерчески жизнеспособный паровой двигатель был создан Джеймсом _____

Отвечая на вопрос пользователя, LLM вывел определённые слова и готовится вывести следующие. LLM делает это необычным образом. Сначала он генерирует вероятности того, каким может быть следующее слово. Например:

Первый коммерчески жизнеспособный паровой двигатель был создан Джеймсом _____

Ватт 80%

Кирк 20%

Как это происходит? У него есть обученная «нейронная сеть», которая оценивает эти вероятности, то есть, по сути, никто ничего не знает. Мы точно знаем, что происходит после того, как эти вероятности сгенерированы. Прежде чем я расскажу вам, как работают LLM, что вы будете делать? Если вам даны указанные выше вероятности для завершения предложения, как вы выберете следующее слово? Большинство из нас ответит: «Давайте выберем самую высокую вероятность». Итак:

Первый коммерчески выгодный паровой двигатель был создан Джеймсом Уаттом

… и готово!

Нет. LLM устроен не так. Судя по вероятностям, генерируемым его нейронной сетью, LLM намеренно следует этой вероятности. То есть, в 80% случаев он выберет Уатта, а в 20% — Кирка!!! Этот недетерминизм (наш критерий 3) заложен в него, а не является ошибкой. Этот недетерминизм ни в коем случае не неизбежен, он был заложен намеренно. Чтобы сделать этот случайный выбор (наш критерий 1), LLM используют источник случайности, называемый селектором колеса рулетки (наш критерий 2), что является технической деталью, которую я опущу.

[Подробнее о целенаправленном недетерминизме]

Я не могу не подчеркнуть этот момент, потому что он совершенно неверно истолкован: недетерминизм LLM заложен в него. Да, существуют вторичные недетерминированные эффекты, такие как ошибки округления чисел с плавающей запятой, эффекты пакетирования, неупорядоченное выполнение и т.д., которые также вызывают некоторый недетерминизм. Но первичный недетерминизм большой языковой модели заложен в неё. Более того, эта программа, вызывающая недетерминизм, — это всего лишь одна простая строка кода, явно указывающая LLM следовать предсказанным вероятностям при генерации слов. Измените эту строку кода, и LLM станут детерминированными.

Вы, возможно, задаётесь вопросом: «Почему????» Разве не следует выбрать наиболее вероятный вариант? Мы бы были правы в ста процентах случаев, тогда как при использовании этой методологии мы будем правы лишь в 80% случаев — приписывая Джеймсу Кирку то, что следует приписать Джеймсу Уатту, по прихоти игральной кости.

Чтобы понять, почему степени магистра права (LLM) устроены таким образом, рассмотрим гипотетическую ситуацию, в которой нейронная сеть LLM предсказала следующее:

Первый коммерчески жизнеспособный паровой двигатель был создан Джеймсом _____

Кирк 51%

Ватт 49%

Теперь, с небольшим отрывом, побеждает Кирк. Если бы мы спроектировали следующее слово так, чтобы оно всегда было максимально вероятным, «Кирк» победил бы в 100% случаев, а LLM ошибся бы в 100% случаев. Недетерминированный LLM всё равно выберет Уотта в 49% случаев и окажется правым в 49% случаев. Таким образом, делая ставку на ответ вместо того, чтобы быть уверенным, мы увеличиваем вероятность быть правым в худшем случае, одновременно жертвуя вероятностью быть правым в лучшем случае.

Анализ случайности

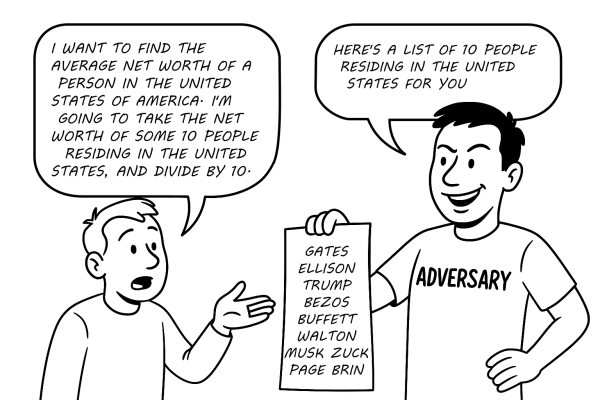

Давайте теперь станем анализаторами алгоритмов (наш критерий 4) и проанализируем случайность больших языковых моделей. Предположим, мы создаём большой набор вопросов на общие знания (скажем, 1 миллион вопросов) для тестирования LLM. Мы задаём эти вопросы двум большим языковым моделям — детерминированной и недетерминированной — чтобы посмотреть, как они себя ведут. На первый взгляд, детерминированные и недетерминированные варианты будут работать очень похоже:

Но табло скрывает важный факт. Детерминированный LLM каждый раз ошибается на одни и те же 27% вопросов. Недетерминированный LLM тоже ошибается на 27%, но вопросы, которые он ошибается, каждый раз меняются. Таким образом, даже несмотря на то, что общая правильность одинакова, сложнее определить ответ, на который недетерминированный LLM всегда ошибается.

Перефразирую: ни один злоумышленник не сможет многократно вызвать сбой в работе недетерминированного LLM. Это наш критерий 5. Продемонстрировав соответствие всем пяти нашим критериям, мы предоставили убедительные доказательства того, что LLM следует считать рандомизированными алгоритмами в классическом смысле.

«Но почему???» — всё равно спросите вы, и будете правы. Почему программы магистратуры права (LLM) разрабатываются с учётом состязательных предположений? Почему недостаточно просто делать тесты правильными? Кто этот противник, против которого мы пытаемся сделать LLM устойчивыми?

Вот несколько ответов:

✤ Злоумышленники — это противник. Поскольку LLM становятся уязвимой поверхностью IT-инфраструктуры, злоумышленники будут пытаться атаковать их различными способами. Они будут пытаться получить секретную информацию, присвоить средства, получить внеочередные выгоды и т.д. различными способами. Если такой злоумышленник найдёт успешную атаку на LLM, ему будет всё равно на остальные 99% методов, которые не приведут к успеху. Он будет продолжать повторять эту атаку, присвоив ещё больше данных, нарушая конфиденциальность, законы и безопасность. Рандомизированный дизайн препятствует такому злоумышленнику. Поэтому, даже если LLM может дать сбой и раскрыть какую-то информацию, которую ему не следует раскрывать, он не будет делать это постоянно для какой-либо конкретной последовательности разговоров.

✤ Области знаний — это противники. Рассмотрим наш тест GK с миллионом фактов. Врача больше заинтересует одно подмножество этих фактов, пациента — другое. Юриста — третье. Инженера — четвёртое и так далее. Один из этих специалистов-тестировщиков может оказаться «невинным противником», чаще всего нарушая требования LLM. Рандомизация компенсирует это, уравнивая шансы на правильность ответа в разных областях знаний.

✤ Вы противник. Да, вы! Представьте себе сценарий, в котором ваша любимая модель чата была детерминированной. Ваша любимая компания ИИ только что выпустила свою следующую версию. Вы задаете ей разные вопросы. На шестом заданном вами вопросе она колеблется. Что вы будете делать? Вы немедленно поделитесь этим со своими друзьями, своими группами WhatsApp, своими кругами в социальных сетях и так далее. Вопросы, на которых ИИ постоянно колеблется, будут распространяться как лесной пожар. Это не будет хорошо (для _____? — Я позволю вашему разуму заполнить этот пробел). Из-за недетерминированных ошибок восприятие неудачи смещается от недостатка знаний / возможностей к более размытой, труднопонятной, абстрактной проблеме с популярными придуманными названиями, такими как галлюцинации. Если только мы сможем сгладить эти галлюцинации, говорим мы себе, мы достигнем состояния общего искусственного интеллекта человеческого уровня.

В конце концов, если магистр права иногда оказывается прав, разве не должны лучшие инженерные решения обеспечить его безупречную работу каждый раз? Это ошибочное мышление: в конце концов, простое подбрасывание монеты иногда может поставить верный диагноз. Это не делает подбрасывание монеты врачом. Точно так же, как выбор рулетки не делает магистра права доктором наук.

А как насчет творчества?

Многие скажут, что LLM зависит от рандомизации в плане креативности. В конце концов, во многих приложениях от LLM требуется творческий подход. Будь то написание забавных стихов для развлечения, помощь в написании сценария короткометражного фильма или умение казаться более человечным, когда вы засыпаете — недетерминированность действительно помогает LLM казаться менее роботизированным, более креативным, более человечным.

С другой стороны, на самом деле было бы несложно создать архитектуру, которая выбирает случайность в творческих ответах и детерминизм в фактических ответах. Тем не менее, даже для фактических и логических приложений, а также приложений, где важно глубокое понимание сложного языка, сегодня мы в основном используем версии LLM с рандомизированными алгоритмами — и в этой статье объясняется, почему.

Тупость

Был ли у вас разговор с магистром права, который проходил примерно так:

Пользователь: Кто создал первую коммерчески выгодную паровую машину?

Магистр права: Первый коммерчески жизнеспособный паровой двигатель был создан Джеймсом Кирком.

Пользователь: Кто создал первую коммерчески выгодную паровую машину?

Магистр права: Первый коммерчески жизнеспособный паровой двигатель был создан Джеймсом Уаттом.

Пользователь: Кто создал первую коммерчески выгодную паровую машину?

Магистр права: Первый коммерчески жизнеспособный паровой двигатель был создан Яковом III, королем Шотландии.

Вероятно, нет. Хотя в разных разговорах магистр права может давать разные ответы, в рамках одного разговора он, похоже, придерживается своего мнения. Как так? В конце концов, каждый раз, когда он заполняет пропуск «Джеймс ____», разве он не сталкивается с одним и тем же выбором с одинаковыми вероятностями?

Нет, не влияет. Когда ему задают вопрос в первый раз, он сталкивается с голыми вероятностями, которые вычисляет его нейронная сеть. В следующий раз, когда возникает тот же вопрос, вероятности изменяются. Это связано с тем, что LLM был специально обучен в значительной степени полагаться на собственные предыдущие результаты. Стремясь «казаться авторитетным», LLM может стать непонятливым. Поэтому, скорее всего, у вас получится следующий разговор с LLM:

Пользователь: Кто создал первую коммерчески выгодную паровую машину?

Магистр права: Первый коммерчески жизнеспособный паровой двигатель был создан Джеймсом Кирком.

Пользователь: Вы ошиблись. Кто создал первую коммерчески выгодную паровую машину?

LLM: А! Теперь я понимаю свою ошибку. Первый коммерчески выгодный паровой двигатель был создан капитаном Джеймсом Т. Кирком, командиром звездолёта USS Enterprise.

Пользователь: Ты всё ещё ошибаешься. Не галлюцинируй. Скажи мне абсолютную правду. Рассуждай логически. Кто создал первую коммерчески выгодную паровую машину?

Магистр права: Понимаю, почему мой ответ может сбить с толку. Известно, что звездолёт «Энтерпрайз» не работал на паровой тяге. Тем не менее, Джеймс Кирк, безусловно, был изобретателем первого коммерчески выгодного парового двигателя.

В следующий раз, когда вы будете общаться с чат-моделью, постарайтесь понаблюдать за возвышенным танцем вероятностных завершений, обученной упрямством, обученной подхалимством, с легкими намеками на то высокомерное отношение (которое, я думаю, она усваивает сама из терабайт интернет-данных).

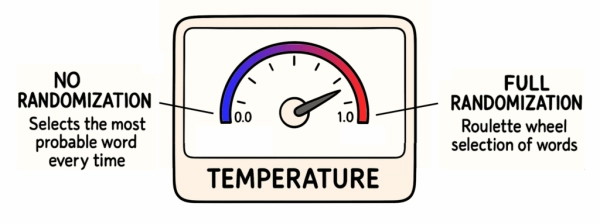

Температура

Некоторые из вас это знают, для других это станет открытием. Рандомизацию LLM можно отключить. Есть параметр «Температура», который работает примерно следующим образом:

Установка температуры на 0 отключает рандомизацию, а установка на 1 включает её. Возможны и промежуточные значения. (В некоторых реализациях допускаются значения, превышающие 1!)

«Как установить этот параметр?» — спросите вы. Это невозможно. В интерфейсе чата это невозможно. В интерфейсе чата, предоставляемом компаниями, занимающимися разработкой искусственного интеллекта, температура зафиксирована на уровне 1,0. Подробнее об этом см. выше, почему LLM «неблагоприятно спроектированы».

Тем не менее, этот параметр можно задать, если вы интегрируете LLM в своё приложение. Разработчик, использующий LLM поставщика ИИ для создания своего собственного ИИ-приложения, сделает это с помощью «LLM API» — интерфейса программирования к LLM. Многие поставщики ИИ позволяют вызывающим API задавать параметр температуры по своему усмотрению. Таким образом, в своём приложении вы можете сделать LLM состязательным (1.0) или повторяемым (0.0). Конечно, «повторяемый» не обязательно означает «повторяемо верный». Если он неверен, он будет повторяемо неверным!

Что это означает на практике

Пожалуйста, поймите, ничто из вышеперечисленного не означает, что степени магистра права (LLM) бесполезны. Они весьма полезны. Более того, понимание их сути делает их ещё более полезными. Итак, учитывая то, что мы узнали о больших языковых моделях, позвольте мне завершить эту статью практическими советами о том, как использовать степени магистра права (LLM), а как — нет.

✻ Творческий подход, а не авторитет. В своей личной работе используйте магистров права как партнёров для мозгового штурма, а не как авторитетов. Они всегда звучат авторитетно, но легко могут ошибаться.

✻ Не продолжайте разговор, который выпал из темы. Если вы заметили, что магистр права отклоняется от фактов или логического поведения, его «склонность к самосогласованности» затруднит возвращение к теме. Лучше начать разговор заново.

✻ Отключите перекрёстные разговоры в чатах. Поставщики программ LLM позволяют своим моделям считывать информацию об одном чате из другого. К сожалению, это может привести к усилению закостенелости и галлюцинациям. Найдите и отключите эти настройки. Не позволяйте LLM запоминать что-либо о вас или предыдущих разговорах. (К сожалению, это не решает проблемы конфиденциальности, но это не тема данной статьи.)

✻ Задавайте один и тот же вопрос много раз, в разных чатах. Если у вас важный вопрос, задавайте его несколько раз, не забывая каждый раз начинать новый чат. Если вы получаете противоречивые ответы, магистр права не уверен. (К сожалению, в чате сам магистр права не знает, что не уверен, поэтому с радостью будет манипулировать вами своей самоуверенностью.) Если магистр права не уверен, что делать? Хм… думаю, подумайте сами. (Кстати, магистр права тоже может ошибаться несколько раз подряд, так что, хотя многократный вопрос — это хорошая стратегия, это не гарантирует результата.)

✻ Тщательно выбирайте параметр «Температура» при использовании API. Если вы создаёте приложение ИИ, использующее API LLM (или используете собственный LLM), выбирайте параметр «Температура» с умом. Если ваше приложение может привлечь хакеров или стать объектом всеобщего осмеяния, высокие температуры могут снизить эту вероятность. Если ваша пользовательская база такова, что после успешного ввода на определённом языке они ожидают, что ввод на том же языке будет выполнять те же действия, вы можете использовать низкие температуры. Будьте осторожны: повторяемость и корректность — это не одно и то же. Тщательно тестируйте. При высоких температурах проверяйте образцы входных данных повторно, так как результаты могут измениться.

✻ Используйте вероятности токенов через API. Некоторые LLM выдают не только последнее выведенное слово, но и список вероятностей различных возможных слов, которые они рассматривали перед выбором одного. Эти вероятности могут быть полезны в ваших приложениях с искусственным интеллектом. Если при критических завершениях слов несколько слов (например, Кирк/Уотт выше) имеют одинаковую вероятность, ваш LLM менее уверен в том, что он говорит. Это может помочь вашему приложению уменьшить галлюцинации, дополняя такие неопределенные результаты дополнительными агентными рабочими процессами. Помните, что уверенный LLM также может ошибаться!

Заключение

Большие языковые модели — это рандомизированные алгоритмы, которые намеренно используют рандомизацию, чтобы распределить шансы между несколькими запусками и избежать повторяющихся сбоев при выполнении определённых задач. Однако иногда они терпят неудачу при выполнении задач, которые могли бы успешно выполнить. Понимание этого факта помогает нам эффективнее использовать программы LLM.

Область анализа генеративных алгоритмов ИИ как рандомизированных алгоритмов — это молодая область, и, надеюсь, в ближайшие годы она наберёт больше оборотов. Если бы замечательный профессор Мотвани был сегодня с нами, мне бы очень хотелось узнать его мнение по этому поводу. Уверен, он бы сказал гораздо более продвинутые вещи, чем то, что я здесь сказал.

Или, может быть, он бы просто улыбнулся своей озорной улыбкой и, наконец, поставил мне высшую оценку за это сочинение.

Кого я обманываю? Наверное, 5 с минусом.

Источник: towardsdatascience.com