Источник: VentureBeat, создано с помощью Midjourney

Источник: VentureBeat, создано с помощью Midjourney

Хотите получать более ценную информацию? Подпишитесь на наши еженедельные рассылки, чтобы получать только то, что важно для руководителей в сфере корпоративного ИИ, данных и безопасности. Подпишитесь сейчас

Если бы в индустрии искусственного интеллекта существовал эквивалент «песни лета» в индустрии звукозаписи — хит, который становится популярным в теплые месяцы здесь, в Северном полушарии, и который можно услышать повсюду, — явным претендентом на этот титул стала бы команда Qwen из Alibaba.

Только за последнюю неделю исследовательский отдел передовых моделей ИИ китайского гиганта электронной коммерции выпустил не одну, не две, не три, а целых четыре (!!) новые модели генеративного ИИ с открытым исходным кодом, которые демонстрируют рекордные результаты, превосходящие даже некоторые ведущие проприетарные решения.

Вчера вечером команда Qwen завершила работу над Qwen3-235B-A22B-Thinking-2507 — это обновленная модель рассуждений на большом языке (LLM), которая реагирует дольше, чем нерассуждающая или «инструктирующая» LLM, участвуя в «цепочках мыслей» или саморефлексии и самопроверке, что, как мы надеемся, приводит к более правильным и полным ответам на более сложные задания.

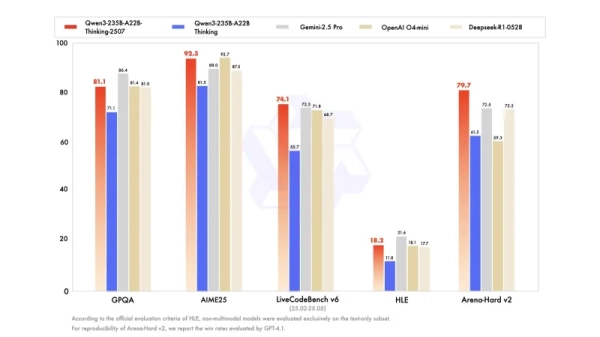

Действительно, новый Qwen3-Thinking-2507, как мы будем его кратко называть, теперь лидирует или почти отстает от самых эффективных моделей в нескольких основных тестах.

Серия мероприятий AI Impact возвращается в Сан-Франциско — 5 августа

Новая фаза развития ИИ уже наступила — вы готовы? Присоединяйтесь к лидерам Block, GSK и SAP, чтобы узнать, как автономные агенты меняют рабочие процессы предприятий — от принятия решений в режиме реального времени до сквозной автоматизации.

Забронируйте свое место сейчас — количество мест ограничено: https://bit.ly/3GuuPLF

Как написал в X инфлюенсер и новостной агрегатор в сфере искусственного интеллекта Эндрю Карран: «Самая сильная модель рассуждений Квен уже появилась, и она находится на переднем крае».

В тесте AIME25 , разработанном для оценки способности решать задачи в математическом и логическом контексте, Qwen3-Thinking-2507 лидирует среди всех рассмотренных моделей с результатом 92,3 , немного опережая и o4-mini от OpenAI ( 92,7 ), и Gemini-2.5 Pro ( 88,0 ).

Модель также демонстрирует впечатляющую производительность на LiveCodeBench v6 , набрав 74,1 балла, опережая Google Gemini-2.5 Pro (72,5), OpenAI o4-mini (71,8) и значительно превосходя свою более раннюю версию, которая показала 55,7 балла .

В тесте GPQA , эталонном тесте для вопросов с несколькими вариантами ответов на уровне выпускников, модель набрала 81,1 балла , что почти соответствует Deepseek-R1-0528 ( 81,0 ) и уступает высшему баллу Gemini-2.5 Pro — 86,4 .

На Arena-Hard v2 , который оценивает выравнивание и субъективные предпочтения через показатели выигрышей, Qwen3-Thinking-2507 набирает 79,7 балла, что ставит его выше всех конкурентов.

Результаты показывают, что эта модель не только превосходит свою предшественницу во всех основных категориях, но и устанавливает новый стандарт того, чего могут достичь модели с открытым исходным кодом, ориентированные на рассуждения.

Отход от «гибридного мышления»

Выпуск Qwen3-Thinking-2507 отражает более масштабный стратегический сдвиг команды Qwen компании Alibaba: отход от гибридных моделей рассуждений, которые требовали от пользователей ручного переключения между режимами «мышления» и «отсутствия мышления».

Вместо этого команда теперь обучает отдельные модели для задач рассуждения и обучения. Такое разделение позволяет оптимизировать каждую модель для её целевого назначения, что приводит к повышению согласованности, ясности и производительности. Новая модель Qwen3-Thinking полностью воплощает эту философию проектирования.

Параллельно с этим Qwen выпустила Qwen3-Coder-480B-A35B-Instruct — модель с 480 байтами параметров, предназначенную для сложных рабочих процессов кодирования. Она поддерживает 1 миллион окон контекста токенов и превосходит GPT-4.1 и Gemini 2.5 Pro по результатам проверки SWE-bench.

Также была анонсирована Qwen3-MT — многоязычная модель перевода, обученная на триллионах токенов для более чем 92 языков. Она поддерживает адаптацию к домену, контроль терминологии и вывод всего от 0,50 доллара за миллион токенов.

Ранее на этой неделе команда выпустила Qwen3-235B-A22B-Instruct-2507 — модель без логических рассуждений, которая превзошла Claude Opus 4 в нескольких тестах, а также представила облегченный вариант FP8 для более эффективного вывода на ограниченном оборудовании.

Все модели лицензированы по Apache 2.0 и доступны через Hugging Face, ModelScope и API Qwen.

Лицензирование: Apache 2.0 и его корпоративные преимущества

Qwen3-235B-A22B-Thinking-2507 выпускается по лицензии Apache 2.0 — весьма разрешительной и коммерчески выгодной лицензии, которая позволяет предприятиям загружать, изменять, размещать у себя, настраивать и интегрировать модель в собственные системы без ограничений.

Это контрастирует с закрытыми моделями или открытыми версиями, предназначенными только для исследований, которые часто требуют доступа к API, накладывают ограничения на использование или запрещают коммерческое развертывание. Для организаций и команд, контролирующих соблюдение нормативных требований и стремящихся контролировать расходы, задержки и конфиденциальность данных, лицензирование Apache 2.0 обеспечивает полную гибкость и право собственности.

Доступность и цены

Qwen3-235B-A22B-Thinking-2507 теперь доступен для бесплатной загрузки на Hugging Face и ModelScope.

Для тех предприятий, которые не хотят или не имеют ресурсов и возможностей размещать вывод модели на своем собственном оборудовании или в виртуальном частном облаке через API Alibaba Cloud, vLLM и SGLang.

- Входная цена: 0,70 доллара за миллион токенов

- Цена выхода: 8,40 долл. США за миллион токенов

- Бесплатный уровень: 1 миллион токенов, действительных в течение 180 дней

Интеграция и инструменты

Модель совместима с агентскими фреймворками через Qwen-Agent и поддерживает расширенное развертывание через совместимые с OpenAI API.

Его также можно запускать локально с использованием фреймворков transformer или интегрировать в стеки разработки через Node.js, инструменты CLI или структурированные интерфейсы подсказок.

Настройки выборки для наилучшей производительности включают температуру=0,6 , top_p=0,95 и максимальную длину выходных данных 81 920 токенов для сложных задач.

Корпоративные приложения и перспективы на будущее

Благодаря высокой производительности в тестах, возможности работы в длинных контекстах и разрешительной лицензии Qwen3-Thinking-2507 особенно хорошо подходит для использования в корпоративных системах искусственного интеллекта, включающих рассуждения, планирование и поддержку принятия решений.

Более широкая экосистема Qwen3, включающая модели кодирования, обучения и перевода, еще больше повышает привлекательность решения для технических групп и бизнес-подразделений, стремящихся внедрить ИИ в такие вертикали, как проектирование, локализация, поддержка клиентов и исследования.

Решение команды Qwen выпустить специализированные модели для отдельных вариантов использования, подкрепленное технической прозрачностью и поддержкой сообщества, сигнализирует о намеренном переходе к созданию открытой, производительной и готовой к использованию инфраструктуры ИИ .

Поскольку все больше предприятий ищут альтернативы моделям «черного ящика» с API-интерфейсом, серия Qwen от Alibaba все активнее позиционирует себя как жизнеспособную платформу с открытым исходным кодом для интеллектуальных систем, предлагающую как контроль, так и масштабируемые возможности.

Источник: venturebeat.com