Мы путаем «размер» с «интеллектом». Следующий скачок в развитии искусственного интеллекта произойдет не за счет увеличения размеров центров обработки данных, а за счет более ограниченных площадей.

Делиться

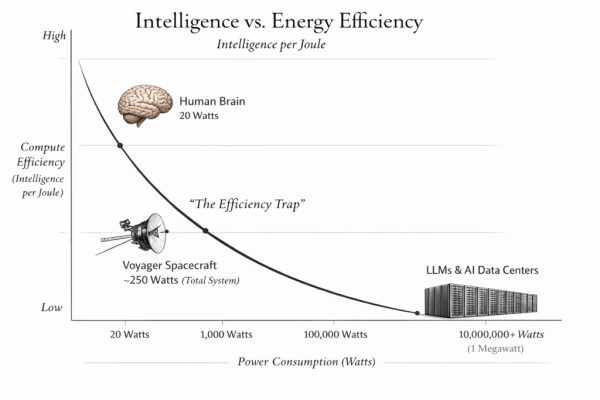

Мы вступаем в любопытную эпоху искусственного интеллекта, где размер ошибочно приравнивается к интеллекту. Модели становятся все больше и больше, достигая миллиардов параметров, центры обработки данных приобретают промышленные масштабы, а прогресс измеряется количеством потребляемой энергии в мегаваттах. Однако некоторые из самых гениальных интеллектуальных систем, когда-либо созданных — такие как межзвездные космические аппараты и человеческий мозг — работают в условиях чрезвычайно жестких ограничений. Они полагаются не на свой размер, а на свою эффективность.

В основе современной науки о данных лежит разделение. С одной стороны, машинное обучение соревнуется в масштабировании. С другой стороны, и это менее заметно, происходит революция в обратном направлении: это квантованные модели, вывод данных на периферии сети, TinyML и архитектуры, способные работать при очень ограниченных ресурсах. Это не ограничения, ведущие к снижению производительности. Это признаки революционных изменений в разработке интеллектуальных систем.

В этой статье выдвигается скромная, но провокационная идея: дефицит следует рассматривать не просто как ограничение интеллекта, а как наиболее значимый фактор его развития. Будь то «Вояджер-1», нейронная компрессия или само будущее человеческой цивилизации, выживают те системы, которые научились извлекать больше из меньшего. Эффективность не является препятствием для прогресса. Она — его конечная форма.

Парадокс «Вояджера»

В 1977 году человечество запустило одну из самых долговечных автономных инженерных систем в истории: «Вояджер-1» .

Он путешествует по Солнечной системе уже почти 50 лет, самостоятельно корректируя свой маршрут и передавая научные данные из космоса за пределами нашей Солнечной системы. Все эти подвиги он совершил, имея всего 69,63 килобайта памяти и процессор, работающий примерно в 200 000 раз медленнее, чем современные смартфоны.

Такое ограничение не считалось недостатком. Это был подход к проектированию.

Сравните это с нынешней ситуацией. В 2026 году мы радуемся огромным языковым моделям, которым требуется гигабайты памяти только для написания лимерика. Мы приняли как должное то, что можно описать только как цифровой гигантизм. Эффективность почти забыта; достижения теперь измеряются количеством параметров, кластерами GPU и потребляемыми мегаваттами.

Если бы «Вояджер-1» был создан с использованием современных технологий разработки программного обеспечения, он бы не смог выйти за пределы земной орбиты.

Помимо этого, природа остается безжалостно эффективной. Человеческий мозг — вероятно, самый умный интеллект на свете — потребляет всего около 20 ватт. «Вояджер» использует ядерный источник энергии, который производит еще меньше энергии, чем фен. Однако значительная часть того, что мы сейчас называем искусственным интеллектом, требует уровня энергопотребления, сопоставимого с показателями тяжелой промышленности.

Фактически, мы производим динозавров в среде, которая все больше благоприятствует млекопитающим.

Цифровые гиганты и их скрытая цена

В настоящее время продвинутые языковые модели содержат десятки или даже сотни миллиардов параметров, поэтому только их веса могут занимать несколько сотен гигабайт памяти. Например, GPT-3 в одинарной точности займет около 700 ГБ. Энергопотребление при обучении и работе таких систем равно энергопотреблению целого города.

Такой подход к проектированию приводит к различным видам структурной хрупкости:

- Экономическая нестабильность: стоимость облачных услуг, взимаемая за каждый запрос, очень быстро растет.

- Задержка: удаленный вывод данных вызывает задержки, которых невозможно избежать.

- Риск нарушения конфиденциальности: конфиденциальная информация должна покинуть локальные устройства.

- Экологические издержки: центры обработки данных для ИИ сейчас практически сравнялись с целыми отраслями по уровню выбросов углекислого газа.

В реальных ситуациях зачастую такие компромиссы не требуются. Более мелкие и специализированные системы чаще всего могут обеспечить основную функциональную ценность при значительно меньших затратах. Использование модели с триллионом параметров для решения очень специфической задачи все больше напоминает использование суперкомпьютера для работы с калькулятором.

Проблема не в отсутствии возможностей. Проблема в избыточности.

Ограничение как функция принуждения

Инженерные решения, как правило, накапливаются, когда ресурсов много. Однако, когда ресурсов мало, они становятся очень точными. Ограничения заставляют системы разрабатываться целенаправленно.

Хорошим примером является квантование — процесс снижения числовой точности весов модели.

import numpy as np np.random.seed(42) w = np.random.randn(4, 4).astype(np.float32) qmin, qmax = -128, 127 xmin, xmax = w.min(), w.max() scale = (xmax — xmin) / (qmax — qmin) zp = qmin — round(xmin / scale) q = np.clip(np.round(w / scale + zp), qmin, qmax).astype(np.int8) w_rec = (q.astype(np.float32) — zp) * scale print(«original:», w[0, 0]) print(«int8:», q[0, 0]) print(«reconstructed:», w_rec[0, 0]) print(«error:», abs(w[0, 0] — w_rec[0, 0]))

Уменьшение объема памяти на 75% само по себе не является просто достижением эффективности; это существенное изменение в природе модели. После удаления десятичных знаков скорость вывода возрастает, поскольку оборудование работает с целочисленной арифметикой более эффективно, чем с операциями с плавающей запятой. Исследования в отрасли всегда показывали, что снижение точности с 32-битной до 8-битной и даже до 4-битной практически не приводит к потере точности. Следовательно, ясно, что «умное» решение, будучи ограниченным, не превращается в низкоуровневое, а концентрируется. Оставшийся сигнал становится сильнее, более подвижным и, в конечном итоге, более развитым.

Галапагосы вычислительной техники

Представьте, что вы оказались на улицах Калькутты или на сельскохозяйственных угодьях Западной Бенгалии. Концепция «облачных технологий в первую очередь», принятая в Силиконовой долине, обычно сталкивается с реальностью ограниченного доступа к сетям 4G и высокой стоимости передачи данных в большей части стран Глобального Юга. В этих местах искусственный интеллект становится «полезным» только тогда, когда он работает локально.

В результате подобных ситуаций появились TinyML и Edge AI — не как уменьшенные копии «настоящего» ИИ, а как специальные разработки, способные работать на недорогом оборудовании без сетевого подключения.

Возьмем, к примеру, развертывание системы обнаружения болезней сельскохозяйственных культур с использованием набора данных PlantVillage. Огромный Vision Transformer (ViT) может достичь 99% точности на сервере в Вирджинии, но он бесполезен для фермера в отдаленной деревне без сигнала. Используя метод дистилляции знаний , который, по сути, представляет собой обучение большой модели «Учитель» небольшой модели «Ученик», такой как MobileNetV3 , мы могли бы осуществлять обнаружение ржавчины листьев в режиме реального времени на устройстве Android стоимостью 100 долларов.

На практике:

- Подключение: обработка данных происходит на самом устройстве.

- Энергопотребление: беспроводная передача сведена к минимуму.

- Конфиденциальность: исходные данные никогда не покидают устройство.

Пример определения границ в стиле TinyML

Для развертывания этих моделей «Студент» мы используем такие фреймворки, как TensorFlow Lite, для преобразования моделей в формат flatbuffer, оптимизированный для мобильных процессоров.

import tensorflow as tf import numpy as np interpreter = tf.lite.Interpreter(model_path=»model.tflite») interpreter.allocate_tensors() input_details = interpreter.get_input_details() output_details = interpreter.get_output_details() data = np.array([[0.5, 0.2, 0.1]], dtype=np.float32) interpreter.set_tensor(input_details[0]['index'], data) interpreter.invoke() output = interpreter.get_tensor(output_details[0]['index']) print(«Локальный вывод:», output)

Это не компромиссы, а скорее эволюционные преимущества. Устройство стоимостью 50 долларов теперь может выполнять работу, для которой раньше требовались целые серверные фермы. Эти системы не стремятся к высоким показателям производительности, а сосредоточены на выживании. С точки зрения эволюции, выживание выбирает эффективность, а эффективность приводит к устойчивости.

Тишина эффективна

Вполне естественно, что стремление к повышению эффективности на Земле может быть принципом, применимым и ко всей Вселенной в больших масштабах.

Парадокс Ферми ставит вопрос о том, почему Вселенная, кажется, лишена каких-либо признаков жизни, хотя статистически должно существовать развитое общество. Мы считаем, что разум должен развиваться в направлении наружу — сферы Дайсона, мегаструктуры и межзвездное вещание являются примерами того, как это может происходить.

Однако что, если зрелые организмы способны не к расширению, а к стабилизации?

Цивилизация, способная проводить вычисления с минимальным количеством отходов, практически до нуля, практически не оставит следов, которые мы могли бы обнаружить. Она ограничит коммуникацию до минимально возможного уровня. По мере развития её интеллекта, её след будет уменьшаться.

В данном случае молчание — это не отсутствие жизни, а высокая эффективность.

Принятие ограничений

По мере того, как мы переходим от «Вояджера-1» к человеческому мозгу и даже к представлению о сверхразумах, повторяется одна и та же закономерность: сначала эффективность, затем сложность.

Если наши самые передовые машины способны выполнять лишь крайне ограниченные задачи и при этом потребляют энергию, эквивалентную энергии целого города, то проблема не в наших чрезмерных амбициях, а в несовершенстве нашей архитектуры. Будущее ИИ будет не историей масштабов, а историей умения преодолевать ограничения.

Выживут не самые крупные системы, а самые эффективные.

Интеллект измеряется не количеством потребляемых ресурсов, а тем, насколько мало ему нужно.

Заключение

От «Вояджера-1» до человеческого мозга и современного периферийного ИИ — одна и та же идея постоянно повторяется: интеллект измеряется не тем, сколько он потребляет, а тем, насколько эффективно он работает. Нехватка ресурсов — не враг инноваций, а сам двигатель, который их формирует. Если доступно лишь небольшое количество ресурсов, то живые организмы становятся очень целенаправленными, точными и устойчивыми.

Квантование, TinyML и вывод данных непосредственно на устройстве больше не считаются временными решениями, которые инженерные команды могут использовать для устранения неполадок; скорее, это первые признаки важного эволюционного пути в вычислительной технике.

Будущее ИИ будет определяться не тем, какая модель будет самой крупной или какая инфраструктура будет самой шумной. Оно будет определяться проектами, которые обеспечат значительную функциональность с минимальными потерями ресурсов. Настоящий интеллект рождается тогда, когда энергия, память и пропускная способность ценятся как дефицитные ресурсы, а не как бесконечные запасы. В этом свете эффективность — это не что иное, как зрелость.

Рассказать эту историю смогут не те, кто просто постоянно совершенствуется, а те, кто постоянно оттачивает свое мастерство до уровня, когда ничего лишнего не остается. Интеллект в своем лучшем проявлении — это красота, ограниченная рамками.

Давайте вместе оптимизировать

Если вы работаете над тем, чтобы сделать ИИ более устойчивым, эффективным или доступным на периферии сети, я был бы рад пообщаться. Вы можете ознакомиться с другими моими работами и связаться со мной в LinkedIn.

Ссылки

- Лаборатория реактивного движения НАСА (JPL) : архивы миссии «Вояджер» и техническая документация космического аппарата.

- Исследовательская литература IBM и отраслевые публикации по квантизации ИИ и эффективному выводу заключений

- ЮНЕСКО публикует отчет о применении TinyML и периферийного ИИ в развивающихся регионах.

- Анализ энергопотребления в крупномасштабных системах искусственного интеллекта и центрах обработки данных.

- Современные научные дискуссии о парадоксе Ферми и энергоэффективном интеллекте.

Источник: towardsdatascience.com