Хотите получать более ценную информацию? Подпишитесь на наши еженедельные рассылки, чтобы получать только то, что важно для руководителей в сфере корпоративного ИИ, данных и безопасности. Подпишитесь сейчас

Началась очередная неделя лета 2025 года, и в продолжение тенденции прошлой недели появились более мощные китайские модели искусственного интеллекта с открытым исходным кодом.

Малоизвестный (по крайней мере, нам на Западе) китайский стартап Z.ai представил две новые модели LLM с открытым исходным кодом — GLM-4.5 и GLM-4.5-Air , — позиционировав их как подходящие решения для рассуждений ИИ, агентного поведения и программирования.

И, согласно сообщению в блоге Z.ai, эти модели показывают результаты, близкие к лучшим среди других моделей, предлагающих программы LLM в США.

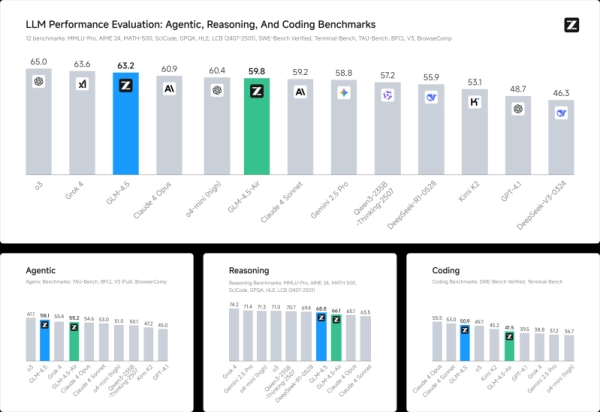

Например, флагманская модель GLM-4.5 соответствует или превосходит ведущие фирменные модели, такие как Claude 4 Sonnet , Claude 4 Opus и Gemini 2.5 Pro, по результатам таких тестов, как BrowseComp , AIME24 и SWE-bench Verified , а также занимает третье место в дюжине конкурентных тестов.

Масштабирование ИИ достигает предела

Ограничения мощности, рост стоимости токенов и задержки в выводе данных меняют корпоративный ИИ. Присоединяйтесь к нашему эксклюзивному салону, чтобы узнать, как обстоят дела у лучших команд:

- Превращение энергии в стратегическое преимущество

- Разработка эффективного вывода для реального увеличения пропускной способности

- Обеспечение конкурентоспособной рентабельности инвестиций с помощью устойчивых систем ИИ

Забронируйте свое место, чтобы оставаться впереди : https://bit.ly/4mwGngO

Его более легкий собрат, GLM-4.5-Air, также входит в шестерку лучших, показывая высокие результаты относительно своего меньшего размера.

Обе модели поддерживают два режима работы: режим размышлений для сложных рассуждений и использования инструментов и режим без размышлений для сценариев мгновенного реагирования. Они могут автоматически генерировать полноценные презентации PowerPoint на основе одного заголовка или подсказки, что делает их полезными для подготовки к совещаниям, обучения и внутренней отчётности.

Они также предлагают услуги по написанию креативных текстов, эмоциональному копирайтингу и созданию сценариев для создания брендированного контента для социальных сетей и веб-сайтов. Кроме того, z.ai заявляет, что поддерживает разработку виртуальных персонажей и пошаговые диалоговые системы для поддержки клиентов, ролевых игр, взаимодействия с фанатами или повествования от лица цифровых персонажей.

Хотя обе модели поддерживают рассуждения, кодирование и агентные возможности, GLM-4.5-Air предназначена для команд, ищущих более легкую и экономичную альтернативу с более быстрым выводом и меньшими требованиями к ресурсам.

Z.ai также перечисляет несколько специализированных моделей семейства GLM-4.5 в своем API, включая GLM-4.5-X и GLM-4.5-AirX для сверхбыстрого вывода, а также GLM-4.5-Flash — бесплатный вариант, оптимизированный для задач кодирования и рассуждений.

Теперь они доступны для использования непосредственно в Z.ai, а также через интерфейс прикладного программирования (API) Z.ai, позволяющий разработчикам подключаться к сторонним приложениям. Их код доступен на HuggingFace и ModelScope. Компания также предоставляет различные варианты интеграции, включая поддержку вывода через vLLM и SGLang.

Лицензирование и ценообразование API

GLM-4.5 и GLM-4.5-Air выпускаются под лицензией Apache 2.0 — разрешительной и коммерчески выгодной лицензией с открытым исходным кодом.

Это позволяет разработчикам и организациям свободно использовать, изменять, размещать у себя, настраивать и распространять модели как в исследовательских, так и в коммерческих целях.

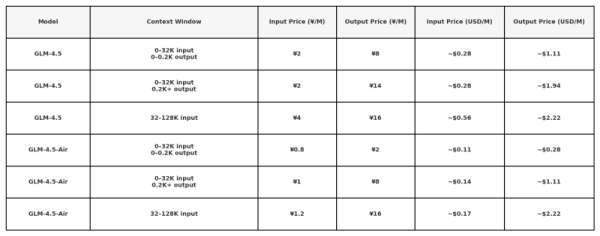

Для тех, кто не хочет загружать код модели или весовые коэффициенты и размещать их на собственном сервере или развертывать самостоятельно, облачный API z.ai предлагает модель по следующим ценам.

- ГЛМ-4.5 :

- 0,60 / 2,20 долл. США за 1 миллион токенов ввода/вывода

- GLM-4.5-Воздух :

- 0,20 долл. США / 1,10 долл. США за 1 млн токенов ввода/вывода

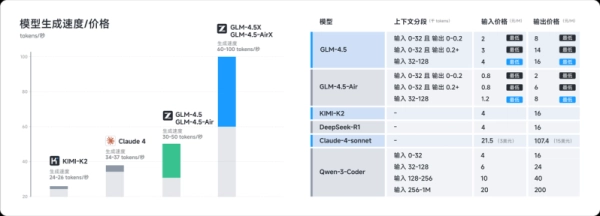

В статье CNBC о моделях сообщается, что z.ai будет взимать всего 0,11/0,28 долл. США за миллион токенов ввода/вывода, что также подтверждается графиком на китайском языке, который компания разместила в своей документации API для «модели Air».

Однако, по-видимому, это справедливо только для ввода до 32 000 токенов и вывода 200 токенов за один раз. (Токены отзыва — это числовые обозначения, которые LLM использует для представления различных семантических концепций и компонентов слов, родного языка LLM, при этом каждый токен переводится в слово или часть слова).

На самом деле, китайский график показывает гораздо более подробную информацию о ценах обеих моделей в расчёте на партии введённых/выведённых токенов. Я попытался перевести его ниже:

Еще одно замечание: поскольку z.ai базируется в Китае, тем на Западе, кто сосредоточен на суверенитете данных, следует провести комплексную проверку с помощью внутренних политик, прежде чем использовать API, поскольку на него могут распространяться ограничения на китайский контент.

Конкурентоспособные показатели по сторонним бенчмаркам, приближающиеся к показателям ведущих закрытых/патентованных LLM

GLM-4.5 занимает третье место по результатам 12 отраслевых тестов, измеряющих производительность агентов, рассуждений и кодирования, уступая только GPT-4 от OpenAI и Grok 4 от xAI. Его более компактный собрат GLM-4.5-Air оказался на шестой позиции.

В агентных оценках GLM-4.5 по производительности сопоставим с Claude 4 Sonnet и превосходит Claude 4 Opus в веб-задачах. Точность в тесте BrowseComp составляет 26,4% по сравнению с 18,8% у Claude 4 Opus. В категории «Рассуждение» GLM-4.5 демонстрирует конкурентоспособные результаты в таких задачах, как MATH 500 (98,2%), AIME24 (91,0%) и GPQA (79,1%).

В области программирования GLM-4.5 демонстрирует 64,2% успешных попыток на SWE-bench Verified и 37,5% на Terminal-Bench. В парных сравнениях он превосходит Qwen3-Coder с 80,8% побед и опережает Kimi K2 в 53,9% задач. Его возможности агентного программирования улучшены благодаря интеграции с такими инструментами, как Claude Code, Roo Code и CodeGeex.

Модель также лидирует по надежности вызова инструментов с показателем успешности 90,6%, опережая Claude 4 Sonnet и новейшую Kimi K2.

Часть волны китайских LLM с открытым исходным кодом

Выпуск GLM-4.5 состоялся на фоне всплеска запусков конкурентоспособных моделей с открытым исходным кодом в Китае, в первую очередь от команды Qwen из Alibaba .

Всего за одну неделю Qwen выпустила четыре новых LLM с открытым исходным кодом , включая ориентированную на рассуждение Qwen3-235B-A22B-Thinking-2507 , которая теперь превосходит или соответствует ведущим моделям, таким как OpenAI o4-mini и Google Gemini 2.5 Pro, в тестах на рассуждение, таких как AIME25, LiveCodeBench и GPQA.

На этой неделе Alibaba продолжила тенденцию, выпустив Wan 2.2 — новую мощную видеомодель с открытым исходным кодом.

Новые модели Alibaba, как и z.ai, лицензированы по Apache 2.0 , что допускает коммерческое использование, самостоятельный хостинг и интеграцию в собственные системы.

Широкая доступность и разрешительное лицензирование предложений Alibaba, а до этого — китайского стартапа Moonshot с его моделью Kimi K2, отражают постоянные стратегические усилия китайских компаний в сфере ИИ по позиционированию инфраструктуры с открытым исходным кодом как жизнеспособной альтернативы закрытым моделям, базирующимся в США.

Это также оказывает давление на американского поставщика моделей, стремящегося конкурировать на рынке открытого исходного кода. Meta начала активно нанимать новых сотрудников после дебюта семейства моделей Llama 4 в начале этого года, что вызвало неоднозначную реакцию со стороны сообщества ИИ, включая изрядную долю критики за то, что некоторые опытные пользователи ИИ посчитали бенчмаркингом и нестабильной производительностью.

Тем временем соучредитель и генеральный директор OpenAI Сэм Альтман недавно объявил, что долгожданный и широко разрекламированный проект OpenAI с открытым исходным кодом LLM (первый с момента запуска ChatGPT в конце 2022 года) будет отложен с изначально запланированного на июль релиза на пока неопределенную более позднюю дату.

Раскрыты уроки архитектуры и обучения

GLM-4.5 содержит 355 миллиардов общих и 32 миллиарда активных параметров. Аналог GLM-4.5-Air имеет более лёгкую конструкцию с 106 миллиардами общих и 12 миллиардами активных параметров.

В обоих случаях используется архитектура «Смесь экспертов» (MoE), оптимизированная с помощью маршрутизации баланса без потерь, сигмоидального стробирования и увеличенной глубины для улучшения рассуждений.

Блок внутреннего внимания включает в себя Grouped-Query Attention и большее количество головок внимания. Слой многотокенного прогнозирования (MTP) обеспечивает спекулятивное декодирование во время вывода.

Предварительное обучение охватывает 22 триллиона токенов, распределенных между корпусами кода общего назначения и кодом/рассуждениями. В середине обучения добавляется 1,1 триллиона токенов из данных кода уровня репозитория, входных данных синтетических рассуждений и источников с длинным контекстом/агентов.

Процесс постобучения Z.ai для GLM-4.5 основывался на фазе обучения с подкреплением, реализованной на базе внутренней инфраструктуры обучения с подкреплением Slime, которая разделяет процессы генерации данных и обучения модели для оптимизации производительности при выполнении агентских задач.

Среди использованных ими методов были внедрение смешанной точности и адаптивное обучение по учебной программе.

Первые помогают модели обучаться быстрее и эффективнее, используя при генерации данных математические вычисления с меньшей точностью, не жертвуя при этом большой точностью.

В то же время адаптивное обучение по учебной программе означает, что модель начинает с более простых задач и постепенно переходит к более сложным, помогая со временем постепенно осваивать более сложные задачи.

Архитектура GLM-4.5 ориентирована на вычислительную эффективность. Как сообщает CNBC, генеральный директор Z.ai Чжан Пэн заявил, что модель работает всего на восьми графических процессорах Nvidia H20 — чипах, специально разработанных для китайского рынка в соответствии с экспортным контролем США. Это примерно вдвое меньше аппаратных требований, чем у аналогичных моделей DeepSeek.

Интерактивные демонстрации

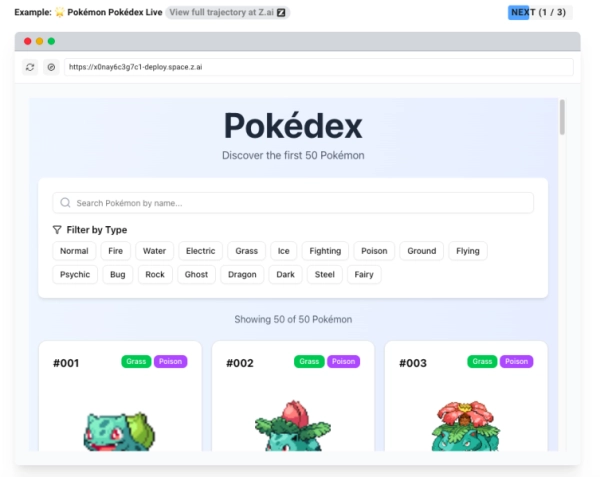

В своем блоге Z.ai выделяет области демонстрации комплексной разработки, создания слайдов и интерактивной генерации артефактов.

В качестве примеров можно привести клон Flappy Bird, веб-приложение Pokémon Pokédex и слайд-презентации, созданные на основе структурированных документов или веб-запросов.

Пользователи могут взаимодействовать с этими функциями на чат-платформе Z.ai или посредством интеграции API.

История компании и ее положение на рынке

По данным CNBC, компания Z.ai была основана в 2019 году под названием Zhipu и с тех пор превратилась в один из самых известных китайских стартапов в области искусственного интеллекта.

Компания привлекла более 1,5 млрд долларов США от инвесторов, включая Alibaba, Tencent, Qiming Venture Partners, а также муниципальные фонды из Ханчжоу и Чэнду, при дополнительной поддержке Prosperity7 Ventures, связанной с Aramco.

Запуск GLM-4.5 совпал с Всемирной конференцией по искусственному интеллекту в Шанхае, где несколько китайских компаний представили свои разработки. Z.ai также упоминался в июньском отчёте OpenAI, посвящённом прогрессу Китая в области искусственного интеллекта, и с тех пор был внесён в список организаций США, ограничивающий сотрудничество с американскими компаниями.

Что это означает для технических лиц, принимающих решения на предприятии

Для старших инженеров ИИ, инженеров по обработке данных и руководителей отделов ИИ, которым поручено создание, развертывание или масштабирование языковых моделей в производственной среде, выпуск семейства GLM-4.5 под лицензией Apache 2.0 представляет собой существенное изменение в возможностях.

Модель обеспечивает производительность, которая не уступает лучшим проприетарным системам в тестах на рассуждение, кодирование и агентские функции, но при этом включает полный доступ, права на коммерческое использование и гибкие пути развертывания, включая облачные, частные или локальные среды.

Для тех, кто управляет жизненными циклами LLM — будь то тонкая настройка моделей, организация многоэтапных конвейеров или интеграция моделей с внутренними инструментами — GLM-4.5 и GLM-4.5-Air устраняют препятствия для тестирования и масштабирования.

Модели поддерживают стандартные интерфейсы в стиле OpenAI и форматы вызова инструментов, что упрощает оценку в изолированных средах или внедрение в существующие структуры агентов.

GLM-4.5 также поддерживает потоковый вывод, кэширование контекста и структурированные ответы JSON , обеспечивая более плавную интеграцию с корпоративными системами и интерфейсами реального времени. Для команд, разрабатывающих автономные инструменты, режим глубокого мышления обеспечивает более точный контроль над многоэтапным рассуждением.

Для команд с ограниченным бюджетом или тех, кто стремится избежать привязки к поставщику, структура ценообразования оказывается ниже, чем у основных проприетарных альтернатив, таких как DeepSeek и Kimi K2. Это важно для организаций, где объём использования, задачи с длительным контекстом или конфиденциальность данных делают открытое развертывание стратегической необходимостью.

Для профессионалов в области инфраструктуры и оркестровки ИИ, таких как те, кто реализует конвейеры непрерывной интеграции и непрерывной доставки (CI/CD), занимается мониторингом моделей в рабочей среде или управляет кластерами графических процессоров, поддержка GLM-4.5 vLLM, SGLang и вывода со смешанной точностью соответствует современным передовым практикам эффективного масштабируемого обслуживания моделей. В сочетании с инфраструктурой обучения с подкреплением (RL) с открытым исходным кодом (Slime) и модульным стеком обучения, архитектура модели обеспечивает гибкость для настройки и расширения в доменно-ориентированных средах.

Короче говоря, запуск GLM-4.5 предоставляет корпоративным командам жизнеспособную, высокопроизводительную базовую модель, которую они могут контролировать, адаптировать и масштабировать , не привязываясь к проприетарным API или ценовым структурам. Это привлекательный вариант для команд, которым необходимо найти баланс между инновациями, производительностью и операционными ограничениями.

Источник: venturebeat.com