Почему более длительное обдумывание может иметь большее значение, чем масштаб.

Делиться

1. Введение

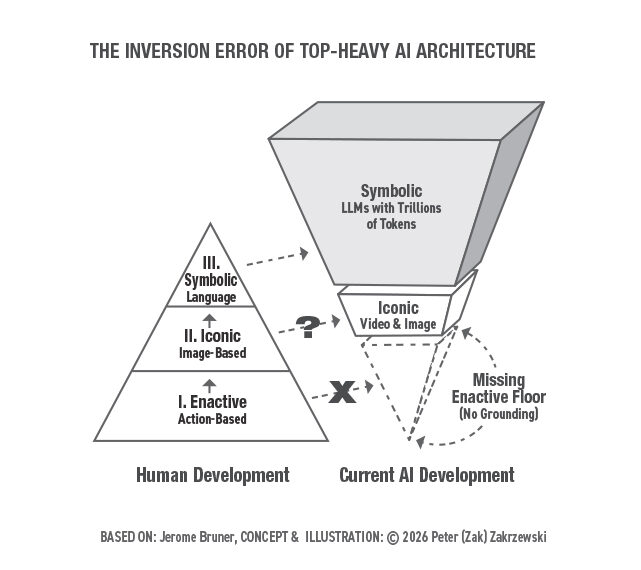

В течение последнего десятилетия вся индустрия ИИ всегда придерживалась одного негласного принципа: интеллект может возникнуть только в больших масштабах. Мы убедили себя, что для того, чтобы модели действительно имитировали человеческое мышление, нам нужны более крупные и глубокие нейронные сети. Неудивительно, что это привело к наложению всё большего количества блоков-трансформаторов друг на друга (Васвани и др., 2017)5, добавлению миллиардов параметров и обучению моделей в центрах обработки данных, которые потребляют мегаватты энергии.

Но не мешает ли нам эта гонка за созданием всё более крупных моделей увидеть гораздо более эффективный путь? Что если реальный интеллект не зависит от размера модели, а от того, как долго ей дается время на рассуждение? Может ли крошечная нейронная сеть, получив свободу итераций для собственного решения, превзойти по интеллекту модель, в тысячи раз превосходящую её по размерам?

2. Хрупкость гигантов

Чтобы понять, почему нам нужен новый подход, мы должны сначала разобраться, почему наши нынешние модели рассуждений, такие как GPT-4, Claude и DeepSeek, по-прежнему испытывают трудности со сложной логикой.

Эти модели в основном обучаются на задаче прогнозирования следующего токена (NTP). Они обрабатывают запрос через свои слои с миллиардом параметров, чтобы предсказать следующий токен в последовательности. Даже когда они используют «цепочку мыслей» (CoT) (Wei et al., 2022)4 для «рассуждения» о проблеме, они снова просто предсказывают слово, что, к сожалению, не является мышлением.

У этого подхода есть два недостатка.

Во-первых, она хрупкая. Поскольку модель генерирует ответы пошагово, одна ошибка на ранних этапах рассуждения может привести к совершенно другому, и часто неверному, ответу. Модель не способна остановиться, вернуться назад и скорректировать свою внутреннюю логику перед ответом. Она должна полностью придерживаться начатого пути, часто уверенно реагируя на происходящее, лишь бы закончить предложение.

Вторая проблема заключается в том, что современные модели рассуждений полагаются на запоминание, а не на логическое выведение. Они хорошо справляются с задачами, которые раньше не встречались, потому что, вероятно, уже сталкивались с подобными проблемами в своих огромных обучающих данных. Но когда они сталкиваются с новой проблемой — чем-то, с чем модели никогда раньше не сталкивались (например, с бенчмарком ARC-AGI) — их огромное количество параметров становится бесполезным. Это показывает, что существующие модели могут адаптировать известное решение, вместо того чтобы формулировать его с нуля.

3. Миниатюрные рекурсивные модели: обмен пространства на время

Модель крошечной рекурсии (TRM) (Jolicoeur-Martineau, 2025)¹ разбивает процесс рассуждения на компактный и циклический процесс. Традиционные трансформерные сети (также известные как наши модели LLM) представляют собой архитектуры прямого распространения, где им приходится обрабатывать входные данные и выдавать результат за один проход. TRM, с другой стороны, работает как рекуррентная машина с небольшим модулем MLP, который может итеративно улучшать свои выходные данные. Это позволяет ей превосходить лучшие современные модели рассуждений, при этом имея размер менее 7 миллионов параметров.

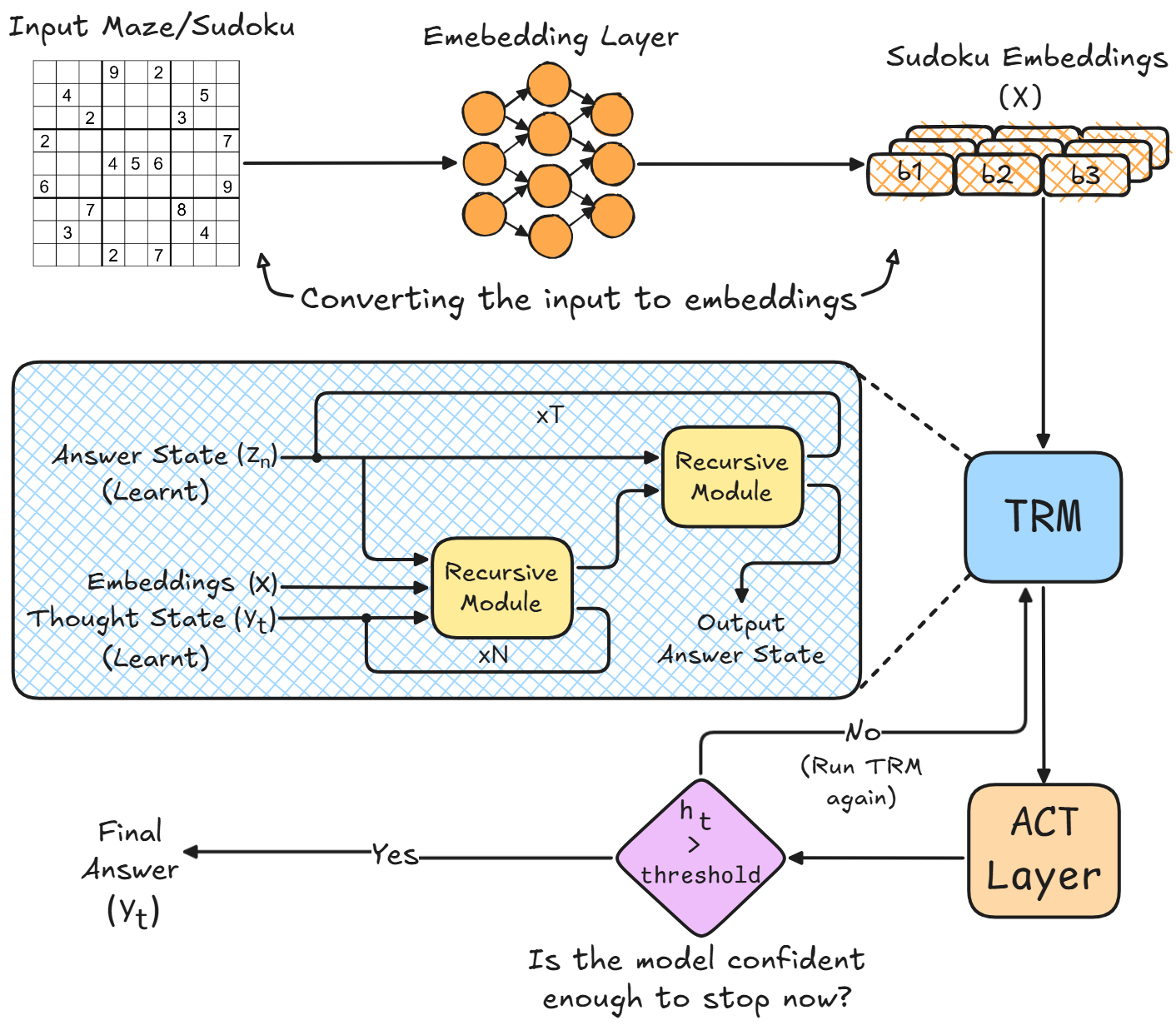

Чтобы понять, как эта сеть решает задачи настолько эффективно, давайте рассмотрим её архитектуру от входных данных до решения.

Визуальная иллюстрация всего процесса обучения/вывода TRM.

3.1. Структура: «Троица» государств

В стандартных LLM единственным «состоянием» является кэш ключ-значение истории разговора. В то же время, TRM поддерживает три различных информационных вектора, которые передают информацию друг другу:

- Неизменяемый вопрос (x): Исходная задача (например, лабиринт или сетка судоку), встроенная в векторное пространство. На протяжении всего обучения/вывода она никогда не обновляется.

- Текущая гипотеза (yt): текущая «наилучшая оценка» ответа, сделанная моделью. На шаге

t=0она инициализируется случайным образом как обучаемый параметр, который обновляется вместе с самой моделью. - Скрытый логический вывод (zn): Этот вектор содержит абстрактные «мысли» или промежуточную логику, которую модель использует для получения ответа. Подобно yt, он также инициализируется как случайный параметр в начале работы.

3.2. Основной механизм: одноканальная петля сети

В основе TRM лежит одна крошечная нейронная сеть, которая часто имеет всего два слоя. Эта сеть не является «модельным слоем» в традиционном смысле, а скорее представляет собой функцию, которая вызывается многократно.

Процесс рассуждения представляет собой вложенный цикл, состоящий из двух отдельных этапов: скрытого рассуждения и уточнения ответа .

Шаг А: Скрытое рассуждение (Обновление zn)

Во-первых, перед моделью стоит задача только думать. Она берет текущее состояние (три вектора, описанные выше) и запускает рекурсивный цикл для обновления своего внутреннего понимания проблемы.

За заданное количество подшагов (n) сеть обновляет свой скрытый вектор мыслей zn. Автор :

Модель принимает все три входных параметра и пропускает их через себя для обновления вектора мышления (это продолжается n шагов).

Здесь нейронная сеть анализирует проблему (x), свою текущую наилучшую догадку (yt) и предыдущую мысль (zn). Таким образом, модель может выявлять противоречия или логические скачки в своем понимании, которые затем используются для обновления zn. Обратите внимание, что ответ yt еще не обновлен. Модель просто размышляет/рассуждает о проблеме.

Шаг B: Уточнение ответа (Обновление yt)

После завершения цикла скрытого рассуждения (до n шагов) модель пытается спроецировать эти выводы в состояние ответа. Для этой проекции используется та же самая нейронная сеть:

Для уточнения состояния ответа модель обрабатывает только вектор мысли и текущее состояние ответа.

Модель преобразует свой процесс рассуждений (zn) в конкретное предсказание (yt). Этот новый ответ затем становится входными данными для следующего цикла рассуждений, который, в свою очередь, продолжается в течение T общих шагов.

Шаг C: Цикл продолжается

После каждых n шагов уточнения мысли выполняется один шаг уточнения ответа (который, в свою очередь, должен быть вызван T раз). Это создает мощную петлю обратной связи, в которой модель может уточнять свой собственный результат на протяжении нескольких итераций. Новый ответ (yt+1) может раскрыть некоторую новую информацию, которая была упущена на всех предыдущих шагах (например, «заполнение этой ячейки судоку показывает, что 5 должна стоять здесь»). Модель берет этот новый ответ, передает его обратно на шаг А и продолжает уточнять свои мысли, пока не заполнит всю сетку судоку.

3.3. Кнопка «Выход»: упрощенное адаптивное время вычислений

Еще одно важное нововведение подхода TRM заключается в том, как он эффективно обрабатывает весь процесс рассуждений. Простая задача может быть решена всего за два цикла, в то время как сложная может потребовать 50 или более, что означает, что жесткое кодирование фиксированного числа циклов является ограничительным и, следовательно, не идеальным вариантом. Модель должна уметь определять, решена ли задача уже или ей требуется еще несколько итераций для обдумывания.

TRM использует адаптивное время вычислений (ACT) для динамического определения момента остановки в зависимости от сложности входной задачи.

В рамках метода TRM остановка рассматривается как простая задача бинарной классификации, основанная на том, насколько модель уверена в своем текущем ответе.

Вероятность остановки (h):

В конце каждых T шагов уточнения ответа модель проецирует свое внутреннее состояние ответа в одно скалярное значение от 0 до 1, которое призвано представлять уверенность модели:

ht: Вероятность остановки.

σ: Сигмоидная функция активации для ограничения выходного сигнала в диапазоне от 0 до 1.

Линейное преобразование: Линейное преобразование, выполняемое над вектором ответа.

Цель обучения:

Модель обучается с использованием функции потерь Binary Cross-Entropy (BCE). Она учится выдавать 1 (стоп), когда ее текущий ответ yt совпадает с истинным значением, и 0 (продолжение), если не совпадает.

Losshalt: Значение функции потерь, используемое для обучения модели моменту остановки.

I(•): Условная функция, которая выдает 1, если условие внутри функции истинно, в противном случае — 0.

ytrue: Истинное значение, определяющее, следует ли модели останавливаться или нет.

Умозаключение:

При запуске модели для решения новой задачи она проверяет эту вероятность ht после каждого цикла (т.е. n ×T шагов).

- Если

ht > threshold: Модель достаточно уверена в своих силах. Она нажимает кнопку «Выход» и возвращает текущий ответ yt в качестве окончательного ответа. - Если

ht < threshold: Модель все еще не уверена. Она возвращает yt и zn обратно в цикл TRM для обсуждения и уточнения.

Этот механизм позволяет TRM быть вычислительно эффективным. Высокая точность достигается не за счет больших размеров, а за счет постоянного распределения вычислительного бюджета именно там, где это необходимо.

4. Результаты

Чтобы по-настоящему проверить пределы возможностей TRM, его производительность была протестирована на некоторых из самых сложных логических наборов данных, таких как судоку и задача ARC-AGI (Chollet, 2019)3.

1. Тест судоку-экстрем

Первое тестирование проводилось на бенчмарке Sudoku-Extreme, представляющем собой набор данных специально подобранных сложных головоломок судоку, требующих глубокого логического анализа и способности возвращаться к шагам, которые модель впоследствии осознает как неверные.

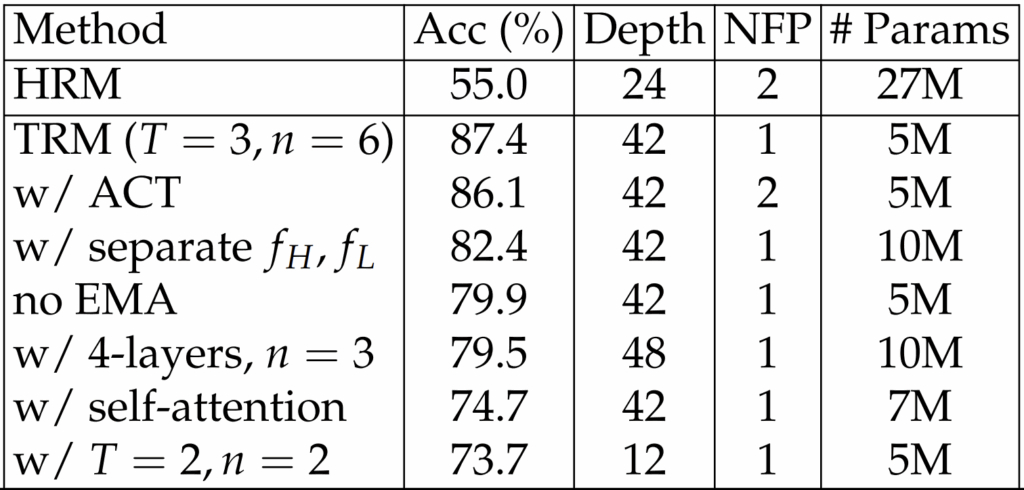

Результаты совершенно противоречат общепринятой практике. Метод TRM, имеющий всего 5 миллионов параметров, достиг точности 87,4% на данном наборе данных.

Чтобы было понятнее:

- Современные стандартные логические модели LLM, такие как Claude 3.7, GPT o3-mini и DeepSeek R1, не смогли решить ни одной задачи судоку из всего набора данных, что привело к нулевой точности по всем параметрам (Wang et al., 2025)².

- Предыдущая передовая рекурсивная модель (HRM) использовала 27 миллионов параметров (более чем в 5 раз больше) и достигла точности 55,0%.

- Просто убрав сложную иерархическую архитектуру HRM и сосредоточившись на одном рекурсивном цикле, TRM повысил точность более чем на 30 процентных пунктов, одновременно сократив количество параметров.

T и n: Количество циклов ответа и уточнения мысли соответственно.

w / ACT: С модулем адаптивного времени вычислений модель показывает несколько худшие результаты.

с отдельными fH, fL: Отдельные сети, используемые для обдумывания и уточнения ответов.

w / 4-слойная архитектура, n=3: Удвоена архитектурная глубина рекурсивного модуля, но количество рекурсий уменьшено вдвое.

w/ self-attention: Рекурсивный модуль, основанный на блоках внимания вместо MLP.

2. «Ловушка пропускной способности»: почему Deeper был хуже.

Пожалуй, наиболее парадоксальным открытием, сделанным авторами в ходе их исследования, стало то, что произошло, когда они попытались «улучшить» TRM, удвоив количество параметров.

Когда глубину нейронной сети увеличили с 2 до 4 слоев, производительность не повысилась, а наоборот, произошел сбой.

- Двухуровневая система TRM: точность решения судоку 87,4%.

- 4-слойная TRM: точность 79,5% при решении судоку.

В мире моделей с линейной регрессией добавление слоев и углубление модели были стандартным способом повышения интеллекта. Но для рекурсивных рассуждений на небольших наборах данных (модель TRM обучалась всего на ~1000 примерах) дополнительные слои могут стать недостатком, поскольку они позволяют модели излишне запоминать закономерности вместо того, чтобы их выводить, что приводит к переобучению.

Это подтверждает основную гипотезу статьи: глубина во времени превосходит глубину в пространстве. Меньшая модель может быть гораздо эффективнее, если она будет долгое время думать, чем большая модель, если она будет думать короткое время. Модели не требуется большая емкость для запоминания; ей просто нужно больше времени и эффективная среда для рассуждений.

3. Вызов ARC-AGI: Унижение гигантов

Корпус абстракции и рассуждений (ARC-AGI) широко считается одним из самых сложных тестов для проверки распознавания образов и логического мышления в моделях ИИ. По сути, он проверяет гибкий интеллект, то есть способность усваивать новые абстрактные правила системы всего на нескольких примерах. Именно здесь большинство современных моделей логического мышления обычно терпят неудачу.

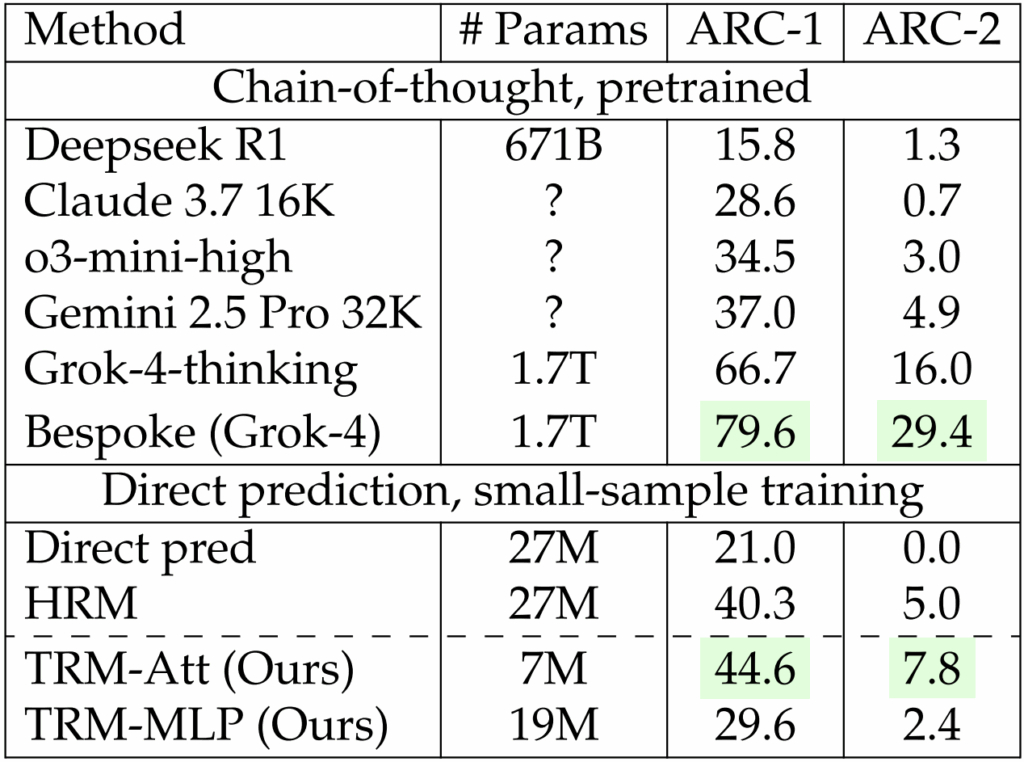

Результаты здесь еще более шокирующие. Модель TRM, обученная всего на 7 миллионах параметров , достигла точности 44,6% на модели ARC-AGI-1.

Сравните это с гигантами отрасли:

- DeepSeek R1 (671 миллиард параметров): точность 15,8%.

- Клод 3,7 (неизвестно, вероятно, сотни миллиардов): точность 28,6%.

- Gemini 2.5 Pro: точность 37,0%.

Модель, размер которой составляет всего 0,001% от размера DeepSeek R1, превзошла его почти в 3 раза . Это, пожалуй, самый эффективный результат, когда-либо зафиксированный на этом бенчмарке. Только модель Grok-4 с 1,7 ТБ параметров демонстрирует производительность, превосходящую рекурсивные методы HRM и TRM.

5. Заключение

В течение многих лет мы оценивали прогресс ИИ по количеству нулей после подсчета параметров. Модель крошечной рекурсии предлагает альтернативу этому подходу. Она доказывает, что модели не обязательно быть огромной, чтобы быть умной; ей просто нужно время, чтобы эффективно мыслить.

В контексте разработки искусственного общего интеллекта (AGI) ответ может заключаться не в создании огромных центров обработки данных для размещения моделей с триллионами параметров. Вместо этого он может заключаться в создании крошечных, эффективных логических моделей, способных обдумывать проблему столько времени, сколько потребуется, имитируя сам человеческий акт остановки, размышления и решения.

👉Если вам понравилась эта статья, я публикую более короткие и актуальные материалы на Substack.

👉А если вы хотите поддержать написание независимых научных работ, BuyMeACoffee поможет вам в этом.

Ссылки

- Жоликер-Мартино, А., Меньше значит больше: рекурсивное рассуждение с использованием крошечных сетей. arXiv.org (2025).

- Ван Г., Ли Дж., Сунь Ю., Чен X., Лю К., Ву Ю., Лу М., Сун С. и Ядкори Ю.А. (26 июня 2025 г.). Иерархическая модель рассуждения. arXiv.org.

- Шолле, Ф. (2019). О мере интеллекта. ArXiv.

- Вэй, Дж., Ван, С., Шуурманс, Д., Босма, М., Ихтер, Б., Ся, Ф., Чи, Э., Ле, К., и Чжоу, Д. (2022, 28 января). Метод «цепочки мыслей» стимулирует рассуждения в больших языковых моделях. arXiv.org.

- Васвани А., Шазир Н., Пармар Н., Ушкорейт Дж., Джонс Л., Гомес А.Н., Кайзер Л. и Полосухин И. (12 июня 2017 г.). Внимание – это все, что вам нужно. arXiv.org.

Мулик Гупта. Все работы Мулика Гупты.

Источник: towardsdatascience.com