Мы подробно описываем, как конфиденциальная технология федеративной аналитики используется для понимания особенностей генеративного ИИ на устройстве, обеспечивая высокую прозрачность в обработке и анализе пользовательских данных.

Быстрые ссылки

- Бумага

- GitHub

- Делиться

Генеративный ИИ (GenAI) обеспечивает персонализированный опыт и позволяет создавать неструктурированные данные, включая резюме, транскрипции и многое другое. Анализ реального использования ИИ [1, 2] может помочь разработчикам GenAI улучшить свои инструменты, понимая распространенные приложения и выявляя режимы сбоев. Особенно когда эти инструменты применяются к данным на устройстве, наша цель — предложить все более надежные гарантии конфиденциальности в процессе генерации информации. В этой статье представлены доказуемо конфиденциальные данные (PPI) — новый ориентир для генерации динамической информации о том, как люди используют LLM и инструменты GenAI, гарантируя при этом, что индивидуальные данные недоступны для проверки, а агрегированные данные анонимны.

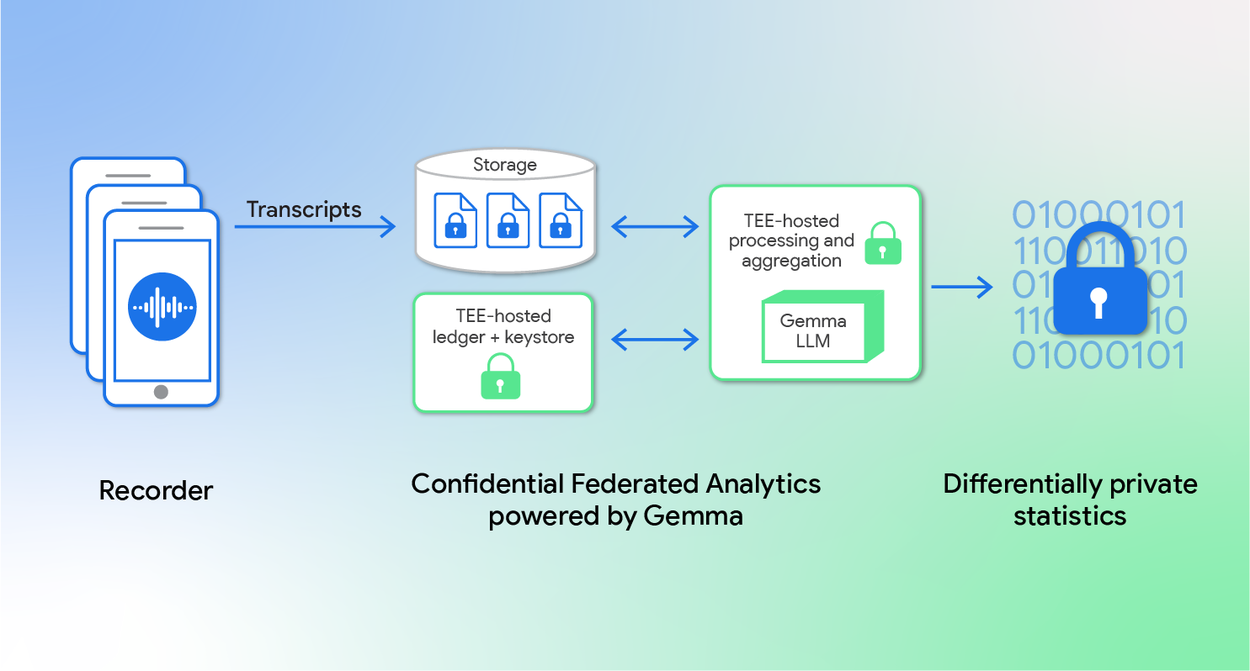

Сегодня мы объявляем о создании первой в своем роде системы защиты персональных данных (PPI), которая использует возможности больших языковых моделей (LLM), дифференциальной конфиденциальности (DP) и доверенных сред выполнения (TEE) для анализа неструктурированных данных GenAI. Эта система доказывает, что обработка на стороне сервера ограничена вычислениями, обеспечивающими конфиденциальность, и может быть полностью проверена извне. С помощью нашей системы разработчики инструментов GenAI могут анализировать взаимодействия, используя LLM-«эксперта по данным», которому поручено отвечать на такие вопросы, как «какая тема обсуждается?» или «не расстроен ли пользователь?». Ответы LLM-«эксперта по данным» агрегируются с помощью DP, чтобы обеспечить всестороннее представление об использовании функций GenAI среди пользователей без раскрытия неагрегированных данных. Сам LLM-«эксперт по данным» находится внутри TEE. PPI обеспечивается конфиденциальной федеративной аналитикой (CFA), методом, впервые примененным в Gboard, где программное обеспечение для анализа с открытым исходным кодом работает в TEE, обеспечивая полную прозрачность механизмов и свойств конфиденциальности обработки данных на стороне сервера. В нашем приложении Recorder для Pixel мы используем новейшие модели Gemma с открытым исходным кодом от Google в качестве «эксперта по данным», чтобы предоставлять информацию об использовании Recorder.

Чтобы побудить внешнее сообщество проверить наши утверждения, мы открыли исходный код аналитических данных, обеспечивающих конфиденциальность и работающих на основе LLM, в рамках конфиденциальной федеративной аналитики в Google Parfait, наряду с остальной частью нашего стека конфиденциальной федеративной аналитики, размещенного на сервере TEE.

Как можно доказуемо получить доступ к конфиденциальной информации

Технология CFA от Google использует конфиденциальные вычисления для защиты неагрегированных пользовательских данных во время обработки и предоставляет результаты только с формальной гарантией защиты данных (на уровне пользователя). CFA обеспечивает надежную изоляцию данных и анонимизацию независимо от того, какой запрос выполняет аналитик.

В этом методе пользовательские устройства сначала определяют, какие данные следует загрузить для анализа. Устройства шифруют и загружают эти данные вместе с этапами обработки, которые сервер имеет право использовать для расшифровки. Загруженные данные защищены ключами шифрования, управляемыми службой управления ключами, размещенной на TEE, которая предоставляет ключи расшифровки только утвержденным устройствами этапам обработки. Устройства могут убедиться, что служба управления ключами представляет собой ожидаемый открытый исходный код (включенный в общедоступный, защищенный от несанкционированного доступа журнал прозрачности, Rekor), и что код работает в правильно настроенном TEE, недоступном для Google. Служба управления ключами, в свою очередь, проверяет, что утвержденные общедоступные этапы обработки выполняются в TEE. Никакие другие анализы данных не могут быть выполнены, и ни один человек не может получить доступ к данным с отдельных устройств.

Получение конфиденциальной информации происходит путем обработки данных на основе четко определенного набора этапов. Сначала неструктурированные исходные данные анализируются с помощью LLM (Large-Listener Model), задача которого — извлечь ответ на конкретный вопрос, например, категорию или тему входных данных («структурированное суммирование»). Обработка начинается с использования модели Gemma 3 с открытым исходным кодом для классификации стенограмм по интересующим категориям. Затем эти классы суммируются для вычисления гистограммы тем с дифференциально-конфиденциальным шумом, гарантирующим, что на выходную гистограмму не может сильно повлиять какой-либо один пользователь. Запрос LLM может часто меняться, поскольку гарантия DP (Distributed Personality) применяется к алгоритму агрегирования независимо от запроса LLM. Даже если разработчик задаст вопрос, предназначенный для выделения одного пользователя, дифференциальная статистика конфиденциальности этого не выявит.

Все компоненты нашей системы, имеющие отношение к конфиденциальности, являются открытыми и воспроизводимо собираемыми — от алгоритма частной агрегации до стека TEE, — и сам LLM также является открытым исходным кодом. Подписи рабочих процессов, используемых для анализа данных, также являются общедоступными. В сочетании со способностью TEE подтверждать состояние системы, на которой работает программное обеспечение, каждая часть конвейера обработки данных может быть проверяемо связана с опубликованным кодом. Это дает сторонним организациям возможность проверять наши заявления о конфиденциальности. Именно эта приверженность сквозной проверяемости позволяет системе продвигаться к доказуемости — мы опираемся на эту возможность, позволяя третьим сторонам проверять открытый исходный код и подтверждать, что это именно тот код, который мы заявляем, тем самым доказывая клиентам, что это единственный код, с помощью которого будут обрабатываться их данные, с учетом известных уязвимостей в TEE текущего поколения.

Вкратце, с помощью структурированного процесса суммирования на основе LLM в конфиденциальной федеративной аналитике можно получать доказуемо конфиденциальные данные. Сочетание структурированного суммирования с генерацией гистограмм с дифференциальной конфиденциальностью позволяет глубже понять, как инструменты GenAI используются в реальном мире, гарантируя при этом конфиденциальность. Технические подробности системы можно найти в техническом документе.

Как в Recorder используются заведомо конфиденциальные данные

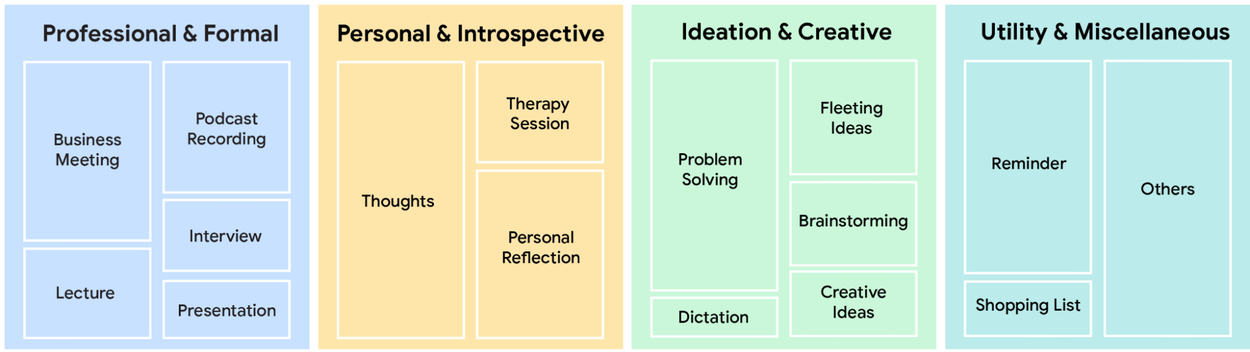

Приложение Google Recorder на Pixel предлагает мощные функции искусственного интеллекта, такие как транскрипция, суммирование и маркировка говорящих. Ключевая задача для разработчиков приложения — понять, как пользователи взаимодействуют с этими функциями. Например, создают ли пользователи «Заметки для себя», «Напоминания» или записывают «Деловые встречи»? Традиционные методы анализа на основе подсчета недостаточны для анализа таких данных без помощи структурированного суммирования или другой формы классификации. В традиционной системе эти стенограммы регистрировались бы на центральном сервере для классификации, а затем на основе полученных результатов выполнялись бы (дифференциально) частные запросы подсчета. PPI работает аналогичным образом, но без риска использования данных для каких-либо других целей.

В приложении «Запись» подмножество стенограмм (от пользователей, включивших в настройках опцию «Улучшить для всех») шифруется открытым ключом, управляемым центральным хранилищем ключей, размещенным в TEE и защищенным стеком аттестации Google Project Oak, работающим на процессорах AMD Secure Encrypted Virtualization-Secure Nested Paging (SEV-SNP). Хранилище ключей гарантирует, что загруженные данные могут быть расшифрованы только предварительно одобренными этапами обработки, которые сами подтверждены как выполняющие ожидаемые этапы обработки в TEE. Модель Gemma 3 4B, работающая в рамках AMD SEV-SNP TEE, классифицирует стенограммы по темам, которые затем агрегируются с использованием дифференциальной конфиденциальности. Внешние стороны могут убедиться, что необработанные стенограммы никогда не покидают защищенную среду TEE, и только частные суммы суммированных выходных категорий передаются в Google.

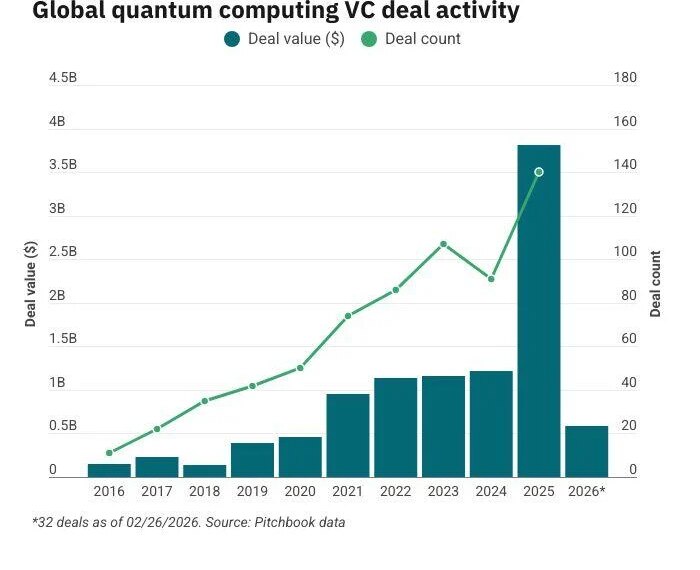

Пример распределения стенограмм разговоров, записанных Джеммой, по различным темам с учетом дифференцированной приватности. Размер внутреннего прямоугольника пропорционален относительной частоте встречаемости темы.

PPI также может помочь оценить производительность встроенных функций GenAI, например, точность сводок, генерируемых Recorder. Вместо того чтобы полагаться исключительно на синтетические данные, которые могут неточно отражать реальное использование, CFA может использовать LLM-автооценщик в рамках компонента структурированного суммирования. Этот LLM-автооценщик также находится в TEE и может оценивать результаты встроенной модели, обеспечивая более точную и конфиденциальную оценку. Это позволяет разработчикам точно настраивать встроенную модель на основе реального взаимодействия пользователей без ущерба для конфиденциальности отдельных лиц.

Конфигурация, используемая в Recorder, доступна в нашем репозитории GitHub, и, следуя этим инструкциям, вы можете получить доступ к конкретным путям выполнения кода и гарантиям конфиденциальности. Конфигурация Recorder гарантирует, что любой выполняемый LLM-запрос будет передан через автоматически настраиваемый агрегатор гистограмм DP со строгими гарантиями конфиденциальности (на уровне пользователя ε = 1, как показано на рисунке выше).

Что дальше?

В этой работе демонстрируется возможность получения доказуемо конфиденциальных данных: использование инструментов GenAI в реальных условиях анализируется с помощью LLM-моделей, а затем агрегируется в дифференциально конфиденциальную статистику, при этом все этапы обработки на стороне сервера остаются полностью прозрачными. Каждый этап процесса генерации данных разработан таким образом, чтобы обеспечить самую современную изоляцию и анонимизацию данных, а внешние верификаторы могут проверить исходный код методов и доказательство того, что мы их запускаем.

Кроме того, в качестве первого примера применения мы представили структурированное суммирование на основе LLM. Мы ожидаем, что за ним последуют и другие примеры, включая кластеризацию с дифференциальной конфиденциальностью и генерацию синтетических данных, все с тем же уровнем проверяемости и конфиденциальности. А благодаря дальнейшей работе по обеспечению конфиденциального использования высокопроизводительных ускорителей, таких как Google TPU, станут возможны более сложные анализы, включая детальный анализ стенограмм и автоматическую оценку. Теперь генерация аналитических выводов возможна без раскрытия конфиденциальных пользовательских данных за пределами зоны конфиденциальных вычислений и с надежными гарантиями защиты данных на уровне пользователя для сгенерированных выводов. Мы рады, что технология для доказуемо конфиденциальных аналитических выводов развивается как раз в тот момент, когда инструменты GenAI начинают применяться к работе с данными на устройствах и конфиденциальными данными.

Благодарности

Мы благодарим команды Google, которые помогли в разработке алгоритмов, внедрении инфраструктуры и техническом обслуживании этой системы, в частности команды под руководством Марко Грутесера, Питера Кайруза и Тимона Ван Овервельдта, а также менеджера по продукту Према Эрувбетина, в том числе: Альберта Чеу, Бретта МакЛарнона, Чуньсяна (Джейка) Чжэна, Эдо Рота, Эмили Гланц, Грейс Ни, Джеймса Белл-Кларка, Кассема Фаваза, Кэтрин Дейли, Кшиштофа Островски, Майю Спивак, Миру Холфорд, Нову Фаллен, Ракшиту Тандон, Рена И, Станислава Чикнаваряна, Стефана Дирауфа, Стива Хе и Зои Гонг. Мы также благодарим наших близких партнеров, которые поддержали эту систему с помощью технологий и интеграции Recorder, в том числе: Аллена Су, Остина Хсу, Консоля Чена, Даниэля Минаре Хо, Денниса Ченга, Яна Вассенберга, Кристи Брэдфорд, Лин Ли, Мину Аскари, Миранду Хуанг, Тама Ле, Яо-Нана Чена и Чжимина Яо. Эта работа была поддержана Коринной Кортес, Джеем Ягником, Рамананом Раджесвараном, Сеангом Чау и Йосси Матиасом. Кроме того, мы благодарим Питера Кайруза, Марко Грутесера, Марка Симборга и Кимберли Шведе за отзывы и вклад в написание этой статьи.

Источник: research.google