Проект Suncatcher — это амбициозный проект, осваивающий новые горизонты: оснащение спутниковых группировок, работающих на солнечной энергии, процессорами TPU и оптическими каналами связи в открытом космосе, чтобы в будущем масштабировать вычисления машинного обучения в космосе.

Быстрые ссылки

- Бумага

- Делиться

Искусственный интеллект (ИИ) — это фундаментальная технология, способная изменить наш мир, стимулировать новые научные открытия и помочь нам справиться с величайшими проблемами человечества. Сейчас мы задаемся вопросом, куда мы можем двигаться, чтобы раскрыть его полный потенциал.

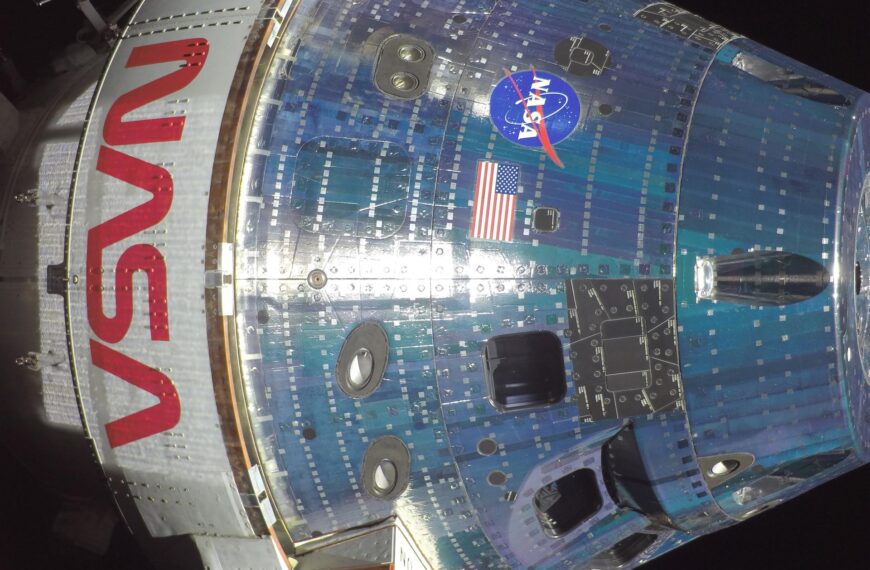

Солнце — главный источник энергии в нашей солнечной системе, излучающий более чем в 100 триллионов раз больше энергии, чем всё производство электроэнергии человечеством. На правильной орбите солнечная панель может быть в 8 раз продуктивнее, чем на Земле, и производить энергию практически непрерывно, снижая потребность в батареях. В будущем космос может стать лучшим местом для масштабирования вычислительных мощностей в области искусственного интеллекта. Исходя из этого, наш новый исследовательский проект «Лунный ковчег» (Project Suncatcher) предполагает создание компактных группировок спутников на солнечной энергии, несущих процессоры Google TPU и соединенных оптическими каналами связи в открытом космосе. Такой подход будет обладать огромным потенциалом для масштабирования, а также минимизирует воздействие на земные ресурсы.

Мы воодушевлены этим растущим направлением исследований и нашими первыми результатами, представленными сегодня в препринте «На пути к будущей масштабируемой космической инфраструктуре искусственного интеллекта», в котором описывается наш прогресс в решении фундаментальных проблем этого амбициозного проекта, включая высокоскоростную связь между спутниками, орбитальную динамику и влияние радиации на вычислительные процессы. Сосредоточившись на модульной конструкции из небольших взаимосвязанных спутников, мы закладываем основу для масштабируемой космической инфраструктуры искусственного интеллекта будущего.

Проект Suncatcher является частью давней традиции Google браться за амбициозные задачи, направленные на решение сложных научных и инженерных проблем. Как и во всех амбициозных проектах, здесь есть неизвестные факторы, но именно в этом духе мы десять лет назад приступили к созданию крупномасштабного квантового компьютера — еще до того, как это стало считаться реалистичной инженерной целью — и более 15 лет назад задумали создать беспилотный автомобиль, который в конечном итоге стал Waymo и теперь обслуживает миллионы пассажирских поездок по всему миру.

Проектирование системы и основные проблемы

Предлагаемая система представляет собой группировку спутников, объединенных в сеть, которые, вероятно, будут работать на солнечно-синхронной низкой околоземной орбите в период с рассвета до заката, где они будут подвергаться почти постоянному воздействию солнечного света. Такой выбор орбиты максимизирует сбор солнечной энергии и снижает потребность в тяжелых бортовых батареях. Для того чтобы эта система стала жизнеспособной, необходимо преодолеть ряд технических препятствий:

1. Создание межспутниковых каналов связи масштаба центров обработки данных.

Для крупномасштабных задач машинного обучения требуется распределение задач между многочисленными ускорителями с высокоскоростными соединениями с низкой задержкой. Для обеспечения производительности, сопоставимой с наземными центрами обработки данных, необходимы каналы связи между спутниками, поддерживающие десятки терабит в секунду. Наш анализ показывает, что это должно быть возможно с помощью многоканальных приемопередатчиков с плотным мультиплексированием по длине волны (DWDM) и пространственного мультиплексирования.

Однако для достижения такой полосы пропускания требуются уровни принимаемой мощности в тысячи раз выше, чем обычно в традиционных системах связи на большие расстояния. Поскольку принимаемая мощность обратно пропорциональна квадрату расстояния, мы можем преодолеть эту проблему, размещая спутники в очень тесном строю (на расстоянии километров или меньше), тем самым сводя к минимуму потери мощности сигнала в системе связи (т.е. учитывая потери мощности сигнала от начала до конца). Наша команда уже начала проверку этого подхода с помощью лабораторного демонстратора, который успешно достиг передачи данных со скоростью 800 Гбит/с в каждом направлении (всего 1,6 Тбит/с) с использованием одной пары приемопередатчиков.

2. Контроль над крупными, плотно сгруппированными спутниковыми группировками.

Высокоскоростные межспутниковые каналы связи требуют, чтобы наши спутники летали в гораздо более компактном строю, чем любая из существующих систем. Мы разработали численные и аналитические физические модели для анализа орбитальной динамики такой группировки. Мы использовали приближение, исходя из уравнений Хилла-Клохесси-Уилтшира (которые описывают орбитальное движение спутника относительно круговой опорной орбиты в кеплеровском приближении), и дифференцируемую модель на основе JAX для численного уточнения, учитывающую дальнейшие возмущения.

На высоте планируемой нами группировки спутников не сферичность гравитационного поля Земли и, возможно, атмосферное сопротивление являются доминирующими некеплеровскими эффектами, влияющими на динамику орбиты спутников. На рисунке ниже показаны траектории (за один полный оборот) для иллюстративной конфигурации группировки из 81 спутника в плоскости орбиты при средней высоте кластера 650 км. Радиус кластера составляет R=1 км, а расстояние между ближайшими спутниками колеблется в пределах ~100–200 м под воздействием гравитации Земли.

Модели показывают, что при расположении спутников на расстоянии всего нескольких сотен метров друг от друга нам, вероятно, потребуются лишь незначительные маневры для поддержания стабильного положения группировки в желаемой солнечно-синхронной орбите.

воспроизведение видео без звука зацикливание пауза видео без звука зацикливание включение звука видео выключение звука

Эволюция свободно падающей («без тяги») группировки спутников под действием гравитационного притяжения Земли, смоделированная с уровнем детализации, необходимым для получения солнечно-синхронных орбит, в невращающейся системе координат относительно центрального опорного спутника S0. Стрелка указывает на центр Земли. Пурпурный: ближайшие соседи спутника S0. Оранжевый: пример «периферийного» спутника S1. Оранжевая пунктирная линия: положение S1 относительно центра скопления (в невращающейся системе координат).

3. Радиационная стойкость ТПУ.

Для эффективной работы ускорителей машинного обучения в космосе они должны выдерживать условия низкой околоземной орбиты. Мы протестировали Trillium, облачный процессор TPU v6e от Google, в пучке протонов с энергией 67 МэВ, чтобы проверить воздействие суммарной ионизирующей дозы (TID) и эффектов одиночных событий (SEE).

Результаты оказались многообещающими. Хотя подсистемы высокоскоростной памяти (HBM) были наиболее чувствительным компонентом, они начали проявлять сбои только после суммарной дозы 2 крад(Si) — почти в три раза превышающей ожидаемую (защищенную) дозу 750 рад(Si) за пять лет эксплуатации. Серьезных отказов, связанных с радиационным облучением, до максимальной испытанной дозы 15 крад(Si) на одном чипе не наблюдалось, что указывает на удивительную радиационную стойкость термопластичных полимеров Trillium для космических применений.

4. Экономическая целесообразность и затраты на запуск.

Исторически сложилось так, что высокие затраты на запуск были основным препятствием для крупномасштабных космических систем. Однако наш анализ исторических и прогнозируемых данных о ценах на запуск показывает, что при устойчивом темпе обучения цены могут упасть до менее чем 200 долларов за килограмм к середине 2030-х годов . При такой цене стоимость запуска и эксплуатации космического центра обработки данных может стать примерно сопоставимой с заявленными затратами на электроэнергию аналогичного наземного центра обработки данных в расчете на киловатт-час в год[608112]. Подробнее см. в препринте.

Перспективы на будущее

Наш первоначальный анализ показывает, что основные концепции космических вычислений в области машинного обучения не исключаются фундаментальными физическими принципами или непреодолимыми экономическими барьерами. Однако остаются значительные инженерные проблемы, такие как управление тепловым режимом, высокоскоростная наземная связь и надежность системы на орбите.

Для решения этих задач следующим этапом станет учебная миссия в партнерстве с компанией Planet, в рамках которой к началу 2027 года планируется запуск двух прототипов спутников. Этот эксперимент позволит проверить, как наши модели и оборудование TPU работают в космосе, а также подтвердить возможность использования оптических межспутниковых каналов связи для распределенных задач машинного обучения.

В конечном итоге, для создания спутниковых группировок гигаваттного масштаба может потребоваться более радикальная конструкция; она может сочетать новые вычислительные архитектуры, более естественно подходящие для космической среды, с механической конструкцией, в которой сбор солнечной энергии, вычисления и управление тепловыми процессами тесно интегрированы. Подобно тому, как разработка сложных систем на кристалле была мотивирована и стала возможной благодаря современным смартфонам, масштаб и интеграция расширят возможности в космосе.

Благодарности

Статья «К созданию будущей масштабируемой космической инфраструктуры искусственного интеллекта» была написана Блезом Агуэрой-и-Аркасом, Трэвисом Билсом, Марией Биггс, Джессикой В. Блум, Томасом Фишбахером, Константином Громовым, Урсом Кёстером, Ришираджем Праваханом и Джеймсом Маника.

Мы благодарим Амаана Пирани за важный вклад в моделирование затрат и общий анализ осуществимости, Марчина Ковальчика за независимые численные расчеты, Пола Эппа и Стивена Палезе за вклад в концепцию ISL, Томаса Зурбухена за его вклад в концепции систем и архитектуры, а также Кенни Вассига и Джерри Чиу за техническую помощь в проектировании систем и тепловых процессов. Мы также благодарим компанию Muon Space за общие обсуждения и за анализ технической и экономической осуществимости концепции.

-

На основе общедоступных данных о затратах на электроэнергию в индустрии центров обработки данных.

Источник: research.google