Карл Франзен

Неужели Китай снова подхватывает эстафету в области искусственного интеллекта с открытым исходным кодом?

Z.ai, также известная как Zhupai AI, китайский стартап в области искусственного интеллекта, наиболее известный своим мощным семейством моделей GLM с открытым исходным кодом, сегодня представила GLM-5.1 под разрешительной лицензией MIT, позволяющей предприятиям загружать, настраивать и использовать ее в коммерческих целях. Они могут делать это на платформе Hugging Face.

Это произошло после того, как в прошлом месяце компания выпустила GLM-5 Turbo, более быструю версию, распространяемую исключительно по лицензии.

Новая модель GLM-5.1 разработана для автономной работы до восьми часов над одной задачей, что знаменует собой окончательный переход от программирования атмосферы к агентному проектированию.

Этот релиз знаменует собой поворотный момент в эволюции искусственного интеллекта. В то время как конкуренты сосредоточились на увеличении количества токенов для рассуждений с целью улучшения логики, Z.ai оптимизирует свою работу для достижения более продуктивных результатов.

GLM-5.1 — это модель «смешанных экспертов» с 754 миллиардами параметров, разработанная для поддержания согласованности целей на протяжении длительных трасс выполнения, охватывающих тысячи вызовов инструментов.

«К концу прошлого года агенты могли выполнять около 20 шагов», — написал руководитель z.ai Лу на X. «glm-5.1 может выполнить 1700 шагов. Время автономной работы может стать наиболее важным показателем после законов масштабирования. glm-5.1 станет первой точкой на этой кривой, которую сообщество открытого исходного кода сможет проверить своими руками. Надеюсь, вам понравится^^»

На рынке, все более переполненном быстро развивающимися моделями, Z.ai делает ставку на марафонца. Компания, которая вышла на Гонконгскую фондовую биржу в начале 2026 года с рыночной капитализацией в 52,83 миллиарда долларов, использует этот релиз для укрепления своих позиций в качестве ведущего независимого разработчика больших языковых моделей в регионе.

Технология: ступенчатая модель оптимизации

Ключевой технологический прорыв GLM-5.1 заключается не только в его масштабе, хотя 754 миллиарда параметров и контекстное окно из 202 752 токенов впечатляют, но и в его способности избежать эффекта плато, наблюдаемого в предыдущих моделях.

В традиционных агентных рабочих процессах модель обычно применяет несколько знакомых методов для быстрого достижения первоначальных результатов, а затем останавливается. Предоставление ей большего времени или большего количества обращений к инструментам обычно приводит к снижению отдачи или изменению стратегии.

Исследование компании Z.ai показывает, что GLM-5.1 работает по так называемой ступенчатой схеме, характеризующейся периодами постепенной настройки в рамках фиксированной стратегии, прерываемыми структурными изменениями, которые сдвигают границу производительности.

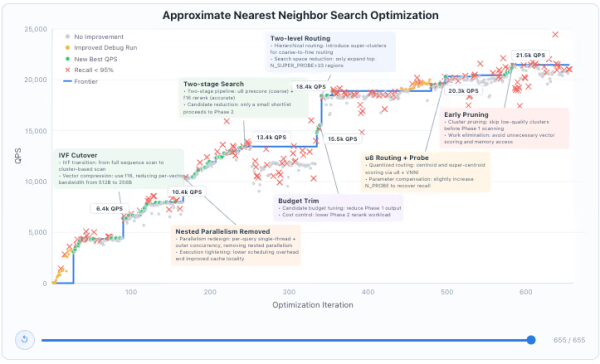

В первом сценарии их технического отчета модели была поставлена задача оптимизации высокопроизводительной векторной базы данных — задача, известная как VectorDBBench.

Модель поставляется с шаблоном на Rust и пустыми заглушками реализации, а затем использует агенты, основанные на вызовах инструментов, для редактирования кода, компиляции, тестирования и профилирования. В то время как предыдущие передовые результаты моделей, таких как Claude Opus 4.6, достигали потолка производительности в 3547 запросов в секунду, GLM-5.1 выполнила 655 итераций и более 6000 вызовов инструментов. Траектория оптимизации не была линейной, а прерывалась структурными прорывами.

На 90-й итерации модель перешла от сканирования всего корпуса к кластерному анализу IVF с векторным сжатием f16, что уменьшило пропускную способность каждого вектора с 512 байт до 256 байт и повысило производительность до 6400 запросов в секунду.

К 240-й итерации модель автоматически внедрила двухэтапный конвейер, включающий предварительную оценку u8 и переранжирование f16, достигнув производительности в 13 400 запросов в секунду. В конечном итоге модель выявила и устранила шесть структурных узких мест, включая иерархическую маршрутизацию через суперкластеры и квантованную маршрутизацию с использованием оценки центроидов через VNNI. Эти усилия привели к конечному результату в 21 500 запросов в секунду, что примерно в шесть раз превышает лучший результат, достигнутый за одну 50-ходовую сессию.

Это демонстрирует модель, которая функционирует как собственный научно-исследовательский отдел, разбивая сложные проблемы на составляющие и проводя эксперименты с высокой точностью.

Модель также позволила оптимизировать выполнение сложных операций, снизив накладные расходы на планирование и улучшив локальность кэша. В процессе оптимизации поиска приблизительного ближайшего соседа модель заблаговременно исключила вложенный параллелизм в пользу редизайна с использованием однопоточности для каждого запроса и внешней параллельности.

Когда модель сталкивалась с итерациями, в которых показатель полноты падал ниже 95-процентного порога, она диагностировала ошибку, корректировала параметры и применяла компенсацию параметров для восстановления необходимой точности. Именно такой уровень автономной коррекции отличает GLM-5.1 от моделей, которые просто генерируют код, не тестируя его в реальной среде.

Kernelbench: расширение границ машинного обучения

Устойчивость модели была дополнительно проверена в KernelBench Level 3, который требует сквозной оптимизации полных архитектур машинного обучения, таких как MobileNet, VGG, MiniGPT и Mamba.

В данном случае цель состоит в создании более быстрого ядра для графического процессора, чем эталонная реализация PyTorch, при сохранении идентичных выходных данных. Каждая из 50 задач выполняется в изолированном контейнере Docker с одним графическим процессором H100 и ограничена 1200 циклами использования инструмента. Корректность и производительность оцениваются по сравнению с базовой версией PyTorch eager в отдельных контекстах CUDA.

Результаты показывают существенный разрыв в производительности между GLM-5.1 и его предшественниками. В то время как оригинальный GLM-5 быстро улучшался, но на ранней стадии его производительность стабилизировалась на уровне 2,6-кратного ускорения, GLM-5.1 поддерживал свои усилия по оптимизации гораздо дольше. В конечном итоге он обеспечил геометрическое среднее ускорение в 3,6 раза по 50 задачам, продолжая демонстрировать полезный прогресс даже после 1000 циклов использования инструмента.

Хотя Claude Opus 4.6 по-прежнему лидирует в этом конкретном тесте с показателем 4,2x, GLM-5.1 значительно расширил производственные возможности моделей с открытым исходным кодом.

Эта возможность заключается не просто в увеличении контекстного окна; она требует от модели поддержания согласованности целей на протяжении длительного выполнения, что снижает дрейф стратегии, накопление ошибок и неэффективный метод проб и ошибок. Одним из ключевых прорывов является возможность формирования автономного цикла эксперимента, анализа и оптимизации, в рамках которого модель может заблаговременно проводить сравнительные тесты, выявлять узкие места, корректировать стратегии и постоянно улучшать результаты посредством итеративного совершенствования.

Все решения, разработанные в ходе этого процесса, были независимо проверены на предмет использования в бенчмарках, что гарантировало, что оптимизации не зависели от конкретных особенностей поведения бенчмарков, а работали с произвольными новыми входными данными, сохраняя при этом вычисления в потоке CUDA по умолчанию.

Продуктовая стратегия: подписка и субсидии.

GLM-5.1 позиционируется как инструмент инженерного уровня, а не как чат-бот для потребителей. Для этого Z.ai интегрировала его в комплексную экосистему Coding Plan, разработанную для прямой конкуренции с высококлассными инструментами для разработчиков.

Предлагаемый продукт разделен на три уровня подписки, каждый из которых включает бесплатные инструменты протокола контекстного моделирования (Model Context Protocol) для анализа изображений, веб-поиска, чтения веб-страниц и чтения документов.

Тарифный план Lite стоимостью 27 долларов США в квартал предназначен для несложных рабочих нагрузок и предлагает в три раза больший объем использования по сравнению с аналогичным планом Claude Pro. Тарифный план Pro стоимостью 81 доллар США в квартал разработан для сложных рабочих нагрузок, предлагая в пять раз больший объем использования по сравнению с планом Lite и на 40–60 процентов более быстрое выполнение.

Тарифный план Max стоимостью 216 долларов в квартал предназначен для опытных разработчиков с большими объемами работы, гарантируя производительность в часы пик.

Для тех, кто использует API напрямую или через такие платформы, как OpenRouter или Requesty, Z.ai установила цену на GLM-5.1 в размере 1,40 доллара США за миллион входных токенов и 4,40 доллара США за миллион выходных токенов. Также доступна скидка за кэширование в размере 0,26 доллара США за миллион входных токенов.

Модель | Вход | Выход | Общая стоимость | Источник |

Grok 4.1 Fast | 0,20 доллара | 0,50 доллара | 0,70 доллара | xAI |

Минимакс М2.7 | 0,30 доллара | 1,20 доллара | 1,50 доллара | МиниМакс |

Gemini 3 Flash | 0,50 доллара | 3,00 доллара | 3,50 доллара | |

Кими-К2.5 | 0,60 доллара | 3,00 доллара | 3,60 доллара | Лунный выстрел |

MiMo-V2-Pro (≤256K) | 1,00 долл. | 3,00 доллара | 4,00 доллара | Сяоми МиМо |

ГЛМ-5 | 1,00 долл. | 3,20 доллара | 4,20 доллара | З.ай |

GLM-5-Turbo | 1,20 доллара | 4,00 доллара | 5,20 долларов | З.ай |

GLM-5.1 | 1,40 доллара | 4,40 доллара | 5,80 долларов | З.ай |

Клод Хайку 4.5 | 1,00 долл. | 5,00 долларов | 6,00 долларов | Антропический |

Qwen3-Max | 1,20 доллара | 6,00 долларов | 7,20 долларов | Alibaba Cloud |

Gemini 3 Pro | 2,00 доллара | 12,00 долларов | 14,00 долларов | |

ГПТ-5.2 | 1,75 доллара | 14,00 долларов | 15,75 долларов | OpenAI |

ГПТ-5.4 | 2,50 доллара | 15,00 долларов | 17,50 долларов | OpenAI |

Клод Сонет 4.5 | 3,00 доллара | 15,00 долларов | 18,00 долларов | Антропический |

Клод Опус 4.6 | 5,00 долларов | 25,00 долларов | 30,00 долларов | Антропический |

GPT-5.4 Pro | 30,00 долларов | 180,00 долларов США | 210,00 долларов США | OpenAI |

Примечательно, что в часы пик, которые определяются как период с 14:00 до 18:00 по пекинскому времени ежедневно, потребление квоты в три раза превышает стандартный тариф. Однако, в рамках ограниченной по времени акции до апреля 2026 года, потребление в непиковые часы оплачивается по стандартному тарифу 1x. Дополняет флагманскую модель недавно представленная GLM-5 Turbo.

В то время как 5.1 — это марафонец, Turbo — это спринтер, запатентованный и оптимизированный для быстрого выполнения задач, таких как использование инструментов и постоянная автоматизация.

При стоимости 1,20 доллара за миллион входных данных / 4 доллара за миллион выходных данных, он дороже базовой модели GLM-5, но доступнее новой GLM-5.1, что делает его коммерчески привлекательным вариантом для высокоскоростных вычислений с контролируемым агентом.

Модель также упакована для локального развертывания и поддерживает такие фреймворки для вывода результатов, как vLLM, SGLang и xLLM. Подробные инструкции по развертыванию доступны в официальном репозитории GitHub, что позволяет разработчикам запускать модель MoE с 754 миллиардами параметров на собственной инфраструктуре.

Для корпоративных команд модель включает в себя расширенные возможности логического мышления, доступ к которым можно получить через параметр thinking в запросах API, что позволяет модели демонстрировать свой пошаговый внутренний процесс рассуждений, прежде чем предоставить окончательный ответ.

Эталонные показатели: новый глобальный стандарт

Данные о производительности GLM-5.1 свидетельствуют о том, что она превзошла ряд устоявшихся западных моделей в задачах программирования и проектирования.

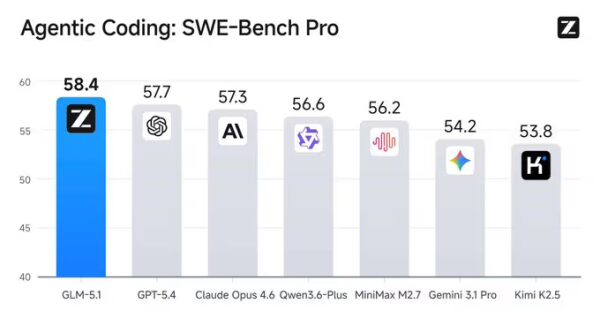

В тесте SWE-Bench Pro, оценивающем способность модели решать реальные задачи GitHub с помощью подсказки и контекстного окна из 200 000 токенов, GLM-5.1 показала результат 58,4. Для сравнения, это превосходит GPT-5.4 (57,7), Claude Opus 4.6 (57,3) и Gemini 3.1 Pro (54,2) .

Помимо стандартизированных тестов на программирование, модель продемонстрировала значительные успехи в тестах на логическое мышление и навыки работы с агентами. Она набрала 63,5 балла в Terminal-Bench 2.0 при оценке с использованием фреймворка Terminus-2 и достигла 66,5 баллов при использовании в паре с тестовым стендом Claude Code.

На тесте CyberGym модель показала результат 68,7 балла за один проход по 1507 задачам, продемонстрировав почти 20-балльное превосходство над предыдущей моделью GLM-5. Модель также показала высокие результаты на общедоступном наборе данных MCP-Atlas с результатом 71,8 балла и достигла 70,6 балла на T3-Bench.

В области логического мышления модель набрала 31,0 балла на экзамене Humanitys Last Exam, а после использования внешних инструментов — 52,3. На математическом конкурсе AIME 2026 она достигла 95,3 балла, а на экзамене GPQA-Diamond по научному мышлению экспертного уровня — 86,2 балла.

Наиболее впечатляющим результатом, подтвержденным личным опытом, стал тест по третьему сценарию: создание с нуля среды рабочего стола в стиле Linux за восемь часов.

В отличие от предыдущих моделей, которые могли отображать простую панель задач и окно-заглушку, прежде чем объявить задачу завершенной, GLM-5.1 автоматически заполняла файловый менеджер, терминал, текстовый редактор, системный монитор и даже функциональные игры.

В процессе разработки стиль и логика взаимодействия постоянно совершенствовались, пока не было создано визуально согласованное и функциональное веб-приложение. Это служит конкретным примером того, чего можно достичь, когда модели предоставляется время и возможность постоянно улучшать свою работу.

Лицензирование и открытый переход

Лицензирование этих двух моделей многое говорит о текущем состоянии мирового рынка ИИ. Модель GLM-5.1 выпущена под лицензией MIT, а её веса доступны для публичного использования на платформах Hugging Face и ModelScope.

Это соответствует исторической стратегии Z.ai, использующей релизы с открытым исходным кодом для укрепления доверия разработчиков и расширения экосистемы. Однако GLM-5 Turbo остается проприетарным и закрытым проектом. Это отражает растущую тенденцию среди ведущих лабораторий ИИ к гибридной модели: использование моделей с открытым исходным кодом для широкого распространения, в то время как оптимизированные для выполнения варианты остаются платными.

Аналитики отрасли отмечают, что этот сдвиг происходит на фоне перебалансировки китайского рынка, где такие гиганты, как Alibaba, также начинают отделять свои собственные разработки от проектов, находящихся в открытом доступе.

Похоже, генеральный директор Z.ai Чжан Пэн решает эту проблему, обеспечивая, чтобы, несмотря на доступность основных интеллектуальных функций флагманской системы для сообщества, высокоскоростная инфраструктура выполнения оставалась источником дохода.

Компания не обещает напрямую открыть исходный код GLM-5 Turbo, но заявляет, что полученные результаты будут учтены в будущих открытых релизах. Такая сегментированная стратегия способствует внедрению, позволяя компании одновременно строить устойчивую бизнес-модель вокруг наиболее коммерчески значимой работы.

Реакция сообщества и пользователей: результат недельной работы.

Реакция сообщества разработчиков на выпуск GLM-5.1 в подавляющем большинстве случаев сосредоточена на надежности модели в производственных средах.

Отзывы пользователей свидетельствуют о высокой степени доверия к автономности модели.

Один разработчик отметил, что GLM-5.1 поразила его своим качеством, заявив, что, по-видимому, она выполняет необходимые задачи более надежно, чем другие модели, и требует меньше доработок подсказок. Другой разработчик упомянул, что общий рабочий процесс модели, от планирования до выполнения проекта, работает превосходно, что позволяет ему с уверенностью доверять ей сложные задачи.

В отдельных примерах, присланных пользователями, подчеркивается значительное повышение эффективности.

Пользователь Crypto Economy News сообщил, что задача, включающая предварительную обработку кода, логику выбора признаков и настройку гиперпараметров, которая изначально занимала неделю, была выполнена всего за два дня. После перехода на тарифный план GLM Coding другие разработчики отметили, что получили возможность работать более свободно и сосредоточиться на основной разработке, не беспокоясь о нехватке ресурсов, которая могла бы помешать прогрессу.

В социальных сетях анонс запуска собрал более 46 000 просмотров за первый час, пользователей захватило заявление о восьмичасовой автономной работе. Среди первых пользователей сложилось мнение, что Z.ai успешно перешла от эпохи иллюзий в сфере ИИ к периоду, когда моделям можно доверять в плане самооптимизации посредством многократных итераций.

Возможность быстро создавать четыре приложения, используя правильные подсказки и структурированное планирование, по мнению многих пользователей, стала настоящим прорывом для отдельных разработчиков.

Последствия работы в долгосрочной перспективе

Выпуск GLM-5.1 предполагает, что следующий рубеж конкуренции в области ИИ будет измеряться не количеством токенов в секунду, а продолжительностью автономной работы.

Если модель может работать в течение восьми часов без вмешательства человека, это коренным образом меняет жизненный цикл разработки программного обеспечения.

Однако компания Z.ai признает, что это только начало. Остаются серьезные проблемы, такие как разработка надежной самооценки для задач, для которых не существует числовой метрики, по которой можно было бы проводить оптимизацию.

Еще одной серьезной проблемой является более ранний выход из локальных оптимумов, когда постепенная настройка перестает давать результаты, а также поддержание согласованности трассировки выполнения, охватывающей тысячи вызовов инструментов.

На данный момент Z.ai обозначила свои позиции. С помощью GLM-5.1 они представили модель, которая не просто отвечает на вопросы, но и завершает проекты. Модель уже совместима с широким спектром инструментов для разработчиков, включая Claude Code, OpenCode, Kilo Code, Roo Code, Cline и Droid.

Для разработчиков и предприятий вопрос уже не в том, «что я могу спросить у этого ИИ?», а в том, «что я могу ему поручить на следующие восемь часов?».

В центре внимания отрасли явно смещается направление на системы, способные надежно выполнять многоэтапные задачи с меньшим контролем. Этот переход к агентному инжинирингу знаменует собой новый этап в развертывании искусственного интеллекта в глобальной экономике.

Подпишитесь, чтобы получать самые свежие новости!

Подробные аналитические данные для руководителей предприятий в области искусственного интеллекта, данных и безопасности.

Отправляя свой адрес электронной почты, вы соглашаетесь с нашими Условиями использования и Политикой конфиденциальности.

Получайте обновления ! Вы подписаны! Наши последние новости скоро поступят на вашу электронную почту.

Источник: venturebeat.com