ИИ учится переводить речь на язык жестов — и обратно

Китайский стартап Limitless Mind разрабатывает систему, которая позволит переводить живую речь в язык жестов и обратно. Лёгкая модель предназначена для умных очков и смартфонов, чтобы сделать общение между глухими и слышащими естественным и двусторонним. Проект пока на стадии прототипа и ищет инвесторов.

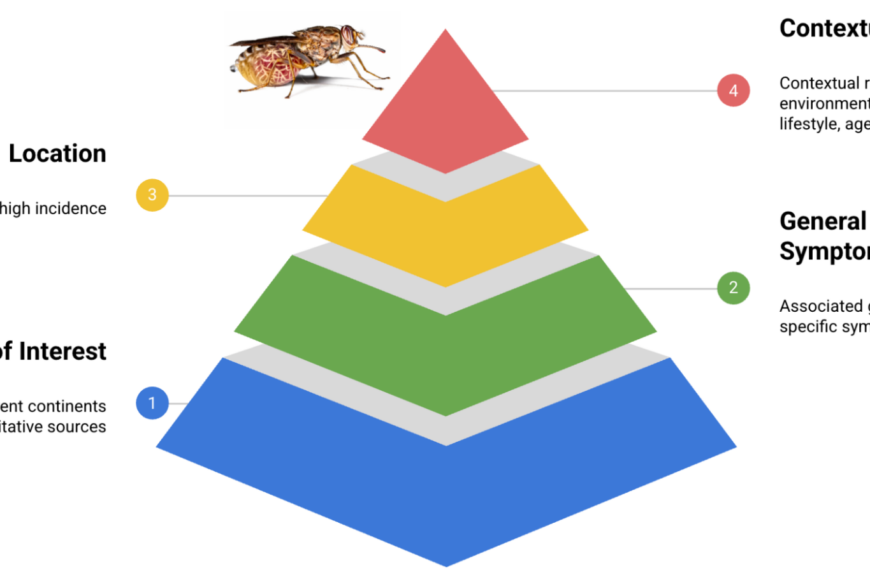

Исследователи собрали 12 000 размеченных видео с различными «диалектами» жестов, включая 3D-координаты движений рук, тела и мимики. На этих данных модель обучили распознавать жесты с видео и генерировать ответ в виде текста или речи, а также создавать 3D-аватара, который демонстрирует нужные жесты.

Преимущество такого подхода в том, что жестовый язык для многих — родной, тогда как чтение текста даётся не всем. Но его сложность в огромном количестве региональных различий и нюансах движений.

В разработке подобных систем уже участвуют и крупные компании:

— Baidu и Alibaba внедряют облачные решения с цифровыми аватарами;

— Google DeepMind представила модель SignGemma для американского языка жестов.

Если проект Limitless Mind выйдет на рынок, он может стать реальным мостом между мирами речи и жестов.