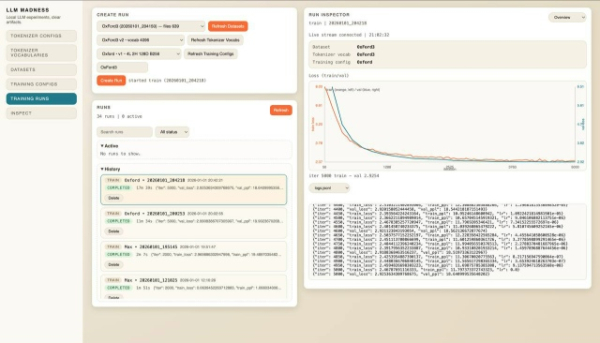

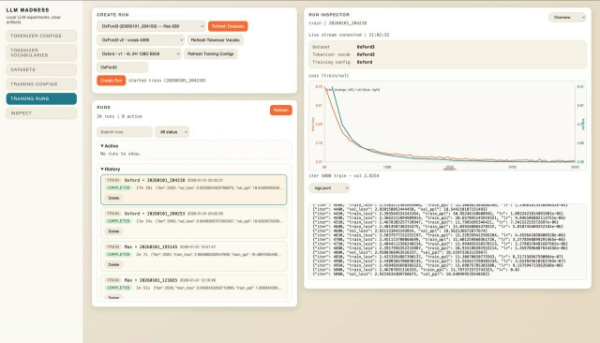

Загружаешь текст, настраиваешь архитектуру и в реальном времени смотришь, как нейронка учится.

Что внутри:

— Визуальный контроль: в UI видно всё — графики лосса, карты внимания (attention maps) и даже то, с какой вероятностью модель выбирает следующий токен;

— Настраиваем BPE, играемся с размером словаря и смотрим, как текст превращается в цифры;

— GPT-архитектура: под капотом честная реализация трансформера, параметры которого (слои, головы, размер блока) можно крутить как угодно;

— Пайплайн сам хеширует датасеты, бьет на train/val и кеширует токены, чтобы не греть процессор зря.

Выращиваем карманный Skynet (https://github.com/MaxHastings/llm-madness)

Источник: github.com

Источник: ai-news.ru