Полный обзор архитектур для выполнения точных прогнозов на основе наиболее распространенных типов наборов данных.

Делиться

Фундаментальные модели — это масштабные модели искусственного интеллекта, обученные на обширном и разнообразном спектре данных, таких как аудио, текст, изображения или их комбинации. Благодаря своей универсальности, фундаментальные модели производят революцию в обработке естественного языка, компьютерном зрении и даже анализе временных рядов. В отличие от традиционных алгоритмов искусственного интеллекта, фундаментальные модели предлагают готовые прогнозы без необходимости обучения с нуля для каждого конкретного приложения. Их также можно адаптировать для решения более специфических задач с помощью тонкой настройки.

В последние годы мы наблюдаем взрывной рост числа фундаментальных моделей, применяемых к неструктурированным данным и временным рядам. К ним относятся GPT-ряды и BERT от OpenAI для текстовых задач, CLIP и SAM для обнаружения, классификации и сегментации объектов, а также PatchTST, Lag-Llama и Moirai-MoE для прогнозирования временных рядов. Несмотря на этот рост, фундаментальные модели для табличных данных остаются в значительной степени неисследованными из-за ряда проблем. Во-первых, табличные наборы данных по своей природе неоднородны. Они имеют вариации в типах признаков (булевские, категориальные, целочисленные, с плавающей точкой) и разные масштабы числовых признаков. Табличные данные также страдают от отсутствия информации, избыточных признаков, выбросов и несбалансированных классов. Еще одной проблемой при построении фундаментальных моделей для табличных данных является нехватка высококачественных открытых источников данных. Часто общедоступные наборы данных имеют небольшой размер и содержат много шума. Возьмем, к примеру, сайт для бенчмаркинга табличных данных openml.org. Здесь 76% наборов данных содержат менее 10 тысяч строк [2].

Несмотря на эти трудности, было разработано несколько базовых моделей для табличных данных. В этой статье я рассмотрю большинство из них, остановившись на их архитектуре и ограничениях. Я хочу ответить на следующие вопросы: каково текущее состояние базовых моделей для табличных данных? Можно ли их применять в рабочей среде или они подходят только для создания прототипов? Лучше ли базовые модели классических алгоритмов машинного обучения, таких как градиентный бустинг? В мире, где табличные данные составляют большую часть данных в компаниях, знание того, какие базовые модели внедряются и их текущие возможности, представляет большой интерес для сообщества специалистов по данным.

TabPFN

Начнём с представления самой известной базовой модели для табличных данных малого и среднего размера: TabPFN. Этот алгоритм был разработан Prior Labs. Первая версия вышла в 2022 году [1], но обновления её архитектуры были выпущены в январе 2025 года [2].

TabPFN — это сеть, подобранная по априорным данным, то есть использующая байесовский вывод для построения прогнозов. В байесовском выводе есть два важных понятия: априорное и апостериорное. Априорное — это распределение вероятностей, отражающее наши убеждения или предположения о параметрах до наблюдения каких-либо данных. Например, вероятность выпадения 6 очков при броске игральной кости равна 1/6. Апостериорное — это обновлённое убеждение или распределение вероятностей после наблюдения данных. Оно объединяет ваши первоначальные предположения (априорное) с новыми данными. Например, вы можете столкнуться с тем, что вероятность выпадения 6 очков при броске игральной кости на самом деле не равна 1/6, поскольку кость смещена.

В TabPFN априорная вероятность определяется 100 миллионами синтетических наборов данных, тщательно разработанных для охвата широкого спектра потенциальных сценариев, с которыми может столкнуться модель. Эти наборы данных содержат широкий спектр взаимосвязей между признаками и целевыми значениями (подробнее см. в [2]).

Апостериорная функция – это предсказательная функция распределения

Это вычисляется путем обучения архитектуры модели TabPFN на синтетических наборах данных.

Архитектура модели

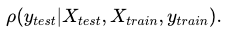

Архитектура TabPFN показана на следующем рисунке:

В левой части диаграммы показан типичный табличный набор данных. Он состоит из нескольких обучающих строк с входными признаками (x1, x2) и соответствующими им целевыми значениями ( y ). Он также включает одну тестовую строку, в которой есть входные признаки, но отсутствует целевое значение. Цель сети — предсказать целевое значение для этой тестовой строки.

Архитектура TabPFN состоит из серии из 12 идентичных слоёв. Каждый слой содержит два механизма внимания. Первый — это одномерное внимание к признакам, которое изучает взаимосвязи между признаками набора данных. По сути, это позволяет модели «обращаться» к наиболее релевантным признакам для заданного прогноза. Второй механизм внимания — это одномерное внимание к выборке . Этот модуль анализирует один и тот же признак во всех остальных выборках. Внимание к выборке — ключевой механизм, обеспечивающий обучение в контексте (In-Context Learning, ICL), при котором модель обучается на предоставленных обучающих данных без необходимости обратного распространения. Эти два механизма внимания позволяют архитектуре оставаться инвариантной к порядку как выборок, так и признаков.

Выход 12 слоёв представляет собой вектор, который поступает в многослойный персептрон (MLP). MLP — это небольшая нейронная сеть, преобразующая вектор в итоговый прогноз. В задаче классификации итоговый прогноз не является меткой класса. Вместо этого MLP выдаёт вектор вероятностей, где каждое значение представляет собой уверенность модели в принадлежности входных данных определённому классу. Например, для задачи с тремя классами выходными данными могут быть [0,1; 0,85; 0,05]. Это означает, что модель на 85% уверена в принадлежности входных данных ко второму классу.

Для задач регрессии выходной слой MLP модифицируется для создания непрерывного значения вместо распределения вероятностей по дискретным классам.

Использование

Использовать TabPFN довольно просто! Установить его можно через pip или из исходного кода. Prior Labs предоставляет отличную документацию со ссылками на различные репозитории GitHub, где можно найти блокноты Colab для непосредственного изучения этого алгоритма. API Python аналогичен API Scikit Learn, используя функции fit/predict.

Функция соответствия в TabPFN не означает, что модель будет обучена, как в классическом подходе машинного обучения. Вместо этого функция соответствия использует обучающий набор данных в качестве контекста. Это связано с тем, что TabPFN использует ICL. В этом подходе модель использует имеющиеся знания и обучающие выборки для понимания закономерностей и генерации более точных прогнозов. ICL просто использует обучающие данные для управления поведением модели.

TabPFN обладает отличной экосистемой, в которой вы также найдете несколько утилит для интерпретации вашей модели с помощью SHAP. TabPFN также предлагает инструменты для обнаружения выбросов и создания табличных данных. Вы даже можете комбинировать TabPFN с традиционными моделями, такими как случайный лес, для улучшения прогнозов, используя гибридные подходы. Все эти функции доступны в репозитории TabPFN на GitHub.

Замечания и ограничения

После тестирования TabPFN на большом частном наборе данных, содержащем как числовые, так и категориальные признаки, вот некоторые выводы:

- Убедитесь, что вы предварительно обработали данные. Все элементы категориальных столбцов должны быть строковыми; в противном случае код выдаст ошибку.

- TabPFN — отличный инструмент для небольших и средних наборов данных, но не для больших таблиц. При работе с большими наборами данных (более 10 000 строк, более 500 признаков или более 10 классов) вы достигнете пределов предварительного обучения, что скажется на качестве прогнозирования.

- Имейте в виду, что вы можете столкнуться с ошибками CUDA, которые трудно отладить.

Если вам интересно посмотреть, как TabPFN работает на разных наборах данных в сравнении с классическими методами усиления, я настоятельно рекомендую эту замечательную публикацию Бахадира Акдемира:

TabPFN: как предварительно обученный преобразователь превосходит традиционные модели на табличных данных (запись в блоге Medium)

КАРТА

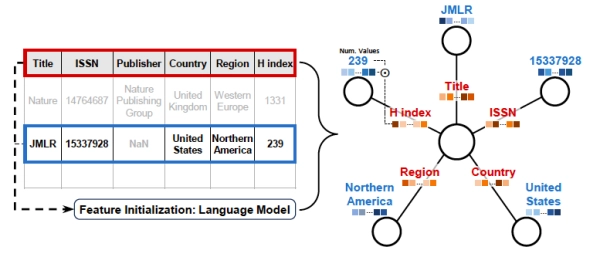

Вторая базовая модель для табличных данных использует графовые структуры для создания интересной архитектуры модели: я говорю о представлении записей таблицы с учетом контекста, или модели CARTE [3].

В отличие от изображений, где объект обладает определёнными характеристиками независимо от своего внешнего вида на изображении, числа в табличных данных не имеют смысла, если контекст не добавлен через названия соответствующих столбцов. Один из способов учесть как числа, так и названия соответствующих столбцов — использовать графическое представление соответствующей таблицы. Команда SODA использовала эту идею при разработке CARTE.

CARTE преобразует таблицу в графовую структуру, преобразуя каждую строку в графлет. Строка в наборе данных представлена в виде небольшого звездообразного графа, где каждое значение строки становится узлом, соединённым с центральным узлом. Имена столбцов служат рёбрами графа.

Для категориальных значений строк и имён столбцов CARTE использует d-мерное встраивание, сгенерированное на основе языковой модели. Таким образом, предварительная обработка данных, такая как категориальное кодирование исходной таблицы, не требуется.

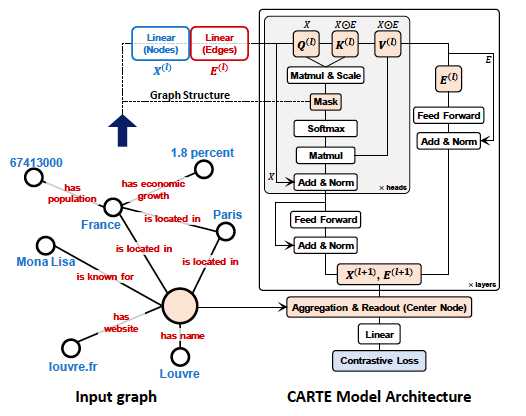

Архитектура модели

Каждый из созданных графлетов содержит признаки узлов (X) и ребер (E). Эти признаки передаются в графо-внимательную сеть, которая адаптирует классическую архитектуру кодировщика Transformer. Ключевым компонентом этой графо-внимательной сети является слой собственного внимания, который вычисляет внимание как по признакам узлов, так и по признакам ребер. Это позволяет модели понимать контекст каждой записи данных.

Архитектура модели также включает слой агрегации и считывания, действующий на центральном узле. Выходные данные обрабатываются с учётом контрастных потерь.

CARTE был предварительно обучен на большой базе знаний YAGO3 [4]. Эта база знаний была создана на основе таких источников, как Wikidata, и содержит более 18,1 миллиона триплетов по 6,3 миллиона записей.

Использование

Репозиторий GitHub для CARTE находится в стадии активной разработки. Он содержит блокнот Colab с примерами использования этой модели для задач регрессии и классификации. Согласно этому блокноту, установка довольно проста и выполняется через pip install. Как и TabPFN, CARTE использует интерфейс Scikit-learn (fit-predict) для прогнозирования на основе ранее не наблюдавшихся данных.

Ограничения

Согласно статье CARTE [3], этот алгоритм обладает рядом существенных преимуществ, таких как устойчивость к пропущенным значениям. Кроме того, при использовании CARTE не требуется сопоставление сущностей. Поскольку для встраивания строк и имён столбцов используется LLM, этот алгоритм может обрабатывать сущности, которые могут выглядеть по-разному, например, «Londres» вместо «London».

Хотя CARTE хорошо работает на небольших таблицах (менее 2000 выборок), модели на основе деревьев могут быть более эффективны на больших наборах данных. Кроме того, для больших наборов данных CARTE может потребовать больше вычислительных ресурсов, чем традиционные модели машинного обучения.

Более подробную информацию об экспериментах, проведенных разработчиками этой основополагающей модели, можно найти в замечательном блоге Гаэля Вароко:

CARTE: к моделям оснований столов

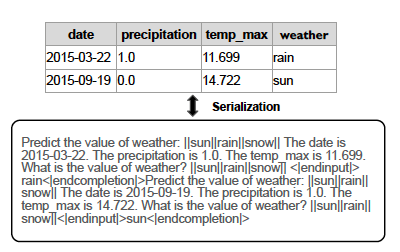

ТабуЛа-8б

Третья базовая модель, которую мы рассмотрим, была построена путём тонкой настройки языковой модели Llama 3-8B. По мнению авторов TabuLa-8b, языковые модели можно обучить выполнению табличных задач прогнозирования, сериализовав строки в текст, преобразовав текст в токены, а затем используя ту же функцию потерь и методы оптимизации, что и в языковом моделировании [5].

Архитектура TabuLa-8b использует эффективную схему маскирования внимания, называемую схемой маскирования строк и причинно-следственных связей в табличной модели (RCTM). Эта схема позволяет модели учитывать все предыдущие строки из одной таблицы одновременно, но не строки из других таблиц. Такая структура стимулирует обучение модели на небольшом количестве примеров в таблице, что критически важно для обучения с малым количеством попыток. Подробную информацию о методологии и результатах см. в оригинальной статье Джоша Гарднера и др. [5].

Использование и ограничения

В репозитории GitHub rtfm содержится код TabuLa-8b. В папке Notebooks вы найдёте пример построения модели. Обратите внимание, что, в отличие от TabPFN или CARTE, TabuLa-8b не имеет интерфейса Scikit-learn. Для получения прогнозов с нулевым шансом или дальнейшей настройки существующей модели необходимо запустить скрипты Python, разработанные авторами.

Согласно оригинальной статье, TabuLa-8b хорошо справляется с задачами прогнозирования с нулевой вероятностью. Однако использование этой модели в больших таблицах с большим количеством выборок или признаков, а также длинными именами столбцов может ограничивать возможности, поскольку эта информация может быстро выйти за пределы контекстного окна LLM (контекстное окно модели Llama 3-8B составляет 8000 токенов).

ТабДПТ

Последняя базовая модель, которую мы рассмотрим в этой статье, — это табличный дискриминантный предобученный преобразователь (Tabular Discriminative Pre-trained Transformer), или сокращённо TabDPT. Как и TabPFN, TabDPT сочетает ICL с самообучением для создания мощной базовой модели для табличных данных. TabDPT обучается на реальных данных (авторы использовали 123 общедоступных набора табличных данных из OpenML). По словам авторов, модель может быть обобщена для решения новых задач без дополнительного обучения или настройки гиперпараметров.

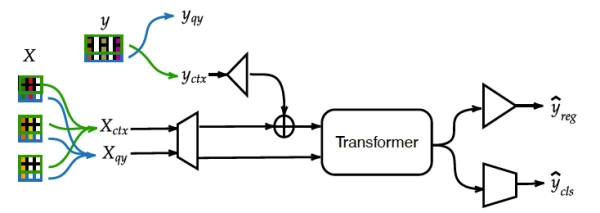

Архитектура модели

TabDPT использует строчный преобразователь-кодировщик, аналогичный TabPFN, где каждая строка служит токеном. Для обработки различного количества признаков обучающих данных (F) авторы стандартизировали размерность признаков Fmax с помощью дополнения (F < Fmax) или снижения размерности (F > Fmax).

Эта базовая модель использует самообучение, по сути, обучаясь самостоятельно, без необходимости в помеченной целевой модели для каждой задачи. Во время обучения она случайным образом выбирает один столбец таблицы в качестве целевого, а затем учится прогнозировать его значения на основе других столбцов. Этот процесс помогает модели понять взаимосвязи между различными признаками. Теперь, при обучении на большом наборе данных, модель не использует всю таблицу сразу. Вместо этого она находит и использует только наиболее похожие строки (называемые «контекстом») для прогнозирования одной строки («запроса»). Этот метод ускоряет и повышает эффективность процесса обучения.

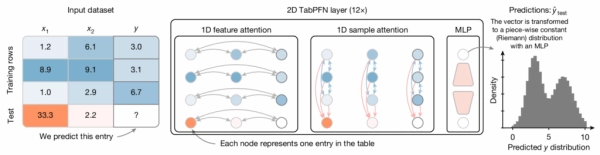

Архитектура TabDPT показана на следующем рисунке:

На рисунке показано, как проводилось обучение этой базовой модели. Сначала авторы отобрали B-таблицы из различных наборов данных для построения набора признаков (X) и набора целевых значений (y). X и y разделены на контекст (Xctx, yctx) и запрос (Xqy, yqy). Запрос Xqy является входными данными, которые передаются через функции встраивания (которые обозначены прямоугольником или треугольником). Модель также создает встраивания для Xctx и yctx. Эти встраивания контекста суммируются и объединяются с встраиванием Xqy. Затем они пропускаются через преобразователь-кодировщик для получения классификации ̂ycls или регрессии ̂yreg для запроса. Потеря между прогнозом и истинными целевыми значениями используется для обновления весов модели.

Использование и ограничения

Существует репозиторий GitHub, предоставляющий код для генерации прогнозов на основе новых табличных наборов данных. Как и TabPFN или CARTE, TabDPT использует API, аналогичный Scikit-learn, для построения прогнозов на основе ранее не исследованных данных, где функция fit использует обучающие данные для использования ICL. Код этой модели в настоящее время находится в стадии активной разработки.

Хотя в статье нет специального раздела, посвященного ограничениям, авторы упоминают несколько ограничений и способы их преодоления:

- Модель имеет предопределенное максимальное количество признаков и классов. Авторы предлагают использовать метод главных компонент (PCA) для уменьшения количества признаков, если таблица превышает этот лимит.

- Для задач классификации с большим количеством классов, чем предел модели, проблему можно разбить на несколько подзадач, представив номер класса в другой базе.

- Процесс извлечения может добавить некоторую задержку во время вывода, хотя авторы отмечают, что ее можно минимизировать с помощью современных библиотек.

Полезные сообщения

В этом блоге я обобщил основные модели для табличных данных. Большинство из них были выпущены в 2024 году, но все они находятся в стадии активной разработки. Несмотря на свою новизну, некоторые из этих моделей уже имеют хорошую документацию и просты в использовании. Например, TabPFN, CARTE или TabDPT можно установить через pip. Кроме того, эти модели используют тот же API-вызов, что и Scikit-learn, что упрощает их интеграцию в существующие приложения машинного обучения.

По словам авторов представленных здесь базовых моделей, эти алгоритмы превосходят классические методы бустинга, такие как XGBoost или CatBoost. Однако базовые модели по-прежнему не могут использоваться на больших табличных наборах данных, что ограничивает их применение, особенно в производственных средах. Это означает, что классический подход к обучению модели машинного обучения на основе набора данных по-прежнему является оптимальным для создания предиктивных моделей на основе табличных данных.

Достигнуты значительные успехи в разработке базовой модели для табличных данных. Посмотрим, что ждёт эту захватывающую область исследований в будущем!

Спасибо за прочтение!

Меня зовут Кармен Мартинес Барбоса, я специалист по анализу данных и люблю делиться новыми алгоритмами, полезными для сообщества. Читайте мои материалы на Medium или TDS.

Ссылки

[1] Н. Холлман и др., TabPFN: преобразователь, который решает небольшие табличные задачи классификации за секунду (2023), обучающий семинар по табличному представлению.

[2] Н. Холлман и др., Точные прогнозы на основе небольших данных с табличной моделью (2025), Nature.

[3] М. Дж. Ким, Л. Гринштайн и Г. Вароко. CARTE: сохранение и передача для табличного обучения (2024), Труды 41-й Международной конференции по машинному обучению, Вена, Австрия.

[4] Ф. Махдисолтани, Дж. Биега и Ф.М. Суханек. Yago3: База знаний из многоязычных википедий (2013 г.), в CIDR.

[5] Дж. Гарднер, Дж. К. Пердомо, Л. Шмидт. «Крупномасштабное обучение переносу табличных данных с помощью языкового моделирования» (2025), NeurlPS.

[6] М. Цзюньвэй и др. TabDPT: Масштабирование табличных моделей фундамента на реальных данных (2024), препринт arXiv, arXiv:2410.18164.

Источник: towardsdatascience.com