Google представила LiteRT-LM — фреймворк, который позволяет запускать большие языковые модели прямо на устройстве, без облака. Он уже лежит в основе Gemini Nano в Chrome, Chromebook Plus и Pixel Watch. LiteRT-LM делает ИИ быстрее, дешевле и приватнее — всё вычисляется локально.

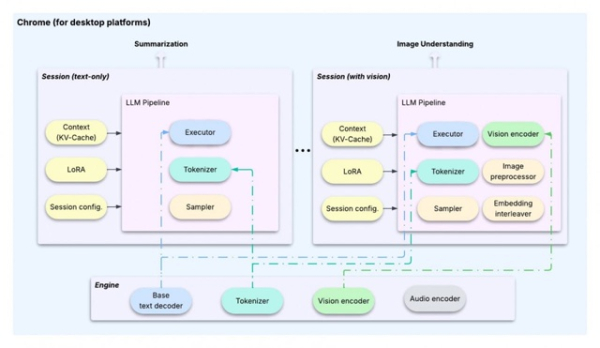

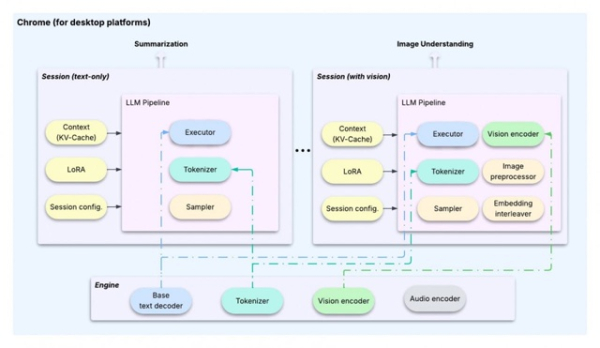

Фреймворк написан на C++ и поддерживает Android, Linux, macOS, Windows и даже Raspberry Pi. Он умеет работать с CPU, GPU и NPU, использовать кэш KV, быстро переключаться между задачами и клонировать сессии. Теперь разработчики могут встроить полноценного офлайн-ассистента в любое приложение — хоть в браузер, хоть в умные часы.

https://github.com/google-ai-edge/LiteRT-LM

Источник: vk.com

Источник: ai-news.ru