Впервые Вашингтон приближается к решению вопроса о регулировании искусственного интеллекта. И разгорается борьба не за технологии, а за то, кто будет осуществлять регулирование.

В отсутствие значимого федерального стандарта в области ИИ, ориентированного на безопасность потребителей, штаты внесли десятки законопроектов, направленных на защиту жителей от вреда, связанного с ИИ, включая законопроект Калифорнии SB-53 о безопасности ИИ и Закон Техаса об ответственном управлении ИИ, который запрещает преднамеренное неправомерное использование систем ИИ.

Технологические гиганты и перспективные стартапы, рожденные в Кремниевой долине, утверждают, что такие законы создают неработоспособную мешанину, которая ставит под угрозу инновации.

«Это замедлит нашу гонку с Китаем», — заявил TechCrunch Джош Власто, соучредитель про-ИИ PAC Leading the Future.

Индустрия и несколько её представителей в Белом доме настаивают на принятии национального стандарта или его отсутствии вообще. В разгар этой борьбы «всё или ничего» появились новые попытки запретить штатам принимать собственные законы об ИИ.

Сообщается, что законодатели Палаты представителей пытаются использовать Закон о национальной обороне (NDAA) для блокирования законов штатов об искусственном интеллекте. В то же время, попавший в сеть проект указа Белого дома также демонстрирует решительную поддержку упреждающих мер штатов по регулированию ИИ.

Масштабный превентивный запрет, лишающий штаты права регулировать ИИ, не пользуется популярностью в Конгрессе, который ранее в этом году подавляющим большинством голосов проголосовал против аналогичного моратория. Законодатели утверждают, что без принятия федерального стандарта блокирование штатов создаст угрозу для потребителей, а технологические компании смогут свободно работать без надзора.

Чтобы создать такой национальный стандарт, конгрессмен Тед Лью (демократ от Калифорнии) и двухпартийная рабочая группа Палаты представителей по вопросам ИИ готовят пакет федеральных законопроектов в области ИИ, охватывающих ряд мер защиты прав потребителей, включая мошенничество, здравоохранение, прозрачность, безопасность детей и риск катастроф. Принятие такого масштабного законопроекта, вероятно, займёт месяцы, если не годы, что подчёркивает, почему нынешняя спешка с ограничением полномочий штатов превратилась в одну из самых спорных тем в политике в области ИИ.

Линия фронта: NDAA и EO

В последние недели активизировались попытки помешать государствам регулировать ИИ.

Палата представителей рассматривает возможность исключения из Закона о национальной обороне (NDAA) положений, запрещающих штатам регулировать ИИ, сообщил Punchbowl News лидер большинства Стив Скалисе (республиканец от Луизианы). Как сообщает Politico, Конгресс, как сообщается, работал над завершением соглашения по оборонному законопроекту до Дня благодарения. Источник, знакомый с ситуацией, сообщил TechCrunch, что переговоры были сосредоточены на сужении сферы действия, чтобы потенциально сохранить полномочия штатов в таких областях, как безопасность детей и прозрачность.

Тем временем, попавший в сеть проект указа Белого дома раскрывает потенциальную стратегию превентивных мер администрации. Указ, который, как сообщается, был приостановлен, предусматривает создание «Рабочей группы по судебным разбирательствам в области ИИ» для оспаривания в суде законов штатов об ИИ, обязывает ведомства оценивать законы штатов, считающиеся «обременительными», и подталкивает Федеральную комиссию по связи и Федеральную торговую комиссию к принятию национальных стандартов, превалирующих над правилами штатов.

В частности, указ предоставит Дэвиду Саксу, главному стратегу Трампа в области искусственного интеллекта и криптовалют, а также соучредителю венчурной компании Craft Ventures, полномочия соруководителя по созданию единой правовой базы. Это позволит Саксу напрямую влиять на политику в области ИИ, что заменит собой традиционные функции Управления по научно-технической политике Белого дома и его главы Майкла Крациоса.

Сакс публично выступал за блокирование государственного регулирования и сохранение федерального надзора на низком уровне, отдавая предпочтение саморегулированию отрасли в целях «максимизации роста».

Лоскутный аргумент

Позиция Сакса отражает точку зрения большей части представителей индустрии искусственного интеллекта. В последние месяцы появилось несколько суперкомитетов политических действий (КП), выступающих за развитие ИИ, которые вкладывают сотни миллионов долларов в местные и региональные выборы, чтобы противостоять кандидатам, поддерживающим регулирование ИИ.

Проект Leading the Future, поддерживаемый Андрессен Горовиц, президентом OpenAI Грегом Брокманом, компанией Perplexity и соучредителем Palantir Джо Лонсдейлом, собрал более 100 миллионов долларов. На этой неделе Leading the Future запустил кампанию с бюджетом в 10 миллионов долларов, призывая Конгресс разработать национальную политику в области ИИ, которая будет иметь приоритет над законами штатов.

«Когда вы пытаетесь стимулировать инновации в технологическом секторе, вы не можете допустить, чтобы все эти законы постоянно появлялись у людей, которые не обязательно обладают техническими знаниями», — сказал Власто в интервью TechCrunch.

Он утверждал, что разрозненные государственные нормы «замедлят нашу гонку с Китаем».

Натан Лимер, исполнительный директор Build American AI, правозащитного подразделения PAC, подтвердил, что группа поддерживает превентивный подход без принятия федеральных мер защиты прав потребителей, связанных с ИИ. Лимер утверждал, что существующие законы, например, о мошенничестве или ответственности за качество продукции, достаточны для предотвращения ущерба, наносимого ИИ. В то время как законы штатов часто направлены на предотвращение проблем до их возникновения, Лимер выступает за более реактивный подход: дать компаниям возможность действовать быстро, а затем решать проблемы в суде.

Нет приоритета без представительства

Алекс Борс, член Ассамблеи штата Нью-Йорк, баллотирующийся в Конгресс, — одна из первых целей движения «Ведущее будущее». Он выступил инициатором законопроекта RAISE, который требует от крупных лабораторий искусственного интеллекта наличия планов безопасности для предотвращения критических случаев.

«Я верю в силу ИИ, и именно поэтому так важно иметь разумное регулирование», — заявил Борс в интервью TechCrunch. «В конечном счёте, ИИ, который победит на рынке, будет надёжным ИИ, а рынок часто недооценивает или не стимулирует инвестиции в безопасность в краткосрочной перспективе».

Борс поддерживает национальную политику в области ИИ, но утверждает, что штаты могут быстрее реагировать на возникающие риски.

И это правда, что штаты двигаются быстрее.

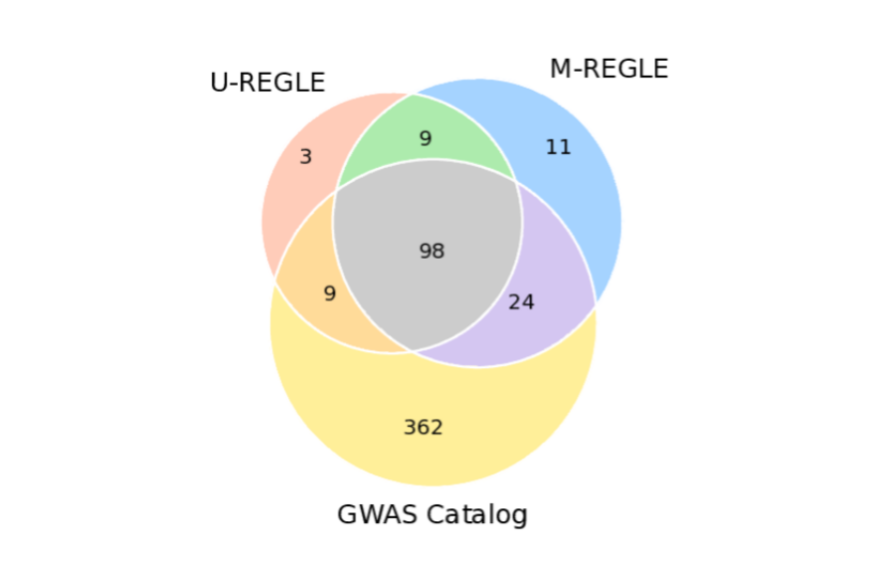

По состоянию на ноябрь 2025 года 38 штатов приняли более 100 законов, связанных с ИИ, в основном направленных против дипфейков, прозрачности и раскрытия информации, а также использования ИИ государством. (Недавнее исследование показало, что 69% этих законов вообще не предъявляют никаких требований к разработчикам ИИ.)

Активность в Конгрессе подтверждает аргумент о более медленном развитии, чем в штатах. Были внесены сотни законопроектов об ИИ, но лишь немногие из них были приняты. С 2015 года конгрессмен Лью внес 67 законопроектов в Комитет Палаты представителей по науке. Только один из них стал законом.

Более 200 законодателей подписали открытое письмо против превентивного механизма в NDAA, утверждая, что «штаты служат лабораториями демократий», которые должны «сохранять гибкость для противостояния новым цифровым вызовам по мере их возникновения». Почти 40 генеральных прокуроров штатов также направили открытое письмо против запрета государственного регулирования ИИ.

Эксперт по кибербезопасности Брюс Шнайер и специалист по анализу данных Натан Э. Сандерс, авторы книги «Переосмысление демократии: как ИИ преобразует нашу политику, правительство и гражданство», утверждают, что жалоба на неоднородность преувеличена.

Они отмечают, что компании, занимающиеся разработкой ИИ, уже соблюдают более строгие правила ЕС, и большинство отраслей находят способ действовать в рамках различных государственных законов. Истинный мотив, по их словам, — стремление избежать ответственности.

Как мог бы выглядеть федеральный стандарт?

Лью готовит масштабный законопроект объёмом более 200 страниц, который он надеется представить в декабре. Он охватывает ряд вопросов, таких как штрафы за мошенничество, защита от дипфейков, защита осведомителей, вычислительные ресурсы для академических кругов, а также обязательное тестирование и раскрытие информации для крупных компаний, занимающихся языковыми моделями.

Последнее положение обяжет лаборатории ИИ тестировать свои модели и публиковать результаты, что большинство сейчас делает добровольно. Лью ещё не внёс законопроект, но, по его словам, он не обязывает федеральные агентства напрямую оценивать модели ИИ. Это отличается от аналогичного законопроекта, внесённого сенаторами Джошем Хоули (республиканец от штата Миссисипи) и Ричардом Блюменталем (демократ от штата Канзас), который требует проведения государственной программы оценки передовых систем ИИ перед их внедрением.

Лью признал, что его законопроект не будет столь строгим, но сказал, что у него больше шансов стать законом.

«Моя цель — добиться принятия закона в этом семестре», — сказал Лью, отметив, что лидер большинства в Палате представителей Скалайс открыто враждебно относится к регулированию ИИ. «Я не пишу законопроект, который написал бы сам, будь я королём. Я пытаюсь написать законопроект, который мог бы принять Палата представителей, контролируемая республиканцами, Сенат и контролируемый республиканцами Белый дом».

Источник: techcrunch.com