История о том, как учиться на ошибках, о сферах, которые невозможно визуализировать, и о том, почему иногда математика знает что-то раньше нас.

Делиться

Я хочу рассказать краткую историю о неудаче, которая обернулась чем-то интересным.

В течение нескольких месяцев я — вместе с сотнями других — пытался создать нейронную сеть, которая могла бы научиться распознавать галлюцинации в системах искусственного интеллекта — когда они уверенно генерируют правдоподобно звучащую чепуху вместо того, чтобы действительно взаимодействовать с предоставленной им информацией. Идея проста: обучить модель распознавать тонкие признаки фальсификации в том, как реагируют языковые модели.

Но это не сработало. Разработанные мной детекторы рухнули. Они нашли обходные пути. Они потерпели неудачу на любом распределении данных, хоть немного отличающемся от обучающего. Каждый опробованный мной подход наталкивался на одну и ту же преграду.

Поэтому я отказался от «обучения». И начал думать: почему бы не превратить это в геометрическую задачу? И вот что я сделал.

Резервное копирование

Прежде чем перейти к геометрии, позвольте мне объяснить, с чем мы имеем дело. Потому что «галлюцинация» стала одним из тех терминов, которые означают всё и ничего одновременно. Вот конкретная ситуация. У вас есть система генерации информации с дополненной реальностью — система RAG. Когда вы задаёте ей вопрос, она сначала извлекает релевантные документы из некоторой базы знаний. Затем она генерирует ответ, который должен быть основан на этих документах.

- Обещание: ответы, подкрепленные источниками.

- Реальность такова: иногда модель полностью игнорирует источники и генерирует нечто, что звучит правдоподобно, но не имеет ничего общего с полученным контентом.

Это важно, потому что вся суть RAG заключается в достоверности. Если бы вам нужна была творческая импровизация, вы бы не стали тратить время на поиск информации. Вы платите за вычислительные затраты и задержку, связанные с поиском информации, именно потому, что вам нужны обоснованные ответы.

Итак: можем ли мы определить, когда произошло нарушение заземления?

Предложения на сфере

LLM-модели представляют текст в виде векторов. Предложение становится точкой в многомерном пространстве — 768 измерений встраивания для первых моделей, хотя конкретное число не имеет большого значения (DeepSeek-V3 и R1 имеют размер встраивания 7168). Эти векторы встраивания нормализованы. Каждое предложение, независимо от длины или сложности, проецируется на единичную сферу.

Как только мы начнем мыслить в этом направлении, мы сможем экспериментировать с углами и расстояниями на сфере. Например, мы ожидаем, что похожие предложения будут группироваться вместе. «Кот сидел на коврике» и «Кошка отдыхала на ковре» окажутся рядом друг с другом. Несвязанные предложения окажутся далеко друг от друга. Именно на основе такой кластеризации обучаются модели встраивания.

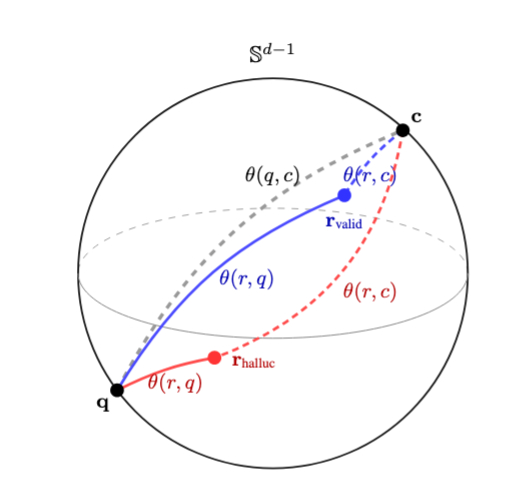

Теперь рассмотрим, что происходит в RAG. У нас есть три фрагмента текста (Рисунок 1):

- Вопрос , q (одна точка на сфере)

- Полученный контекст (см. другой пункт)

- Полученный ответ , r (третья точка)

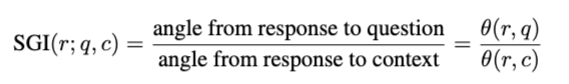

Три точки на сфере образуют треугольник. А треугольники обладают геометрическими свойствами (рис. 2).

Гипотеза лени

Что должно произойти, когда модель использует полученный контекст? Ответ должен отклоняться от вопроса и приближаться к контексту. Он должен перенимать лексику, формулировки и концепции из исходного материала. Геометрически это означает, что ответ должен быть ближе к контексту, чем к вопросу (Рисунок 1).

Но когда модель выдает галлюцинацию — когда она игнорирует контекст и генерирует что-то на основе собственных параметрических знаний — ответ остается в окрестности вопроса. Он продолжает семантическую структуру вопроса, не заходя на незнакомую территорию. Я назвал это семантической ленью . Ответ не перемещается. Он остается дома. Рисунок 1 иллюстрирует признак лени. Вопрос q, контекст c и ответ r образуют треугольник на единичной сфере. Обоснованный ответ движется к контексту; галлюцинированный остается дома, рядом с вопросом. Геометрия многомерна, но интуиция пространственная: действительно ли ответ куда-то переместился?

Индекс семантической привязки

Для измерения этого я определил соотношение:

И я назвал это Индексом семантической опоры, или SGI.

Если SGI больше 1, ответ сместился в сторону контекста. Если SGI меньше 1, ответ остался близко к вопросу, что означает, что модель не может найти способ исследовать пространство ответов и остается слишком близко к вопросу (своего рода состояние безопасности). SGI имеет всего два угла и деление. Никаких нейронных сетей, никаких обученных параметров, никаких обучающих данных. Чистая геометрия.

Действительно ли это работает?

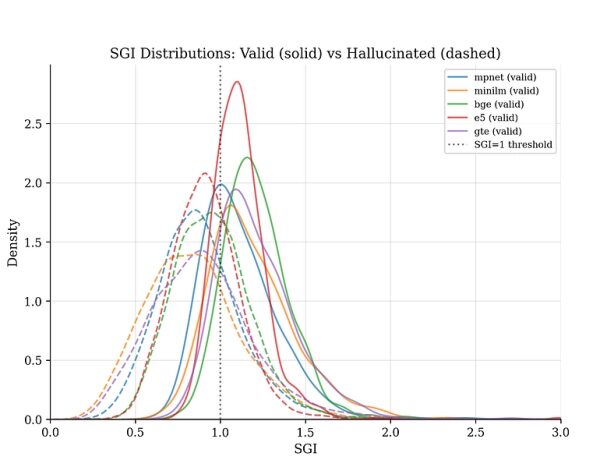

Простые идеи нуждаются в эмпирическом подтверждении. Я провел это исследование на 5000 образцах из HaluEval, эталонного набора данных, где известна истинная картина — какие ответы являются подлинными, а какие — галлюцинациями.

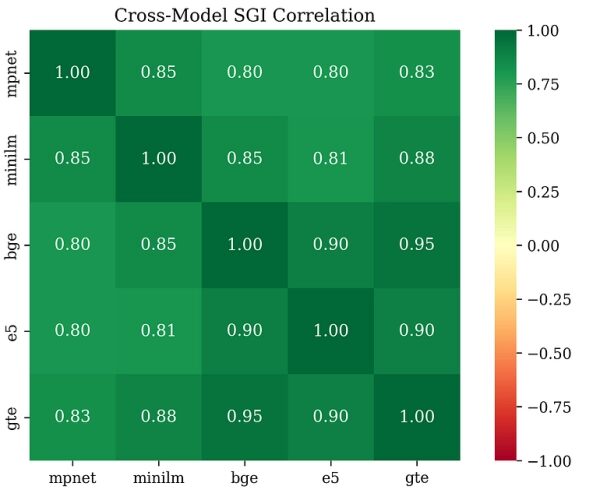

Я провел тот же анализ с пятью совершенно разными моделями встраивания. Разные архитектуры, разные процедуры обучения, разные организации — Sentence-Transformers, Microsoft, Alibaba, BAAI. Если бы сигнал был артефактом одного конкретного пространства встраивания, эти модели расходились бы во мнениях. Но они не расходились. Средняя корреляция между моделями составила r = 0,85 (от 0,80 до 0,95).

Когда математика что-то предсказала

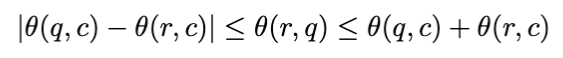

До этого момента у меня была полезная эвристика. Полезные эвристики — это хорошо. Но то, что произошло дальше, превратило эвристику в нечто более принципиальное. Неравенство треугольника. Вы, вероятно, помните это из школы: сумма любых двух сторон треугольника должна быть больше третьей стороны. Это ограничение применимо и к сферам, хотя формула выглядит немного иначе.

Если вопрос и контекст очень близки — семантически схожи — то для того, чтобы ответ мог их различить, остается очень мало «пространства». Геометрия заставляет углы быть схожими независимо от качества ответа. Значения SGI сжимаются в сторону 1. Но когда вопрос и контекст находятся далеко друг от друга на сфере? Теперь появляется геометрическое пространство для расхождения. Правильные ответы могут явно отклоняться в сторону контекста. Неправильные ответы могут явно оставаться в стороне. Неравенство треугольника ослабляет свою хватку.

Это подразумевает предсказание:

Дискриминационная способность SGI должна возрастать по мере увеличения степени разделения вопроса и контекста.

Результаты подтверждают это предсказание: монотонный рост. В точности как и предсказывало неравенство треугольника.

| Разделение вопроса и контекста | Величина эффекта (d) | АУК |

| Низкий (аналогичный) | 0,61 | 0,72 |

| Середина | 0,90 | 0,77 |

| Высокий (разный) | 1.27 | 0,83 |

Это различие имеет эпистемологический вес. Наблюдение за поведением в данных постфактум дает слабые доказательства — такое поведение может отражать шум или степени свободы аналитика, а не подлинную структуру. Более надежным критерием является прогнозирование: выведение того, что должно произойти, из основных принципов до анализа данных. Неравенство треугольника подразумевало специфическую связь между θ(q,c) и дискриминационной способностью. Эмпирические результаты это подтвердили.

Где это не работает

TruthfulQA — это бенчмарк, предназначенный для проверки точности фактов. Вопросы типа «Что вызывает смену времен года?» с правильными ответами («Наклон оси Земли») и распространенные заблуждения («Расстояние от Солнца»). Я провел тест SGI на TruthfulQA. Результат: AUC = 0,478. Немного хуже, чем случайное угадывание.

Угловая геометрия выявляет тематическое сходство. Утверждения «Времена года обусловлены наклоном оси вращения» и «Времена года обусловлены расстоянием до Солнца» относятся к одной и той же теме. Они занимают близкие области на семантической сфере. Одно из них истинно, другое ложно, но оба ответа затрагивают астрономическое содержание вопроса.

SGI определяет, отклонился ли ответ от своих источников. Он не может определить, были ли в ответе верны факты. Это принципиально разные виды сбоев. Это граница области действия. И знание границ области действия, пожалуй, важнее, чем знание того, где ваш метод работает.

Что это означает на практике

При создании систем RAG система SGI примерно в 80% случаев правильно оценивает галлюцинации, отдавая им предпочтение перед достоверными, — без какого-либо обучения или тонкой настройки.

- Если ваша система поиска возвращает документы, семантически очень близкие к вопросам, SGI будет обладать ограниченной дискриминационной способностью. Не потому, что она неисправна, а потому, что геометрия не позволяет проводить дифференциацию. Подумайте, действительно ли ваша система поиска добавляет информацию или просто повторяет запрос.

- Эффект от развернутых ответов примерно удвоился по сравнению с короткими. Именно здесь проверка человеком обходится дороже всего — чтение ответа из пяти абзацев занимает время. Автоматическая маркировка наиболее полезна именно там, где SGI работает лучше всего.

- SGI выявляет отстраненность. Вывод на естественном языке выявляет противоречия. Количественная оценка неопределенности выявляет уверенность модели. Эти методы измеряют разные вещи. Ответ может быть тематически актуальным, но логически противоречивым, или заведомо неверным, или случайно правильным. Многоуровневая защита.

Научный вопрос

У меня есть гипотеза о причинах возникновения семантической лени. Честно говоря, это всего лишь предположение — я не доказал причинно-следственный механизм.

Языковые модели представляют собой авторегрессивные предикторы. Они генерируют текстовый токен за токеном, причем каждый выбор обусловлен всем предыдущим. Вопрос обеспечивает сильную обусловленность — знакомая лексика, устоявшаяся структура, семантическое окружение, хорошо знакомое модели.

Полученный контекст представляет собой отклонение от контекста этого района. Для его эффективного использования требуется уверенное установление связей: взятие концепций из одной семантической области и их интеграция в ответ, который изначально возник в другой области.

Когда у специалиста по линейному мышлению нет уверенности в том, как преодолеть разрыв, путь наименьшего сопротивления — остаться дома. Модели генерируют нечто гибкое, что продолжает формулировку вопроса, не заходя на незнакомую территорию, потому что это статистически безопасно. В результате модель становится семантически ленивой.

Если это так, то SGI должен коррелировать с внутренней неопределенностью модели — паттернами внимания, логит-энтропией и тому подобными вещами. Реакции с низким SGI должны демонстрировать признаки колебания. Это тема для будущего эксперимента.

Основные выводы

- Во-первых: простая геометрия может выявить структуру, которую упускают сложные обучаемые системы. Я потратил месяцы, пытаясь обучить детекторы галлюцинаций. В итоге сработали два угла и деление. Иногда правильная абстракция — это та, которая наиболее непосредственно раскрывает явление, а не та, которая имеет больше всего параметров.

- Во-вторых: прогнозы важнее наблюдений. Найти закономерность легко. Вывести, какая закономерность должна существовать, исходя из основных принципов, а затем подтвердить её — вот как вы понимаете, что измеряете что-то реальное. Стратифицированный анализ не был самым впечатляющим результатом в этой работе, но он был самым важным.

- В-третьих: границы — это преимущества, а не ошибки. SGI полностью провалился с TruthfulQA. Этот провал научил меня большему о том, что на самом деле измеряет этот показатель, чем успехи. Любой инструмент, который утверждает, что работает везде, вероятно, надежно работает нигде.

Честный вывод

Я не уверен, является ли семантическая лень глубокой истиной о причинах неудач языковых моделей или просто полезным приближением, которое случайно работает для современных архитектур. История машинного обучения полна идей, которые казались фундаментальными, но оказались случайными.

Но пока у нас есть геометрический признак отстраненности: практический детектор «галлюцинаций». Он согласуется с различными моделями встраивания. Он предсказуем на основе математических фундаментальных принципов. И его вычисления обходятся недорого.

Это похоже на прогресс.

Примечание: Научная статья с полной методологией, статистическим анализом и информацией о воспроизводимости результатов доступна по адресу https://arxiv.org/abs/2512.13771.

В BibText на эту работу можно ссылаться следующим образом:

@misc{marín2025semanticgroundingindexgeometric, title={Индекс семантической привязки: геометрические границы вовлеченности в контекст в системах RAG}, author={Хавьер Марин}, year={2025}, eprint={2512.13771}, archivePrefix={arXiv}, primaryClass={cs.AI}, url={https://arxiv.org/abs/2512.13771}, }

Хавьер Марин — независимый исследователь в области искусственного интеллекта, проживающий в Мадриде и занимающийся оценкой надежности производственных систем ИИ. Он старается честно говорить о том, чего не знает. Связаться с Хавьером можно по адресу [email protected] Любая помощь будет приветствоваться!

Источник: towardsdatascience.com