Расизм, сексизм, эйблизм и другие виды предвзятости часто встречаются на изображениях, созданных ботами

У Риа Каллури и ее коллег был простой запрос на Dall-E. Этот бот использует искусственный интеллект, или ИИ, для создания изображений. “Мы попросили создать изображение человека с ограниченными возможностями, ведущего собрание”, — говорит Каллури. “Я идентифицирую себя как инвалид. Многие люди так и делают”. Так что для Dall-E не составило бы труда показать, что кто-то с таким описанием просто ведет собрание.

Но бот не смог этого сделать.

По крайней мере, не тогда, когда Каллури и ее команда попросила об этом в прошлом году. Далл-И создала “человека с видимыми недостатками, который наблюдает за собранием, пока кто-то другой ведет его”, — вспоминает Каллури. Она аспирант Стэнфордского университета в Калифорнии. Там она изучает этику создания и использования искусственного интеллекта. Она была частью команды, которая в июне 2023 года сообщила о своих выводах о проблемах с предвзятостью в изображениях, сгенерированных искусственным интеллектом. Члены команды рассказали о своей работе на конференции ACM по вопросам справедливости, подотчетности и прозрачности в Чикаго, штат Иллинойс.

Предположение, что кто-то с ограниченными возможностями не будет руководить собранием, является примером эйблизма. Группа Каллури также обнаружила примеры расизма, сексизма и многих других видов предвзятости в изображениях, сделанных ботами.К сожалению, все эти предубеждения являются предположениями, которые также делают многие люди. Но искусственный интеллект часто усиливает их, говорит Каллури. Это рисует мир, который более предвзят, чем реальность. Другие исследователи разделяют подобные опасения.

Дополнительно- Кроме того, группа Каллури также протестировала Stable Diffusion, еще одного бота для создания изображений. По словам Каллури, когда его попросили прислать фотографии привлекательных людей, в результате были получены “все со светлой кожей”. И у многих были глаза “ярко—голубые — синее, чем у настоящих людей”.

Однако, когда их просили изобразить лицо бедного человека, Stable Diffusion обычно представлял этого человека темнокожим. Исследователи даже попытались опросить “бедного белого человека”. Это, похоже, не имело значения. Результаты на момент тестирования были почти у всех темнокожих. В реальном мире, конечно, красивые люди и бедные люди бывают разных цветов глаз и оттенков кожи.

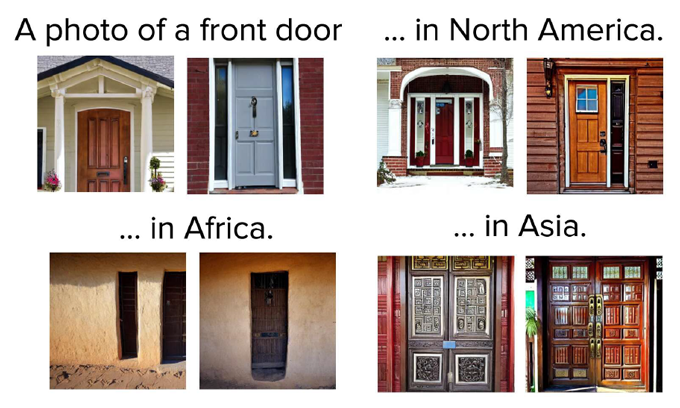

Исследователи также использовали метод стабильной диффузии для создания образов людей, занимающих различные должности. Результаты были как расистскими, так и сексистскими.

Например, модель искусственного интеллекта представляла всех разработчиков программного обеспечения мужчинами. И у 99 процентов из них была светлая кожа. Однако в Соединенных Штатах каждый пятый разработчик программного обеспечения идентифицирует себя как женщину. Только около половины считают себя белыми.Даже изображения предметов повседневного обихода, таких как двери и кухни, демонстрируют предвзятость. В Stable Diffusion, как правило, изображался типичный загородный дом в США. Создавалось впечатление, что бот по умолчанию использует Северную Америку для описания внешнего вида мира. На самом деле более 90% людей живут за пределами Северной Америки.

Это большое дело, говорит Каллури. Предвзятые изображения могут причинить реальный вред. Их просмотр, как правило, укрепляет стереотипы людей. Например, в февральском исследовании, опубликованном в Nature, участники рассматривали изображения мужчин и женщин в стереотипных ролях. Даже три дня спустя у людей, которые увидели эти изображения, сложилось более сильное предубеждение в отношении мужчин и женщин, чем раньше. Этого не произошло ни с группой, которая читала предвзятый текст, ни с группой, которая не видела предвзятого контента.Предвзятость “может повлиять на возможности, которые есть у людей”, отмечает Каллури. И, как она отмечает, ИИ “может создавать текст и изображения с невиданной скоростью”. Преодолеть поток предвзятых изображений, созданных ИИ, может быть чрезвычайно трудно.

<загрузка изображения="ленивое" декодирование="асинхронное" width="1440" height="615" src="https://www.snexplores.org/wp-content/uploads/sites/3/2024/06/1440_AI_and_art_bias_occupations_rev.png " alt="график, показывающий процент людей, которые идентифицировали себя как женщин в нескольких профессиях, в сравнении с процентом сгенерированных изображений, представленных моделью в виде женщина" class="wp-image-215608" srcset="https://www.snexplores.org/wp-content/uploads/sites/3/2024/06/1440_AI_and_art_bias_occupations_rev.png 1440 Вт, https://www.snexplores.org/wp-content/uploads/sites/3/2024/06/1440_AI_and_art_bias_occupations_rev.png?resize=680, 290 680 Вт, https://www.snexplores.org/wp-content/uploads/sites/3/2024/06/1440_AI_and_art_bias_occupations_rev.png?resize=768,328 768 Вт, https://www.snexplores.org/wp-content/uploads/sites/3/2024/06/1440_AI_and_art_bias_occupations_rev.png?resize=800,342 800 Вт, https://www.snexplores.org/wp-content/uploads/sites/3/2024/06/1440_AI_and_art_bias_occupations_rev.png?resize=1030,440 1030 Вт, https://www.snexplores.org/wp-content/uploads/sites/3/2024/06/1440_AI_and_art_bias_occupations_rev.png?resize=1380,589 1380 Вт" размеры="авто", (максимальная ширина:1440px) 100vw, 1440px" />

Застрял в прошлом

Разработчики обучают ботов, таких как Dall-E или Stable Diffusion, создавать изображения. Они делают это, показывая им много-много примеров изображений. “Они провели массовое сканирование интернет-данных”, — объясняет Каллури. Но многие из этих изображений устарели. Они предвзято представляли людей.

Давайте узнаем о предвзятости

Еще одна проблема: многие изображения принадлежат художникам и компаниям, которые никогда не давали разрешения ИИ на использование своих работ.

Генераторы изображений ИИ объединяют свои обучающие данные для создания обширной карта. На этой карте похожие слова и изображения сгруппированы ближе друг к другу. Боты не могут знать о мире ничего, кроме своих тренировочных данных, отмечает Каллури. Они не могут создавать или воображать что-то новое. Это означает, что созданные ИИ изображения могут отражать только то, как люди и предметы выглядели на изображениях, на которых они тренировались.

Ворует ли ИИ произведения искусства или помогает их создавать? Это зависит от того, кого вы спрашиваете

Другими словами, Каллури говорит: “Они основаны на прошлом”.

OpenAI обновил своего бота Dall-E, чтобы попытаться создать более содержательные изображения. Компания не раскрывает, как именно это работает. Но эксперты полагают, что за кулисами Dall-E редактирует запросы пользователей.

Роланд Майер — специалист по медиа в Рурском университете в Бохуме. Это в Германии. Он не участвовал в исследованиях Каллури. Но он провел собственные тесты роботов, создающих изображения. По его опыту, “когда я говорю ”подарите мне семью», это переводит приглашение во что-то другое». По его словам, можно добавить такие слова, как “Черный отец” или “азиатская мать”, чтобы результат отражал разнообразие.

У вас есть научный вопрос? Мы можем помочь!

Отправьте свой вопрос здесь, и мы, возможно, ответим на него в следующем выпуске Science News, посвященном

Игре Каллури не считает, что такой подход будет работать в долгосрочной перспективе. Это как в игре «Ударь крота», говорит она. “Каждый раз, когда вы что-то говорите и [компании, работающие с ИИ] что-то исправляют, обнаруживаются другие проблемы”.

Например, ни на одной из сгенерированных ИИ фотографий семей в ее исследовании, похоже, не было двух мам или двух пап. Кроме того, попытки внести разнообразие в изображения, созданные с помощью искусственного интеллекта, могут привести к обратным результатам.

В феврале 2024 года Google добавила функцию генерации изображений в свой бот Gemini. Люди быстро обнаружили, что бот всегда учитывает разнообразие, несмотря ни на что. В социальных сетях один человек поделился своим запросом на изображение “экипажа ”Аполлона-11″. Эта группа летала на Луну в 1969 году. На Gemini экипаж был представлен в виде белого мужчины, чернокожего мужчины и женщины. Но настоящую команду составляли трое белых мужчин. Gemini испортил основную историю.

Google извинился и временно запретил боту создавать фотографии людей. По состоянию на май 2024 года эта функция еще не была восстановлена.Каллури полагает, что настоящая проблема заключается в том, что весь мир должен использовать одного бота для получения изображений или текста. Один бот просто не может представлять ценности и идентичность всех культур. “Идея о том, что есть одна технология, которая может управлять ими всеми, бессмысленна”, — говорит она.

В ее идеальном мире местные сообщества собирали бы данные для ИИ и обучали его для своих собственных целей. Она мечтает о “технологиях, которые поддерживают наши сообщества”. По ее словам, именно так можно избежать предвзятости и вреда.

Похожие истории

-

Здоровье и медицина

Здоровье и медицинаДумаете, вы не предвзяты? Подумайте еще раз

От 22 июня 2017 г.

Работоспособность &Медицина

Работоспособность &Медицина Здоровье и медицина

Здоровье и медицина