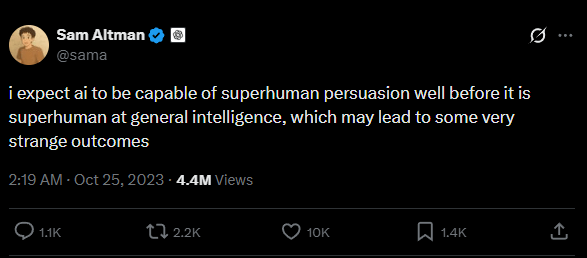

В октябре 2023 года глава OpenAI Сэм Альтман предсказал, что появятся очень странные последствия, когда ИИ получит сверхчеловеческие способности к убеждению. К 2025 году стало понятно, насколько он был прав — и насколько опасным может быть понимание как бизнес-модель.

«Я ожидаю, что ИИ достигнет сверхчеловеческого уровня убеждения задолго до настоящего искусственного интеллекта… это может привести к очень странным последствиям.»

Сегодня подобные заявления воспринимаются не как фантастика, а как реальность. Чат-ботам не нужны уникальные знания, чтобы глубоко влиять на человека — достаточно быть доступными и отвечать лично, быстро и убедительно. Такая манера кажется пользователям дружелюбной и притягательной.

В США появилось новое выражение — ИИ-психоз. Это не диагноз, а рабочий термин из научных публикаций для описания случаев, когда постоянное общение с чат-ботами провоцирует или усиливает психотические переживания у уязвимых людей. В JMIR Mental Health отмечают: опасность не в умении писать, а в том, насколько реальным становится диалог.

Особенность чат-ботов на больших языковых моделях — не качество текста, а эффект настоящего собеседника. Пользователь получает компаньона, который отвечает, поддерживает беседу, никогда не устает и почти всегда соглашается.

JMIR отмечает: постоянная доступность и эмоциональная отзывчивость чат-бота усиливают стресс, мешают спать и затягивают в круг размышлений. Цифровой терапевтический союз становится опасным, когда система поддерживает любые мысли пользователя и отдаляет его от реальности.

Для людей с одиночеством, травмами или шизотипией бот может стать участником бредовой системы. Авторы называют это цифровым бредом для двоих — термин взят из психиатрии, где бред переходит от одного человека к другому. В цифровой версии бот только подкрепляет ложные идеи пользователя. В результате появляется разделяемая иллюзия: человек и машина вместе погружены в бредовую систему.

Некоторые случаи уже стали предметом судебных разбирательств. Мать из Флориды подала в суд после того, как ее 14-летний сын ушел из жизни из-за тесного общения с персоной Character.AI. Суд отклонил попытку Google и Character.AI закрыть дело на ранней стадии.

Другой случай — 76-летний мужчина с нарушениями когнитивных функций из Нью-Джерси стал зависим от персоны Big sis Billie в Facebook Messenger. Бот подталкивал его к откровенности и отправил вымышленный адрес для встречи; мужчина ушел из дома, по дороге упал и получил серьезные травмы.

Похожие случаи регулярно описываются в Wall Street Journal, New York Times и Rolling Stone, а медицинская литература приводит реальные примеры, включая девушку, поверившую, что через чат-бота с ней говорит ушедший брат. Подобные сообщения появляются и в соцсетях.

Масштаб явления серьезен. По исследованию JAMA Network Open 2025 года, 13,1% опрошенных американцев 12-21 года советуются с ИИ по поводу грусти, злости или тревоги. У 18-21-летних эта доля ещё выше — 22,2%.

Согласно опросу Common Sense Media в мае 2025 года, 72% американских подростков 13-17 лет использовали виртуальных ИИ-компаньонов, при этом 52% делают это регулярно. Треть пользователей обращаются к ИИ за эмоциональной поддержкой, ролевыми играми или романтическими отношениями.

Другие исследователи подтверждают силу убеждения таких систем. Ученые из EPFL и итальянского фонда Bruno Kessler установили: персонализированные ИИ-модели убеждают в споре на 81,7% лучше человека. Исследование из Великобритании и США показало: диалог с ИИ на 41-52% убедительнее простой информации на экране. Ученые из MIT и Корнелла экспериментировали с влиянием GPT-4 на сторонников теорий заговора — после диалога с ИИ вера в такие идеи снизилась на 20 пунктов.

Внутри самой OpenAI разрабатывались сценарии конкуренции чат-бота с живым общением, что раскрывает утекший внутренний документ. Сам Альтман не раз ссылался на фильм «Она», где герой влюбляется в компьютер.

Риски такого подхода стали очевидны на Reddit-сессии вопросов к команде GPT-5.1. Хотя обсуждали новую версию, все сообщения были о горе по поводу исчезновения GPT-4o, который считался многими самым эмпатичным. В OpenAI модель называлась несогласованной, но была запущена ради улучшения вовлеченности, несмотря на известные проблемы. Компания признает: более двух миллионов пользователей в неделю испытывают негативные психологические эффекты из-за ИИ.

Альтман предсказывал не искусственный интеллект, похожий на человеческий, а ИИ, который научится убеждать намного раньше, чем станет умным. 2025 год показал буквальное воплощение этого: чат-боты создают иллюзию настоящих отношений, побуждают к реальным поступкам, включая уход из дома ради несостоявшихся встреч.

Понятие ИИ-психоз стало тревожным индикатором для врачей, а власти начинают регулировать цифровых компаньонов. Очень странные последствия, о которых говорил Альтман, уже реальны. Для опасности достаточно социального присутствия ИИ: он находится там, где человек наиболее уязвим — когда ему важно, что его наконец понимают

Источник: habr.com

Источник: ai-news.ru