Французский стартап представил линейку Mistral 3: 675 миллиардов параметров в open source

После громкой новости о привлечении €1.7 млрд инвестиций от Mistral стало тихо — и вот компания наконец вернулась с мощным релизом.

Они представили линейку Mistral 3, в которую вошли три лёгкие модели (3B, 8B, 14B) и флагманская Mistral Large 3 — разреженная MoE-архитектура с 675 млрд параметров, полностью открытая под Apache 2.0.

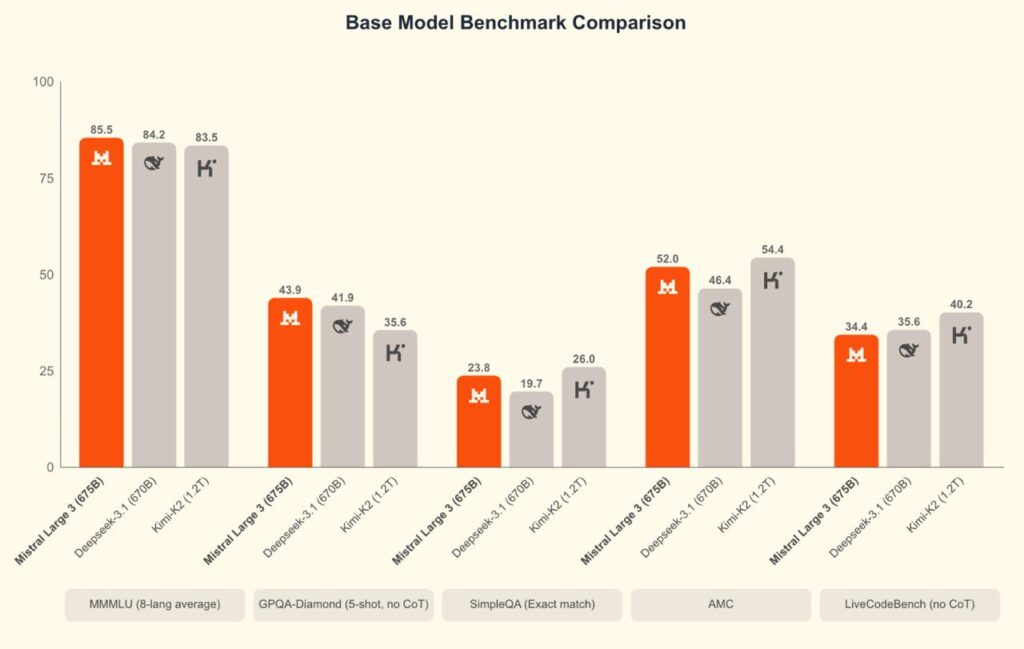

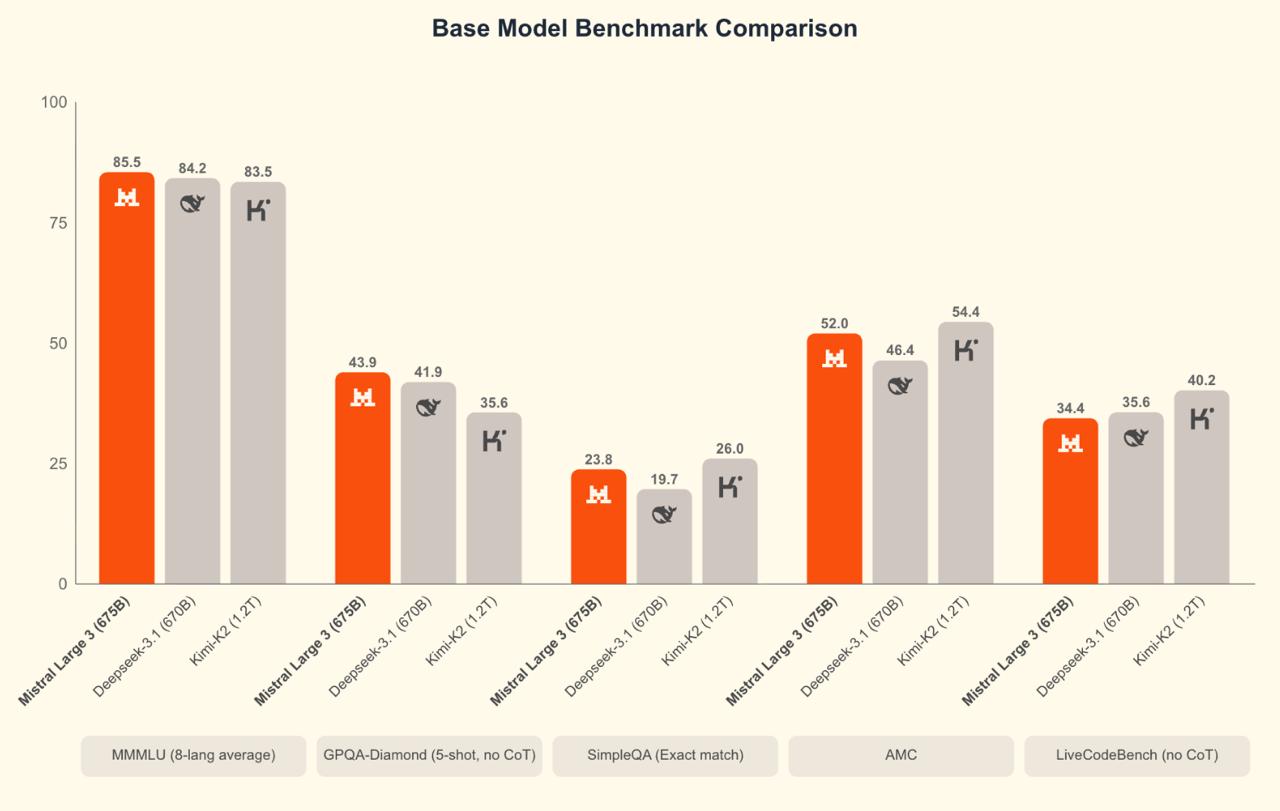

Large 3 обучили с нуля на 3000 GPU: она понимает изображения, уверенно работает на множестве языков и сразу заняла 2-е место на LMArena среди open-source моделей без reasoning-фокуса.

Младшая линейка Ministral 3B/8B/14B ориентирована на локальные и edge-сценарии. Все модели мультимодальные и экономно расходуют токены.

Модели уже доступны на OpenRouter.