По мере того, как роботы-гуманоиды появляются в реальном мире, новые исследования показывают, что люди проецируют на них свои расовые предубеждения — но исследователи расходятся во мнениях относительно того, сохраняются ли эти предубеждения за пределами лаборатории и при взаимодействии в реальном мире

Когда исследователи попросили более 1000 американцев присвоить роботам цвета в соответствии с их работой, они обнаружили, что предубеждения, знакомые по работе с людьми, всплыли на поверхность — и что люди, делающие выбор, редко осознавали их как предубеждения. Закономерности были достаточно сильны, чтобы предсказать, какой робот будет выбран для той или иной роли, однако участники объясняли свои действия нейтральным языком практичности, а не предубеждений. По мере того как человекоподобные машины перемещаются из исследовательских лабораторий на заводы и в больницы, этот разрыв между тем, что выбирают люди, и тем, что они думают, что они выбирают, — именно это беспокоит исследователей: рабочая сила роботов может в конечном итоге быть отсортирована по той же иерархии, что и человеческая, и никто не захочет этого делать. назовем это так.

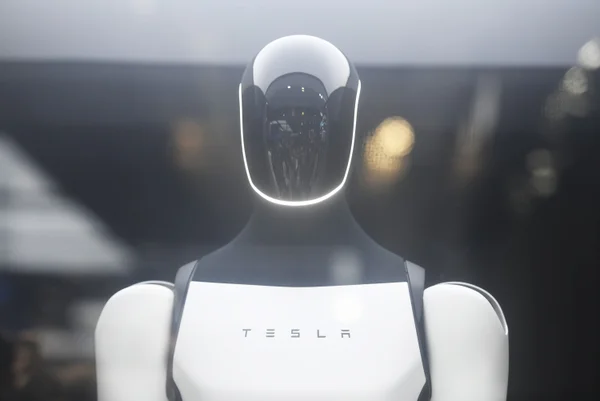

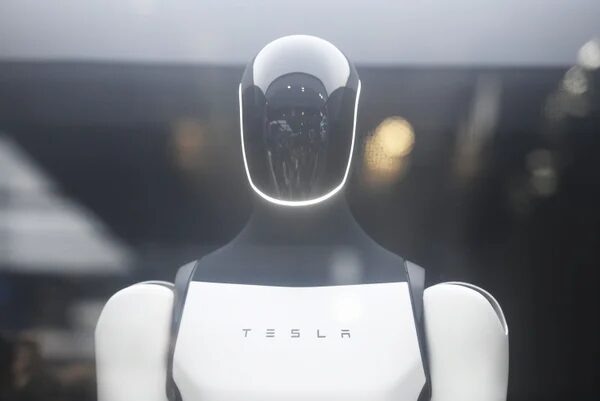

Исследование, опубликованное в журнале conference proceedings в марте 2026 года исследователями Цзяньген Хэ, Ваньци Чжан и Джессикой К. Барфилд присоединяется к растущему числу исследователей в области робототехники, которые часто расходятся во мнениях о том, воспринимают ли люди роботов как расу вообще. Это также происходит в то время, когда вопросы о дизайне человекоподобных роботов вот-вот перестанут быть академическими. Генеральный директор Tesla Илон Маск заявил, что переоборудует часть завода во Фримонте, штат Калифорния, для производства своих роботов Optimus. Китайские фирмы, такие как Unitree Robotics, поставляют потребителям роботов-перевертышей, а гуманоиды Figure AI работают на сборочных линиях BMW. «Придание внешнего вида социальному роботу никогда не является чисто эстетическим выбором», — пишут он, Чжан и Барфилд в статье, опубликованной на сервере препринтов arXiv.org, которая расширяет результаты исследования. «Это глубокое социально-техническое вмешательство, требующее преднамеренного этического проектирования».

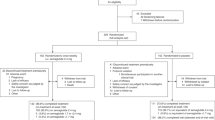

Для исследования исследователи набрали участников с помощью платформы для опроса Prolific и показали каждому из них четыре сцены на рабочем месте без каких-либо человеческих фигур: строительная площадка, больница, центр домашнего обучения и спортивная площадка. Для каждой сцены участники выбирали одного робота из шести, которые отличались только цветом — было четыре оттенка кожи, от светлого до темного, плюс серебристый и бирюзовый варианты, предназначенные для нерасовой ориентации. Примерно половина участников выбрали серебристый или бирюзовый цвета в сценариях. Но когда участники выбрали робота с цветом кожи, результаты совпали со стереотипами, которые исследователи зафиксировали между латиноамериканцами и физическим трудом, азиатами и академической компетентностью, чернокожими и спортивными способностями, белыми и профессиональными ролями. Во втором эксперименте с другой группой участников исследователи добавили к тем же сценам людей-профессионалов: строителя-латиноамериканца, белого врача, преподавателя-азиата и чернокожего спортсмена. Предвзятость усилилась: эти участники почти в шесть раз чаще, чем в первой группе, выбирали робота, цвет кожи которого соответствовал тому работнику, которого они только что видели.

О поддержке научной журналистики

Если вам понравилась эта статья, подумайте о том, чтобы поддержать нашу журналистику, отмеченную наградами, подписавшись на нее. Приобретая подписку, вы помогаете обеспечить будущее впечатляющих историй об открытиях и идеях, формирующих наш современный мир.

Команда также попросила участников объяснить, как они выбирают цвет своих роботов. «Мы хотели глубже разобраться в причинах, по которым определенные роботы были выбраны для определенных должностей», — говорит Барфилд, исследователь из Университета Кентукки. Многие участники оправдано белые роботы для лечебно-профилактических учреждениях, потому что они выглядели чище и темно-роботы для строительства, потому что они были менее склонны к грязи, сообщают исследователи в препринте arXiv.org . Другая закономерность проявилась, когда исследователи проанализировали моменты, когда участники выбирали для работы робота, цвет кожи которого соответствовал их собственному. Белые и азиатские участники, как правило, приводили психологические и эмоциональные доводы, говоря, что роботы заставляли их чувствовать себя спокойнее или что им лично нравился цвет. Напротив, чернокожие участники, выбравшие роботов с темной кожей, приводили функциональные обоснования. «Они бы сказали: «О, этот робот выглядит сильнее или полезнее», — это своего рода более функциональная причина», — говорит он, исследователь из Университета Теннесси в Ноксвилле.

В обоих исследованиях и в каждом сценарии работы роботы silver и teal были самыми популярными — в среднем их выбирали чаще, чемлюбой индивидуальный оттенок кожи. По мере того, как роботы становились все более похожими на людей, в объяснениях участников нейтральные цвета все чаще обозначались как промышленные или практичные. «Когда робот становится все более похожим на человека, люди стараются избегать такого деликатного выбора», — говорит он.

Это не первые исследования, которые показывают, что люди проявляют расовую предвзятость по отношению к роботам. В исследовании 2018 года Кристоф Бартнек, исследователь взаимодействия человека и компьютера из Кентерберийского университета в Новой Зеландии, и его коллеги адаптировали хорошо известный психологический инструмент под названием «парадигма предвзятости стрелка». В классической версии участники играют в своего рода видеоигру, в которой человеческие фигуры — одни черные, другие белые — держат в руках оружие или безобидные предметы. У вас есть доля секунды, чтобы решить: стрелять или не стрелять.

В исследовании Бартнека участники быстрее стреляли по вооруженным чернокожим мишеням, чем по вооруженным белым, и быстрее удерживали огонь по невооруженным белым мишеням по сравнению с невооруженными черными. Затем Бартнек и его коллеги поменялись роботами местами, «чтобы посмотреть, работает ли это также и для роботов», — говорит он. Участники исследования реагировали на темнокожих роботов так же, как и на чернокожих людей в сценарии видеоигры.

В последующем исследовании исследователи представили робота с коричневой кожей рядом с другими роботами. темнокожие и светлокожие, и предубеждение исчезло. Оказалось, что мир сложнее упорядочивать, когда он не двоичный.

Роберт Спарроу, философ из Университета Монаша в Австралии, один из первых, кто написал о бинарном мире. этика робототехники утверждает, что роботы несут в себе два конкурирующих расовых нарратива. Первый — символический. Слово «робот» происходит от пьесы чешского писателя Карела Карона Апека «Универсальные роботы Россума», опубликованной в 1920 году и впервые поставленной в январе 1921 года, в которой роботы были органическими существами созданы как работники принудительного труда — чешское слово robota означает принудительный труд. «Совершенно очевидно, что они были сторонниками рабочих», — говорит Спарроу. Опасения восстания роботов, с его точки зрения, по сути, являются опасениями восстания рабов, опасениями захвата рабочим классом средств производства. «Роботы Карона апека не были изображены с темной кожей, — говорит Спарроу, — но они занимали культурное положение порабощенного низшего класса — в его понимании, это был расовый труд той эпохи». Таким образом, роботы с самого начала, представляют собой своего рода угнетенный низший класс расово настроенных рабочих», — говорит он.

Второе повествование, появившееся позже, — о том, как научная фантастика переосмыслила робота как блестящего, футуристического, вдохновляющего — построило будущее, которое, как представлялось европейской и американской научной фантастике писателей, был белым. «Это своего рода классическая научная фантастика азимовского периода — люди просто вообразили, что «высшие расы» собираются колонизировать звезды», — говорит Спарроу. Инженеры, которые выросли на этих историях, затем создали машины, которые они видели на экране. «Это должно выглядеть так, как будто это происходит из будущего», — говорит Спарроу. “На что похоже будущее? Именно об этом рассказывает нам научная фантастика.” И научная фантастика на протяжении большей части 20-го века рассказывала нам, что будущее выглядит как белые люди в элегантной обстановке. База данных антропоморфных роботов — фотографический каталог человекоподобных роботов из лабораторий по всему миру — представляет собой, по описанию Спарроу, «белую стену».»

Тем не менее, Спарроу честен в отношении пределов доказательств. «В научной литературе нет единого мнения на эту тему», — говорит он. Некоторые исследователи искали расовые реакции на роботов и ничего не нашли. В 2022 году исследователи Джейми Бэнкс (Jaime Banks) и Кевин Кобан (Kevin Koban) опубликовали исследование, в котором темные или светлые тона кожи и стереотипные мужские или женские черты оказали, как они выразились, «незначительное влияние» на стереотипное представление о роботе-гуманоиде. Участники исследования, по-видимому, стереотипизировали роботов как таковых — причисляя их к категории «нечеловеческих агентов».

Лайонел Обадиа, культурный антрополог из Лионского университета. 2 во Франции, которая изучает взаимодействие человека и робота в Европе и Азии, скептически относится к расовым стереотипам в отношении человекоподобных роботов. В его этнографических полевых исследованиях — наблюдениях за реальными людьми, взаимодействующими с настоящими роботами в естественной среде, а не в онлайн-экспериментах с изображениями — расовая принадлежность не рассматривалась как существенный фактор. «Расизм — это гораздо более человеческая проблема, чем проблема роботов», — говорит Обадия, предупреждая, что «от лабораторных исследований к реальной жизни, от изображений к воплощенным роботам, от онлайн-анкетирования к эмпирическим наблюдениям», — результаты могут не пережить этого путешествия.p>

Но более глубокое возражение Обадии касается универсализма. Он утверждает, что дискуссия чрезмерно детерминирована американскими рамками: исследования, проведенные Хе, Чжаном и Барфилдом, были проведены с участием американских участников в специфическом расовом контексте США, и Обадия не считает, что их результаты можно полностью распространить на роботов или взаимодействие человека и робота в других частях мира.

Гуманоидный робот Оптимус от Tesla показывает, с чем ученые могут не согласиться. Оптимус в основном белый, но у него черная голова и значительная часть черных панелей. В 2021 году, когда Tesla представила свою концепцию того, что должно было стать Optimus, некоторые критики усмотрели проблемы с расовым кодированием. Эксперт по цифровой этике Дэви Оттенхаймер (Davi Ottenheimer) утверждал, что презентация вызвала в воображении чернокожего слугу, которым можно управлять. Эдвард Джонс-Имхотеп, историк науки и техники, также сказал WIRED, что он видит связь между гуманоидами и этим расистским явлением.

Спарроу говорит, что, по его мнению, дизайн Optimus выглядит как белый. «Но я подозреваю, что на самом деле это был сознательный дизайнерский выбор — не делать все белым, чтобы это было оправданно», — добавляет он.

Обадия рассматривает вопрос Оптимуса как свидетельство того, как расовые рамки сами по себе искажают восприятие. «Я подозреваю, что это связано с чрезмерным вниманием к роботам, цветом кожи и расой и, наконец, расизмом: это может привести к удивительному искажению восприятия цвета роботов и к тому, что все они будут [как] белые.”

Бартнек также предостерегает от чрезмерного развития аргументации. “Чего нам следует опасаться, так это сенсационности ”, — говорит он. «Не все зависит от расы. Никого не волнует цвет вашей стиральной машины.»