Эксклюзивная беседа с Марком Ченом и Якубом Пачоцки, руководителями исследований OpenAI, о пути к более эффективным моделям рассуждений и супервыравниванию.

В последние пару лет OpenAI ощущалась как бренд, управляемый одним человеком. Генеральный директор Сэм Альтман своим шоу-бизнесом и блестящим подходом к сбору средств затмевает всех остальных крупных имен в списке компании. Даже его неудачное отстранение от дел привело к тому, что он снова оказался на вершине — и стал ещё более знаменитым, чем когда-либо. Но если взглянуть на харизматичного лидера, то станет яснее, куда движется эта компания. В конце концов, Альтман не тот, кто создал технологию, на которой зиждется её репутация.

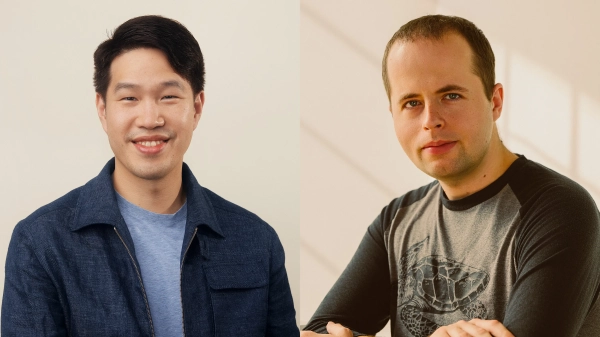

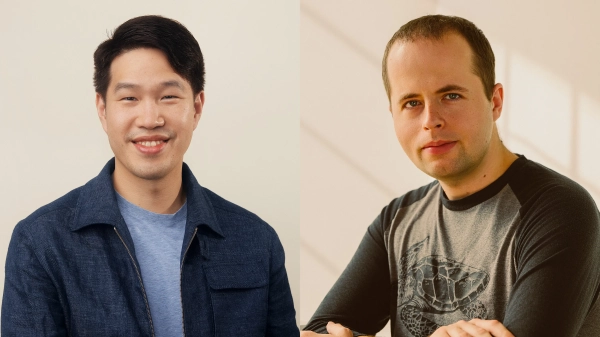

Эта ответственность лежит на двух руководителях исследований OpenAI — главном научном директоре Марке Чене и главном научном сотруднике Якубе Пачоцки. Они совместно обеспечивают OpenAI преимущество перед такими мощными конкурентами, как Google.

Я встретился с Ченом и Пачоцки для эксклюзивной беседы во время их недавней поездки в Лондон, где OpenAI открыл свой первый международный офис в 2023 году. Мы обсудили, как им удается справляться с внутренним противоречием между исследованиями и продуктом. Мы также поговорили о том, почему они считают, что программирование и математика — ключи к созданию более эффективных универсальных моделей; что они на самом деле имеют в виду, когда говорят об ИИОН; и что случилось с командой OpenAI по супервыравниванию, созданной соучредителем и бывшим главным научным сотрудником Ильей Суцкевером для предотвращения выхода гипотетического сверхинтеллекта из-под контроля и распавшейся вскоре после его ухода.

В частности, мне хотелось понять, о чем они думают в преддверии выпуска самого крупного продукта OpenAI за последние месяцы: GPT-5.

Поступают сообщения о том, что модель следующего поколения компании будет запущена в августе. Официальная позиция OpenAI (точнее, Альтмана) заключается в том, что компания выпустит GPT-5 «скоро». Ожидания высоки. Прорыв OpenAI с GPT-3, а затем и GPT-4 поднял планку того, что считалось возможным с помощью этой технологии. И всё же задержки с запуском GPT-5 породили слухи о том, что OpenAI с трудом удаётся создать модель, отвечающую её собственным, не говоря уже о всех остальных, ожиданиям.

Но управление ожиданиями — часть работы компании, которая последние несколько лет задаёт тон в отрасли. А Чэнь и Пачокки задают этот тон в OpenAI.

Твин Пикс

Главный лондонский офис компании находится в Сент-Джеймсском парке, в нескольких сотнях метров к востоку от Букингемского дворца. Но я встретился с Ченом и Пачокки в конференц-зале коворкинга недалеко от Кингс-Кросс, который OpenAI использует как своего рода пристанище в самом сердце лондонского технологического района (Google DeepMind и Meta находятся совсем рядом). Лоранс Фоконне, руководитель отдела исследовательских коммуникаций OpenAI, сидел с открытым ноутбуком на краю стола.

Чен, одетый в бордовую рубашку-поло, выглядит опрятно, почти как в стиле преппи. Он прошёл медийную подготовку и чувствует себя комфортно, общаясь с журналистом. (Вот он флиртует с чат-ботом в видеоролике «Знакомство с GPT-4o».) Пачокки, в чёрной футболке с логотипом в виде слона, больше похож на хакера из телесериала. Он много смотрит на свои руки, когда говорит.

Но эта пара — более сплочённый дуэт, чем кажется на первый взгляд. Пачокки кратко описал их роли. Чэнь, по его словам, формирует исследовательские группы и руководит ими. «Я отвечаю за разработку плана исследований и формирование нашего долгосрочного технического видения».

Связанная история

Режим обучения помогает учащимся изучать темы, а не просто давать им ответы. Но есть одна очевидная проблема.

«Но роли довольно гибкие», — сказал Чэнь. «Мы оба исследователи, мы работаем с техническими аспектами. Мы делаем всё, что можем исправить».

Чен присоединился к компании в 2018 году, до этого он работал количественным трейдером в компании Jane Street Capital на Уолл-стрит, где разрабатывал модели машинного обучения для торговли фьючерсами. В OpenAI он возглавил создание DALL-E, революционной генеративной модели изображений компании. Затем он работал над добавлением распознавания изображений в GPT‑4 и руководил разработкой Codex, генеративной модели кодирования, лежащей в основе GitHub Copilot.

Пачоцки оставил академическую карьеру в области теоретической информатики, чтобы присоединиться к OpenAI в 2017 году и сменить Суцкевера на посту главного научного руководителя в 2024 году. Наряду с Суцкевером он является одним из ключевых архитекторов так называемых моделей рассуждений OpenAI, особенно o1 и o3, которые предназначены для решения сложных задач в области науки, математики и программирования.

Когда мы встретились, они были в восторге, находясь на волне двух новых побед подряд, одержанных их компанией в сфере технологий.

16 июля одна из крупных языковых моделей OpenAI заняла второе место в финале AtCoder World Tour, одного из самых напряжённых соревнований по программированию в мире. 19 июля OpenAI объявила, что одна из её моделей достигла результатов уровня золотой медали на Международной математической олимпиаде 2025 года, одном из самых престижных математических конкурсов в мире.

Результат по математике попал в заголовки не только из-за выдающегося достижения OpenAI, но и потому, что два дня спустя конкурент Google DeepMind сообщил, что одна из его моделей достигла такого же результата в том же соревновании. Google DeepMind действовал по правилам соревнования и ждал, пока организаторы проверят результаты, прежде чем сделать объявление; OpenAI, по сути, сам оценил свои ответы.

Для Чена и Пачокки результат говорит сам за себя. В любом случае, больше всего их радует победа в программировании. «Мне кажется, её сильно недооценивают», — сказал мне Чен. Золотая медаль на Международной математической олимпиаде ставит вас где-то в двадцатку-пятерку лучших, сказал он. Но в конкурсе AtCoder модель OpenAI вошла в двойку лидеров: «Выйти на совершенно новый уровень человеческих возможностей — это беспрецедентно».

Корабль, корабль, корабль!

В OpenAI до сих пор любят говорить, что работают в исследовательской лаборатории. Но компания сильно отличается от той, что была до выхода ChatGPT три года назад. Сейчас компания соревнуется с крупнейшими и богатейшими технологическими компаниями мира, её стоимость оценивается в 300 миллиардов долларов. Грандиозные исследования и эффектные демонстрации больше не подходят. Нужно просто поставлять продукты и доставлять их людям — и, чёрт возьми, это так.

Компания OpenAI продолжает выпускать новые версии, выпустив крупные обновления серии GPT-4, ряд генеративных моделей изображений и видео, а также возможность общаться с ChatGPT голосом. Полгода назад компания запустила новую волну так называемых моделей рассуждений, выпустив версию o1, за которой вскоре последовала версия o3. А на прошлой неделе компания выпустила в открытый доступ браузерного агента Operator. Компания утверждает, что более 400 миллионов человек пользуются её продуктами каждую неделю и отправляют 2,5 миллиарда запросов в день.

Новый генеральный директор OpenAI по приложениям Фиджи Симо планирует сохранить набранные темпы. В служебной записке для сотрудников компании она сообщила, что с нетерпением ждет возможности «помочь сделать технологии OpenAI доступными большему числу людей по всему миру», где они «откроют больше возможностей для большего числа людей, чем любая другая технология в истории». Ожидается, что продукты будут продолжать появляться.

Я спросил, как OpenAI совмещает открытые исследования и разработку продуктов. «Мы думали об этом очень давно, задолго до ChatGPT», — сказал Пачокки. «Если мы действительно серьёзно настроены на создание общего искусственного интеллекта, очевидно, что по ходу дела с этой технологией можно будет сделать очень многое, и можно будет развить множество направлений, которые приведут к появлению крупных продуктов». Другими словами, продолжайте трясти дерево и собирайте урожай.

Сторонники OpenAI часто говорят о том, что выпуск экспериментальных моделей в мир был необходимой частью исследований. Цель состояла в том, чтобы показать людям, насколько хороша эта технология. «Мы хотим рассказать людям о том, что нас ждёт, чтобы мы могли участвовать в очень непростом общественном диалоге», — сказал мне Альтман в 2022 году. Создателям этой странной новой технологии также было интересно, для чего она может быть нужна: OpenAI стремилась дать её людям, чтобы посмотреть, что они будут с ней делать.

Это всё ещё так? Они ответили одновременно. «Да!» — сказал Чэнь. «В какой-то степени», — сказал Пачокки. Чэнь рассмеялся: «Нет, продолжай».

«Я бы не сказал, что исследования повторяются в процессе разработки продукта», — сказал Пачокки. «Но теперь, когда модели достигли предела возможностей, которые можно измерить классическими эталонными тестами, и многие давние проблемы, о которых мы думали, начинают отступать, мы находимся в точке, где всё решает то, что модели могут делать в реальном мире».

Это как соревноваться с людьми в соревнованиях по программированию. Программистом, который победил модель OpenAI на конкурсе AtCoder в Японии в этом году, стал программист Пшемыслав Дембяк, также известный как Psyho. Конкурс представлял собой марафон по решению головоломок, в котором участникам давалось 10 часов на поиск наиболее эффективного способа решения сложной задачи по программированию. После победы Psyho написал в X: «Я совершенно измотан… Я едва жив».

Чен и Пачоцки тесно связаны с миром соревновательного программирования. Оба в прошлом участвовали в международных соревнованиях по программированию, а Чен тренирует команду США на компьютерной олимпиаде. Я спросил, влияет ли их личный энтузиазм к соревновательному программированию на их восприятие важности успешного выступления модели в такой сложной ситуации.

Связанная история

На мероприятии «Круглый стол» для подписчиков MIT Technology Review автор книги «Империя ИИ» объясняет, почему каждый заинтересован в развитии ИИ.

Они оба рассмеялись. «Определённо», — сказал Пахоцкий. «Итак: Psyho — своего рода легенда. Он много лет был лучшим участником. Он ещё и мой друг — мы вместе участвовали в этих соревнованиях». Дембяк также работал с Пахоцким в OpenAI.

Когда Пахоцкий участвовал в соревнованиях по программированию, он отдавал предпочтение тем, которые были сосредоточены на коротких задачах с конкретными решениями. Дембяк же предпочитал более длинные, открытые задачи без очевидного правильного ответа.

«Он подшучивал надо мной, говоря, что соревнования, которые мне нравятся, будут автоматизированы задолго до тех, которые нравятся ему», — вспоминал Пачокки. «Поэтому я был серьёзно заинтересован в том, чтобы эта модель показала себя на последних соревнованиях».

Пачокки рассказал мне, что он был прикован к ночной прямой трансляции из Токио, наблюдая, как его модель заняла второе место: «Психо пока сопротивляется».

«Мы уже некоторое время отслеживаем успехи LLM на соревнованиях по программированию, — сказал Чэнь. — Мы видим, как они становятся лучше меня, лучше Якуба. Это похоже на игру Ли Седоля в го».

Ли — мастер го, проигравший серию матчей игровой модели AlphaGo от DeepMind в 2016 году. Результаты ошеломили международное сообщество го и заставили Ли отказаться от профессиональной карьеры. В прошлом году он заявил New York Times: «Поражение от искусственного интеллекта, в каком-то смысле, означало, что весь мой мир рухнул… Я больше не мог получать удовольствие от игры». И всё же, в отличие от Ли, Чен и Пачокки рады, что их превзошли.

Но почему остальных из нас должны волновать эти нишевые достижения? Очевидно, что эта технология, призванная имитировать и, в конечном счёте, заменять человеческий интеллект, создаётся людьми, для которых вершина интеллекта — это победа в математическом конкурсе или противостояние с легендарным программистом. Разве проблема в том, что это представление об интеллекте смещено в сторону математического, аналитического конца шкалы?

«Я имею в виду, я думаю, вы правы, знаете ли, эгоистично, но мы хотим создавать модели, которые ускоряют нас самих», — сказал мне Чэнь. «Мы рассматриваем это как очень быстрый фактор прогресса».

Такие исследователи, как Чен и Пачокки, утверждают, что математика и программирование — основа гораздо более общей формы интеллекта, способной решать широкий спектр задач способами, о которых мы, возможно, и не догадывались. «Мы говорим о программировании и математике», — сказал Пачокки. «Но на самом деле речь идёт о творчестве, о выдвижении новых идей, о связывании идей из разных источников».

Взгляните на два недавних соревнования: «В обоих случаях возникали проблемы, требующие очень серьёзного, нестандартного мышления. Psyho потратил половину времени соревнования на размышления, а затем придумал решение, которое оказалось действительно новым и сильно отличалось от всего, что рассматривала наша модель».

«Именно это мы и ищем», — продолжил Пачокки. «Как нам заставить модели открывать подобные новые идеи? По-настоящему расширять наши знания? Думаю, в определённых пределах они уже способны на это. Но я считаю, что эта технология способна действительно ускорить научный прогресс».

Я вернулся к вопросу о том, является ли упор на математику и программирование проблемой, и признал, что, возможно, это нормально, если мы создаём инструменты, которые помогут нам заниматься наукой. Мы не хотим, чтобы большие языковые модели заменили политиков и обладали навыками общения, предположил я.

Чен скривился и посмотрел на потолок: «Почему нет?»

Чего не хватает?

OpenAI была основана с высокомерием, превосходящим даже по меркам Кремниевой долины, хвастаясь своей целью создать ИИОН ещё тогда, когда разговоры об ИИОНе казались чем-то невероятным. OpenAI по-прежнему с таким же энтузиазмом относится к ИИОНу и сделала больше, чем большинство, чтобы ИИОН стал мейнстримным многомиллиардным проектом. Однако пока этого не произошло. Я спросил Чена и Пачокки, чего, по их мнению, не хватает.

«Я думаю, что для того, чтобы представить себе будущее, необходимо действительно глубоко изучать технологии, которые мы видим сегодня», — сказал Пачоцки. «С самого начала OpenAI рассматривала глубокое обучение как очень загадочную и, безусловно, очень мощную технологию с огромным потенциалом. Мы пытались понять её слабые места. Что она может делать? Чего она не может?»

По словам Чэня, сейчас на переднем крае находятся модели рассуждений, которые разбивают проблемы на более мелкие, более управляемые этапы, но даже у них есть ограничения: «Знаете, есть эти модели, которые знают много вещей, но не могут связать эти знания воедино. Почему? Почему они не могут делать это так, как это делают люди?»

OpenAI делает все возможное, чтобы ответить на этот вопрос.

«Мы, вероятно, всё ещё находимся в самом начале пути к этой парадигме рассуждений», — сказал мне Пачоцки. «На самом деле, мы думаем о том, как заставить эти модели учиться и развиваться в долгосрочной перспективе и действительно генерировать совершенно новые идеи».

Чэнь довёл дело до конца: «Я действительно не считаю, что рассуждения закончены. Мы определённо не решили эту проблему. Приходится читать очень много текста, чтобы получить хотя бы приблизительное представление о том, что известно людям».

OpenAI не раскрывает, какие данные она использует для обучения своих моделей, и не приводит подробности об их размере и форме — лишь сообщает, что она прилагает все усилия, чтобы сделать все этапы процесса разработки более эффективными.

Эти усилия вселяют в них уверенность в том, что так называемые законы масштабирования, предполагающие, что модели будут становиться лучше по мере увеличения объема вычислений, не демонстрируют никаких признаков нарушения.

«Не думаю, что есть доказательства того, что законы масштабирования в каком-либо смысле мертвы», — настаивал Чэнь. «Узкие места были всегда, верно? Иногда они связаны со способом построения моделей. Иногда — с данными. Но по сути, речь идёт о поиске исследований, которые помогут преодолеть текущее узкое место».

Вера в прогресс непоколебима. Я вспомнил слова Пачоцки об ИИ, сказанные им в майском интервью журналу Nature: «Когда я пришёл в OpenAI в 2017 году, я всё ещё был одним из самых больших скептиков в компании». Он выглядел сомневающимся.

«Не уверен, что я был настроен скептически по отношению к этой концепции», — сказал он. «Но, кажется, я был…» Он сделал паузу, глядя на свои руки на столе перед собой. «Когда я присоединился к OpenAI, я ожидал, что нам потребуется больше времени, чтобы достичь того, что мы имеем сейчас».

Связанная история

Это заявление подтверждает один из двух слухов, циркулировавших в интернете на этой неделе. Другой касался сверхразума.

«Искусственный интеллект имеет множество последствий, — сказал он. — Но больше всего меня волнует автоматизированное исследование. История человечества во многом связана с технологическим прогрессом, с тем, как люди создают новые технологии. Момент, когда компьютеры смогут самостоятельно разрабатывать новые технологии, кажется очень важным, так сказать, переломным моментом».

Мы уже видим, как эти модели помогают учёным. Но когда они смогут работать с более широкими горизонтами — когда они смогут самостоятельно разрабатывать исследовательские программы, — мир станет совершенно другим».

Для Чена способность моделей работать самостоятельно дольше имеет ключевое значение. «Я имею в виду, что у каждого своё определение ИИОН», — сказал он. «Но эта концепция автономного времени — просто количества времени, которое модель может потратить на продуктивное решение сложной задачи, не заходя в тупик, — это одна из важнейших задач, к которым мы стремимся».

Это смелая задумка, далеко превосходящая возможности современных моделей. Но меня, тем не менее, поразило, как Чен и Пачокки представили ИИОН почти как нечто обыденное. Сравните это с тем, как Суцкевер отреагировал на мой разговор полтора года назад. «Это будет монументально, сногсшибательно», — сказал он мне. «Будет до и после». Столкнувшись с грандиозностью того, что он создавал, Суцкевер переключил фокус своей карьеры с разработки всё более совершенных моделей на поиск способов управления технологией, которая, по его мнению, вскоре превзойдёт его самого.

Два года назад Суцкевер создал так называемую команду супервыравнивания, которую он возглавил совместно с другим исследователем безопасности OpenAI, Яном Лейке. Предполагалось, что эта команда направит пятую часть ресурсов OpenAI на разработку способов управления гипотетическим сверхразумом. Сегодня большинство участников команды супервыравнивания, включая Суцкевера и Лейке, покинули компанию, и команда распалась.

Когда Лейке ушёл, он объяснил это тем, что команда не получила той поддержки, которую, по его мнению, она заслуживала. Он написал об этом в X: «Создание машин, превосходящих человека по интеллекту, — изначально опасное начинание. OpenAI несёт огромную ответственность от имени всего человечества. Но в последние годы культура безопасности и процессы отошли на второй план, уступив место блестящим продуктам». Другие уходящие исследователи высказали схожие заявления.

Я спросил Чена и Пачокки, что они думают о подобных проблемах. «Многие из этих вещей — сугубо личные решения», — сказал Чен. «Знаете, исследователь может… ну, вы понимаете…»

Он начал снова. «Они могут быть убеждены, что область будет развиваться определённым образом, что их исследования увенчаются успехом и принесут плоды. И, знаете, компания, возможно, не перестроится так, как вам хотелось бы. Это очень динамичная область».

«Многие из этих вещей — личные решения», — повторил он. «Иногда область просто развивается в направлении, которое всё меньше соответствует вашему подходу к исследованиям».

Но, как утверждают оба, согласование теперь является частью основного бизнеса, а не заботой одной конкретной команды. По словам Пачокки, эти модели не работают вообще, если не работают так, как вы ожидаете. Кроме того, мало желания сосредотачиваться на согласовании гипотетического сверхразума с вашими целями, когда это уже само по себе представляет сложную задачу с существующими моделями.

«Два года назад риски, которые мы представляли, были в основном теоретическими», — сказал Пачокки. «Сегодня мир выглядит совсем иначе, и я думаю, что многие проблемы с выравниванием теперь имеют вполне практическую подоплеку».

Тем не менее, экспериментальные технологии превращаются в продукты массового рынка быстрее, чем когда-либо прежде. Неужели это никогда не приводит к разногласиям между ними?

« Мне часто предоставляется возможность по-настоящему задуматься о долгосрочной перспективе, о том, куда будут двигаться технологии», — сказал Пачоцки. «Столкновение с реальностью процесса — как с точки зрения людей, так и с более широкими потребностями компании — ложится на Марка. На самом деле, это не разногласие, но между этими разными целями и разными вызовами, с которыми сталкивается компания, существует естественное противоречие, которое возникает между нами».

Чен вмешался: «Я думаю, это просто очень тонкий баланс».

Исправление: мы удалили строку, ссылающуюся на сообщение Альтмана в X о GPT-5. Мы исправили, кто стоял за моделями рассуждений OpenAI, включив в них ссылку на Суцкевера.

Источник: www.technologyreview.com