В понедельник исследователи DeepSeek представили новую экспериментальную модель V3.2-exp, разработанную для значительного снижения затрат на вывод при использовании в долгосрочных контекстных операциях. DeepSeek анонсировала модель в публикации на Hugging Face, а также опубликовала ссылку на научную статью на GitHub.

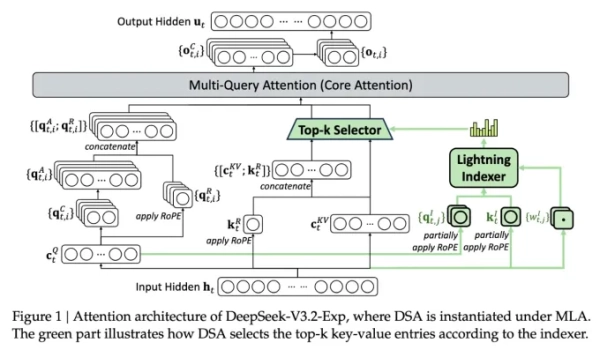

Важнейшей функцией новой модели является DeepSeek Sparse Attention – сложная система, подробно описанная на схеме ниже. По сути, система использует модуль, называемый «молниеносным индексатором», для приоритизации определённых фрагментов из контекстного окна. После этого отдельная система, называемая «системой точного выбора токенов», выбирает из этих фрагментов определённые токены для загрузки в ограниченное окно внимания модуля. В совокупности они позволяют моделям Sparse Attention работать с большими фрагментами контекста при сравнительно небольшой нагрузке на сервер.

Для операций с длинным контекстом преимущества системы весьма существенны. Предварительное тестирование DeepSeek показало, что стоимость простого вызова API может быть снижена вдвое в ситуациях с длинным контекстом. Для более надёжной оценки потребуются дополнительные испытания, но, поскольку модель имеет открытый вес и свободно доступна на Hugging Face, вскоре сторонние тесты смогут оценить утверждения, сделанные в статье.

Новая модель DeepSeek — одно из ряда недавних прорывов, направленных на решение проблемы затрат на вывод — по сути, серверных затрат на работу предварительно обученной модели ИИ, в отличие от затрат на её обучение. В случае DeepSeek исследователи искали способы повысить эффективность фундаментальной архитектуры преобразователя и обнаружили, что есть возможность значительного улучшения.

Базирующаяся в Китае компания DeepSeek стала необычной фигурой на фоне бума ИИ, особенно для тех, кто рассматривает исследования в этой области как националистическую борьбу между США и Китаем. В начале года компания произвела фурор своей моделью R1, обученной преимущественно с использованием обучения с подкреплением и при этом значительно более низкой стоимости, чем у американских конкурентов. Однако эта модель не произвела настоящей революции в обучении ИИ, как предсказывали некоторые, и в последующие месяцы компания ушла из поля зрения.

Новый подход с «рассеянным вниманием» вряд ли вызовет такой же резонанс, как R1, но он все же может научить американских поставщиков некоторых крайне необходимых приемов, которые помогут снизить затраты на вывод.

Источник: techcrunch.com