DeepSeek снова трясёт индустрию: новый метод масштабирования LLM

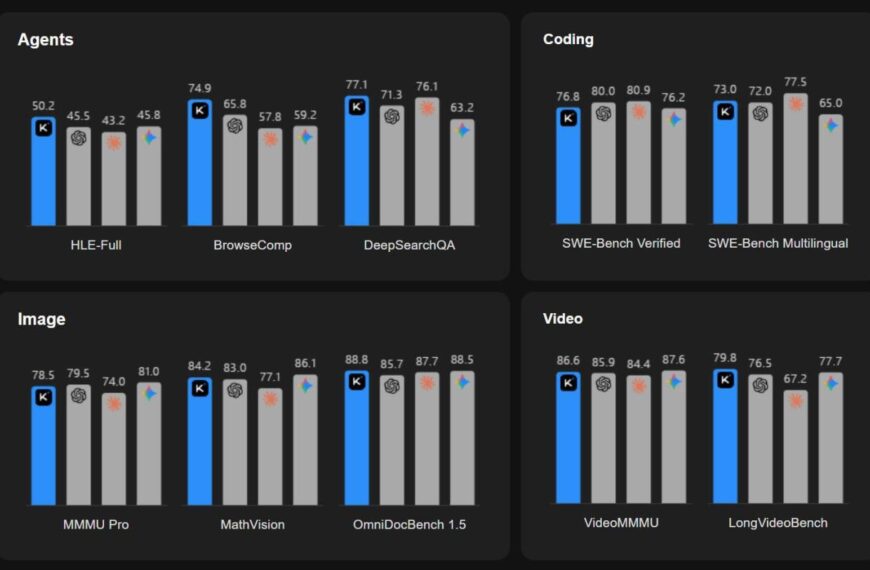

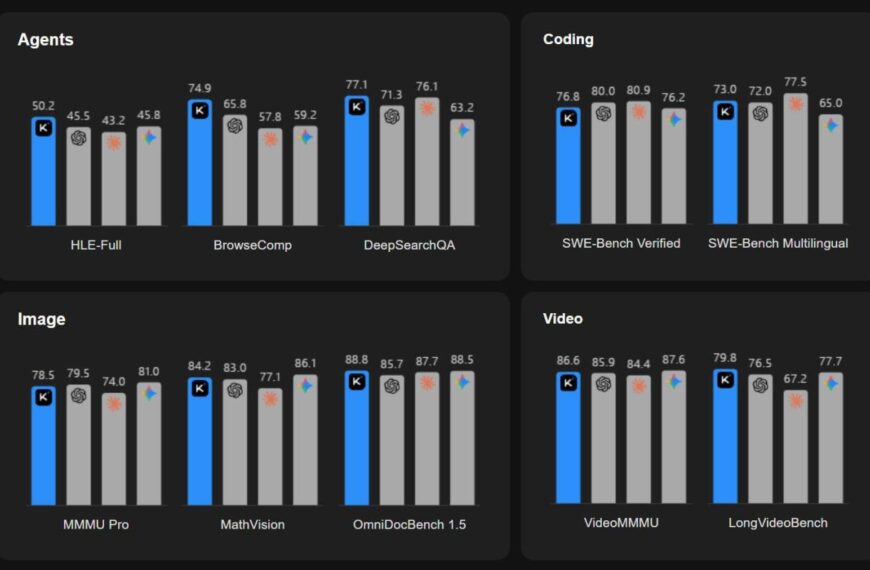

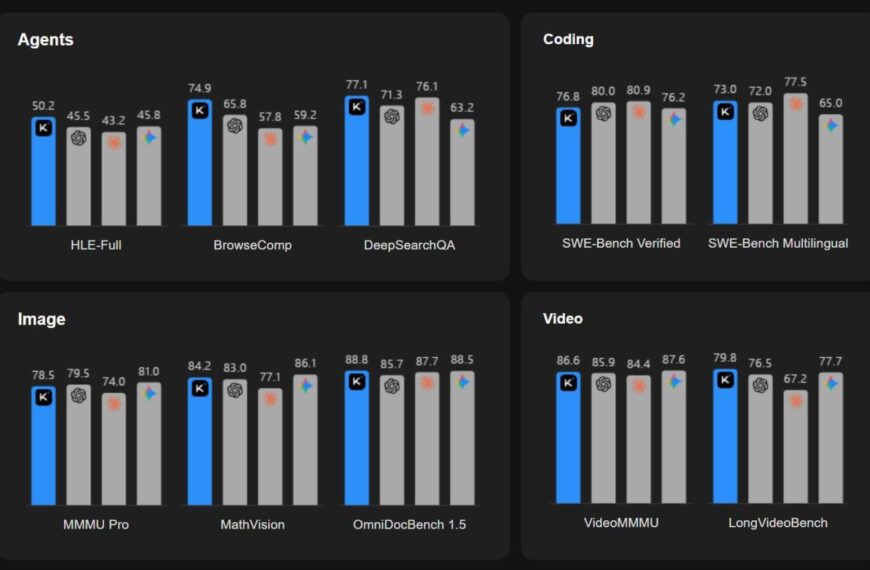

Китайский стартап DeepSeek опубликовал исследование по масштабированию больших языковых моделей. Подход получил название Manifold-Constrained Hyper-Connections (mHC) — он позволяет модели обмениваться информацией внутри себя без потери стабильности и без резкого роста вычислительных затрат.

Аналитики уже называют это поразительным прорывом. mHC может заметно ускорить разработку новых флагманов, включая ожидаемую R2, и подтолкнуть конкурентов к созданию собственных версий метода.

Ранее DeepSeek уже удивил рынок моделью R1, которая по качеству сопоставима с топовыми решениями вроде ChatGPT, но требует значительно меньших затрат. Новый метод обещает повторить для компании тот самый «Sputnik-момент» — когда правила игры внезапно меняются.