Даже когда выясняется, что контент был сфальсифицирован, он всё равно формирует наши убеждения. Защитники истины безнадежно отстают.

Эта статья первоначально появилась в The Algorithm, нашей еженедельной рассылке об искусственном интеллекте. Чтобы первыми получать подобные статьи на свою электронную почту, подпишитесь здесь.

Что нужно, чтобы убедить вас в том, что эпоха разрушения правды, о которой нас давно предупреждали, — когда контент, созданный ИИ, обманывает нас, формирует наши убеждения, даже когда мы разоблачаем ложь, и подрывает доверие общества в процессе, — уже наступила? Статья, которую я опубликовал на прошлой неделе, окончательно вывела меня из себя. Она также заставила меня осознать, что инструменты, которые нам продавали как лекарство от этого кризиса, терпят сокрушительный провал.

В четверг я сообщил о первом подтверждении того, что Министерство внутренней безопасности США, в состав которого входят иммиграционные ведомства, использует генераторы видео на основе искусственного интеллекта от Google и Adobe для создания контента, которым оно делится с общественностью. Эта новость появилась на фоне того, как иммиграционные ведомства наводнили социальные сети контентом в поддержку программы массовой депортации президента Трампа — часть которого, по всей видимости, создана с помощью ИИ (например, видео о «Рождестве после массовых депортаций»).

Но я получил два типа откликов от читателей, которые, возможно, в равной степени объясняют эпистемологический кризис, в котором мы сейчас находимся.

Один из комментариев был от людей, которых это не удивило, поскольку 22 января Белый дом опубликовал отредактированную цифровым способом фотографию женщины, арестованной на акции протеста против ICE (Иммиграционной и таможенной службы США), на которой она выглядела истеричной и плачущей. Каэлан Дорр, заместитель директора по коммуникациям Белого дома, не ответил на вопросы о том, редактировал ли Белый дом фотографию, но написал: «Мемы будут продолжаться».

Второй отзыв поступил от читателей, которые не видели смысла сообщать о том, что Министерство внутренней безопасности США использует ИИ для редактирования контента, распространяемого среди общественности, поскольку новостные агентства, по-видимому, делали то же самое. Они указали на тот факт, что новостной канал MS Now (ранее MSNBC) опубликовал изображение Алекса Претти, отредактированное с помощью ИИ, которое, как казалось, сделало его более привлекательным. Этот факт привел к появлению множества вирусных роликов на этой неделе, включая один из подкаста Джо Рогана. Другими словами, бороться с огнем огнем? Представитель MS Now сообщил Snopes, что новостное агентство показало изображение, не зная, что оно было отредактировано.

Нет оснований объединять эти два случая изменения контента в одну категорию или рассматривать их как доказательство того, что правда больше не имеет значения. В одном случае правительство США опубликовало в открытом доступе явно измененную фотографию и отказалось отвечать на вопрос, была ли она намеренно отредактирована; в другом случае новостное агентство показало фотографию, о которой оно должно было знать, что она изменена, но предприняло шаги для раскрытия ошибки.

Вместо этого, подобные реакции выявляют недостаток в том, как мы коллективно готовились к этому моменту. Предупреждения о кризисе правды в сфере ИИ вращались вокруг ключевого тезиса: неспособность отличить правду от лжи уничтожит нас, поэтому нам нужны инструменты для независимой проверки истины. Мои два мрачных вывода заключаются в том, что эти инструменты терпят неудачу, и что, хотя проверка правды остается важной, она больше не способна сама по себе обеспечить обещанное нам общественное доверие.

Связанная статья

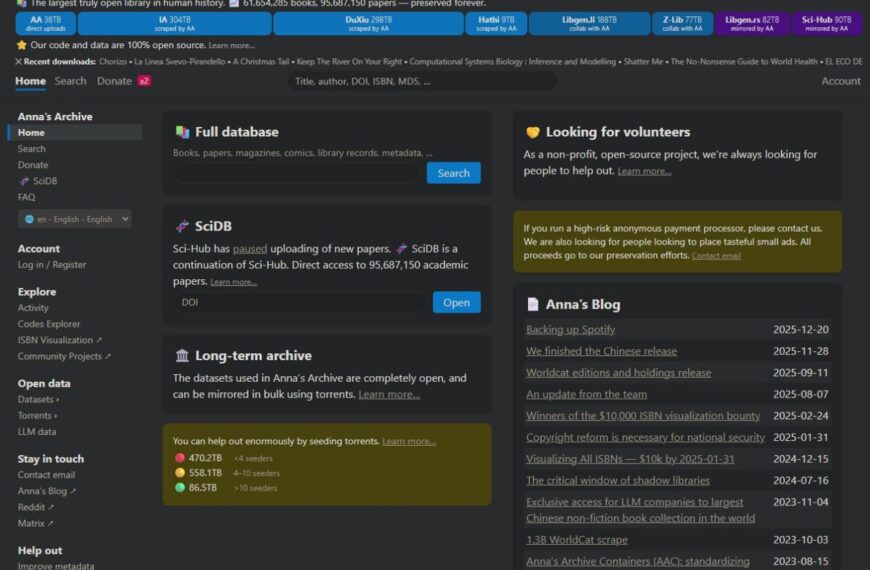

Например, в 2024 году много говорили об Инициативе по обеспечению подлинности контента (Content Authenticity Initiative), одним из соучредителей которой была Adobe, а организацией — крупные технологические компании. Эта инициатива предполагала добавление к контенту меток, указывающих на время создания, автора и использование ИИ. Однако даже сама Adobe применяет эти метки только в том случае, если контент полностью создан с помощью ИИ, а не частично.

А такие платформы, как X, где было опубликовано измененное фото ареста, могут в любом случае удалить подобные метки с контента (примечание о том, что фотография была изменена, было добавлено пользователями). Платформы также могут просто не показывать метку; действительно, когда Adobe запустила эту инициативу, она отметила, что веб-сайт Пентагона для обмена официальными изображениями, DVIDS, будет отображать метки для подтверждения подлинности, но проверка веб-сайта сегодня не показывает таких меток.

Заметив, какой резонанс вызвала фотография Белого дома даже после того, как выяснилось, что она была отредактирована с помощью ИИ, я был поражен результатами очень актуальной новой статьи, опубликованной в журнале Communications Psychology. В исследовании участники смотрели дипфейк-«признание» в преступлении, и исследователи обнаружили, что даже когда им прямо говорили, что доказательства поддельные, участники полагались на них при оценке вины человека. Иными словами, даже когда люди узнают, что контент, который они видят, полностью фейковый, они всё равно остаются под его эмоциональным влиянием.

«Прозрачность помогает, но сама по себе она недостаточна», — написал недавно эксперт по дезинформации Кристофер Неринг, комментируя результаты исследования. «Нам необходимо разработать новый генеральный план действий в отношении дипфейков».

Инструменты искусственного интеллекта для создания и редактирования контента становятся все более совершенными, простыми в использовании и дешевыми в эксплуатации — все это причины, по которым правительство США все чаще платит за их использование. Нас об этом хорошо предупреждали, но мы отреагировали, подготовившись к миру, в котором главной опасностью будет путаница. Вместо этого мы попадаем в мир, где влияние сохраняется, если его разоблачить, сомнения легко использовать как оружие, а установление истины не служит кнопкой перезагрузки. И защитники истины уже сильно отстают.

Источник: www.technologyreview.com